矢量化 L1 损失?

pytorch 196

原文标题 :Vectorized L1 loss?

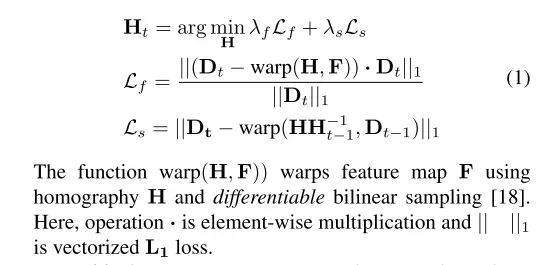

我正在阅读一篇论文,其中提到他们正在使用矢量化 L1 损失,这在编码方面意味着什么?与常规的 L1 损失有什么区别吗?从论文中,这是公式:

看Lf,如果我写代码,不就是看起来像普通的 L1 损失吗?

import torch.nn.functional as F

loss_f = F.l1_loss(D_t, warped * D_t)

loss_f.backward()

如果是这样,为什么要特别提到向量化 L1 损失?我错过了什么?