1、简介

第一次发帖,就是想尝试一些不为人知的领域,也想为自己的成长做一点见证。当然,也希望能帮助在这条路上一起努力的每一个人,做到最好。

写到这里,机会是我也想尝试做人脸识别,因为觉得自己比较感兴趣,觉得自己有能力去做。在这个实践的过程中,看了很多文章,学习了很多别人的代码,也学到了很多,但是我也发现很多可能是因为版本变化和兼容性问题,所以我也想帮助别人.踩一些坑,和大家分享一下你的心路历程。

本文最初是看了这位前辈的文章,然后想要实现https://blog.csdn.net/qq_42633819/article/details/81191308

因为人丑所以没有拿自己的数据去做,而是在网上找了一些视频去做视觉识别,因为我是用了一个人的两段完全不同视频,后面得到的效果还是不错的,模型得到的拟合效果也是几乎100%,下面直接亮教程和代码。

2、工具准备

至于环境配置,我先在这方面下了不少功夫,因为很多数据包的准备很麻烦,原因有很多,所以这里给大家支个招。

环境配置

Anaconda3

tensorflow2.6.0

python3.9.7

Keras也是2.6.0

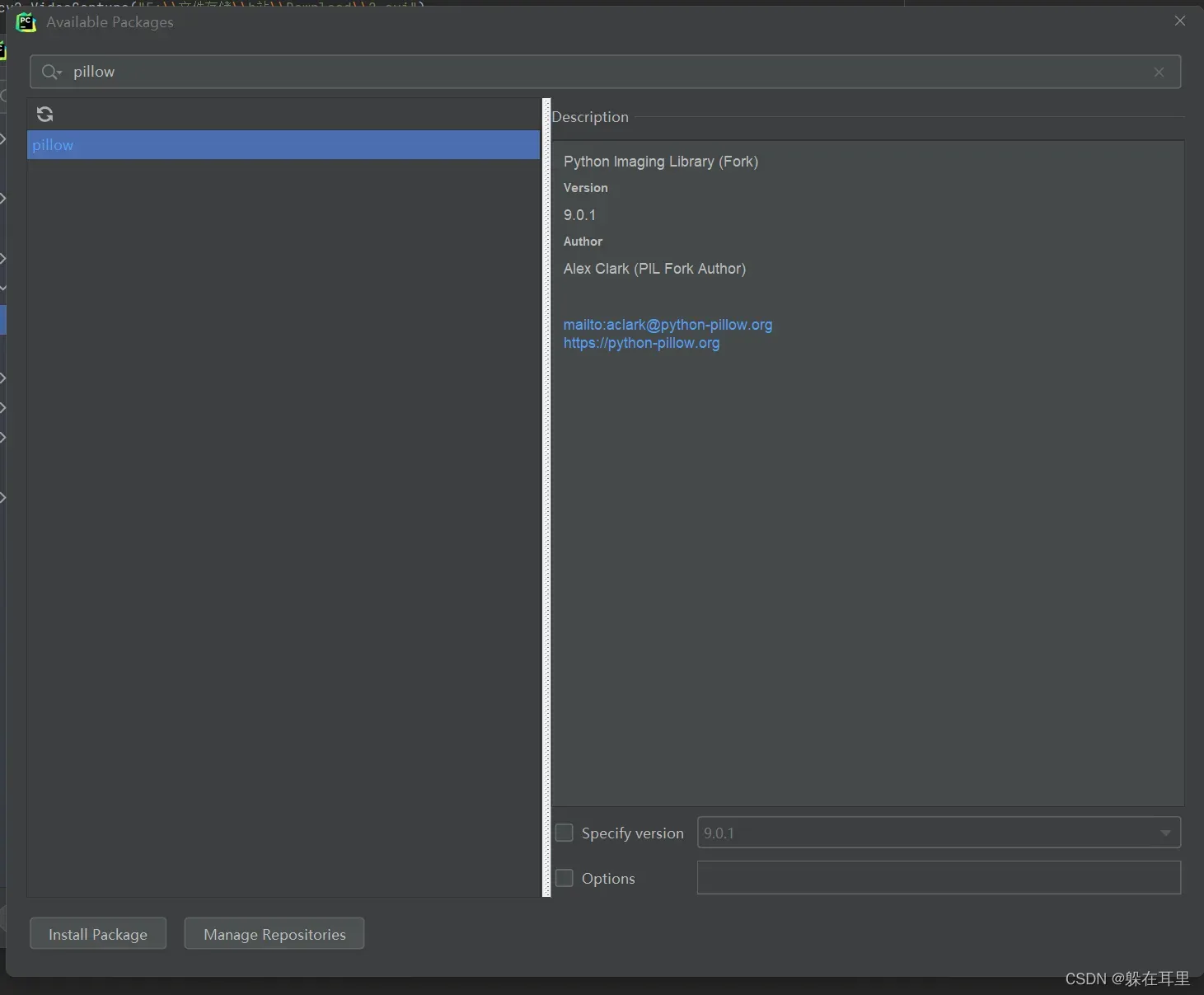

pillow(pyhcarm里配置即可)

opencv4.5.5

剩下的可能就是Haar级联表,这个感觉获取方式很多,如果实在没有也可以联系我私发。

3、人脸识别(先画个框)

这一步的话,就是用opencv和级联表Haar为主。代码我直接展示

import cv2

import sys

from PIL import Image

#1-4对应的分别是窗口名,图像数据传入接口,获取多少帧作为训练目标,照片导入目标地址

def CatchPICFromVideo(window_name, camera_idx, catch_pic_num, path_name):

cv2.namedWindow(window_name)

# 视频来源

cap = cv2.VideoCapture(camera_idx)

# 告诉OpenCV使用人脸识别分类器

classfier = cv2.CascadeClassifier("F:\\ros\\ros_exploring-master\\robot_perception\\robot_vision\\data\\haar_detectors\\haarcascade_frontalface_alt.xml")

# 识别出人脸后要画的边框的颜色,可以自己定义

color = (0, 255, 0)

num = 0

while cap.isOpened():

ok, frame = cap.read() # 读取一帧数据

if not ok:

break

grey = cv2.cvtColor(frame, cv2.COLOR_BGR2GRAY) # 将当前桢图像转换成灰度图像

# 人脸检测,1.2和2分别为图片缩放比例和需要检测的有效点数

faceRects = classfier.detectMultiScale(grey, scaleFactor=1.2, minNeighbors=3, minSize=(32, 32))

if len(faceRects) > 0: # 大于0则检测到人脸

for faceRect in faceRects: # 单独框出每一张人脸

x, y, w, h = faceRect

# 将当前帧保存为图片

img_name = '%s/%d.jpg' % (path_name, num)

image = frame[y - 10: y + h + 10, x - 10: x + w + 10]

cv2.imwrite(img_name, image)

num += 1

if num > (catch_pic_num): # 如果超过指定最大保存数量退出循环

break

# 画出矩形框

cv2.rectangle(frame, (x - 10, y - 10), (x + w + 10, y + h + 10), color, 2)

# 显示当前捕捉数量

font = cv2.FONT_HERSHEY_SIMPLEX

cv2.putText(frame, 'num:%d' % (num), (x + 30, y + 30), font, 1, (255, 0, 255), 4)

# 超过指定最大保存数量结束程序

if num > (catch_pic_num): break

# 显示图像

cv2.imshow(window_name, frame)

c = cv2.waitKey(10)

if c & 0xFF == ord('q'):

break

# 释放摄像头并销毁所有窗口

cap.release()

cv2.destroyAllWindows()

if __name__ == '__main__':

if len(sys.argv) != 1:

print("Usage:%s camera_id face_num_max path_name\r\n" % (sys.argv[0]))

else:

CatchPICFromVideo("截取人脸", "E:\\文件存储\\b站\\Download\\1_1.avi", 200, "F:\\ros\\Original code\\recongniaze_face\\photo")这样窗口就会框出人脸,然后将获取到的对应数据导入到对应的文件中。

4、图片调整

这是为了确保图像的长度和宽度相等。

import os

import sys

import numpy as np

import cv2

IMAGE_SIZE = 64

# 按照指定图像大小调整尺寸

def resize_image(image, height=IMAGE_SIZE, width=IMAGE_SIZE):

top, bottom, left, right = (0, 0, 0, 0)

# 获取图像尺寸

h, w, _ = image.shape

# 对于长宽不相等的图片,找到最长的一边

longest_edge = max(h, w)

# 计算短边需要增加多上像素宽度使其与长边等长

if h < longest_edge:

dh = longest_edge - h

top = dh // 2

bottom = dh - top

elif w < longest_edge:

dw = longest_edge - w

left = dw // 2

right = dw - left

else:

pass

# RGB颜色

BLACK = [0, 0, 0]

# 给图像增加边界,是图片长、宽等长,cv2.BORDER_CONSTANT指定边界颜色由value指定

constant = cv2.copyMakeBorder(image, top, bottom, left, right, cv2.BORDER_CONSTANT, value=BLACK)

# 调整图像大小并返回

return cv2.resize(constant, (height, width))

# 读取训练数据

images = []

labels = []

def read_path(path_name):

for dir_item in os.listdir(path_name):

# 从初始路径开始叠加,合并成可识别的操作路径

full_path = os.path.abspath(os.path.join(path_name, dir_item))

if os.path.isdir(full_path): # 如果是文件夹,继续递归调用

read_path(full_path)

else: # 文件

if dir_item.endswith('.jpg'):

image = cv2.imread(full_path)

image = resize_image(image, IMAGE_SIZE, IMAGE_SIZE)

# 放开这个代码,可以看到resize_image()函数的实际调用效果

# cv2.imwrite('1.jpg', image)

images.append(image)

labels.append(path_name)

return images, labels

# 从指定路径读取训练数据

def load_dataset(path_name):

images, labels = read_path(path_name)

# 将输入的所有图片转成四维数组,尺寸为(图片数量*IMAGE_SIZE*IMAGE_SIZE*3)

# 图片为64 * 64像素,一个像素3个颜色值(RGB)

images = np.array(images)

print(images.shape)

# 标注数据,'change_photo'文件夹下都是脸部图像,全部指定为0

labels = np.array([0 if label.endswith('photo') else 1 for label in labels])

return images, labels

if __name__ == '__main__':

if len(sys.argv) != 1:

print("Usage:%s path_name\r\n" % (sys.argv[0]))

else:

images, labels = load_dataset("F:\\ros\\Original code\\recongniaze_face\\photo")将照片变成方形矩阵后,就可以对模型进行训练。我这里的话其实训练量很小,也就大概200份这样,但其准确度后来看也很不错

5、模型训练

这里用的就是tensorflow.keras的方法,配合CNN卷积神经网络来学习,这里是踩过不少的坑,统一的,我照片数据输入方式使用 ‘tf’,也就是 ‘channels_first’的方式输入,另一种方法就是 ‘th’,也就是 ‘channels_last’的方法,然后很多函数的名字也发生了改变,我也进行了很多校正,这之中花了很多的时间。

事不宜迟,让我们进入代码!

import random

import numpy as np

from sklearn.model_selection import train_test_split

from keras.preprocessing.image import ImageDataGenerator

from keras.models import Sequential

from keras.layers import Dense, Dropout, Activation, Flatten

from keras.layers import Convolution2D, MaxPooling2D

from tensorflow.keras.optimizers import SGD

from keras.utils import np_utils

from keras.models import load_model

from keras import backend as K

from change_photo import load_dataset, resize_image, IMAGE_SIZE

class Dataset:

def __init__(self, path_name):

# 训练集

self.train_images = None

self.train_labels = None

# 验证集

self.valid_images = None

self.valid_labels = None

# 测试集

self.test_images = None

self.test_labels = None

# 数据集加载路径

self.path_name = path_name

# 当前库采用的维度顺序

self.input_shape = None

# 加载数据集并按照交叉验证的原则划分数据集并进行相关预处理工作

def load(self, img_rows=IMAGE_SIZE, img_cols=IMAGE_SIZE,

img_channels=3, nb_classes=2):

# 加载数据集到内存

images, labels = load_dataset(self.path_name)

train_images, valid_images, train_labels, valid_labels = train_test_split(images, labels, test_size=0.3,

random_state=random.randint(0, 100))

_, test_images, _, test_labels = train_test_split(images, labels, test_size=0.5,

random_state=random.randint(0, 100))

# 这部分代码就是根据keras库要求的维度顺序重组训练数据集

if K.image_data_format() == 'channels_first':

train_images = train_images.reshape(train_images.shape[0], img_channels, img_rows, img_cols)

valid_images = valid_images.reshape(valid_images.shape[0], img_channels, img_rows, img_cols)

test_images = test_images.reshape(test_images.shape[0], img_channels, img_rows, img_cols)

self.input_shape = (img_channels, img_rows, img_cols)

else:

train_images = train_images.reshape(train_images.shape[0], img_rows, img_cols, img_channels)

valid_images = valid_images.reshape(valid_images.shape[0], img_rows, img_cols, img_channels)

test_images = test_images.reshape(test_images.shape[0], img_rows, img_cols, img_channels)

self.input_shape = (img_rows, img_cols, img_channels)

# 输出训练集、验证集、测试集的数量

print(train_images.shape[0], 'train samples')

print(valid_images.shape[0], 'valid samples')

print(test_images.shape[0], 'test samples')

# 我们的模型使用categorical_crossentropy作为损失函数,因此需要根据类别数量nb_classes将

# 类别标签进行one-hot编码使其向量化,在这里我们的类别只有两种,经过转化后标签数据变为二维

train_labels = np_utils.to_categorical(train_labels, nb_classes)

valid_labels = np_utils.to_categorical(valid_labels, nb_classes)

test_labels = np_utils.to_categorical(test_labels, nb_classes)

# 像素数据浮点化以便归一化

train_images = train_images.astype('float32')

valid_images = valid_images.astype('float32')

test_images = test_images.astype('float32')

# 将其归一化,图像的各像素值归一化到0~1区间

train_images /= 255

valid_images /= 255

test_images /= 255

self.train_images = train_images

self.valid_images = valid_images

self.test_images = test_images

self.train_labels = train_labels

self.valid_labels = valid_labels

self.test_labels = test_labels

# CNN网络模型类

class Model:

def __init__(self):

self.model = None

# 建立模型

def build_model(self, dataset, nb_classes=2):

# 构建一个空的网络模型,它是一个线性堆叠模型,各神经网络层会被顺序添加,专业名称为序贯模型或线性堆叠模型

self.model = Sequential()

# 以下代码将顺序添加CNN网络需要的各层,一个add就是一个网络层

self.model.add(Convolution2D(32, (3, 3), padding='same',input_shape=dataset.input_shape))# 1 2维卷积层

self.model.add(Activation('relu')) # 2 激活函数层

self.model.add(Convolution2D(32, (3, 3))) # 3 2维卷积层

self.model.add(Activation('relu')) # 4 激活函数层

self.model.add(MaxPooling2D(pool_size=(2, 2))) # 5 池化层

self.model.add(Dropout(0.25)) # 6 Dropout层

self.model.add(Convolution2D(64,( 3, 3), padding='same')) # 7 2维卷积层

self.model.add(Activation('relu')) # 8 激活函数层

self.model.add(Convolution2D(64, 3, 3)) # 9 2维卷积层

self.model.add(Activation('relu')) # 10 激活函数层

self.model.add(MaxPooling2D(pool_size=(2, 2))) # 11 池化层

self.model.add(Dropout(0.25)) # 12 Dropout层

self.model.add(Flatten()) # 13 Flatten层

self.model.add(Dense(512)) # 14 Dense层,又被称作全连接层

self.model.add(Activation('relu')) # 15 激活函数层

self.model.add(Dropout(0.5)) # 16 Dropout层

self.model.add(Dense(nb_classes)) # 17 Dense层

self.model.add(Activation('softmax')) # 18 分类层,输出最终结果

# 输出模型概况

self.model.summary()

# 训练模型

def train(self, dataset, batch_size=20, nb_epoch=10, data_augmentation=True):

sgd = SGD(lr=0.01, decay=1e-6,

momentum=0.9, nesterov=True) # 采用SGD+momentum的优化器进行训练,首先生成一个优化器对象

self.model.compile(loss='categorical_crossentropy',

optimizer=sgd,

metrics=['accuracy']) # 完成实际的模型配置工作

# 不使用数据提升,所谓的提升就是从我们提供的训练数据中利用旋转、翻转、加噪声等方法创造新的

# 训练数据,有意识的提升训练数据规模,增加模型训练量

if not data_augmentation:

self.model.fit(dataset.train_images,

dataset.train_labels,

batch_size=batch_size,

nb_epoch=nb_epoch,

validation_data=(dataset.valid_images, dataset.valid_labels),

shuffle=True)

# 使用实时数据提升

else:

# 定义数据生成器用于数据提升,其返回一个生成器对象datagen,datagen每被调用一

# 次其生成一组数据(顺序生成),节省内存,其实就是python的数据生成器

datagen = ImageDataGenerator(

featurewise_center=False, # 是否使输入数据去中心化(均值为0),

samplewise_center=False, # 是否使输入数据的每个样本均值为0

featurewise_std_normalization=False, # 是否数据标准化(输入数据除以数据集的标准差)

samplewise_std_normalization=False, # 是否将每个样本数据除以自身的标准差

zca_whitening=False, # 是否对输入数据施以ZCA白化

rotation_range=20, # 数据提升时图片随机转动的角度(范围为0~180)

width_shift_range=0.2, # 数据提升时图片水平偏移的幅度(单位为图片宽度的占比,0~1之间的浮点数)

height_shift_range=0.2, # 同上,只不过这里是垂直

horizontal_flip=True, # 是否进行随机水平翻转

vertical_flip=False) # 是否进行随机垂直翻转

# 计算整个训练样本集的数量以用于特征值归一化、ZCA白化等处理

datagen.fit(dataset.train_images)

# 利用生成器开始训练模型

self.model.fit_generator(datagen.flow(dataset.train_images, dataset.train_labels,

batch_size=batch_size),

steps_per_epoch=dataset.train_images.shape[0],

epochs=nb_epoch,

validation_data=(dataset.valid_images, dataset.valid_labels))

MODEL_PATH = './CWT.face.model.h5'

def save_model(self, file_path=MODEL_PATH):

self.model.save(file_path)

def load_model(self, file_path=MODEL_PATH):

self.model = load_model(file_path)

def evaluate(self, dataset):

score = self.model.evaluate(dataset.test_images, dataset.test_labels, verbose=1)

print("%s: %.2f%%" % (self.model.metrics_names[1], score[1] * 100))

# 识别人脸

def face_predict(self, image):

# 依然是根据后端系统确定维度顺序

if K.image_data_format() == 'channels_first' and image.shape != (1, 3, IMAGE_SIZE, IMAGE_SIZE):

image = resize_image(image) # 尺寸必须与训练集一致都应该是IMAGE_SIZE x IMAGE_SIZE

image = image.reshape((1, 3, IMAGE_SIZE, IMAGE_SIZE)) # 与模型训练不同,这次只是针对1张图片进行预测

elif K.image_data_format() == 'channels_last' and image.shape != (1, IMAGE_SIZE, IMAGE_SIZE, 3):

image = resize_image(image)

image = image.reshape((1, IMAGE_SIZE, IMAGE_SIZE, 3))

# 浮点并归一化

image = image.astype('float32')

image /= 255

# 给出输入属于各个类别的概率,我们是二值类别,则该函数会给出输入图像属于0和1的概率各为多少

result = self.model.predict(image)

print('result:', result)

# 给出类别预测:0或者1

predict_x = self.model.predict(image)

classes_x = np.argmax(predict_x, axis=1)

# 返回类别预测结果

return classes_x[0]

if __name__ == '__main__':

dataset = Dataset("F:\\ros\\Original code\\recongniaze_face\\photo")

dataset.load()

model = Model()

# 先前添加的测试build_model()函数的代码

model.build_model(dataset)

# 测试训练函数的代码

model.train(dataset)

if __name__ == '__main__':

dataset = Dataset("F:\\ros\\Original code\\recongniaze_face\\photo")

dataset.load()

model = Model()

model.build_model(dataset)

model.train(dataset)

model.save_model(file_path='./model/CWT.face.model.h5')

if __name__ == '__main__':

dataset = Dataset("F:\\ros\\Original code\\recongniaze_face\\photo")

dataset.load()

# 评估模型

model = Model()

model.load_model(file_path='./model/CWT.face.model.h5')

model.evaluate(dataset)这一套模型跑下来,会输出一个模型,我把存储在我的model的文件夹下。

6、Face_recongnize(也就是最后的临门一脚了)

# -*- coding: utf-8 -*-

import cv2

import sys

import gc

from face_train import Model

if __name__ == '__main__':

if len(sys.argv) != 1:

print("Usage:%s camera_id\r\n" % (sys.argv[0]))

sys.exit(0)

# 加载模型

model = Model()

model.load_model(file_path="F:\\ros\\Original code\\recongniaze_face\\model\\CWT.face.model.h5")

# 框住人脸的矩形边框颜色

color = (0, 255, 0)

# # 采用摄像头用这个

# cap = cv2.VideoCapture(0)

# 采用视频用这个

cap = cv2.VideoCapture("E:\\文件存储\\b站\\Download\\2.avi")

# 人脸识别分类器本地存储路径

cascade_path = "F:\\ros\\ros_exploring-master\\robot_perception\\robot_vision\\data\\haar_detectors\\haarcascade_frontalface_alt.xml"

# 循环检测识别人脸

while True:

ret, frame = cap.read() # 读取一帧视频

if ret is True:

# 图像灰化,降低计算复杂度

frame_gray = cv2.cvtColor(frame, cv2.COLOR_BGR2GRAY)

else:

continue

# 使用人脸识别分类器,读入分类器

cascade = cv2.CascadeClassifier(cascade_path)

# 利用分类器识别出哪个区域为人脸

faceRects = cascade.detectMultiScale(frame_gray, scaleFactor=1.2, minNeighbors=3, minSize=(32, 32))

if len(faceRects) > 0:

for faceRect in faceRects:

x, y, w, h = faceRect

# 截取脸部图像提交给模型识别这是谁

image = frame[y - 10: y + h + 10, x - 10: x + w + 10]

faceID = model.face_predict(image)

#如果是识别目标

if faceID == 0:

cv2.rectangle(frame, (x - 10, y - 10), (x + w + 10, y + h + 10), color, thickness=2)

# 文字提示是谁

cv2.putText(frame, 'tutu',

(x + 30, y + 30), # 坐标

cv2.FONT_HERSHEY_SIMPLEX, # 字体

1, # 字号

(255, 0, 255), # 颜色

2) # 字的线宽

else:

pass

cv2.imshow("detect", frame)

# 等待10毫秒看是否有按键输入

k = cv2.waitKey(10)

# 如果输入q则退出循环

if k & 0xFF == ord('q'):

break

# 释放摄像头并销毁所有窗口

cap.release()

cv2.destroyAllWindows()7、细碎事项

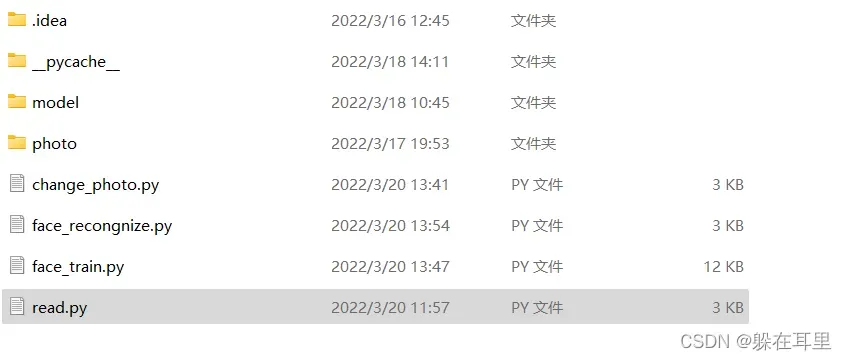

基本上到了这里问题基本就没有了,但是怕有些朋友不知道我的文件夹设置,所以给大家展示一下

剩下的话,还有什么问题也欢迎兄弟们和我交流,如果这部文章是我踩了很多的坑在2022年3月写出来的,很多版本较新,兼容性不错,希望能帮助到兄弟们,也请兄弟们支持一下我这个初来乍到的新人~~

(后续,想尝试在树莓派上运行做一个人脸识别开门器,有兴趣的也可以关注~)

文章出处登录后可见!