机器学习概述

在机器学习中,学习是训练模型的过程,通过它我们可以发现正确的参数集,使模型能够执行所需的行为。也就是说,使用数据来训练模型。

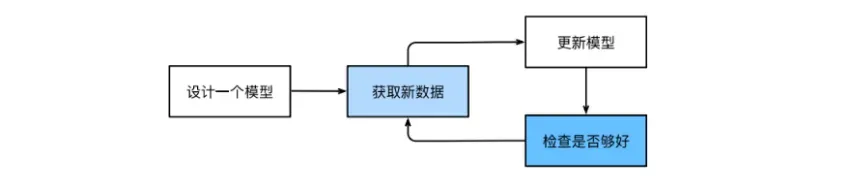

训练过程步骤:

- 从具有随机初始化参数的模型开始,该模型基本上是不智能的

- 获取一些数据样本(例如音频剪辑和相应的 {yes, no} 标签)

- 调整参数以使模型在这些样本上表现更好

- 重复步骤 2 和 3,直到模型在任务上表现令人满意

2. 机器学习问题的组成部分

- 可以学习的数据(data)

- 转换数据的模型(model)

- 一个目标函数(objective function),用来量化模型的有效性

- 调整模型参数以优化目标函数(algorithm)

2.1 数据

- 每个数据集由一个样本组成

- 样本都是独立同分布的,每个样本都由一组属性组成,这些属性成为特征。机器学习模型根据这些属性进行预测。

- 每个样本的特征类别数量都是相同的时候,其特征向量是固定长度的,这个长度被称为数据的维数(dimensionality)。

- 并不是每一个数据都可以用一个定长的向量来表示,以图像数据为例,如果它们都来自标准的显微镜设备,那么定长是可取的,但是如果图像数据都来自互联网,则很难它们具有相同的您可以考虑将图像裁剪为标准尺寸。另外,文本数据基本没有固定长度,有的文本数据很短,有的很啰嗦。与传统机器学习相比,深度学习有一个巨大的优势就是可以处理不同长度的数据。

- 小到大的数据集为现代机器学习的成功奠定了基础

- 不仅需要大量数据,还需要正确的数据。如果数据充满了错误,或者数据的特征不能正确预测任务目标,那么模型很可能是无效的。

2.2 模型

深度学习与经典方法的区别在于,前者侧重于强大的模型,这些模型被神经网络错综复杂地交织在一起,涉及层层数据转换,因此被称为深度学习。

2.3 目标函数

深度学习中的学习是指自主提高模型完成某些任务的效率。对于“改进”,我们需要定义模型的好坏,这个指标在大多数情况下是可优化的,我们称之为目标函数。

- 当任务在试图预测数值时,最常见的损失函数是平方误差(squared error), 即预测值与实际值之差的平方。

- 当任务是解决一个分类问题时,最常见的目标函数是最小化错误率,即预测与实际情况不一致的样本比例。一些目标函数(如平方误差)容易优化,而一些目标(如错误率)由于不可微或其他复杂性而难以直接优化。

- 数据集分为训练数据集和测试数据集。训练数据集用于拟合模型参数,测试数据集用于评估拟合模型。比较两个数据集的实际性能,测试性能可能与训练性能有显着差异。在训练集上表现良好但不能泛化到测试集的模型是过拟合的。

2.4 优化算法

当我们得到数据、模型和目标函数时,我们需要一个算法,它可以搜索到最好的参数,最好的参数用于优化模型以优化目标函数。最流行的优化算法通常基于一种基本方法——梯度下降。梯度下降会检查每一个参数,看看你是否只对那个参数进行了少量的改变,训练集损失会朝那个方向移动,然后调整参数。

3.各类机器学习问题

3.1 监督学习

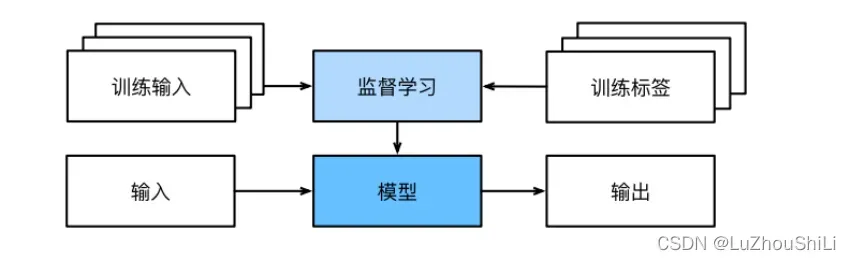

监督学习(supervised learning)擅长在给定输入特征情况下预测标签,每一个特征-标签称之为一个样本。目标是生成一个模型,能够将任何输入特征映射到标签,即预测

示例:预测患者是否会心脏病发作,输入特征:生命体征、心率、舒张压,标签:心脏病发作、无心脏病发作

监督学习的本质是条件概率。在训练参数时,我们为模型提供了一个数据集,其中每个样本都有一个真实的标签。我们想要预测估计给定输入特征标签的条件概率,机器学习在工业中最成功的应用是监督学习。因为许多重要的任务可以清楚地描述为:给定一组特定的可用数据,估计未知事物的概率。

通俗地说,监督学习的过程如下:

- 从已知的大型数据集中随机选择一个子集,以获得每个样本的基本真实标签。有时这些样本已经被标记(例如患者是否会康复),但有时需要人工标记的数据(图像分类),这些输入与相应的标签一起构成了训练数据集。然后我们选择一种监督学习算法,将训练数据集作为输入并输出一个完整的学习模型。之后,将之前使用的样本放入模型中,模型的输出就是样本的标签预测。

简单来说就是利用模型预测对应的标签(输出结果)

3.2 回归问题

回归问题是一种监督学习问题。一个典型的例子是房价预测。比如房子的特点,一定是面积、卧室数量、浴室数量,对应的标签自然就是它的价格。因此,在房价预测模型训练完成后,可以通过预测给定数据的特征来预测相应的标签,即预测其价格。

3.3 分类问题

虽然回归问题可以很好地预测标签,但许多问题不能。在分类问题中,我们希望模型预测样本属于哪个类别,对于回归问题我们输出一个值,在分类问题中我们训练一个分类器。

模型如何得出是或者不是的预测?模型为每一种可能的类分配一个概率,比如猫狗分类的一个例子,模型可能会输出图像是猫的概率是0.9,也就是90%的概率确定他是猫,但是仍然存在不确定性。

3.4 标记问题

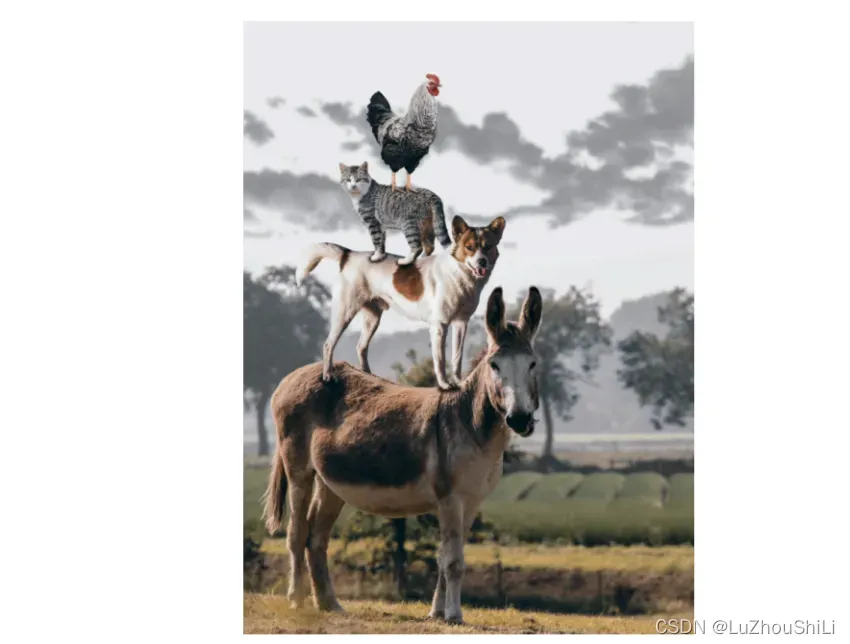

我们可以训练一个通用的二元分类器来区分猫和狗,但我们被新的动物模型困住了,比如“不来梅的城市音乐家”肖像。它不能简单地被视为一个二元分类问题。

这是一个多元分类问题,学习预测不相互排斥的类别问题称之为多标签分类问题。比如一篇技术博客,里面涉及到很多技术,那么关于博客的标签就有很多,比如:C++、Linux、机器学习、python。

3.5 搜索

搜索引擎使用机器学习和用户行为模型来获得网页相关性分数,然后检索评分最高的元素。

3.6 推荐系统

另一种与搜索和排名相关的问题是推荐系统,其目标是向特定用户提供个性化推荐。

对于某些应用程序,用户会给出明确的反馈,例如对他们喜欢的产品的评分。对于短视频等应用,如果用户快速跳出播放界面,说明用户不喜欢这类视频。一个成功的推荐算法将通过整合用户的活动和物品特征在大量数据上进行训练,并且可以很容易地捕捉到一个人的偏好。

3.7 序列学习

如果输入的样本是连续的,那么我们的模型可能需要有记忆功能,比如处理视频剪辑,每个视频剪辑可能由不同数量的帧组成,通过前一帧的图像,我们可能事情更多肯定。

在医学中,序列的输入和输出更为重要。我们使用模型来监测重症患者,并根据过去所有时间有关患者的所有信息进行预测,而不仅仅是最近的测量结果。

3.2 无监督学习

以上都是监督学习:我们为模型提供了一个庞大的数据集,每个样本都包含特征和对应的标签值,模型在大量数据集的训练下学习从情境到动作的映射。

但是,如果工作没有非常具体的目标,那么您需要自发学习。我们将此类数据中不包含目标的机器学习问题称为无监督学习。无监督学习的应用场景:

- 聚类问题:对没有标签的数据进行分类

- 主成分分析:找到少量参数,准确捕捉数据的线性相关属性

- 因果关系和概率图形模型:我们能否描述许多数据观察的根本原因。

- 生成对抗网络:一种提供合成数据的方法

3.3 与环境互动

到目前为止,我们讨论的是不依赖于环境相互作用的学习。这里的所有学习都是在算法与环境断开后执行的。它被称为离线学习。这种离线学习既有缺点也有优点。优点是模式识别可以在没有干扰和其他问题的情况下单独完成。但缺点是解决问题的能力相当有限,您更希望它与真实环境进行交互。

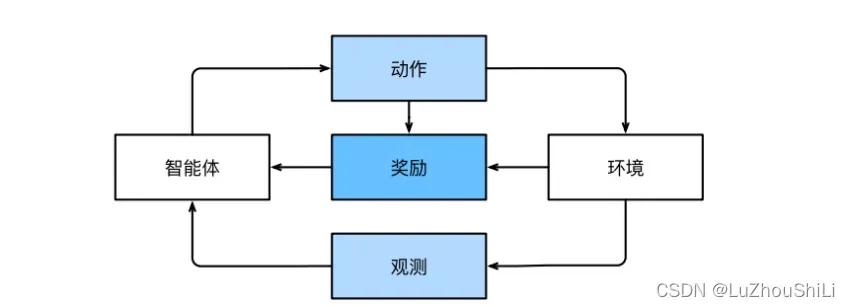

强化学习问题是一类考虑与环境交互的问题

3.4 强化学习

强化学习框架的通用性十分强大,我们可以将任何监督学习问题转化为强化学习;强化学习还可以解决许多监督学习无法解决的问题,在监督学习中,我们总是希望输入与正确的标签相关联,但是在强化学习中,我们并不假设环境告诉agent每个观测的最优动作,一般来说agent只是得到一些奖励。

在任何时间点上,强化学习agent可能知道一个好的策略,但是可能有许多更好的策略没有尝试过,强化学习agent必须不断地做出选择,是应该利用当前最好的策略还是探索新的策略空间(放弃一些短期汇报来换取知识)。

当可以充分观察环境时,我们将强化学习问题称为马尔可夫决策过程。当状态不依赖于先前的动作时,我们将问题称为上下文赌博机,而当没有状态,而只有一组初始未知收益的可用动作时,问题是经典的多臂赌博机。

文章出处登录后可见!