这篇博文主要介绍了机器学习中经常遇到的一些分类相关的问题。

- 有监督学习和无监督学习的区别

监督学习的训练数据有标注信息,而无监督学习的训练数据没有标注信息。分类和回归是监督学习的代表,聚类是无监督学习的代表。

- 如果数据有问题怎么办

第一种情况是数据中存在缺失值。缺失值的处理方法有:删除、统一值填充、统计值填充、正反向值填充、插值法填充、建模预测填充和具体分析方法。

第二种情况是数据中存在异常值,可以删除或修正填充。

- 相对熵公式

它用于衡量同一随机变量的两个分布

和

之间的差异,

常用于描述样本的真实分布,

用于表示预测分布。

KL散度的值越小表示两个分布越接近。

- 交叉熵公式

把KL散度的公式变形,得到:

前半部分是的熵,后半部分是交叉熵

- LR的推导,损失函数

功能:

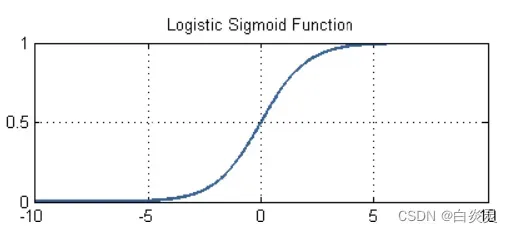

其图像如下:

损失函数测量真实输出和模型输出之间的差异。

通过取两边的对数,将连续乘法变为连续加法形式,即:

这里损失函数的值等于事件的总概率。我希望它越大越好。按照习惯最小化损失函数,可以在前面加一个负号。

- LR和线性回归的区别与联系

两者都是广义上的线性回归。

线性回归的优化方法是最小二乘法,而LR是似然函数。

线性回归主要是解决回归问题,LR主要是解决分类问题。

线性回归的输出是实数域上的连续值,LR的输出被sigmoid函数映射到(0,1)之间,通过设置阈值转换为分类类别。

- 逻辑回归如何实现多分类

方法一:

把多分类任务拆解成多个二分类任务,利用逻辑回归分类器进行投票求解。有三种拆分策略,OvO、OvR、MvM逻辑回归实现多分类[0]

OvO:转化为多个二分类

OvR:一对其余,一个类别作为正例,其余所有类别作为反例

MvM:将若干个类作为正例,若干个其他类作为反例

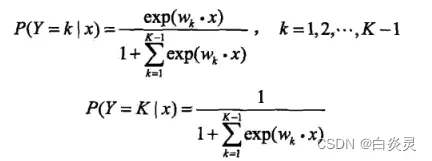

方法二:

传统逻辑回归模型的改造

- 什么是支持向量机

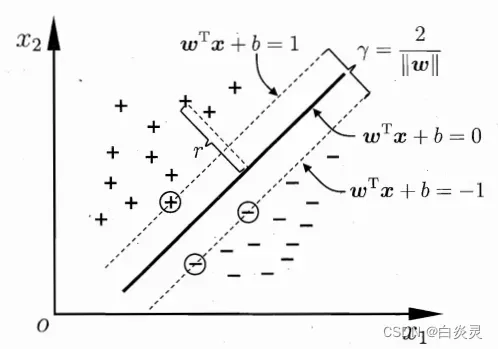

支持向量机SVM就是一种二类分类模型,基本模型是定义在特征空间上的间隔最大的线性分类器,其学习策略就是间隔最大化。

区间定义:

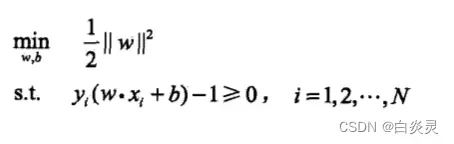

- SVM的硬间隔,软间隔表达式

硬行距表达式:

- SVM使用对偶计算的目的是什么,如何推出来的,手写推导;

9中的SVM基本型是一个凸二次规划问题,可以利用现成的优化计算包求解,但引入对偶问题更容易求解。“引入核函数,进而推广到非线性分类问题。”

对9中的每条约束添加拉格朗日乘子,该问题的拉格朗日函数可写为:

让,现在的目标是最小化

分别求 关于

和

的偏导数:

令偏导都等于0可得:

最后,代入拉格朗日函数得到:

所以双重问题是:

- SVM的物理意义是什么

构造一个最优超平面,以足够的置信度对训练数据进行分类,并希望以足够的置信度分离离超平面最近的点。

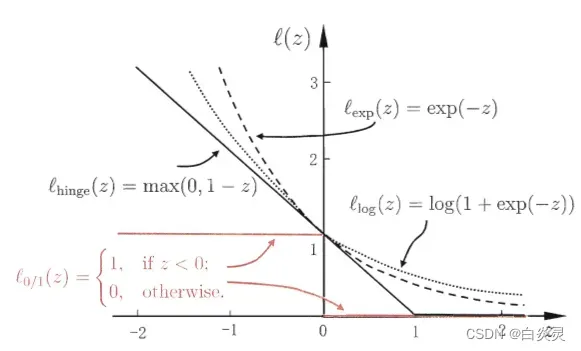

- SVM的损失函数

采用hinge损失时,损失函数为:

指数损失:

对准损失:

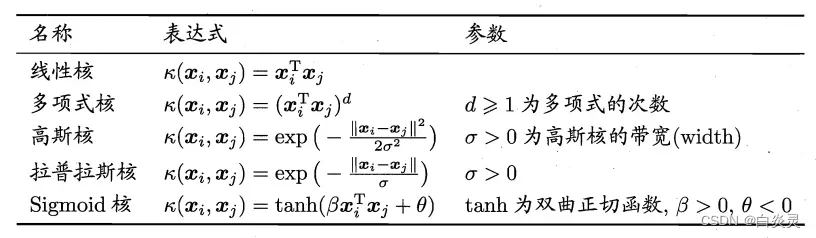

- SVM核函数的作用、种类

核函数的作用是将样本从原始空间映射到更高维的特征空间,使样本在这个特征空间中线性可分。如果原始空间是有限维的,即属性的数量是有限的,那么一定有一个高维的特征空间使得样本可分离。

- SVM中什么时候用线性核什么时候用高斯核?

线性核:主要用于线性可分、特征维度高的情况,参数少,速度快。对于一般数据,分类效果已经很好了。

高斯核:主要用于线性不可分、特征维度小、参数多、分类结果对参数依赖很大的情况。

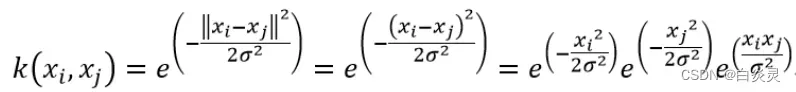

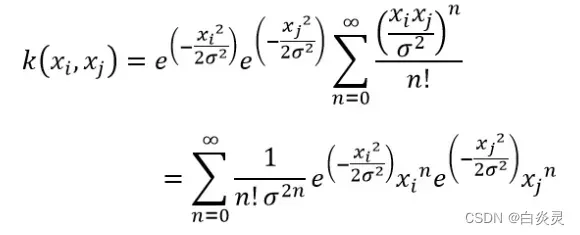

- 为什么高斯核可以拟合无限维

高斯核函数:

代入上述第三项得:

即高斯核函数将输入空间映射到无限多维空间。

- SVM和全部数据有关还是和局部数据有关

SVM只和分类界限上的支持向量点有关,换而言之只和局部数据有关。

- LR和SVM 的区别与联系

两者都是有监督的分类算法。

LR是参数模型,SVM是非参数模型。

SVM不直接依赖数据分布,LR依赖。

LR的损失函数是交叉熵,而SVM是hinge函数。

- 机器学习中的距离计算方法

欧几里得距离:是维度,

和

分别是

和

的第

属性

Minkowski 距离:(欧几里得距离的推广)

称为块距离(或曼哈顿距离,

范数)

是前面介绍的欧几里得距离(或

范数)

当称为切比雪夫距离(或

范数)

杰卡德相似系数(Jaccard):

余弦相似度(cosine similarity):

Pearson相似系数(是对象之间线性联系的度量):

相对熵(K-L距离):

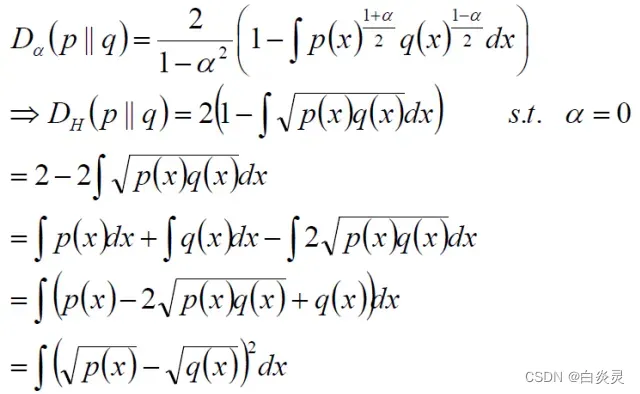

Hellinger距离:

- 训练集中的类别不平衡,哪个评价指标最不准确

在数据不均衡时,准确度accuracy这个评价指标最不标准,参考意义不大。

- ID3、C4.5和CART三种决策树的区别

ID3算法:信息增益

C4.5算法:信息增益率

特征A对训练数据集D的信息增益比定义为其信息增益

与训练数据集D的经验熵

之比:

CART算法:基尼指数

在分类问题中,假设有类,样本点属于

类的概率为

,则概率分布的基尼指数定义为:

对于二类分类问题,若样本点属于第1个类的概率是,则概率分布的基尼指数为:

对于给定的样本集,其基尼指数为:

其中,是

中属于

类的样本子集,

是类数。

如果将样本集根据特征

是否取某个可能值

分为

和

两部分,即:

、

那么在特征的条件下,集合

的基尼指数为:

基尼指数代表集合

的不确定性,基尼指数

代表集合

除以

后的不确定性。基尼指数越大,样本集的不确定性越大。

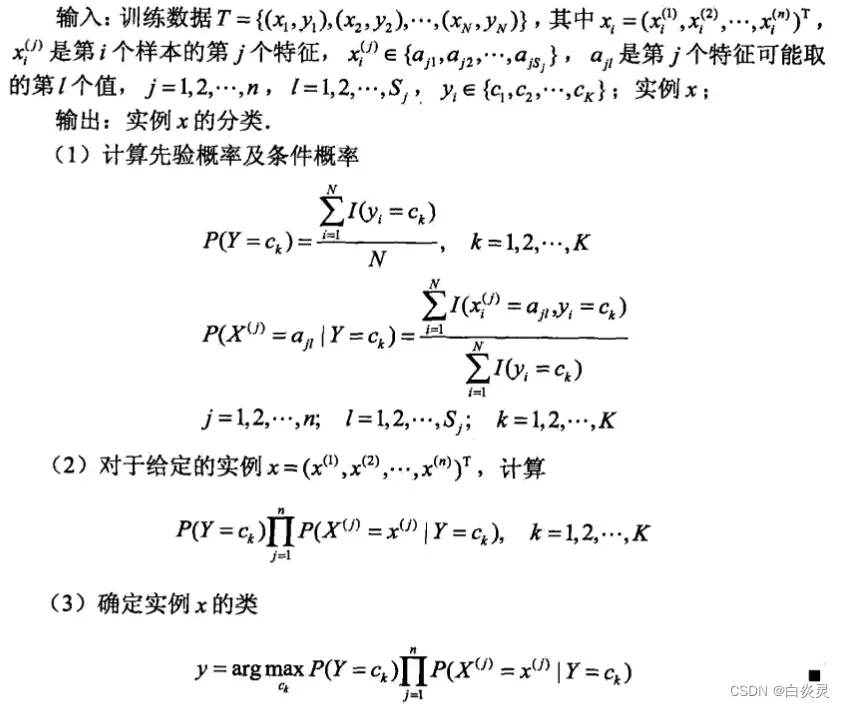

- 朴素贝叶斯基础和预测过程

用朴素贝叶斯法分类时,对于给定的输入,通过学习模型计算后验概率分布

,将后验概率最大的类作为

的类输出,后验概率计算按照贝叶斯定理:

根据条件独立假设,我们得到:

上式中的分母对所有都是一样的,所以比较时只能比较分母。

- 朴素贝叶斯(naive Bayes)法的要求

朴素贝叶斯假设条件概率分布的条件独立。

- 有多少分类算法?应用场景

没有最好的分类器,只有最合适的分类器。

感知机、决策树、逻辑回归、贝叶斯分类器、支持向量机、K近邻、随机森林

决策树应用场景:由于能够生成清晰的树形图,当你想更好地理解数据时可以使用决策树

逻辑回归应用场景:需要具有概率意义的输出,LR的参数代表每个特征对输出的二影响,可解释性强。LR的计算量小,存储占用低,可以在大数据场景中使用。LR虽然效果一般,但模型清晰。

贝叶斯分类器应用场景:当一个比较容易解释,且不同维度之间相关性较小时,可以高效处理高维数据,但结果不保证

支持向量机应用场景:在大量数据上表现良好,可以尝试。

KNN应用场景:需要一个特别容易解释的模型的时候

随机森林应用场景:一种可以解决大规模数据集问题的综合方法,还可以对变量的重要性进行排序。刚拿到数据集不知道用什么方法的时候,也可以试试随机森林。

- 生成模型和判别模型的基本形式是什么?

典型的生成模型有:朴素贝叶斯和隐马尔可夫模型。

生成模型:

典型的判别模型有:k近邻法、感知机、决策树、逻辑斯蒂回归模型、最大熵模型、支持向量机、提升方法和条件随机场。

判别模型表示生成关系,给定输入产生输出

。

本文参考资料:

机器学习算法的应用场景[0]

文章出处登录后可见!