1.最小二乘估计(Least Squares Approximations)、拟合(Fitting)

笔记来源:Least Squares Approximation | Linear Algebra | Khan Academy

1.1 最小化误差(Minimizing the Error)

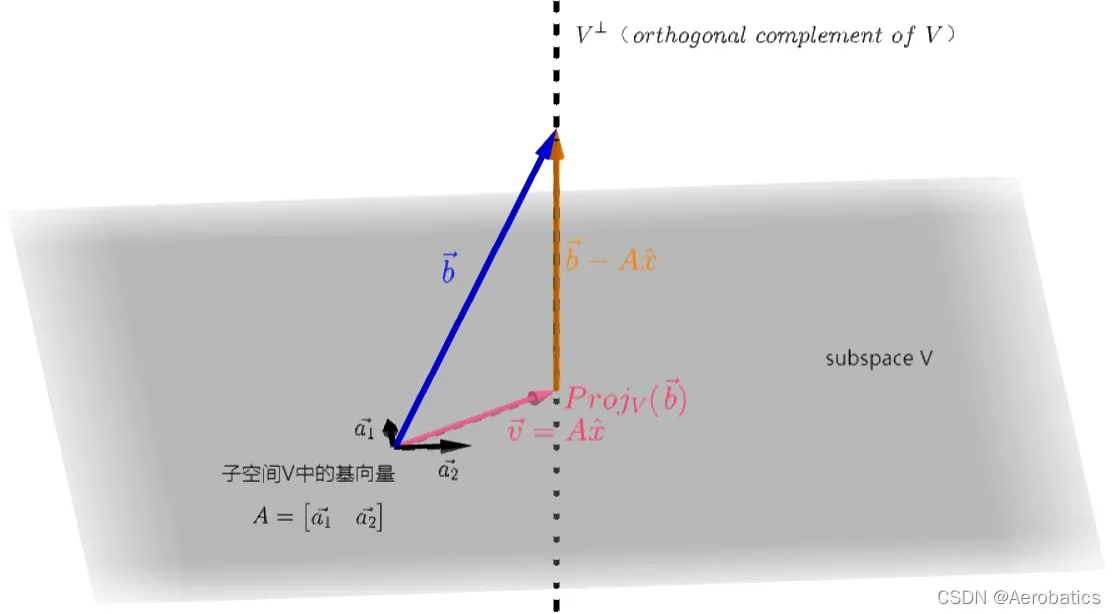

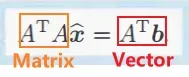

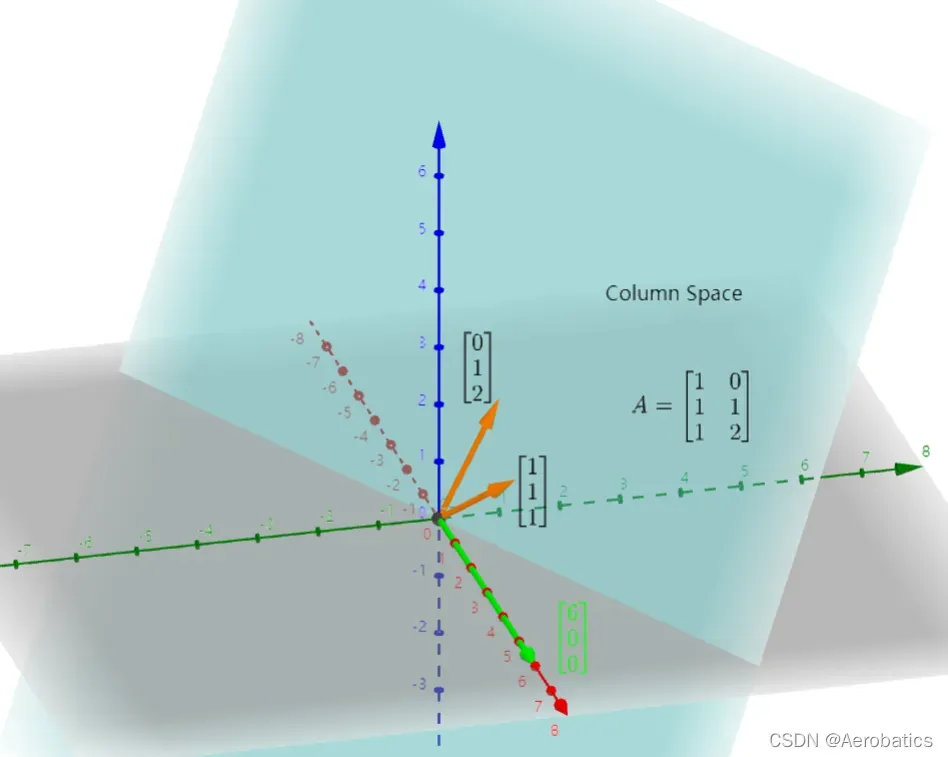

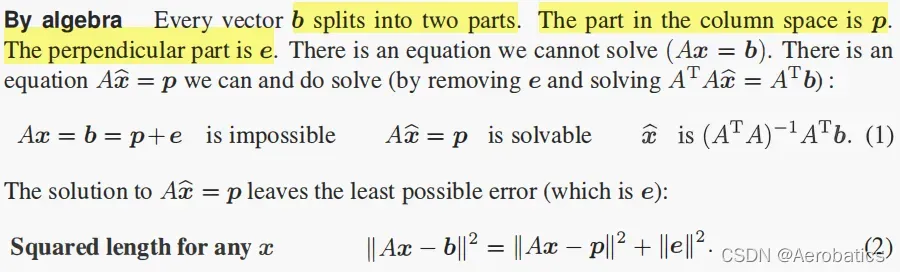

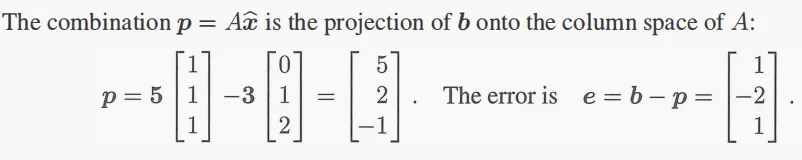

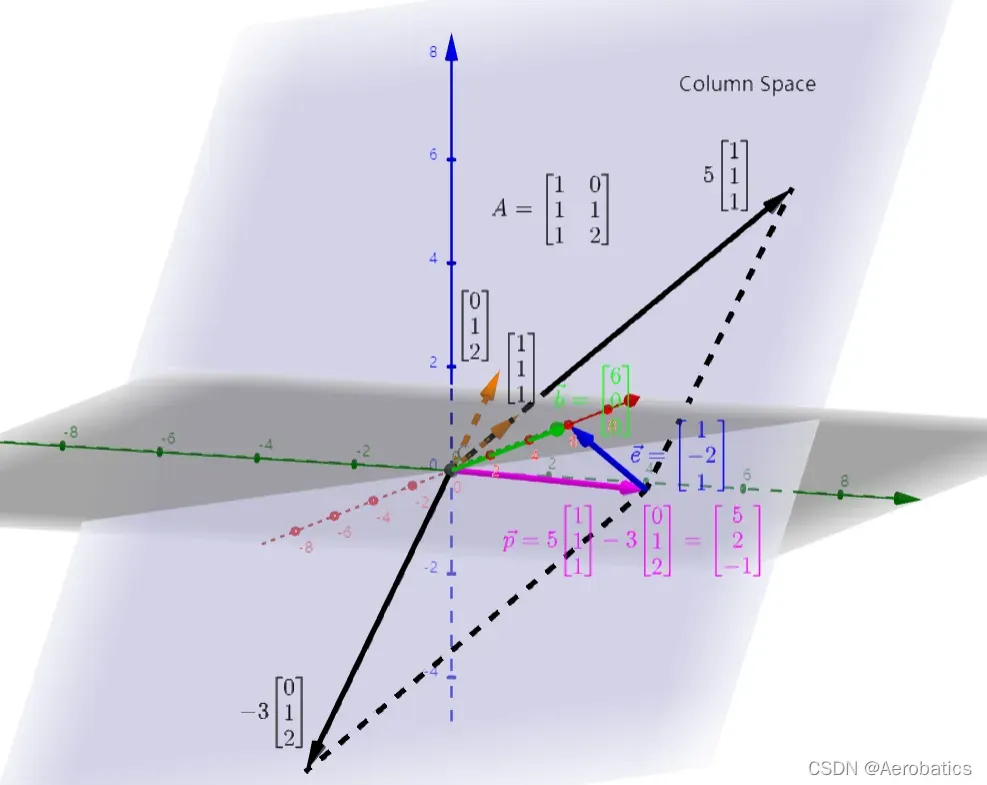

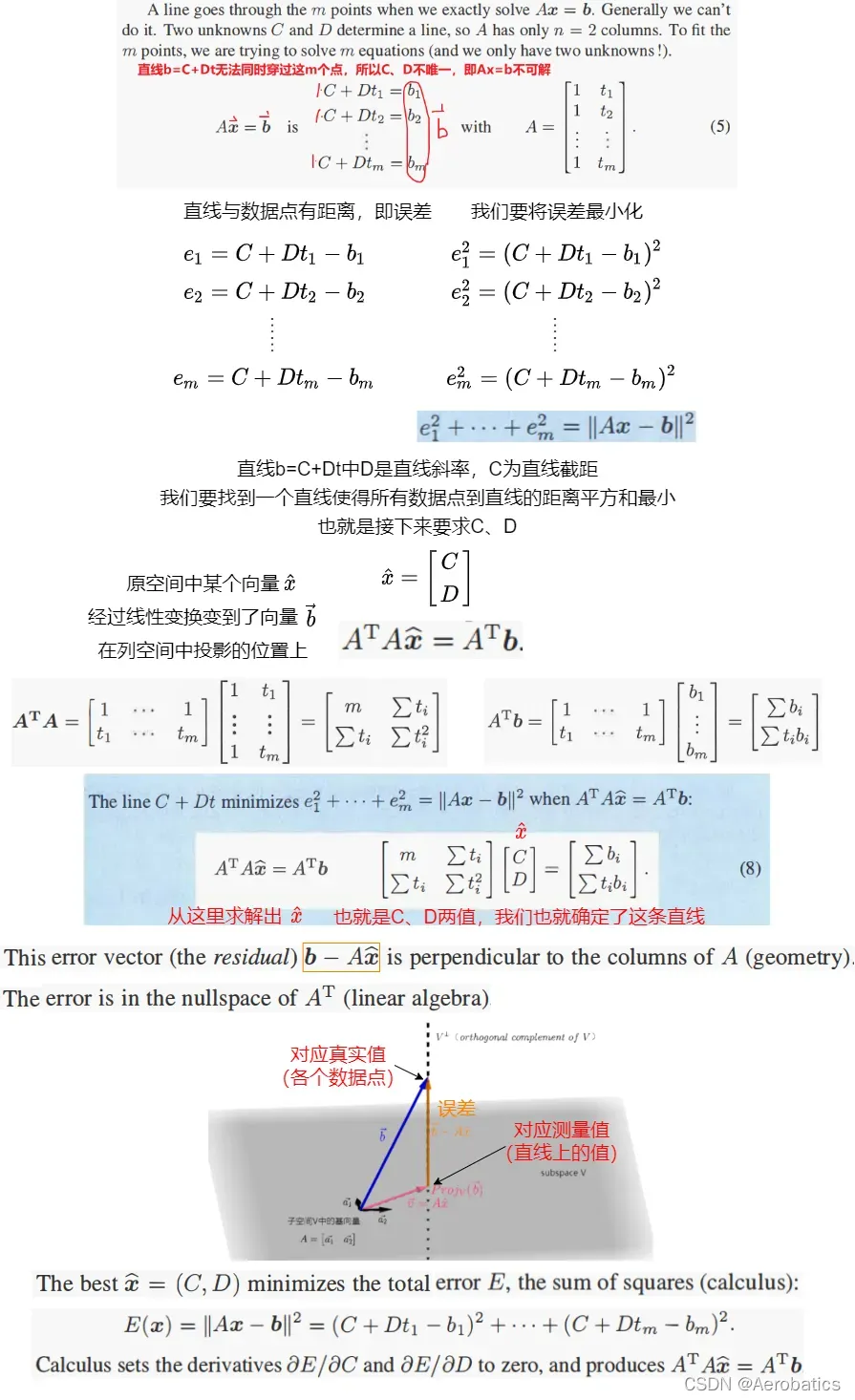

1.1.1 几何角度理解

个人理解:

原空间(未经线性变换的空间,即单位基向量构成的空间)中的所有向量经过线性变换(矩阵 )后驻留到了子空间

中,原空间没有一个向量

变到了图中向量

的位置,所以我们说

无解,但我们可以在子空间

中找到一个向量

,这个向量

最接近我们要求的向量

,这里所说的子空间

中的这个向量其实就是向量

在子空间中的投影

也就是说原空间中的某个向量 经过线性变换(矩阵

)后驻留到了子空间 V 中向量

投影的位置,我们将其称作向量

我们这里的用向量 和其在子空间

中的投影向量

的差向量

的大小叫做误差(Error),这个差向量因为垂直于子空间

,所以这个差向量实际上就在子空间

的正交补集

中

【我们要求的是向量 ,但实际我们只能达到

】

【其实在现实问题中就是由于测量中含有噪声,导致测量值与实际值之间存在误差】

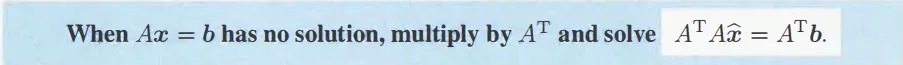

我们假设子空间 为列空间

、则其正交补集为左零空间

其中 就是最小二乘估计

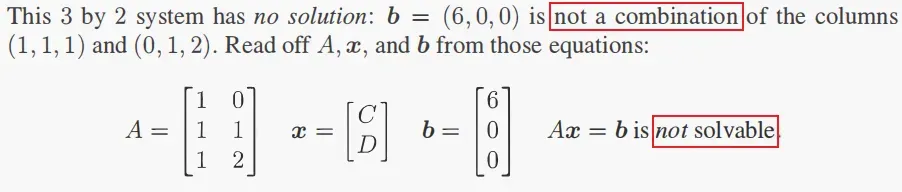

1.1.2 代数角度理解

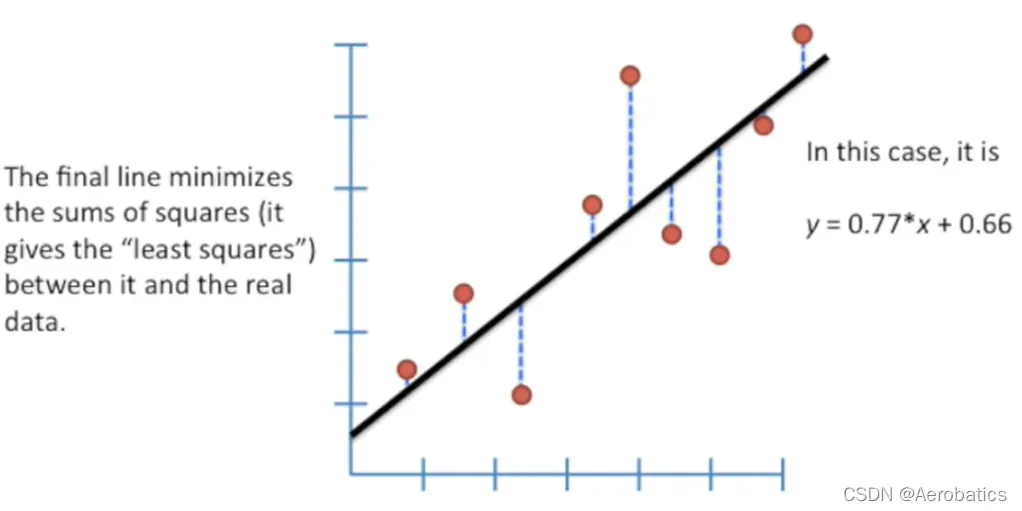

笔记来源:The Main Ideas of Fitting a Line to Data (The Main Ideas of Least Squares and Linear Regression.)

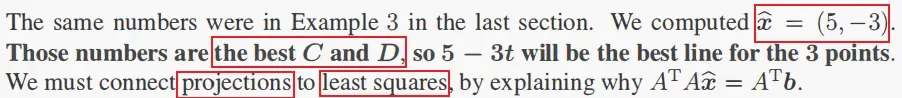

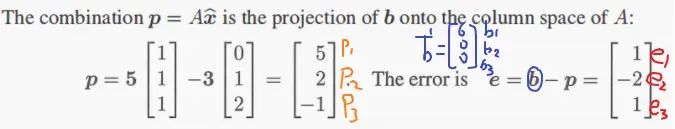

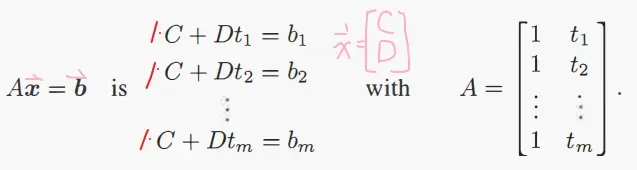

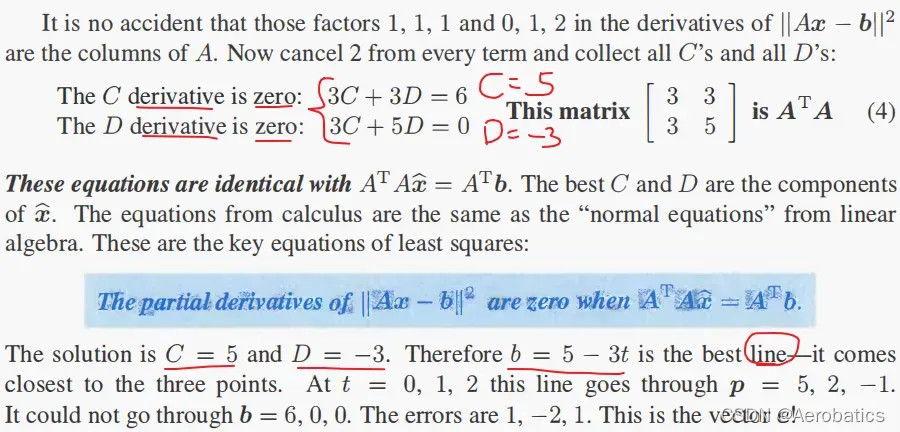

1.1.2.1 直线拟合

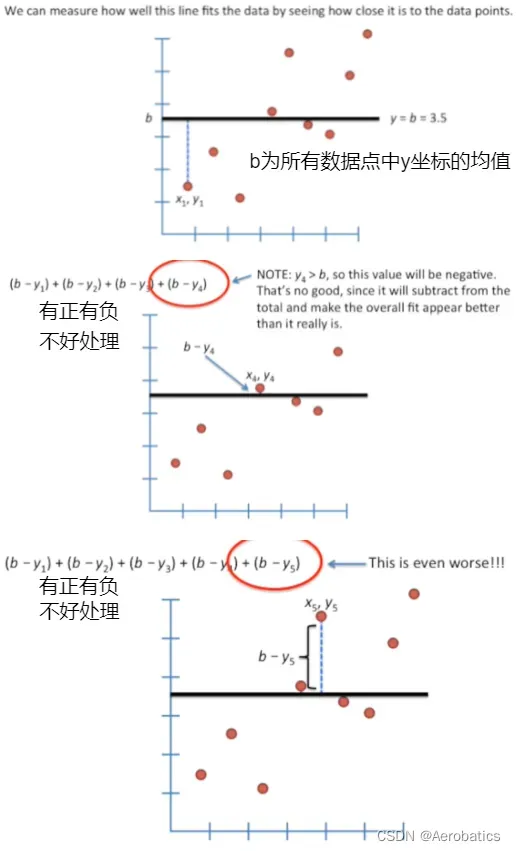

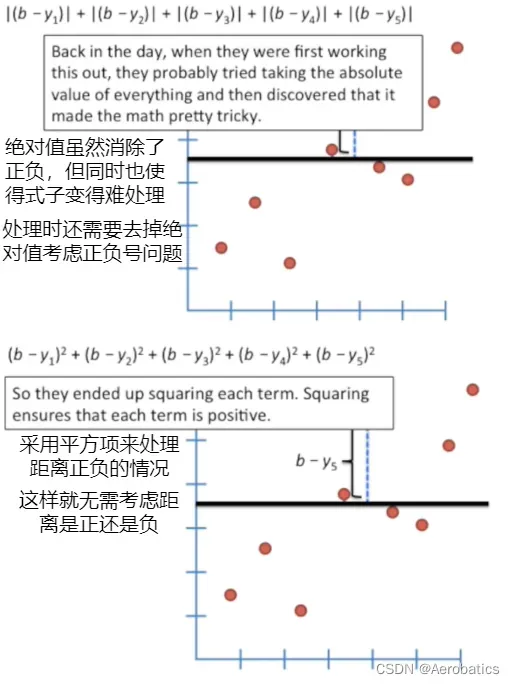

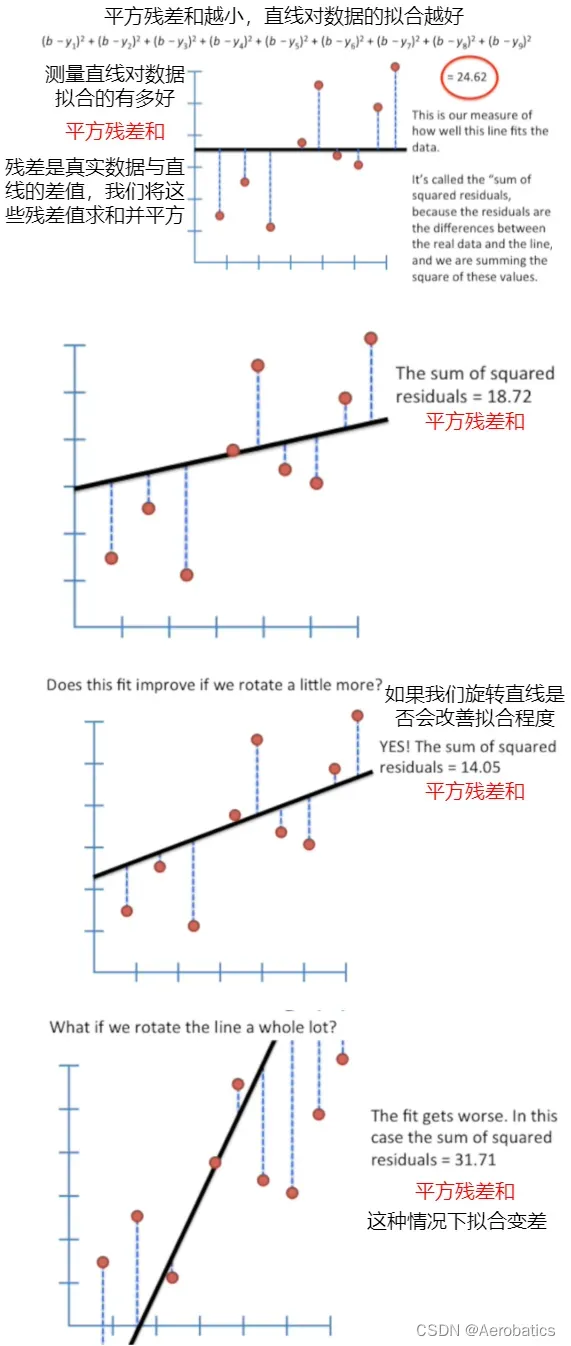

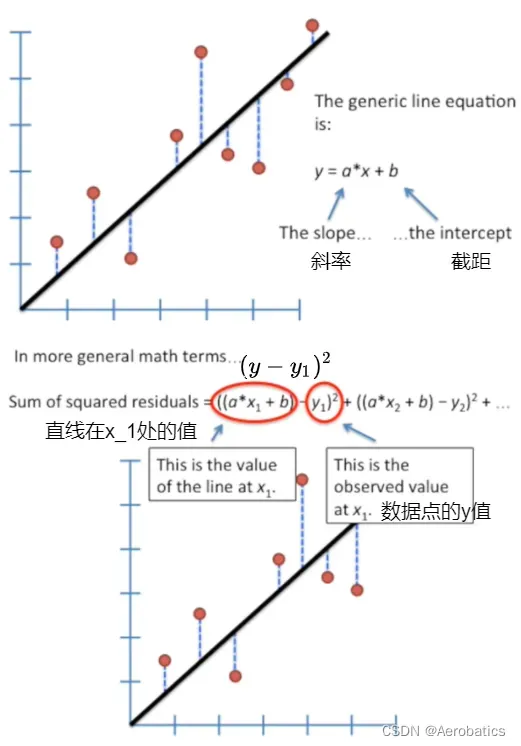

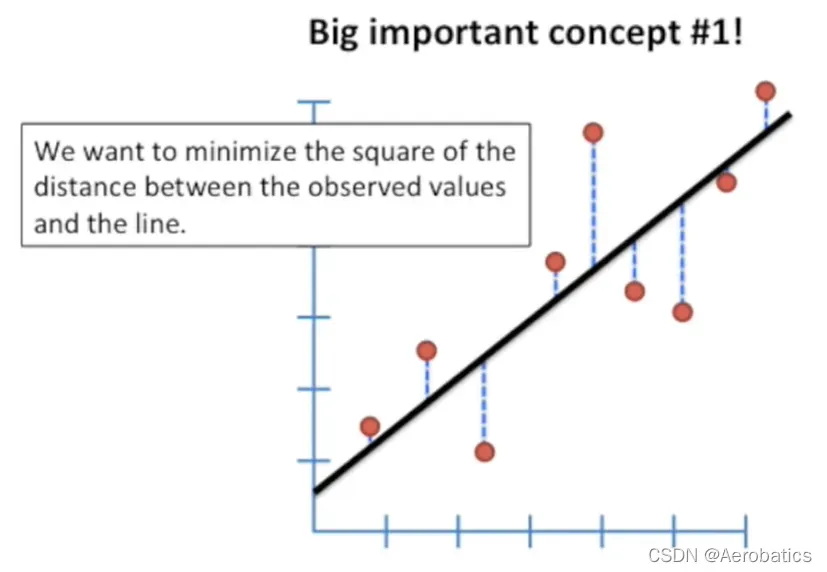

通过看所有数据点离直线距离的和来测量直线对数据的拟合有多好(距离和越小,拟合的越好)

1.1.2.2 曲线拟合

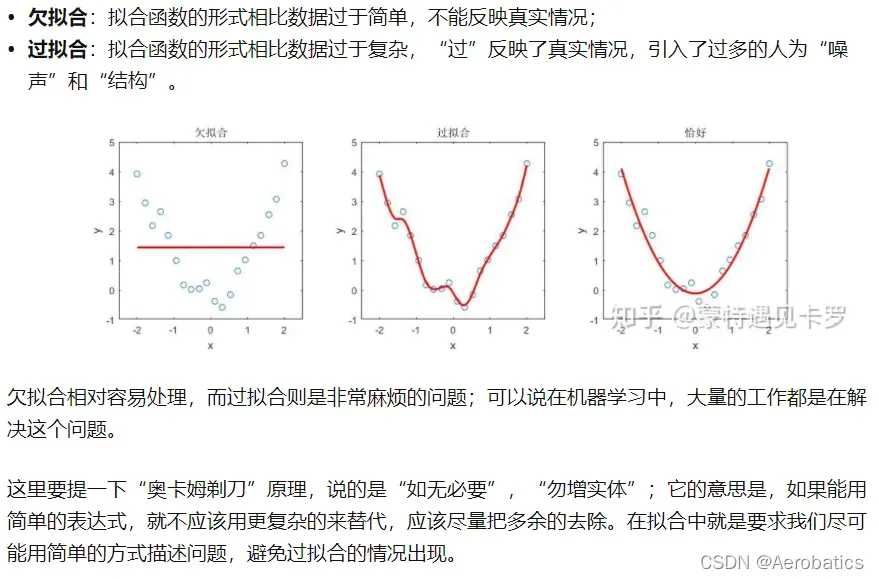

1.1.2.3 欠拟合、过拟合

下图来源于:数据分析中的插值与拟合(2) —— 拟合

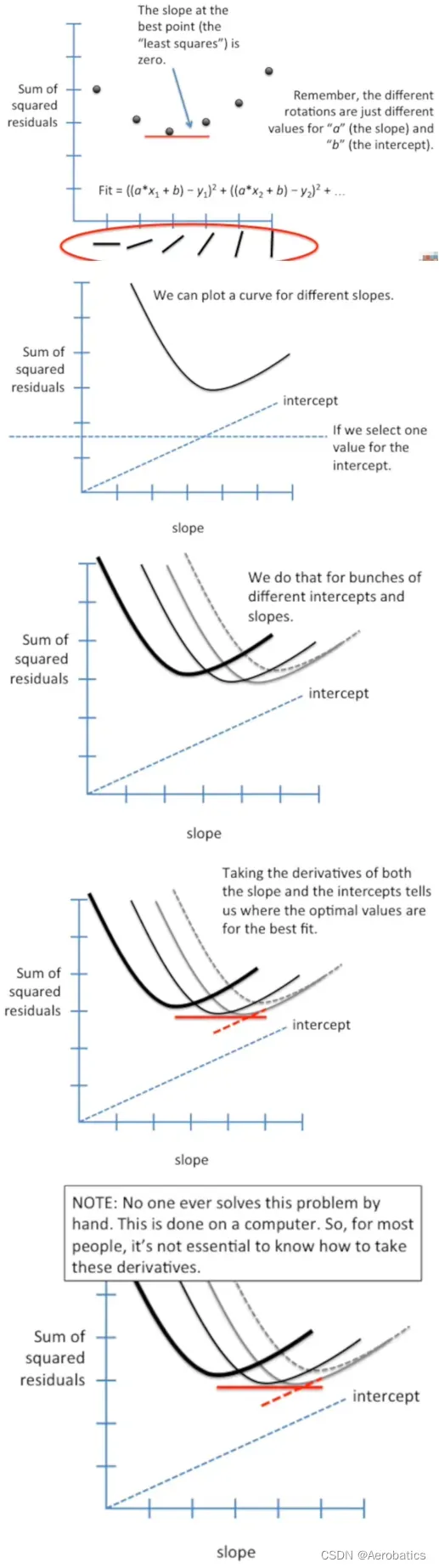

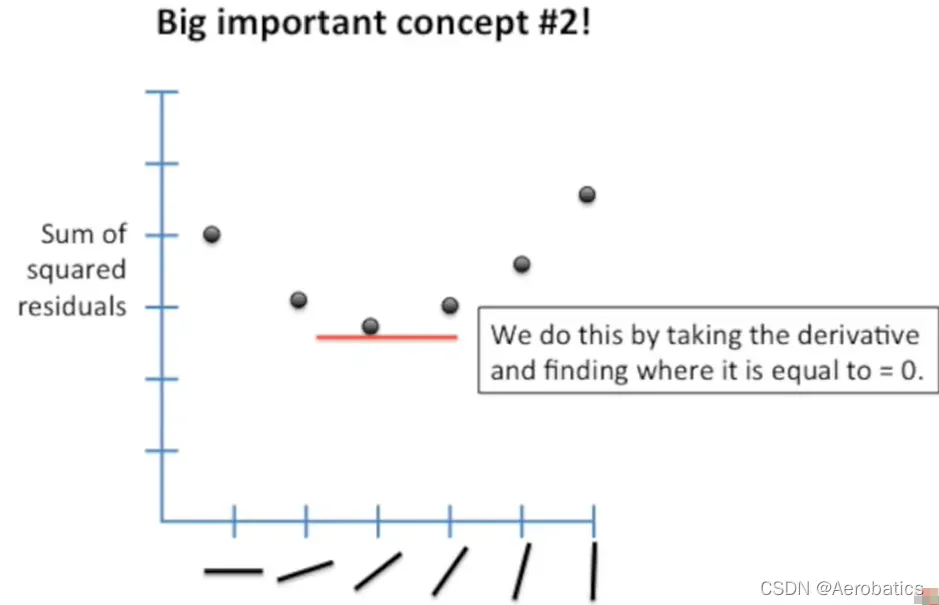

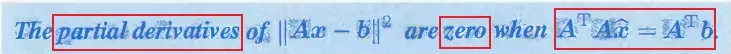

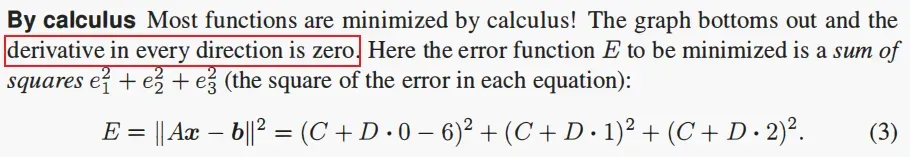

1.1.3 微积分角度

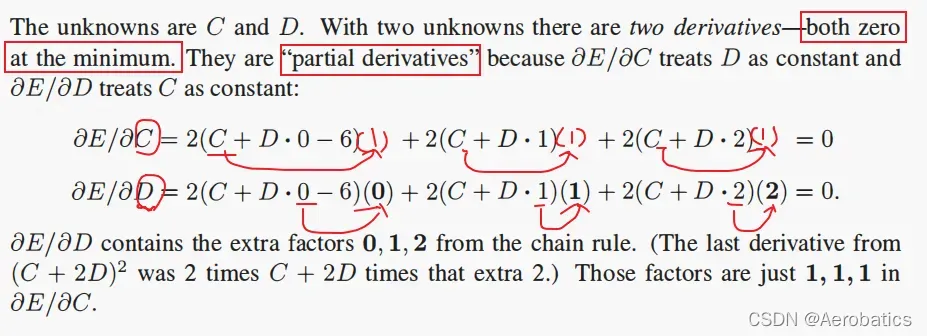

残差平方和的偏导为0,意在寻找局部极值

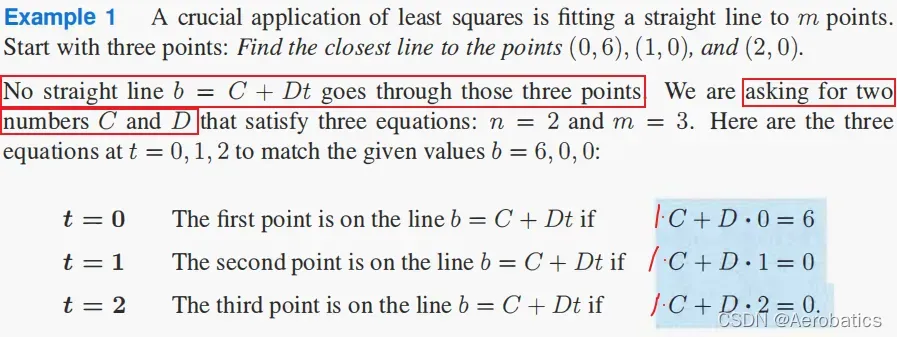

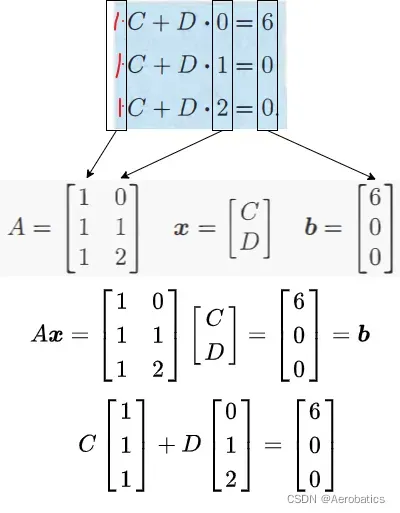

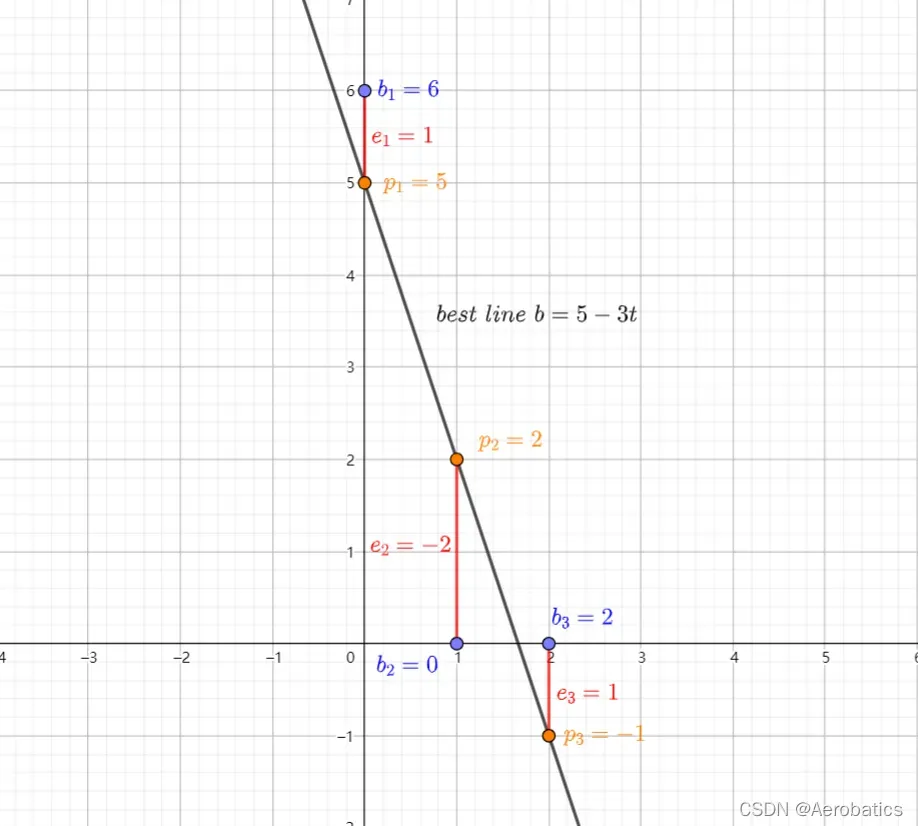

1.2 例子

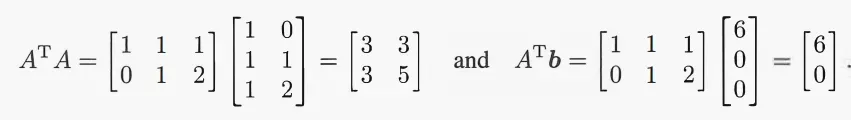

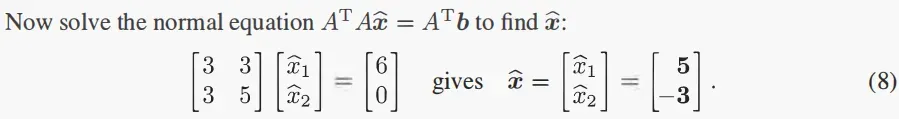

列空间中的基向量为:、

这两个基向量线性组合张成了矩阵 的列空间,而向量

不在列空间中,所以基向量无法线性组合后得到向量

几何角度:

代数角度:

微积分角度:

1.3 思路总结

版权声明:本文为博主Aerobatics原创文章,版权归属原作者,如果侵权,请联系我们删除!

原文链接:https://blog.csdn.net/weixin_48524215/article/details/122549450