以上就是GNN的基本框架,下面我们来看看GNN与CNN框架及Transformer中的异同。

1)GNN vs. CNN

CNN层与层之间的传递公式为:

其中, 表示像素

的8个相邻像素。我们可以将上式拆成两部分,邻居像素的传递+自己本身的传递:

注意,CNN中的每个邻居像素对应的权重是不一致的,因此有个上角标,也就是每个相邻像素位置对应一个权重,因此CNN不具有置换不变性。而相比之下GNN的传递公式为:

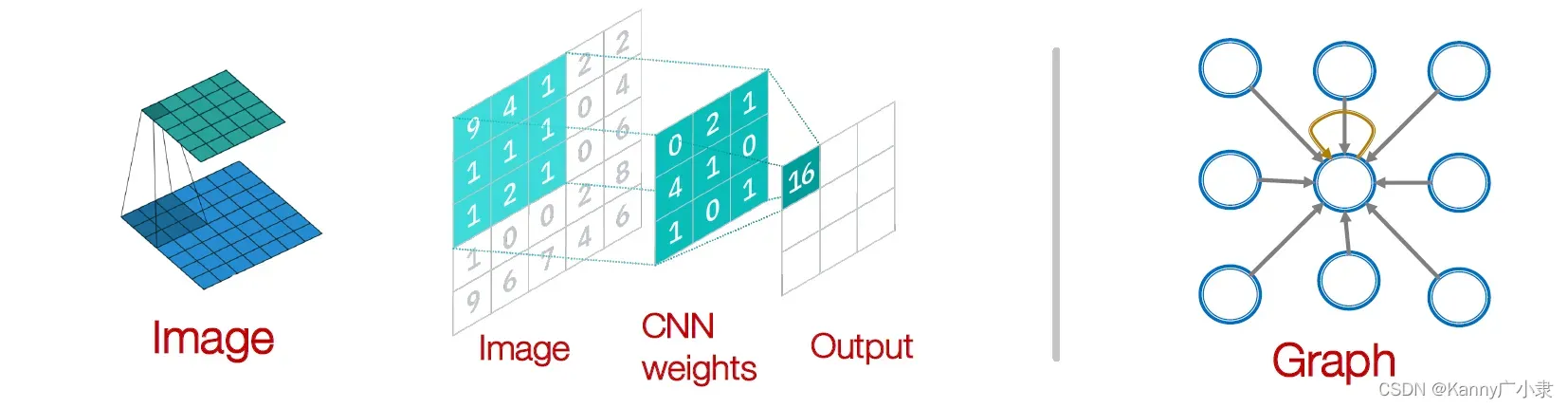

其每个对应的邻居权重都是相同的,为,这是需要适应图节点中的度可能是任意的(每个节点的邻居数量都不尽相同)。对比的图像示意如下:

2)GNN vs. Transformer

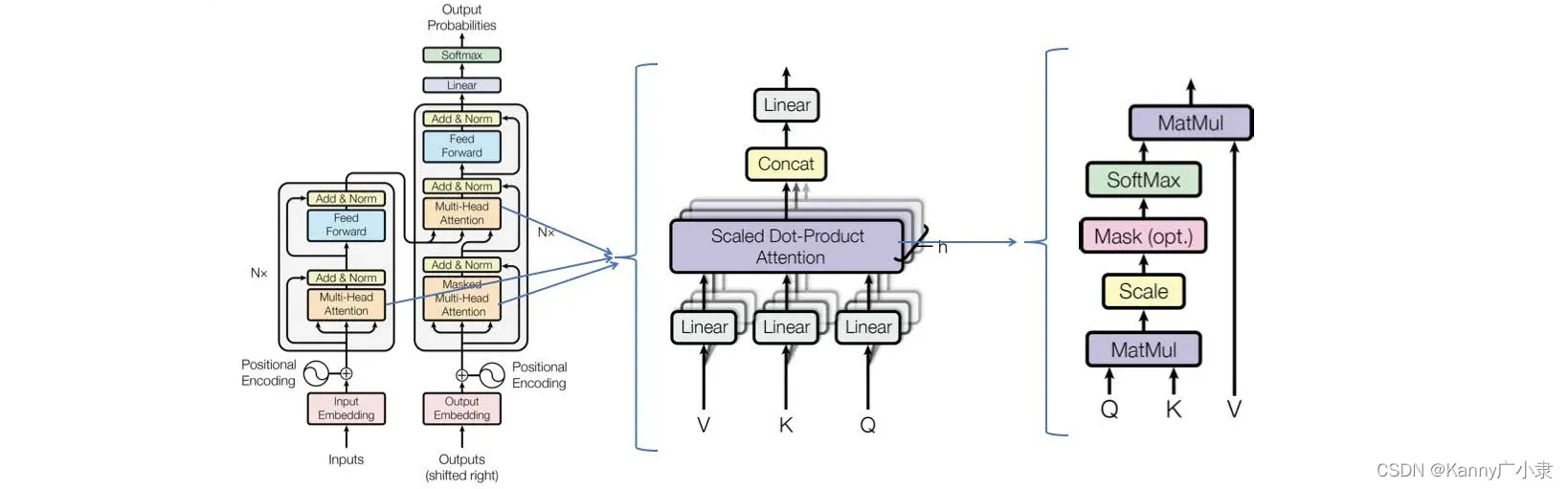

接着我们来对比GNN与文本中用到非常多的Transformer进行对比。首先看看后者的基础结构:

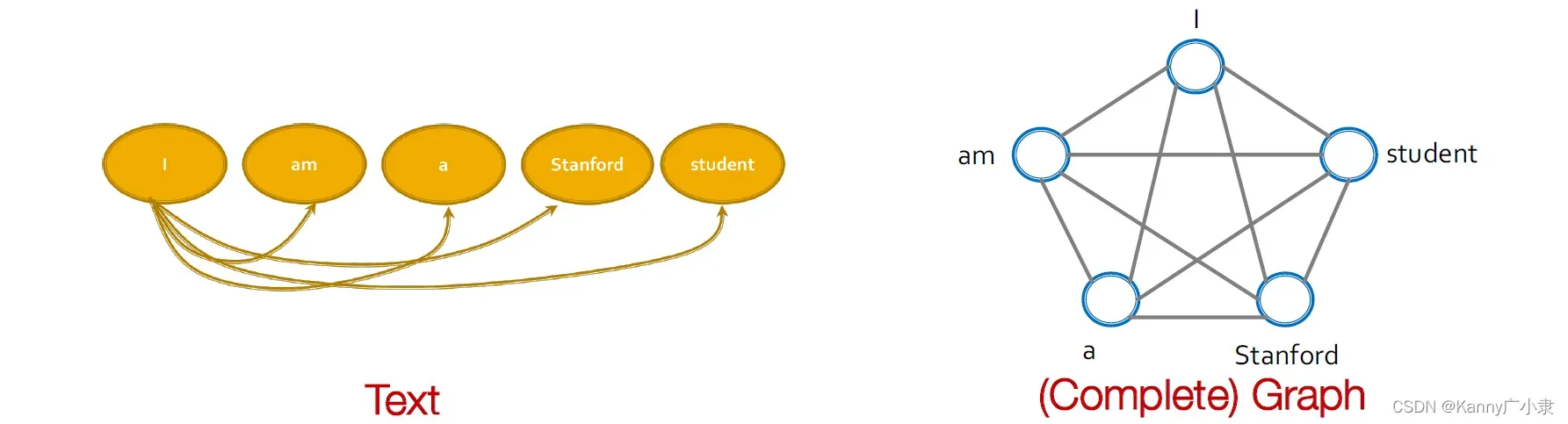

其基本想法是自注意力机制,也就是通过矩阵计算,每个标记/词都与其他标记/词相关。因此Transformer本质上是一个两两相连的完全图。

文章出处登录后可见!

已经登录?立即刷新