一、背景

再次使用CosineAnnealingLR的时候出现了一点疑惑,这里记录一下,其使用方法和参数含义

后面的代码基于 pytorch 版本 1.1, 不同版本可能代码略有差距,但是含义是差不多的

二、余弦退火的目的和用法

2.1 为啥用cosineAnnealingLR策略

原因:因为懒… 这样就不用像使用其他类似于StepLR策略 进行调参了,而且总会取得不错的结果。

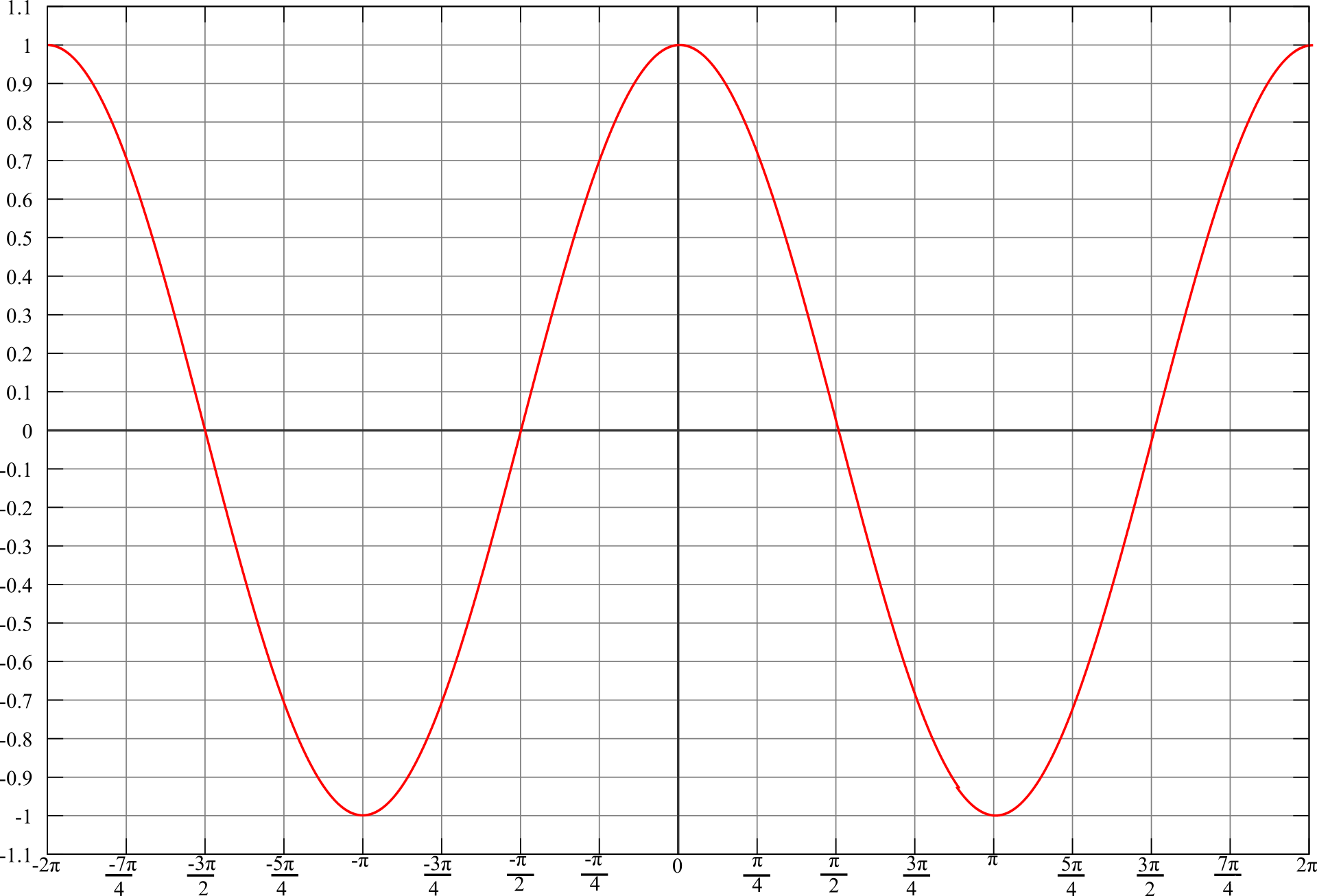

余弦函数如下(两个)

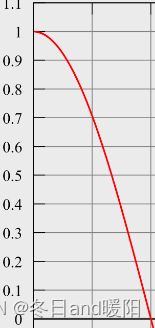

考虑cosine函数的四分之一个周期,如下图所示

我们希望学习率能像四分之一个cosine的周期一样下降:所以有了cosineAnnealingLR学习率的策略。如果想每个batch 更新学习率,则

torch.optim.lr_scheduler.CosineAnnealingLR(optimizer, T_max, eta_min=0, last_epoch=- 1, verbose=False

“

这里面主要就介绍一下参数T_max ,这个参数指的是cosine 函数 经过多少次更新完成四分之一个周期。

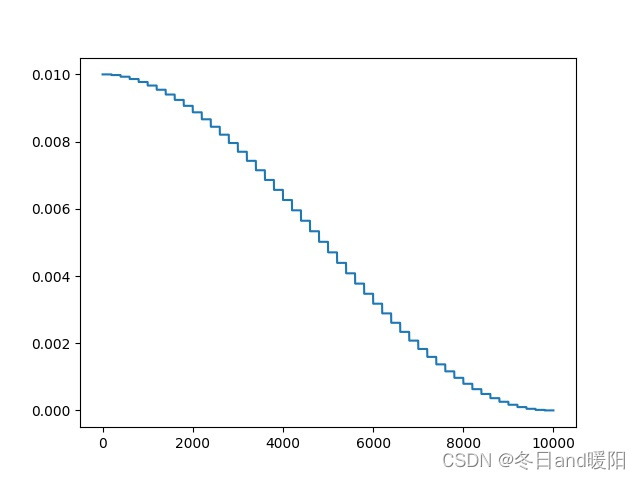

2.2 如果 希望 learning rate 每个epoch更新一次

import numpy as np

import torch

from torchvision import models

import matplotlib.pyplot as plt

net = models.resnet18(pretrained=False)

max_epoch=50 # 一共50 epoch

iters=200 # 每个epoch 有 200 个 bach

optimizer = torch.optim.SGD(net.parameters(), lr=0.01, momentum=0.9)

scheduler = torch.optim.lr_scheduler.CosineAnnealingLR(optimizer = optimizer,

T_max = max_epoch) # * iters

lr = []

for epoch in range(max_epoch):

for batch in range(iters):

optimizer.step()

lr.append(scheduler.get_lr()[0])

scheduler.step() # 注意 每个epoch 结束, 更新learning rate

plt.plot(np.arange(len(lr)), lr)

plt.savefig('aa.jpg')

每个epoch内,learning rate 是一样的

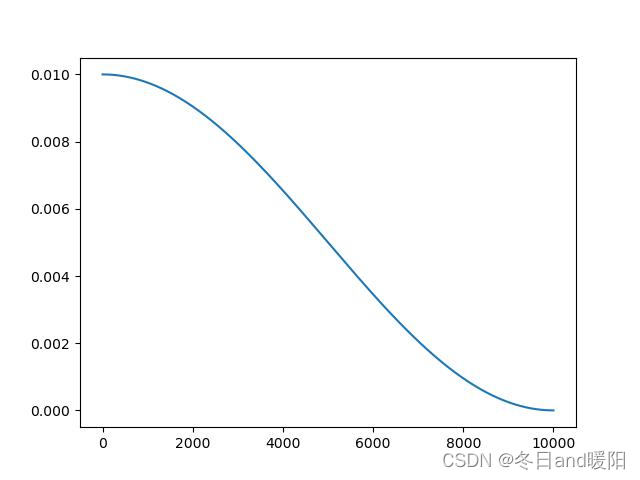

2.3 每个batch 迭代都改变学习率

max_epoch=50 # 一共50 epoch

iters=200 # 每个epoch 有 200 个 bach

optimizer = torch.optim.SGD(net.parameters(), lr=0.01, momentum=0.9)

scheduler = torch.optim.lr_scheduler.CosineAnnealingLR(optimizer = optimizer,

T_max = max_epoch * iters ) # 调整了四分之一周期的长度

lr = []

for epoch in range(max_epoch):

for batch in range(iters):

optimizer.step()

lr.append(scheduler.get_lr()[0])

scheduler.step() # 注意 每个batch 结束, 更新learning rate

每个batch都改变学习率

文章出处登录后可见!

已经登录?立即刷新