摘要:口罩检测系统用于日常生活中检测行人是否规范佩戴口罩,利用深度学习算法可实现图片、视频、连接摄像头等方式的口罩检测,另外支持和结果可视化。在介绍算法原理的同时,给出Python的实现代码以及PyQt的UI界面。口罩检测系统可用于路口、商场等公共场合检测人脸是否佩戴口罩,佩戴和未佩戴口罩的数目、位置、预测置信度等;连接摄像头设备可开启实时检测功能,另外对图片、视频等文件也可进行测试和检测;登录系统提供用户注册、登录、管理功能;训练和调优的模型可有效检测口罩佩戴情况,模型可选择切换;可选择单个目标进行单独显示和标注,结果一键保存。博文提供了完整的Python代码和使用教程,适合新入门的朋友参考,完整代码资源文件请转至文末的下载链接。本博文目录如下:

文章目录

- 前言

- 1. 效果演示

- 2. 口罩数据集及训练

- 3. 口罩检测识别

- 下载链接

- 结束语

➷点击跳转至文末所有涉及的完整代码文件下载页☇

基于深度学习的口罩检测系统演示与介绍(Python+YOLOv5深度学习模型+清新界面)

前言

在公众场合需要佩戴口罩已经成为常识,新型冠状病毒的主要传播途径就是飞沫传播,戴上口罩就可以有效的阻隔病毒的传播。口罩是预防呼吸道传染病的重要防线,可以降低新型冠状病毒感染风险。口罩不仅可以防止病人喷射飞沫,降低飞沫量和喷射速度,还可以阻挡含病毒的飞沫核,防止佩戴者吸入。有研究显示,只要双方都佩戴口罩且间隔1.8米以上,造成感染的几率几乎为0。

但是,未规范佩戴口罩的情况也很常见,无论是进出商场、教室、街道、地下停车场等公共场所,还是在人员密集的会议室里,都可能有人未戴口罩的情况。口罩检测系统基于机器视觉深度学习技术,运用YOLOv5训练出来的口罩检测模型进行检测,能够实现无人值守的不间断工作,并且系统可以主动发现监控区域内的未佩戴口罩情况,并以最及时的方式进行告警,同时最大限度降低误报和漏报现象;极大的节约了人员成本,提高了工作效率。

近年来,机器学习和深度学习取得了较大的发展,深度学习方法在检测精度和速度方面与传统方法相比表现出更良好的性能。YOLOv5是单阶段目标检测算法YOLO的第五代,根据实验得出结论,其在速度与准确性能方面都有了明显提升,其论文可参考TPH-YOLOv5: Improved YOLOv5 Based on Transformer Prediction Head for Object Detection on Drone-captured Scenarios,开源的代码可见https://github.com/ultralytics/yolov5(官方源码仓库)。因此,有了应用YOLOv5进行口罩检测的想法,关注到近期YOLO算法的最新进展已有YOLOv6、YOLOv7、YOLOv8等算法相继出现,将本系统中检测算法替换为最新算法的代码也将在后面发布,欢迎关注。

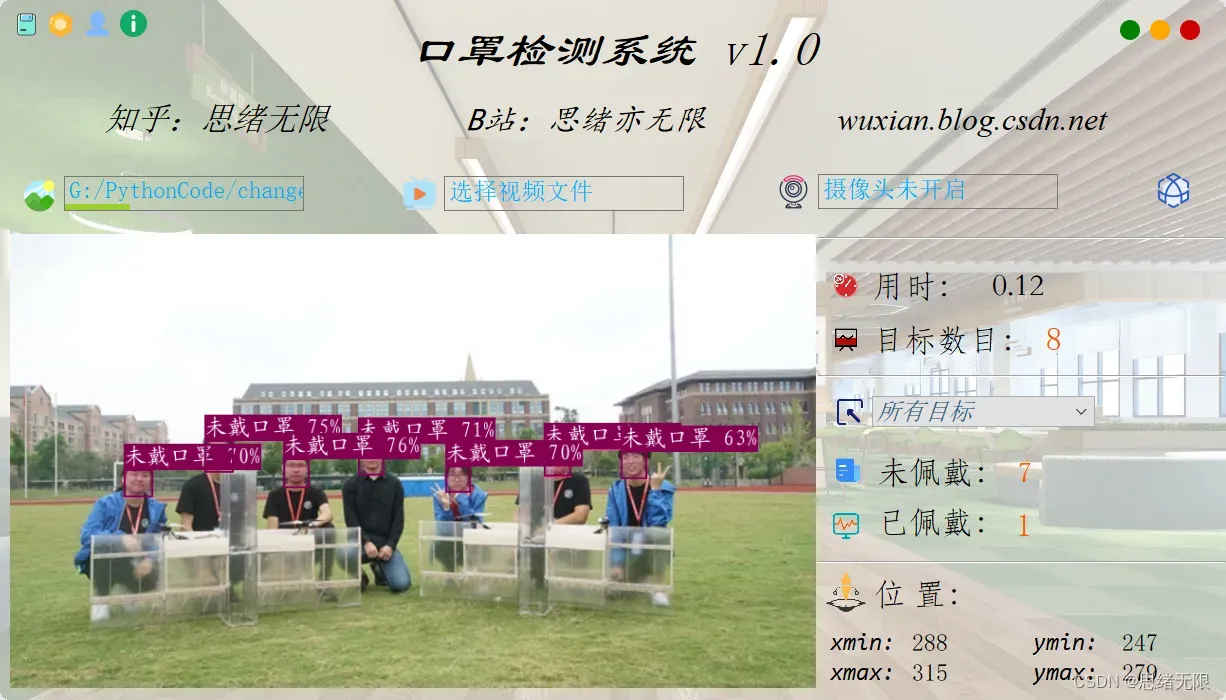

说完检测算法,对于界面的展示同样非常重要,这里给出博主设计的软件界面,与前期发布的系统界面保持同款的清新简约风,功能也可以满足图片、视频和摄像头的识别检测,希望大家可以喜欢,初始界面如下图:

检测口罩时的界面截图如下图,可识别画面中存在的多个目标的口罩佩戴情况,也可开启摄像头或视频检测:

详细的功能演示效果参见博主的B站视频或下一节的动图演示,觉得不错的朋友敬请点赞、关注加收藏!系统UI界面的设计工作量较大,界面美化更需仔细雕琢,大家有任何建议或意见和可在下方评论交流。

1. 效果演示

首先我们还是通过动图看一下识别的效果,系统设计了一个简单的登录注册界面和功能主界面,实现的主要功能是对图片、视频和摄像头画面中的人脸口罩进行识别,识别的结果可视化显示在界面和图像中,另外提供多个目标的显示选择功能,演示效果如下。

(一)用户注册登录界面

这里设计了一个登录界面,可以注册账号和密码,然后进行登录。界面还是参考了当前流行的UI设计,左侧是一个动图,右侧输入账号、密码、验证码等等。

(二)选择图片识别

系统允许选择图片文件进行识别,点击图片选择按钮图标选择图片后,显示所有目标识别的结果,可通过下拉选框查看单个目标的结果。本功能的界面展示如下图所示:

(三)视频识别效果展示

有时候我们需要识别一段视频中是否佩戴口罩,这里设计了视频选择功能。点击视频按钮可选择待检测的视频,系统会自动解析视频逐帧识别人脸,并将结果记录在右下角表格中,效果如下图所示:

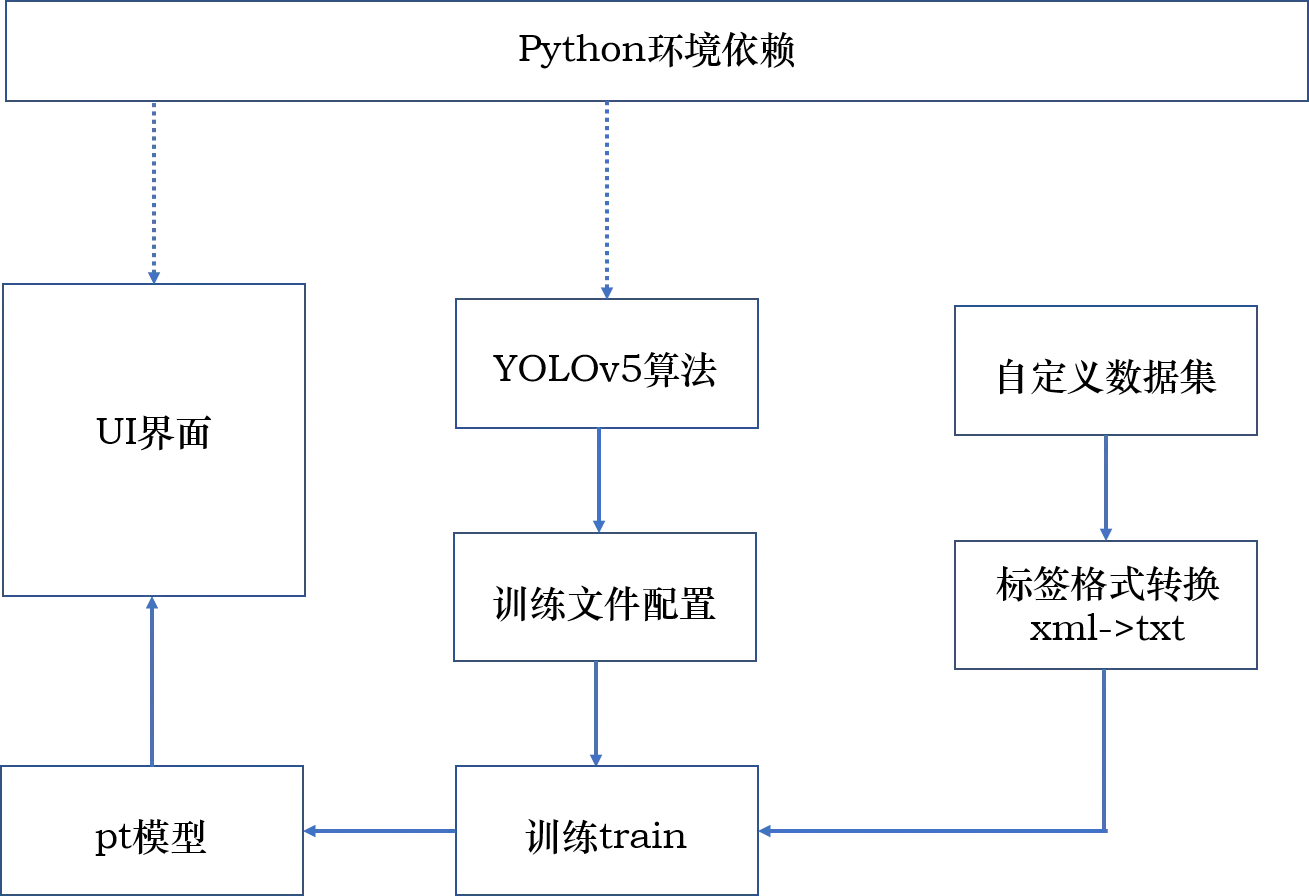

2. 口罩数据集及训练

以上系统的技术构成主要为两大块:YOLOv5算法、UI界面设计。YOLOv5算法提供深度学习的检测模型,这一部分需要构建口罩数据集并训练模型,为后续界面中口罩识别提供算法支持;UI界面利用PyQt5进行界面设计,并为各控件模块写入执行逻辑,在选中图片或视频时调用前面训练好的YOLOv5模型进行预测,将结果显示在界面上。整个系统涉及的主要工作如下图所示。

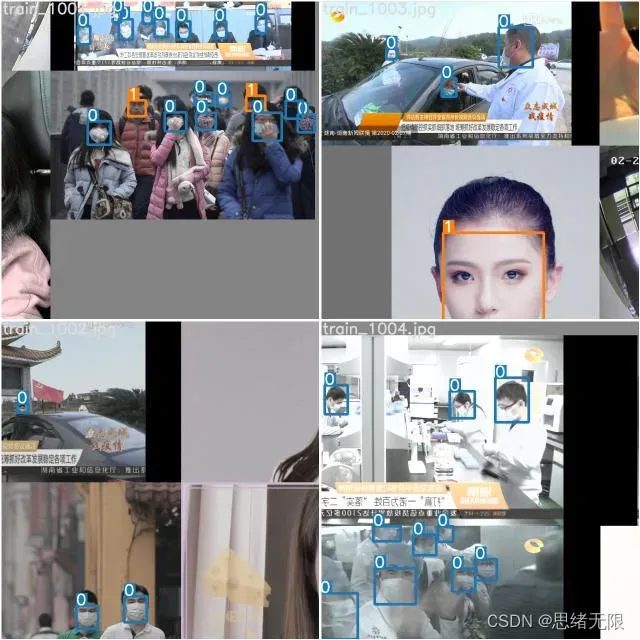

这里我们使用的口罩识别数据集,每张图片除包括类别标签外,还有一个标注的物体边框(Bounding Box),其中包括训练集1200张、验证集400张、测试集400张,共计2000张图片。

每张图像均提供了图像类标记信息,其中的标注文件已转换为YOLO算法使用的txt格式,算法可以直接使用其进行训练,数据集并解压后得到的部分截图如下图所示。

数据集准备好,接下来可执行训练程序,首先要安装本系统所需的依赖库,配置一个Python3.8然后按照requirements.txt里面的依赖装环境就可以运行了。

#请按照给定的python版本配置环境,否则可能会因依赖不兼容而出错

conda create -n env_rec python=3.8

#激活环境

activate env_rec

#使用pip安装所需的以来,可通过requirements.txt

pip install -r requirements.txt

有些人可能会在装pycocotools>=2.0这个包有问题,这里博主在文章底部也提供了离线库的链接,也可通过离线包安装。到这,深度学习所需的环境和依赖包就准备好了。

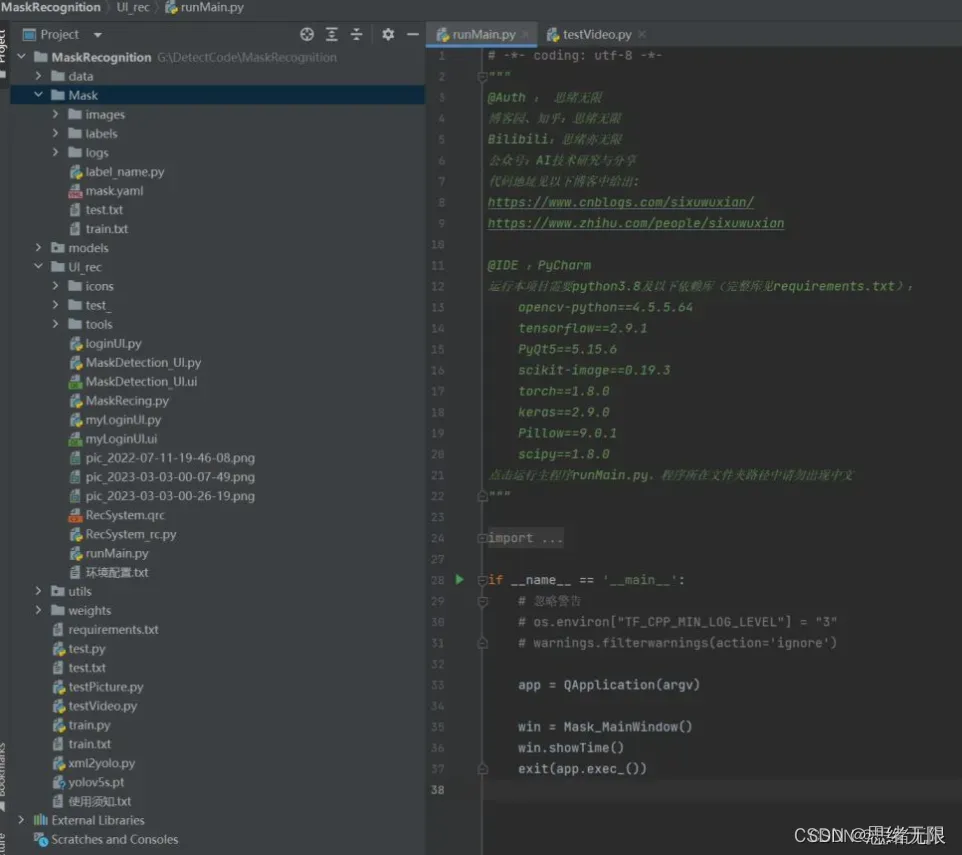

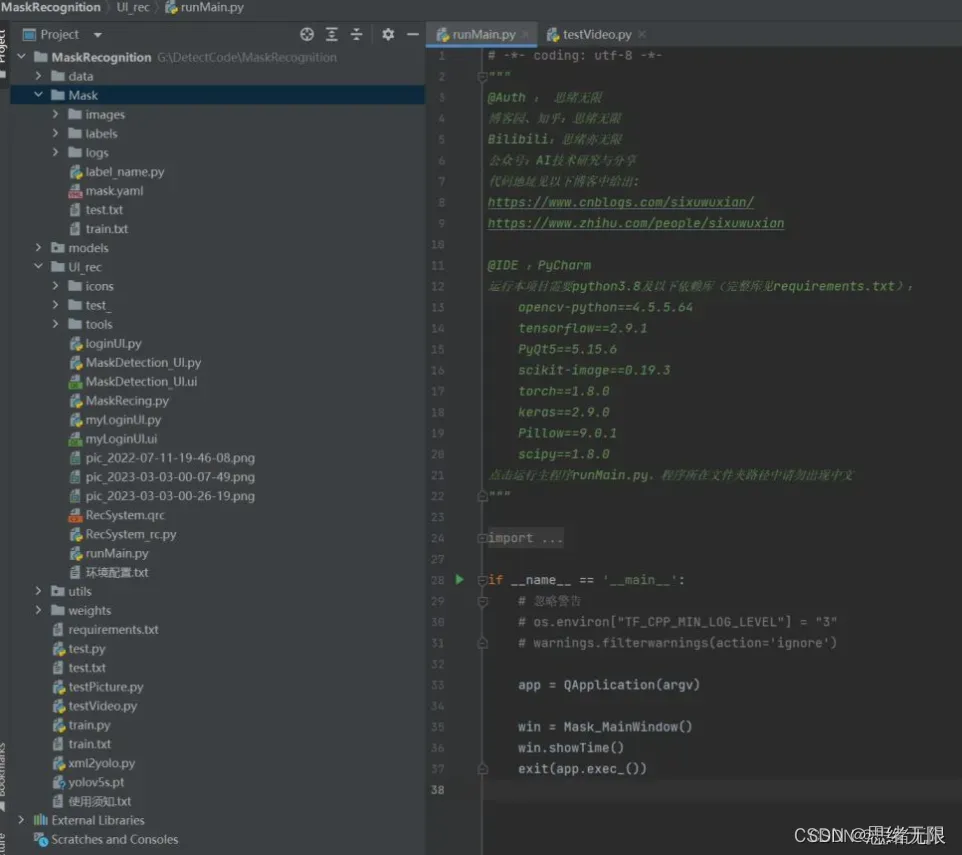

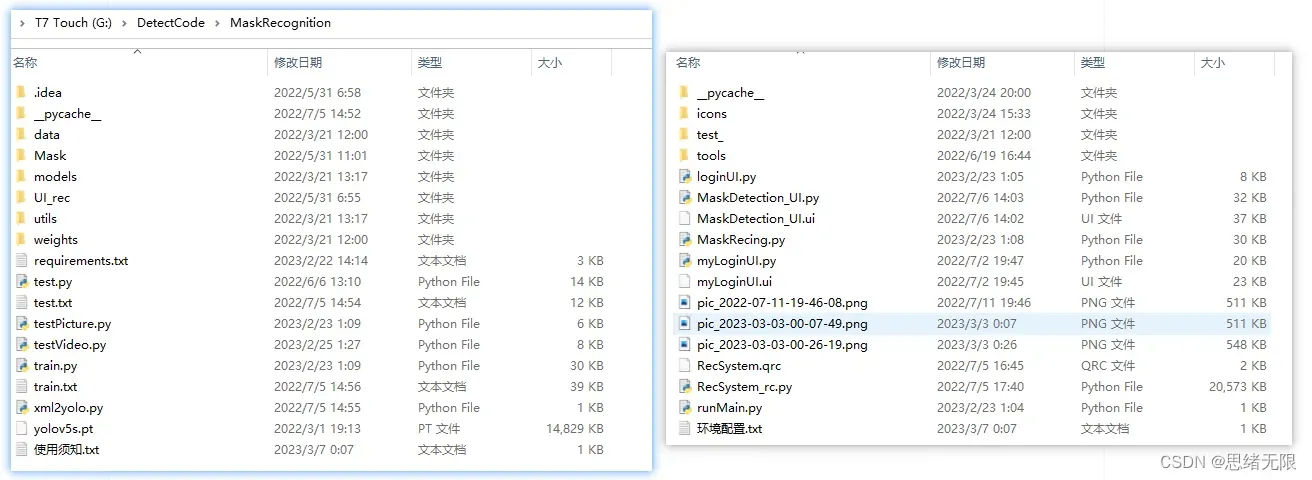

现在对YOLO代码的部分做一个介绍,下图为本项目的目录:

data:主要是存放一些超参数的配置文件(这些文件(yaml文件)是用来配置训练集和测试集还有验证集的路径的,其中还包括目标检测的种类数和种类的名称)

里面主要是一些网络构建的配置文件和函数,其中包含了该项目的四个不同的版本,分别为是s、m、l、x。从名字就可以看出,这几个版本的大小。他们的检测测度分别都是从快到慢,但是精确度分别是从低到高。如果训练自己的数据集的话,就需要修改这里面相对应的yaml文件来训练自己模型。

utils:存放的是工具类的函数,里面有loss函数,metrics函数,plots函数等等。

weights:放置训练好的权重参数。

detect.py:利用训练好的权重参数进行目标检测,可以进行图像、视频和摄像头的检测。

UI_rec:这个文件夹下存放有UI界面、图标及界面相关的代码程序,可运行runMain.py进入主界面,使用loginUI.py进入登录注册界面。

train.py:训练自己的数据集的函数。

testPicture.py:读取设置的图片进行预测;testVideo.py:读取自定义路径的视频文件进行检测。

requirements.txt:这是一个文本文件,里面写着使用本项目的环境依赖包的一些版本,可以利用该文本导入相应版本的包。

以上就是本项目代码的整体介绍。我们训练和测试自己的数据集就是利用到如上的代码。

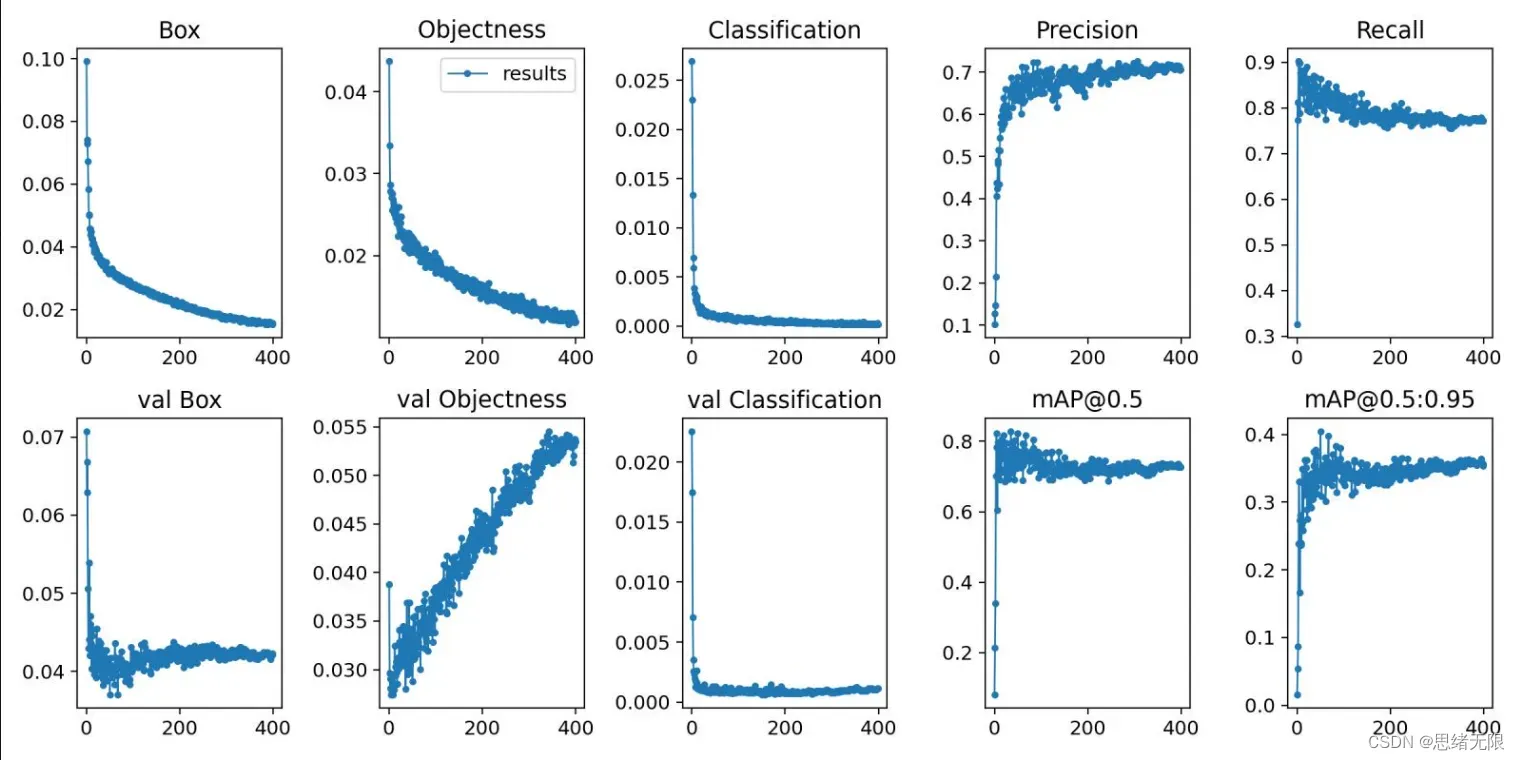

在深度学习中,我们通常通过损失函数下降的曲线来观察模型训练的情况。而YOLOv5训练时主要包含三个方面的损失:矩形框损失(box_loss)、置信度损失(obj_loss)和分类损失(cls_loss),在训练结束后,我们也可以在logs目录下找到生成对若干训练过程统计图。下图为博主训练口罩类识别的模型训练曲线图。

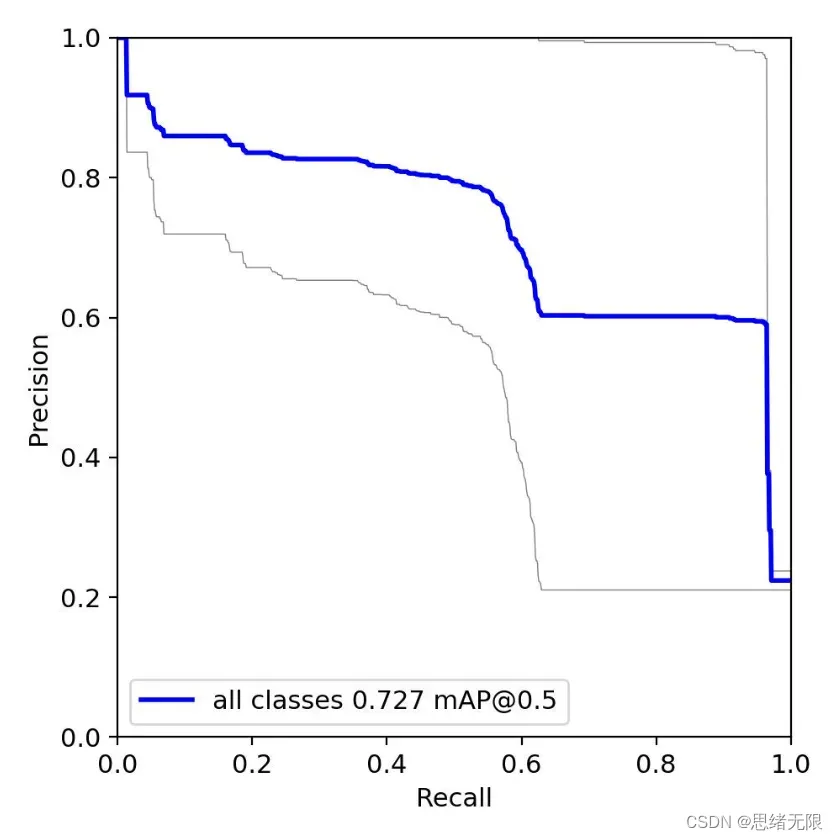

一般我们会接触到两个指标,分别是召回率recall和精度precision,两个指标p和r都是简单地从一个角度来判断模型的好坏,均是介于0到1之间的数值,其中接近于1表示模型的性能越好,接近于0表示模型的性能越差,为了综合评价目标检测的性能,一般采用均值平均密度map来进一步评估模型的好坏。我们通过设定不同的置信度的阈值,可以得到在模型在不同的阈值下所计算出的p值和r值,一般情况下,p值和r值是负相关的,绘制出来可以得到如下图所示的曲线,其中曲线的面积我们称AP,目标检测模型中每种目标可计算出一个AP值,对所有的AP值求平均则可以得到模型的mAP值。

以PR-curve为例,可以看到我们的模型在验证集上的均值平均准确率为0.727。当然我们这里没有过多的调优训练过程,所以训练模型的结果还有待提升。

3. 口罩检测识别

在训练完成后得到最佳模型,接下来我们将帧图像输入到这个网络进行预测,从而得到预测结果,预测方法(predict.py)部分的代码如下所示:

def predict(img):

img = torch.from_numpy(img).to(device)

img = img.half() if half else img.float()

img /= 255.0

if img.ndimension() == 3:

img = img.unsqueeze(0)

t1 = time_synchronized()

pred = model(img, augment=False)[0]

pred = non_max_suppression(pred, opt.conf_thres, opt.iou_thres, classes=opt.classes,

agnostic=opt.agnostic_nms)

t2 = time_synchronized()

InferNms = round((t2 - t1), 2)

return pred, InferNms

得到预测结果我们便可以将帧图像中的口罩框出,然后在图片上用opencv绘图操作,输出口罩的类别及口罩的预测分数。以下是读取一个口罩图片并进行检测的脚本,首先将图片数据进行预处理后送predict进行检测,然后计算标记框的位置并在图中标注出来。

if __name__ == '__main__':

img_path = "./UI_rec/test_/val_178.jpg"

image = cv_imread(img_path)

img0 = image.copy()

img = letterbox(img0, new_shape=imgsz)[0]

img = np.stack(img, 0)

img = img[:, :, ::-1].transpose(2, 0, 1) # BGR to RGB, to 3x416x416

img = np.ascontiguousarray(img)

pred, useTime = predict(img)

det = pred[0]

p, s, im0 = None, '', img0

if det is not None and len(det): # 如果有检测信息则进入

det[:, :4] = scale_coords(img.shape[1:], det[:, :4], im0.shape).round() # 把图像缩放至im0的尺寸

number_i = 0 # 类别预编号

detInfo = []

for *xyxy, conf, cls in reversed(det): # 遍历检测信息

c1, c2 = (int(xyxy[0]), int(xyxy[1])), (int(xyxy[2]), int(xyxy[3]))

# 将检测信息添加到字典中

detInfo.append([names[int(cls)], [c1[0], c1[1], c2[0], c2[1]], '%.2f' % conf])

number_i += 1 # 编号数+1

label = '%s %.2f' % (names[int(cls)], conf)

# 画出检测到的目标物

plot_one_box(image, xyxy, label=label, color=colors[int(cls)])

# 实时显示检测画面

cv2.imshow('Stream', image)

# if cv2.waitKey(1) & 0xFF == ord('q'):

# break

c = cv2.waitKey(0) & 0xff

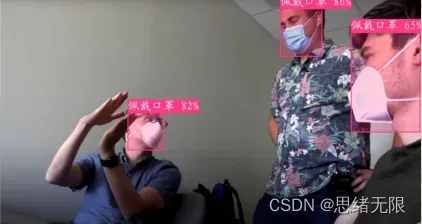

执行得到的结果如下图所示,图中口罩的种类和置信度值都标注出来了,预测速度较快。基于此模型我们可以将其设计成一个带有界面的系统,在界面上选择图片、视频或摄像头然后调用模型进行检测。

跑通了这个预测程序,我们可以将其封装到界面中,利用PyQt5设计一个UI界面,在运行图片、视频检测时调用这个方法。博主对整个系统进行了详细测试,最终开发出一版流畅得到清新界面,就是博文演示部分的展示,完整的UI界面、测试图片视频、代码文件,以及Python离线依赖包(方便安装运行,也可自行配置环境),均已打包上传,感兴趣的朋友可以通过参考文章里面给出的下载链接或B站视频简介处的下载链接获取。

下载链接

若您想获得博文中涉及的实现完整全部程序文件(包括测试图片、视频,py, UI文件等,如下图),这里已打包上传至博主的面包多平台,可见参考博客与视频,已将所有涉及的文件同时打包到里面,点击即可运行,完整文件截图如下:

在文件夹下的资源显示如下,其中包含了Python的离线依赖包,读者可在正确安装Anaconda和Pycharm软件后,进行安装,详细演示也可见本人B站视频。

注意:该代码采用Pycharm+Python3.8开发,经过测试能成功运行,运行界面的主程序为runMain.py和LoginUI.py,测试图片脚本可运行testPicture.py,测试视频脚本可运行testVideo.py。为确保程序顺利运行,请按照requirements.txt配置Python依赖包的版本。Python版本:3.8,请勿使用其他版本,详见requirements.txt文件;

环境配置与界面中文字、图片、logo等的修改方法请见视频,项目完整文件下载请见参考博客文章里面,或参考视频的简介处给出:➷➷➷

参考博客文章:https://zhuanlan.zhihu.com/p/614267444/

参考视频演示:https://www.bilibili.com/video/BV1dx4y1N7z8/

离线依赖库下载链接:https://pan.baidu.com/s/1hW9z9ofV1FRSezTSj59JSg?pwd=oy4n (提取码:oy4n )

结束语

由于博主能力有限,博文中提及的方法即使经过试验,也难免会有疏漏之处。希望您能热心指出其中的错误,以便下次修改时能以一个更完美更严谨的样子,呈现在大家面前。同时如果有更好的实现方法也请您不吝赐教。

文章出处登录后可见!