✨博客主页:米开朗琪罗~🎈

✨博主爱好:羽毛球🏸

✨年轻人要:Living for the moment(活在当下)!💪

🏆推荐专栏:【图像处理】【千锤百炼Python】【深度学习】【排序算法】

目录

😺一、引言

类似于人脑的注意力感知,那卷积神经网络能否也能产生注意力效果呢?答案是:可以!

SE_Block是SENet的子结构,作者将SE_Block用于ResNeXt中,并在ILSVRC 2017大赛中拿到了分类任务的第一名,在ImageNet数据集上将top-5 error降低到2.251%,比2016年的最好成绩提高了约25%。

论文链接:Squeeze-and-Excitation Networks

开源代码:https://github.com/hujie-frank/SENet

😺二、网络结构

作者研究了网络设计通道之间的关系,引入了一个新的结构单元SE_Block,其目标是通过显式地建模网络演化特征通道之间的相互依赖关系来提高网络生成的表示的质量。为此,作者提出了一种机制,允许网络执行特征重新校准,通过这种机制,它可以学习使用全局信息来选择性地强调信息性特征,并抑制不太可靠的特征。

🐶2.1 SE_Block结构图

SE_Block(SQUEEZE-AND-EXCITATION BLOCKS)主要包含两部分,分别是Squeeze和Excitation。

结构中的输入为

,且

,输出为

,且

。

我们将视为一个简单的卷积操作,用式子

表示,其中

表示第

个卷积核,输出用式子

表示,则有:

其中表示卷积,

,

,且

,

是一个2D空间卷积,为了简化公式,作者简化了偏置项。

由于输出是通过所有通道的求和产生的,因此通道相关性隐式地嵌入在中,但与滤波器捕获的局部空间相关性相纠缠。我们期望通过显式地建模通道的相互依赖性来增强卷积特征的学习,从而使网络能够提高其对信息特征的敏感性,这些信息特征可以被后续转换利用。因此,我们希望为其提供获取全局信息的途径,并在输入下一个转换之前,分两步(Sequeeze and Excitation)重新校准滤波器响应。

🐶2.2 Squeeze:Global Information Embedding

作者首先考虑输出特征图中的每个信道的信号。每个学习到的滤波器都与一个局部感受野一起工作,因此转换输出的每个单元都无法利用该区域之外的上下文信息。

为了解决这个问题,作者建议将全局空间信息压缩到信道描述符中。这是通过使用全局平均池生成通道统计信息来实现的。准确地说,是对特征

在空间维度

执行全局平均池化后的结果,因此

的每一个元素表示如下:

因此,Squeeze操作就是在得到(多个特征图)之后采用全局平均池化操作对每一个特征图进行牙所,使其

个特征图最后变成

的实数数列。

🐶2.3 Excitation: Adaptive Recalibration

为了利用Squeeze操作中聚合的信息,我们需要继续执行第二个操作Excitation,目的是完全捕获通道依赖关系。为了实现这一目标,该功能必须满足两个标准:第一,它必须操作灵活(尤其是它必须能够学习通道之间的非线性关系),第二,它必须学习非互斥关系,因为我们希望多个通道都能被加强(而不是类似one-hot那种仅加强了某一个通道特征)。为了满足这些标准,作者选择使用带有sigmoid 激活的简单门控机制。

为了满足上述两个条件,作者采用了下面的变换形式:

上式中,表示sigmoid激活函数,

表示relu激活函数,其中

,

。

为了限制模型的复杂性并使其通用化,作者使用两个FC层来对选通机制进行参数化,即具有降维率的降维层,一个ReLU,然后是一个维度升高层,再转到输出特征图的通道维度。通过使用激活重新缩放特征图来获得Block的最终输出。

得到后,可以通过下式得到SE_Block的最终输出:

其中,

,

是通道上的乘积。

😺三、模块迁移

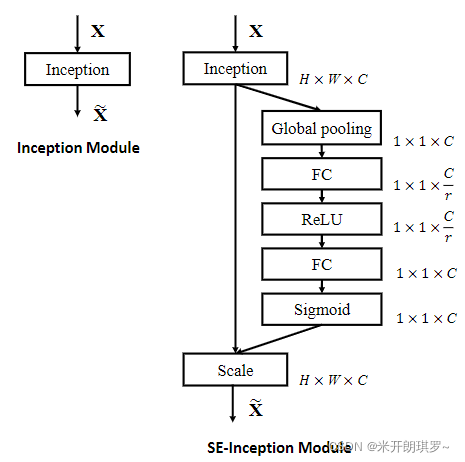

下图是将SE_Block迁移到Inception网络与ResNet中的结构图:

😺四、总结

作者提出了一个可移植性非常高的通道注意力模块SE_Block,并在各种经典神经网络中表现了不错的性能。

文章出处登录后可见!