PANet

Path Aggregation Network for Instance Segmentation

用于实例分割的路径聚合网络

论文网址:PANet

简读论文

这篇论文提出了Path Aggregation Network (PANet),目的是增强基于proposal的实例分割框架中的信息流动。具体来说,论文提出了以下几点改进:

- 增加自底向上的路径(bottom-up path augmentation),用低层中的精确定位信号增强整个特征金字塔,缩短从底层到顶层的信息路径。

- 提出自适应特征池化(adaptive feature pooling),允许每个proposal获取所有特征层的信息,避免仅依赖于被人为指定的某个特征层。

- 在mask预测分支中增加全连接融合(fully-connected fusion),与原有的FCN路径互补,获取不同视角的预测结果进行融合。

首两点改进同时提升了目标检测和实例分割的性能。实验结果显示,即使只用ResNet-50作为backbone,单尺度测试下PANet也优于利用更大模型和多尺度测试的Mask R-CNN和2016年COCO挑战赛冠军方案。在2017年COCO挑战赛中,PANet获得实例分割第一名和目标检测第二名。

主要贡献总结如下:

4. 提出自底向上路径增强,用低层精确定位信号增强整个特征金字塔,缩短从底层到顶层的信息路径。

5. 提出自适应特征池化,允许每个proposal获取所有特征层信息,避免人为指定特征层。

6. 在mask预测中增加全连接分支,与FCN互补获取不同视角预测进行融合。

7. 在多个数据集上取得最优或比较优异的结果。

PANet网络结构详解

PANet的网络结构可以总结如下三个关键部分:

- 底层到顶层的自底向上路径增强(Bottom-up Path Augmentation)

- 在FPN的基础上,新增从底层到顶层的侧连接,构建自底向上的路径

- 每个建立一个块,将高分辨率的底层特征图上样本并下采样,然后与高层特征图做侧连接相加

- 逐层进行,直到最高层,增强整个特征金字塔的定位能力

FPN本身是自顶向下的结构,通过较高层的语义信息向下增强低层特征,输出多尺度的特征图。

PANet在FPN的基础上,新增了自底向上的路径。具体是从最低层开始,逐步向上融合当前层和上一层获得新特征,一直到最高层,输出增强后的多尺度特征图。

这种自底向上是对FPN的补充,可以让低层的精确定位信息更好地向上传递,增强整体特征金字塔的定位表达能力。

在增强后的多尺度特征图上,进行 ROIs 池化、预测等操作。

- 自适应特征池化(Adaptive Feature Pooling)

- 为每个提议框分别在每个特征层进行ROIAlign池化得到特征

- 将不同层得到的特征做最大值融合(element-wise max)

自适应特征池化中对不同层特征进行融合,具体操作如下:

1.对每个提议框,在每个特征层上分别进行 ROI Align,得到同样大小的固定尺寸特征图(例如 7×7)。

2.不同特征层的特征图通道数相同(例如256),所以可以直接逐位置进行最大值融合(element-wise max)。

3.举例来说,如果有4个特征层,对一个提议框进行ROI Align后,可以得到4个 256 x 7 x 7 的特征图。

4.然后对这4个特征图逐位置取最大值,得到一个 256 x 7 x 7 的融合特征图。

5.这个融合特征图作为该提议框的最终表征,进行后续预测。 - 允许每个提议框自适应获取所有层特征,不受人为指定特征层限制

- 全连接分支融合(Fully-Connected Fusion)

- 在Mask R-CNN的FCN预测分支基础上,新增全连接分支

- 全连接分支从conv3开始,进行全局预测

- 将FCN分支和全连接分支的预测进行相加,融合不同视角信息

以上模块相对简单高效,同时增强了特征表达能力和信息流动,从而显著提升了性能。

摘要

信息在神经网络中传播的方式非常重要。本文提出了路径聚合网络(PANet),旨在增强基于proposal的实例分割框架中的信息流动。具体来说,通过自下而上的路径增强,在较低层中使用准确的定位信号来增强整个特征层次结构,从而缩短了较低层和最顶层特征之间的信息路径。本文提出了自适应特征池化,它将特征网格和所有特征级别链接起来,使每个特征级别中的有用信息直接传播到以下提议子网络。创建一个互补分支,捕获每个提案的不同视图,以进一步改进掩模预测。

引言

实例分割是视觉任务中最重要和最具挑战性的任务之一。它的目的是预测类标签和像素级实例掩码,以定位图像中呈现的不同数量的实例。这项任务广泛应用于自动驾驶汽车、机器人、视频监控等。

在深度卷积神经网络的帮助下,提出了几种实例分割框架,例如[Mask RCNN]。 Mask R-CNN 是一个简单而有效的实例分割系统。基于 Fast/Faster R-CNN ,全卷积网络 (FCN) 用于掩模预测以及框回归和分类。为了实现高性能,利用特征金字塔网络(FPN)[2017]来提取网络内特征层次结构,其中增强了具有横向连接的自上而下的路径以传播语义上强的特征。

几个新发布的数据集为改进算法提供了巨大空间。COCO 由 20 万张图像组成。每张图像中都捕获了许多具有复杂空间布局的实例。不同的是,Cityscapes 和 MVD 每张图像中都有大量交通参与者的街道场景。这些数据集中出现了模糊、严重遮挡和极小的实例。

已经提出了一些用于设计图像分类网络的原则,这些原则对于目标检测也有效。例如,通过干净的残差连接和密集连接来缩短信息路径和简化信息传播。通过遵循 split-transform-merge 策略创建并行路径来增加信息路径的灵活性和多样性。

本文发现:本文的研究表明,最先进的 Mask R-CNN 中的信息传播可以进一步改进。具体来说,低级别的特征有助于大型实例识别。但从底层结构到最高层特征有很长的路要走,这增加了获取准确定位信息的难度。此外,每个提议都是基于从一个特征级别汇集的特征网格来预测的,该特征级别是启发式分配的。这个过程可以更新,因为在其他级别中丢弃的信息可能有助于最终预测。最后,掩模预测是在单一视图上进行的,失去了收集更多多样化信息的机会。

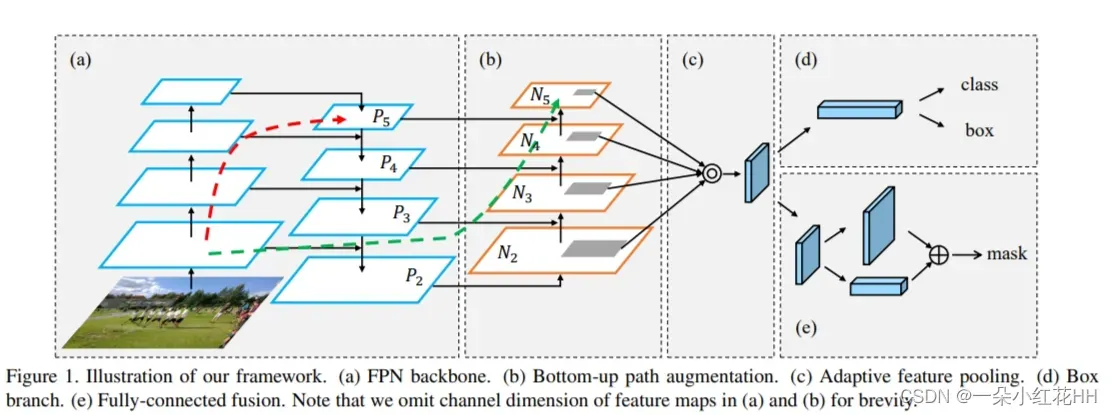

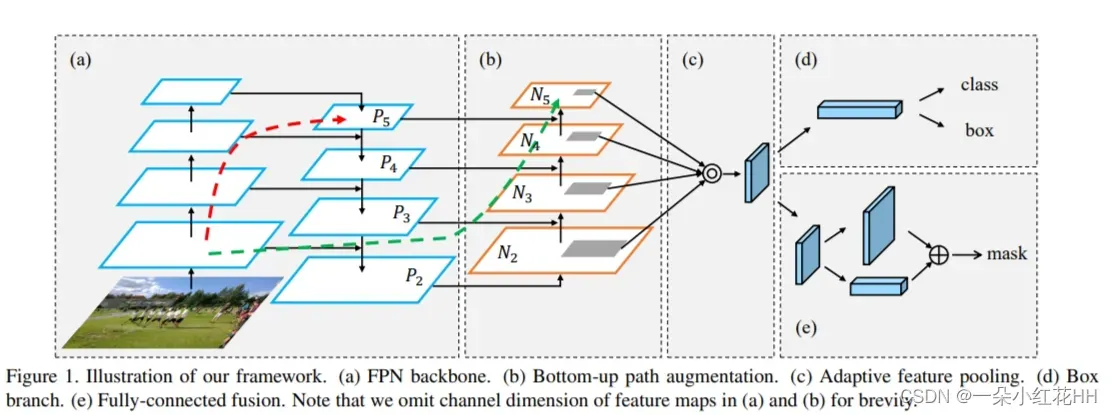

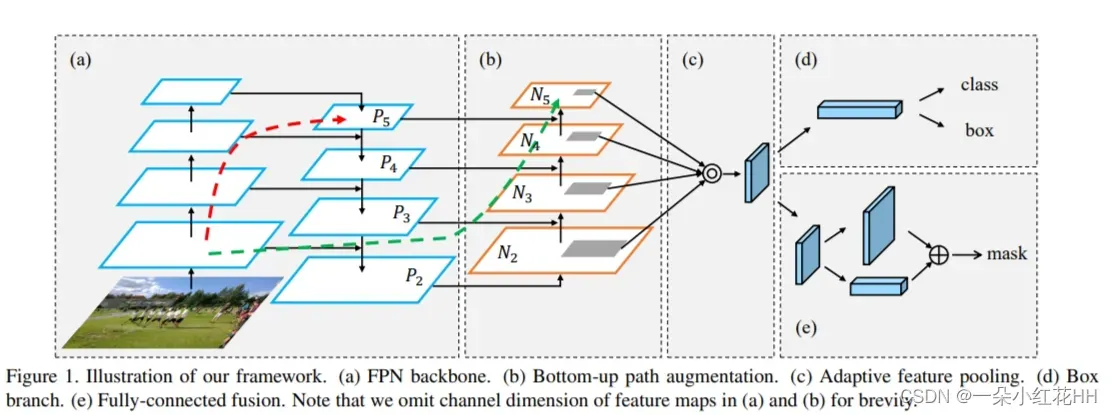

贡献:受这些原则和观察的启发,提出了 PANet,如下图所示,用于分割实例。

首先,为了缩短信息路径并利用低层中存在的精确定位信号来增强特征金字塔,创建了自下而上的路径增强。事实上,[SSD,DSSD,Hypernet]的系统中利用了低层的特征。但尚未探索传播低级特征以增强整个特征层次结构以进行实例识别。

其次,为了恢复每个提议和所有特征级别之间损坏的信息路径,开发了自适应特征池化。它是一个简单的组件,用于聚合每个提议的所有特征级别的特征,避免任意分配的结果。通过此操作,与[Insideoutside net]相比,创建了更干净的路径。

最后,为了捕获每个提议的不同视图,使用微小的全连接(fc)层增强掩模预测,该层与 Mask R-CNN 最初使用的 FCN 具有互补的特性。通过融合这两种观点的预测,增加信息多样性并产生质量更好的掩模。

前两个组件由目标检测和实例分割共享,从而大大增强了这两个任务的性能。

实验结果:借助 PANet,在多个数据集上实现了最先进的性能。使用 ResNet-50 作为初始网络,用单一尺度进行测试的 PANet 在目标检测和实例分割任务中的表现已经超过了 COCO 2016 Challenge 的冠军。请注意,这些先前的结果是通过更大的模型以及多尺度和水平翻转测试来实现的。

相关工作

Instance Segmentation:实例分割主要有两种方法。最流行的一种是基于提议的。该的方法与目标检测有很强的联系。在 R-CNN 中,来自 [Selective search for object recognition-2013, Edge boxes-2014] 的对象提案被输入网络以提取特征进行分类。而 Fast/Faster R-CNN 和 SPPNet 通过池化全局特征图中的特征来加速这一过程。早期的工作将 MCG 的掩模提案作为输入来提取特征,而 CFM 、MNC 和 [Boundary-aware instance segmentation]将特征池化合并到网络中以获得更快的速度。较新的设计是在网络中生成实例掩码作为提议或最终结果。 Mask R-CNN是属于这一流的有效框架。本文的工作建立在Mask R-CNN的基础上,并从不同方面对其进行了改进。

其他中的方法主要是基于分段的。他们学习了专门设计的转换或实例边界。然后从预测的转换中解码实例掩码。其他pipeline的实例分割也存在。

Multi-level Features:来自不同层的特征被用于图像识别。 SharpMask ,[Large kernel matters – improve semantic segmentation by global convolutional network] 和 LRR 融合特征图,用于具有更精细细节的分割。 FCN、U-Net 和 [Learning deconvolution network for semantic segmentation]通过跳跃连接融合来自较低层的信息。 TDM 和 FPN 都通过横向连接增强了自上而下的路径,用于目标检测。与 TDM 采用最高分辨率的融合特征图来池化特征不同,SSD 、DSSD 、MS-CNN 和 FPN 将提议分配到适当的特征级别进行推理。本文以 FPN 为基准并对其进行了很大的增强。

ION ,[A multipath network for object detection]、Hypernet 和 Hypercolumn 连接不同层的特征网格以实现更好的预测。但需要一系列操作,即归一化、串联和降维才能获得可行的新特征。相比之下,本文的设计要简单得多。

[Object detection networks on convolutional feature maps] 中还利用了每个提议融合来自不同来源的特征网格。但该方法在不同尺度的输入上提取特征图,然后进行特征融合(使用最大值操作)以改进输入图像金字塔的特征选择。相比之下,本文的方法旨在利用单尺度输入的网络内特征层次结构中所有特征级别的信息。启用端到端训练。

Larger Context Region:[Object detection via a multiregion and semantic segmentation-aware CNN model, Crafting GBD-Net for object detection, A multipath network for object detection]的方法通过中心凹结构汇集每个提议的特征,以利用来自不同分辨率区域的上下文信息。从更大区域汇集的特征提供了周围的环境。 PSPNet 和 ParseNet 使用全局池化来极大地提高语义分割的质量。[ Large kernel matters – improve semantic segmentation by global convolutional network]中使用了全局卷积。本文的掩模预测分支也支持访问全局信息。但技术完全不同。

Framework

本文的框架如下图所示。进行路径增强和聚合是为了提高性能。增强了自下而上的路径,使低层信息更容易传播。设计了自适应特征池化,以允许每个提议访问各个级别的信息进行预测。互补路径被添加到掩模预测分支。这种新结构带来了不错的性能。与 FPN 类似,改进与 CNN 结构无关。

Bottom-up Path Augmentation

Motivation:富有洞察力的观点 [Visualizing and understanding convolutional networks] 高层神经元对整个对象强烈响应,而其他神经元更有可能被局部纹理和模式激活,这表明有必要增强自上而下的路径来传播语义上强的特征并增强所有FPN特征中合理的分类能力。

本文的框架通过传播低级模式的强烈响应,进一步增强了整个特征层次结构的定位能力。为此,建立了一条从低层到高层的横向连接清晰的路径。因此,存在一条跨越这些级别的“捷径”(图中的绿色虚线),该捷径由不到 10 层组成。相比之下,FPN 到 CNN 主干给出了一条很长的路径(图中的红色虚线),从低层到最顶层甚至经过 100 多个层。

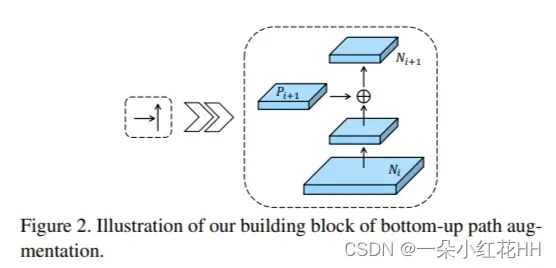

Augmented Bottom-up Structure:本文的框架首先完成自下而上的路径增强。遵循 FPN 来定义生成具有相同空间大小的特征图的层处于同一网络阶段。每个功能级别对应一个阶段。以 ResNet 作为基本结构,并使用 {P2, P3, P4, P5} 表示 FPN 生成的特征级别。增强路径从最低级别 P2 开始,逐渐接近 P5,如图(b)所示。从P2到P5,空间尺寸逐渐以因子2下采样。使用{N2,N3,N4,N5}来表示与{P2,P3,P4,P5}对应的新生成的特征图。注意,N2只是P2,没有任何处理。

如下图所示,每个构建块通过横向连接获取较高分辨率的特征图Ni和较粗的特征图Pi+1,并生成新的特征图Ni+1。每个特征图 Ni 首先经过一个步幅为 2 的 3 × 3 卷积层以减小空间尺寸。然后通过横向连接将特征图 Pi+1 和下采样图的每个元素相加。然后融合的特征图由另一个 3 × 3 卷积层处理,为后续子网络生成 Ni+1。这是一个迭代过程,在接近P5后终止。在这些构建块中,始终使用特征图的 256 通道。所有卷积层后面都跟有 ReLU 。然后从新的特征映射中,即{N2,N3,N4,N5},汇集每个提议的特征网格。

Adaptive Feature Pooling

Motivation:在 FPN 中,根据提议的大小将提议分配到不同的特征级别。它会将小型提案分配给低功能级别,将大型提案分配给较高功能级别。尽管简单有效,但它仍然可能产生非最佳结果。例如,两个具有 10 像素差异的提议可以分配到不同的级别。事实上,这两个提议非常相似。

此外,特征的重要性可能与其所属的级别没有很强的相关性。高级特征是通过较大的感受野生成的,并捕获更丰富的上下文信息。允许小提议访问这些功能可以更好地利用有用的上下文信息进行预测。同样,低级特征具有许多精细细节和高定位精度。让大型提议访问它们显然是有益的。有了这些想法,建议为每个提议汇集各个级别的特征,并将它们融合以进行后续预测。将此过程称为自适应特征池化。

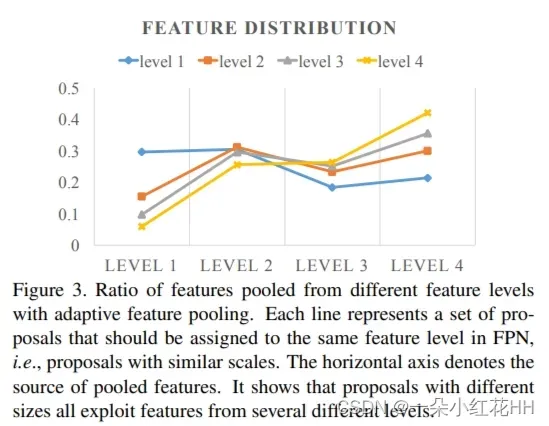

现在通过自适应特征池来分析不同级别池化特征的比率。使用最大操作来融合不同级别的特征,这让网络可以选择元素方面的有用信息。根据提议最初在 FPN 中分配的级别将提案分为四类。对于每组提议,计算从不同级别选择的特征的比率。在符号中,级别 1 – 4 代表从低到高的级别。如下图所示,蓝线代表最初在 FPN 中分配给级别 1 的小提案。令人惊讶的是,近 70% 的功能来自其他更高级别。还使用黄线来表示在 FPN 中分配给第 4 级的大型提议。同样,50% 以上的功能是从其他较低级别汇集的。这一观察结果清楚地表明,多个级别的特征组合在一起有助于准确的预测。这也是设计自下而上的路径增强的有力支持。

Adaptive Feature Pooling Structure:自适应特征池化实际上实现起来很简单,如图 1© 所示。首先,对于每个提议,将它们映射到不同的特征级别,如图 1(b) 中的深灰色区域所示。遵循 Mask R-CNN,ROIAlign 用于池化每个级别的特征网格。然后利用融合操作(逐元素最大值或总和)来融合不同级别的特征网格。

在接下来的子网络中,池化特征网格独立地经过一个参数层,然后进行融合操作,以使网络能够适应特征。例如,FPN中的box分支有两个fc层。在第一层之后应用融合操作。由于Mask R-CNN中的掩模预测分支使用了四个连续的卷积层,因此在第一和第二卷积层之间放置融合操作。

本文的设计重点是融合来自网络内特征层次结构的信息,而不是来自输入图像金字塔的不同特征图的信息。与[Inside-outside net, A multipath network for object detection,Hypernet]的过程相比,它更简单,需要L-2归一化、串联和降维。

Fully-connected Fusion

Motivation:全连接层(MLP)广泛用于实例分割和掩模提案生成中的掩模预测。 [Fully convolutional instance-aware semantic segmentation] 的结果表明,FCN 也能够预测实例的像素级掩模。最近,Mask R-CNN 在池化特征网格上应用了一个微型 FCN 来预测相应的掩模,避免了类之间的竞争。

本文注意到,与 FCN 相比,fc 层具有不同的特性,FCN 是根据局部感受野对每个像素点进行预测,不同空间位置的参数是共享的。相反,fc 层对位置敏感,因为不同空间位置的预测是通过不同的参数集实现的。因此,它们能够适应不同的空间位置。此外,每个空间位置的预测都是通过整个提议的全局信息进行的。这有助于区分实例和识别属于同一物体的不同部分。鉴于 fc 层和卷积层的特性各不相同,本文将这两类层的预测结果融合在一起,以获得更好的掩膜预测效果。

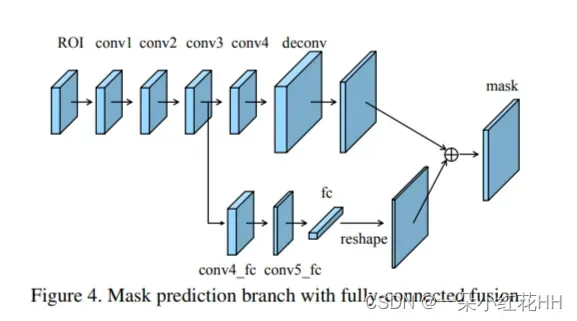

Mask Prediction Structure:本文的掩模预测组件是轻量级且易于实现的。 mask 分支对每个提议的池化特征网格进行操作。如下图所示,主路径是一个小型FCN,由4个连续的卷积层和1个反卷积层组成。每个卷积层由 256 个 3 × 3 滤波器组成,反卷积层以因子 2 上采样特征。它独立地预测每个类别的二进制像素级掩模,以解耦分割和分类,类似于 Mask R-CNN。进一步创建从 conv3 层到 fc 层的短路径。有两个 3×3 卷积层,其中第二个将通道缩小一半以减少计算开销。

fc 层用于预测与类无关的前景/背景掩模。它不仅高效,而且允许使用更多样本训练fc层中的参数,从而具有更好的通用性。使用的掩模大小是 28 × 28,以便 fc 层产生 784 × 1 × 1 向量。该向量被重塑为与 FCN 预测的掩模相同的空间大小。为了获得最终的掩模预测,添加了来自 FCN 的每个类别的掩模和来自 fc 的前景/背景预测。仅使用一个 fc 层(而不是多个 fc 层)进行最终预测,可以防止将隐藏的空间特征图压缩为短特征向量(从而丢失空间信息)的问题。

结论

本文已经展示了用于实例分割的 PANet。设计了几个简单而有效的组件来增强代表性管道中的信息传播。汇集所有特征级别的特征,并缩短较低和最高特征级别之间的距离,以实现可靠的信息传递。补充路径被增强以丰富每个提案的功能。产生了令人印象深刻的结果。未来的工作是将本文的方法扩展到视频和 RGBD 数据。

版权声明:本文为博主作者:一朵小红花HH原创文章,版权归属原作者,如果侵权,请联系我们删除!

原文链接:https://blog.csdn.net/qq_53909832/article/details/133699300