目录

牛顿-拉夫逊优化算法(Newton-Raphson-based optimizer, NBRO)是一种新型的元启发式算法(智能优化算法),该成果由Sowmya等人于2024年2月发表在中科院2区Top SCI期刊《Engineering Applications of Artificial Intelligence》上。

由于发表时间较短,谷歌学术上还无人引用!你先用,你就是创新!

原理简介

所提出的NRBO通过使用几个向量集和两个算子(如NRSR和TAO)来探索搜索域,应用NRM来发现搜索区域,从而定义搜索路径。

一、种群初始化

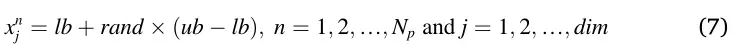

与其他元启发式算法一样,NRBO通过在候选解的边界内产生初始随机种群来启动对最优解的搜索。基于存在Np个种群的事实,并且每个种群由模糊决策变量/向量组成。因此,使用公式(7)生成随机种群:

其中xij表示第n个总体的第j个维度的位置,rand表示(0,1)之间的随机数。公式(8)给出了可以描绘所有维度的种群的种群矩阵:

二、Newton-Raphson搜索规则(NRSR)

矢量由NRSR控制,允许种群更准确地探索可行区域并获得更好的位置。NRSR是基于NRM的概念,即提出NRM是为了促进勘探趋势并加快收敛。由于许多优化技术是不可微的,因此在这种情况下,使用数学NRM来代替函数的显式公式。NRM从一个假定的初始解开始,并沿着一个确定的方向前进到下一个位置。为了从中公式(5)中获取NRSR,必须使用TS来确定二阶导数。f(x−Δx)和f(x+Δx)的TS如下所示:

通过减去/加上公式(9)和公式(10),得出f'(x)和f'(x)的表达式如下:

代入公式(5)中的公式(11)和公式(12),更新的根位置被重写如下:

考虑到NRSR应该是NRBO的主要组成部分,有必要进行某些调整,以管理种群搜索作为公式(13)的结果。彼此相邻的x的位置分别用xn+Δx和xn−Δx表示,如图2所示。NRBO将这对相邻位置转换为种群中的另外两个向量。因为f(xn)是一个最小化问题,如图2所示。位置xn+Δx的适应度值比位置x差,而位置xn-Δx的适合度比位置xn大。因此,NRBO替换位置Xb的位置xn-Δx,位置Xb在其邻域中具有比位置xn更好的位置,而位置xn+Δx被Xw的位置替换,位置Xw在其邻域内具有比位置xn更差的位置。这个方法的另一个优点是,它使用位置xn而不是其适应度f(xn),这节省了计算时间。因此,NRSR表示如下:

其中randn表示均值为0、方差为1的正态分布随机数,Xw表示最差位置,Xb表示最佳位置。等式(14)可以通过用当前解决方案来辅助更新其位置来增强当前解决方案。等式(14)具有随机参数,以增加NRBO的搜索能力并更好地平衡开发和探索能力。

根据经验,所提出的算法必须能够在多样性和聚集性之间达到平衡,以便在搜索空间中发现最优解,并最终收敛到全局解。可以通过应用一个称为δ的自适应系数来增强算法。δ的表达式如公式(15)所示:

其中IT表示当前迭代,而Max IT表示迭代的最大次数。为了在勘探和开发阶段之间保持平衡,参数δ在迭代过程中会自行调整。图3说明了每次迭代过程中δ的变化。根据公式(15),δ的值在1到−1之间变化。

与自适应参数δ一起,所提出的NRSR通过考虑优化过程中的随机动作、增加多样性和避免局部最优来改进NRBO,同时显著减少迭代次数。公式(14)中Δx的表达式如公式(16)所示:

其中Xb表示迄今为止获得的最佳解,rand(1,dim)是具有dim维度决策变量的随机数。现在,通过考虑NRSR来修改公式(13),并重写如下:

![]()

接着,通过包括另一个称为ρ的参数来改进所提出的NRBO的利用,该参数将种群引导到正确的方向。ρ的表达式如下所示。

其中a和b是(0,1)之间的随机数,r1和r2是从总体中随机选择的不同整数。然而,r1和r2的值不相等。矢量的当前位置XnIT已经由公式(19)更新:

其中X1ITn是通过更新xITn而得到的新矢量位置。NRSR是由NRM进一步改进,并且公式(13)被修改和重写如下:

其中yw和yb是使用Z(n+1)和xn生成的两个向量的位置,r1表示(0,1)之间的随机数。NRSR的增强版本如公式(20)所示。使用公式(20)之后,公式(19)被更新如下:

有必要通过用等公式(24)中的当前矢量xnIT的位置代替最佳矢量Xb的位置来构造新矢量X2ITn:

开发阶段是这一搜索方向策略的主要重点。当涉及到局部搜索时,公式(25)提出的搜索方法是有益的,但当涉及到全局搜索时它有局限性;而公式(24)给出的搜索策略对于全局搜索是有益的,但对于局部搜索有局限性。因此,NRBO同时使用公式(24)和(25)来改善多样化和强化阶段。下一次迭代期间的新位置矢量用公式(26)、(27)表示:

其中r2表示(0,1)之间的随机数。

三、陷阱规避操作(TAO)

纳入TAO是为了提高建议的NRBO处理现实世界问题的有效性。TAO是采用Ahmadianfar等人提出的改进和增强运算公式。使用TAO可以显著改变xIT+1n的位置。它通过组合最佳位置Xb和当前矢量位置XITn来产生具有增强质量XITTAO的解决方案。如果rand的值小于DF,则使用如下公式产生解XITTAO:

其中,rand表示(0,1)之间的均匀随机数,θ1和θ2分别是(−1,1)和(−0.5,0.5)之间的一致随机数,DF表示控制NRBO性能的决定因素,μ1和μ2是随机数,分别由公式(31)和(32)生成:

其中β表示二进制数,即1或0,rand表示随机数。如果Δ的值大于或等于0.5,则β的值为0;否则,该值为1。由于参数μ1和μ2选择的随机性,种群变得更加多样化,并逃离局部最优解,这有助于提高其多样性。与NRBO类似,GBO也受到牛顿方法的启发。因此,NRBO概念看起来可能与GBO相似,但由于NRBO的独特特性,其性能仍远优于GBO。

公式详解

上文原理尽量使大家理解作者设计公式的思路,所以可能公式比较多。为了更加简洁,这边根据作者源代码整理出核心公式,方便大家撰写论文,变量含义可查看上文原理介绍~

(1)种群初始化:

![]()

(2)Newton-Raphson搜索规则:

NRSR是基于Newton-Raphson方法的概念提出的,该概念是为了促进勘探趋势和加速收敛。

(3)陷阱避免算子(TAO):

提高NRBO处理实际问题的有效性,避免局部最优。

算法流程图与伪代码

为了使大家更好的理解,这边给出作者的流程图和伪代码,非常清晰!

如果实在看不懂,不用担心,可以看下代码,再结合上文公式理解就一目了然了!

性能测评

原文作者使用64个基准数值函数对NRBO的性能进行了评估,其中包括23个标准测试函数,29个CEC2017约束基准和12个CEC2022基准。

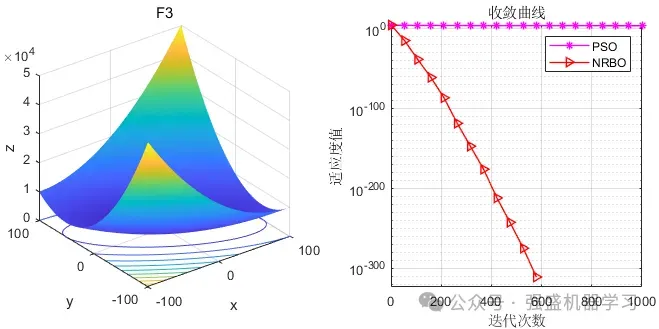

这边为了方便大家对比与理解,采用23个标准测试函数,并与非常经典的粒子群算法进行比较,这边展示5个测试函数的图~

可以看到,NRBO的效果还是非常不错的!性能优越,收敛速度也非常快,可以较好的应用到各类实际问题应用中~

参考文献

[1]Sowmya R, Premkumar M, Jangir P. Newton-Raphson-based optimizer: A new population-based metaheuristic algorithm for continuous optimization problems[J]. Engineering Applications of Artificial Intelligence, 2024, 128: 107532.

完整代码

如果需要免费获得图中的完整测试代码,只需点击下方小卡片,后台回复关键字,不区分大小写:

NRBO

也可点击小卡片,后台回复个人需求定制NRBO优化模型(看到秒回):

1.回归/时序/分类预测类:SVM、LSSVM、ELM、KELM、HKELM、DELM、RELM、DHKELM、RF、LSTM、BiLSTM、GRU、BiGRU、PNN、CNN、BP、XGBoost、TCN、ESN等等均可~

2.组合预测类:CNN-SVM、CNN-LSTM/BiLSTM/GRU/BiGRU-Attention、Adaboost类、DBN-SVM等均可~

3.分解类:EMD、EEMD、VMD、REMD、FEEMD、CEEMDAN、ICEEMDAN、SVMD等分解模型均可~

4.其他:机器人路径规划、无人机三维路径规划、DBSCAN聚类、VRPTW路径优化、微电网优化、无线传感器覆盖优化、故障诊断等等均可~

5.原创改进优化算法(适合需要创新的同学):2024年的NRBO、CPO、SO、WOA等任意优化算法均可,保证测试函数效果!

更多代码链接:

版权声明:本文为博主作者:强盛机器学习原创文章,版权归属原作者,如果侵权,请联系我们删除!

原文链接:https://blog.csdn.net/QSJIQIXUEXI/article/details/135919485