扔掉anchor!真正的CenterNet——Objects as Points论文解读

简单讲一下,目标检测中,存在两种anchor机制哦,一种是anchor-base,典型就是Faster RCNN中先验框以及YOLO2-5系列,另一种是anchor-free,典型的是YOLOv1,YOLOX以及本博客所讲的CenterNet,但是论文原名不是CenterNet,原因是被别人使用了,所以作者起名叫Object as Point。anchor-base和anchor-free最大的区别是区别是否有先验框。

论文下载链接:https://arxiv.org/abs/1904.07850

提:那CenterNet相比于之前的one-stage和two-stage的目标检测有什么特点?

- CenterNet的“anchor”仅仅会出现在当前目标的位置处而不是整张图上撒网,所以也没有所谓的box overlap大于多少多少的算positive anchor这一说,也不需要区分这个anchor是物体还是背景 – 因为每个目标只对应一个“anchor”,这个anchor是从heatmap中提取出来的,所以不需要NMS再进行来筛选

- CenterNet的输出分辨率的下采样因子是4,比起其他的目标检测框架算是比较小的(Mask-Rcnn最小为16、SSD为最小为16)。

总体来说,CenterNet结构优雅简单,直接检测目标的中心点和大小,是真anchor-free。

使用网络

论文中CenterNet提到了三种用于目标检测的网络,这三种网络都是编码解码(encoder-decoder)的结构:

- Resnet-18 with up-convolutional layers : 28.1% coco and 142 FPS

- DLA-34 : 37.4% COCOAP and 52 FPS

- Hourglass-104 : 45.1% COCOAP and 1.4 FPS

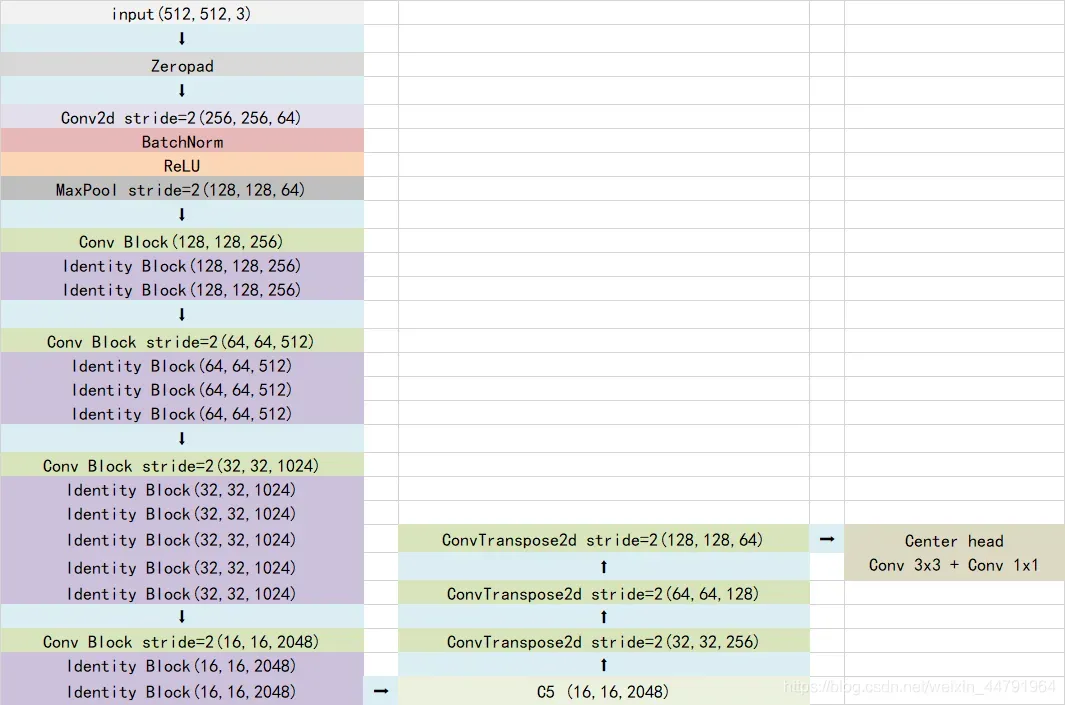

每个提取网络(encode)内部的结构不同,但是在模型的最后都是通过三次上采样加了三个网络构造来输出预测值,默认是80个类、2个预测的中心点坐标、2个中心点的偏置。

类别是通过热图确定的

下图给个列子(resnet提取特征),通过三次上采样,再分成三个预测结果(图片来源)

说到这里,我有一个疯狂的想法,可能已经有人实现了,不用调整中心点的位置,直接输出预测框相对于中心点的相对位置。

目标检测

确定中心点位置的热图

首先假设输入图像为,其中

和

分别为图像的宽和高,然后在预测的时候,我们要产生出关键点的热点图(keypoint heatmap):

,其中

为输出对应原图的步长,而

是在目标检测中对应着检测点的数量,如在COCO目标检测任务中,这个

的值为80,代表当前有80个类别。VOC肯定就是20个类别了

插一段官方代码,其中就是self.opt.down_ratio也就是4,代表下采样的因子。

# 其中input_h和input_w为512,而self.opt.down_ratio为4,最终的output_h为128

# self.opt.down_ratio就是上述的R即输出对应原图的步长

output_h = input_h // self.opt.down_ratio

output_w = input_w // self.opt.down_ratio

这样,就是检测到的物体的预测值。对于

,表示对于类别

,在当前

坐标中检测到该类别的物体,

表示在当前坐标点没有

类别的物体。

在整个训练的流程中,CenterNet学习了CornerNet的方法。对于每个标签图(ground truth)中的某一类,我们要将真实关键点(true keypoint)

计算出来用于训练,中心点的计算方式为

,对于下采样后的坐标,我们设为

,其中

是上文中提到的下采样因子4。所以我们最终计算出来的中心点是对应低分辨率的中心点。

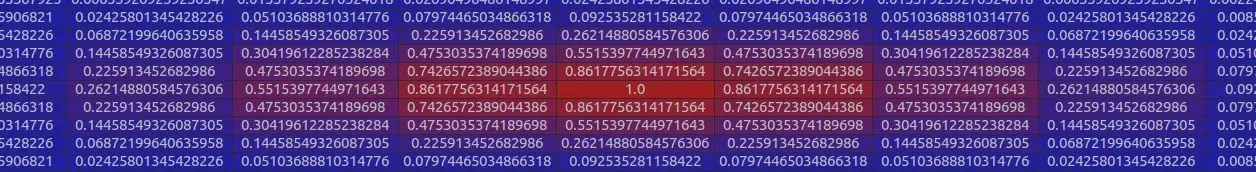

然后我们利用来对图像进行标记,在下采样的[128,128]图像中将ground truth point以

的形式,用一个高斯核

来将关键点分布到特征图上,其中

是一个与目标大小(也就是w和h)相关的标准差。如果某一个类的两个高斯分布发生了重叠,直接取元素间最大的就可以。

这么说可能不是很好理解,那么直接看一个官方源码中生成的一个高斯分布[9,9]:

每个点的范围是0-1,而1则代表这个目标的中心点,也就是我们要预测要学习的点。如果同一个类有多个类别,那么高斯分布就会重叠,选取数值大的保留下来就可以,相信小伙伴们都可以理解。

以上是热图的介绍。

损失函数

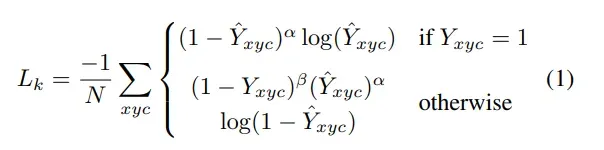

中心点预测损失

重点看一下中心点预测的损失函数,原始论文中因为篇幅关系将第二个otherwise的公式挤一块了:

其中和

是Focal Loss的超参数,

是图像

的的关键点数量,用于将所有的positive focal loss标准化为1。在这篇论文中

和

分别是2和4。这个损失函数是Focal Loss的修改版,适用于CenterNet。

这个损失也比较关键,需要重点说一下。和Focal Loss类似(差别在于),对于easy example的中心点,适当减少其训练比重也就是loss值,当

的时候,

就充当了矫正的作用,假如

接近1的话,说明这个是一个比较容易检测出来的点,那么

就相应比较低了。而当

接近0的时候,说明这个中心点还没有学习到,所以要加大其训练的比重,因此

就会很大,

是超参数,这里取2。

再说下另一种情况,当的时候,这里对实际中心点的其他近邻点的训练比重(loss)也进行了调整,首先可以看到 ,因为当

的时候

的预测值理应是0,如果不为0的且越来越接近1的话,

的值就会变大从而使这个损失的训练比重也加大;而

则对中心点周围的,和中心点靠得越近的点也做出了调整(因为与实际中心点靠的越近的点可能会影响干扰到实际中心点,造成误检测,因为

在上文中已经提到,是一个高斯核生成的中心点,在中心点

,但是在中心点周围扩散

会由1慢慢变小但是并不是直接为0,类似于上图,因此

,与中心点距离越近,

越接近1,这个值越小,相反则越大。那么

和

是怎么协同工作的呢?

简单分为几种情况:

- 对于距离实际中心点近的点,

值接近1,例如

,但是预测出来这个点的值

比较接近1,这个显然是不对的,它应该检测到为0,因此用

惩罚一下,使其LOSS比重加大些;但是因为这个检测到的点距离实际的中心点很近了,检测到的

接近1也情有可原,那么我们就同情一下,用

来安慰下,使其LOSS比重减少些。

- 对于距离实际中心点远的点,

值接近0,例如

,如果预测出来这个点的值

]比较接近1,肯定不对,需要用

惩罚(原理同上),如果预测出来的接近0,那么差不多了,拿

来安慰下,使其损失比重小一点;至于

的话,因为此时预测距离中心点较远的点,所以这一项使距离中心点越远的点的损失比重占的越大,而越近的点损失比重则越小,这相当于弱化了实际中心点周围的其他负样本的损失比重,相当于处理正负样本的不平衡了。

- 如果结合上面两种情况,那就是:

和

来限制easy example导致的gradient被easy example dominant的问题,而 则用来处理正负样本的不平衡问题(因为每一个物体只有一个实际中心点,其余的都是负样本,但是负样本相较于一个中心点显得有很多)。

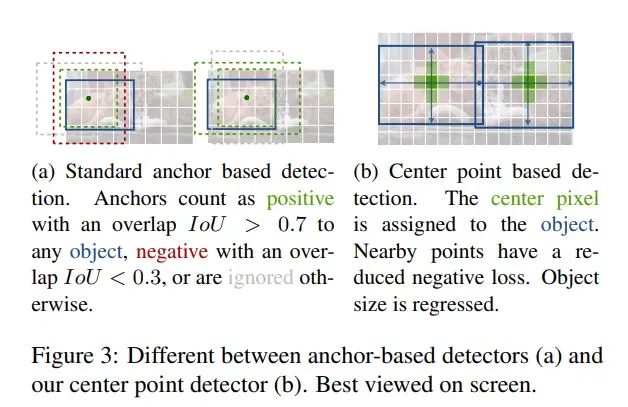

另外看一下官方的这张图可能有助于理解:传统的基于anchor的检测方法,通常选择与标记框IoU大于0.7的作为positive,相反,IoU小于0.3的则标记为negative,如下图a。这样设定好box之后,在训练过程中使positive和negative的box比例为1:3来减少negative box的比例(例如SSD没有使用focal loss)。

而在CenterNet中,每个中心点对应一个目标的位置,不需要进行overlap的判断。那么怎么去减少negative center pointer的比例呢?CenterNet是采用Focal Loss的思想,在实际训练中,中心点的周围其他点(negative center pointer)的损失则是经过衰减后的损失(上文提到的),而目标的长和宽是经过对应当前中心点的w和h回归得到的:

目标中心的偏差损失

因为上文中对图像进行了的下采样,这样的特征图重新映射到原始图像上的时候会带来精度误差,因此对于每一个中心点,额外采用了一个

:

去补偿它。所有类

的中心点共享同一个offset prediction,这个偏置值(offset)用L1 loss来训练:

上述公式直接看可能不是特别容易懂,其实是原始图像经过下采样得到的,对于[512,512]的图像如果

的话那么下采样后就是[128,128]的图像,下采样之后对标签图像用高斯分布来在图像上撒热点,怎么撒呢?首先将box坐标也转化为与[128,128]大小图像匹配的形式,但是因为我们原始的annotation是浮点数的形式(COCO数据集),使用转化后的box计算出来的中心点也是浮点型的,假设计算出来的中心点是[98.97667,2.3566666]。

但是在推断过程中,我们首先读入图像[640,320],然后变形成[512,512],然后下采样4倍成[128,128]。最终预测使用的图像大小是[128,128],而每个预测出来的热点中心(headmap center),假设我们预测出与实际标记的中心点[98.97667,2.3566666]对应的点是[98,2],坐标是,对应的类别是

,等同于这个点上

,有物体存在,但是我们标记出的点是[98,2],直接映射为[512,512]的形式肯定会有精度损失,为了解决这个就引入了

偏置损失。

在这个公式中,是我们预测的bias,force是在训练过程中预先计算的值。在官方代码中是:

# ct 即 center point reg是偏置回归数组,存放每个中心店的偏置值 k是当前图中第k个目标

reg[k] = ct - ct_int

# 实际例子为

# [98.97667 2.3566666] - [98 2] = [0.97667, 0.3566666]

reg[k]之后与预测出来的reg一并放入损失函数中进行计算。注意上述仅仅是对某一个关键点位置来计算的,计算当前这个点的损失值的时候其余点都是被忽略掉的。

此时,我们可以发现这个bias loss是可选的,我们也可以不用,但是准确率会下降一点。

目标大小损失

我们假设为目标

,所属类别为

,它的中心点为

。我们使用关键点预测 KaTeX parse error: Expected ‘}’, got ‘EOF’ at end of input: \hat{Y] 去预测所有的中心点。然后对每个目标

的size进行回归,最终回归到

,这个值是在训练前提前计算出来的,是进行了下采样之后的长宽值。

为了减少回归的难度,这里使用作为预测值,使用L1损失函数,与之前的

损失一样:

整体损失函数是object loss、size loss、bias loss之和,每个loss都有对应的权重。

在论文中,然后

,论文中所使用的backbone都有三个head layer,分别产生[1,80,128,128]、[1,2,128,128]、[1,2,128,128],也就是每个坐标点产生

个数据,分别是类别以及、长宽、以及偏置。

推理阶段

在预测阶段,首先针对一张图像进行下采样,随后对下采样后的图像进行预测,对于每个类在下采样的特征图中预测中心点,然后将输出图中的每个类的热点单独地提取出来。具体怎么提取呢?就是检测当前热点的值是否比周围的八个近邻点(八方位)都大(或者等于),然后取100个这样的点,采用的方式是一个3×3的MaxPool,类似于anchor-based检测中nms的效果。

这里假设是检测点,

代表类中检测到的一个点。每个关键点的位置用整型坐标表示

,然后使用KaTeX parse error: Double subscript at position 16: \hat{Y}_{x_iy_i_̲c}表示当前点的confidence,随后使用坐标来产生标定框:

,其中

是当前点与原图对应的偏移点,

表示当前点对应的目标的预测长度和宽度。

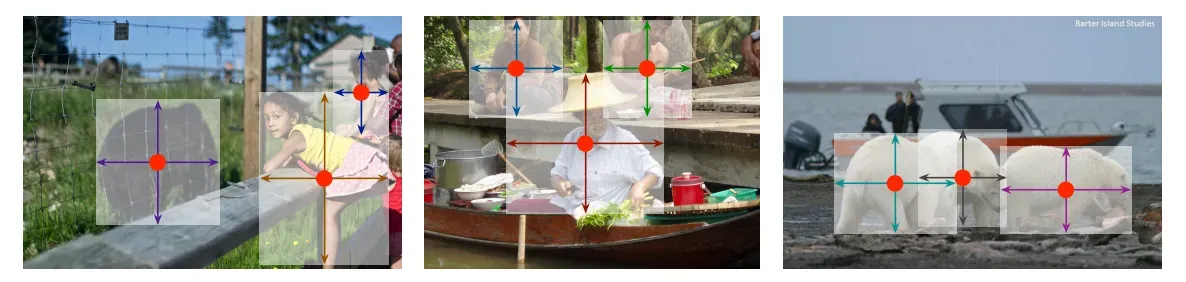

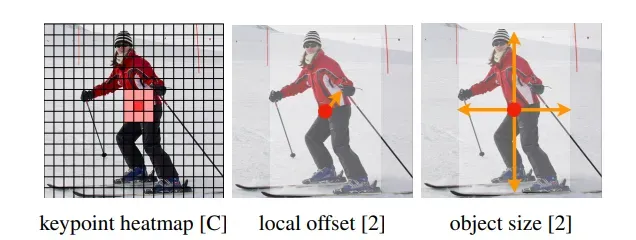

下图为网络模型预测的中心点,中心点偏移量,以及该点对应的目标长宽:

那最终是怎么选择的,最终是根据模型预测出来的值,也就是当前中心点存在物体的概率值,代码中设置的阈值为0.3,也就是从上面选出的100个结果中调出大于该阈值的中心点作为最终的结果。

总结

优势:

- 检测模型原理简单,不仅相比于two-stage简单,对于one-stage也是简单的,简化了边界框的去重,nms操作变为max pool,工作量下降了很多

- 该模型应用广泛,目标检测、3D检测和人体姿态识别

缺点:

- 在实际训练中,如果在图像中,同一个类别中的某些物体的GT中心点,在下采样时会挤到一块,也就是两个物体在GT中的中心点重叠了,CenterNet对于这种情况也是无能为力的,也就是将这两个物体的当成一个物体来训练(因为只有一个中心点)。同理,在预测过程中,如果两个同类的物体在下采样后的中心点也重叠了,那么CenterNet也是只能检测出一个中心点,不过CenterNet对于这种情况的处理要比faster-rcnn强一些的,具体指标可以查看论文相关部分。

- 有一个需要注意的点,CenterNet在训练过程中,如果同一个类的不同物体的高斯分布点互相有重叠,那么则在重叠的范围内选取较大的高斯点。

学习资料参考:https://zhuanlan.zhihu.com/p/66048276

文章出处登录后可见!