Recovering Realistic Texture in Image Super-resolution by Deep Spatial Feature Transform

基于深度空间特征变换的超分辨率图像真实纹理恢复

原文地址:Recovering Realistic Texture in Image Super-resolution by Deep Spatial Feature Transform (cuhk.edu.hk)[0]

1、研究动机

本文目的解决超分任务中对图像的纹理信息恢复的不好的问题。一开始的超分网络使用MSE loss,导致的生成的图像比较模糊和过于光滑的纹理。

改进损失函数,使用Perceptual Loss 和 Adversarial Loss,但是依然存在图像的纹理信息恢复的不好的问题。

如何表达语义类别先验?如何有效地将语义先验整合到网络中?这是本文提出的方法的基础。

从两张低分辨率图像中提取的建筑物和植物斑块看起来非常相似。在没有事先通知的情况下使用对抗性损失和感知损失可能会增加不忠实于基类的细节。使用正确的分类先验可以获得更现实的结果。下面将讨论先验信息。

假如不同列别在低分辨率的RGB值是一样或者相似的,那么在上采样的时就,模型就很难区分当前图像的片断属于哪一个列别,从而导致合成的图像的纹理不真实.

论文提出利用先验类别信息来解决虚幻超分辨率纹理的问题,即在超分辨率合成中使用语义图。语义图的生成使用了图像分割网络,也就是上面首先提到的分类。测试知识。

2、SFGAN

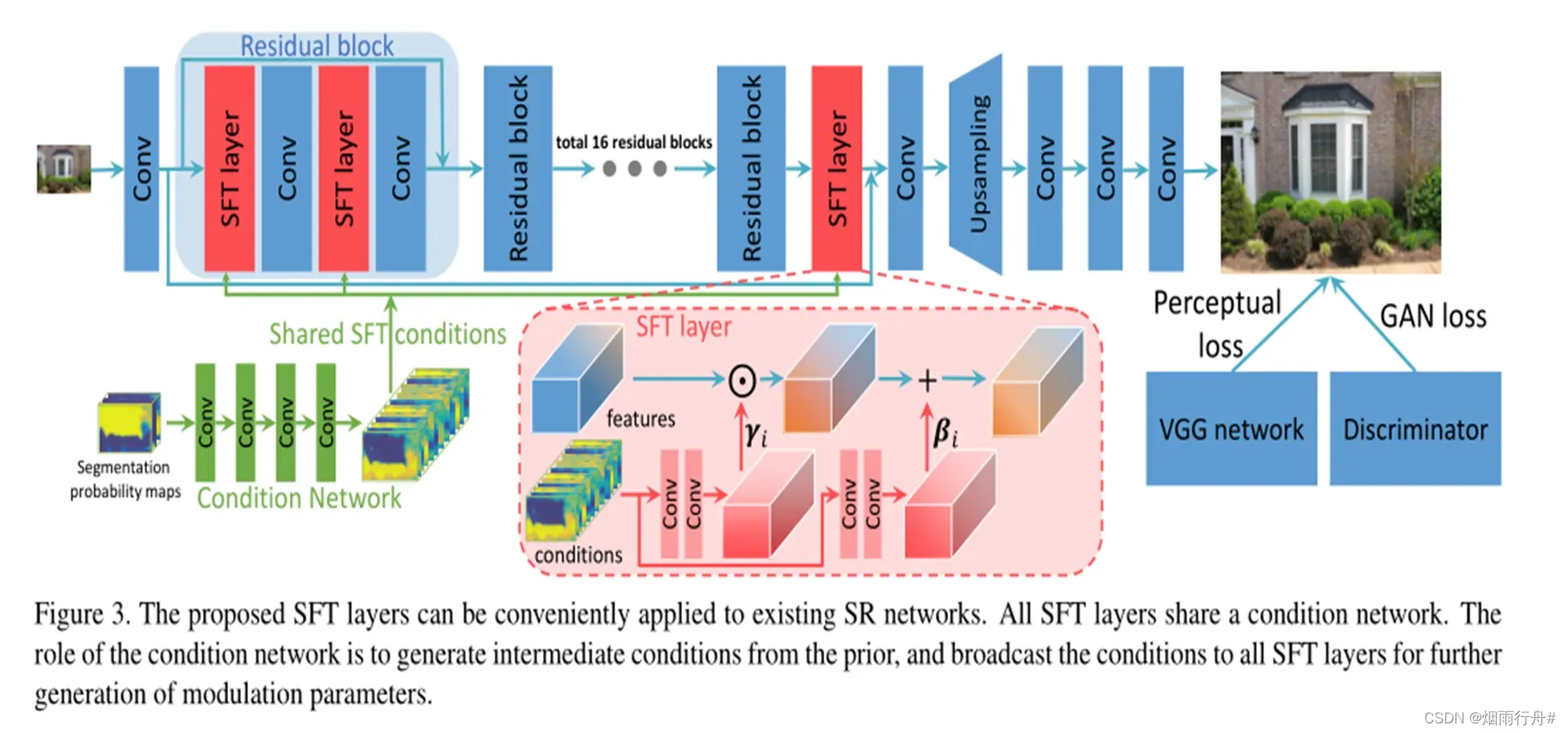

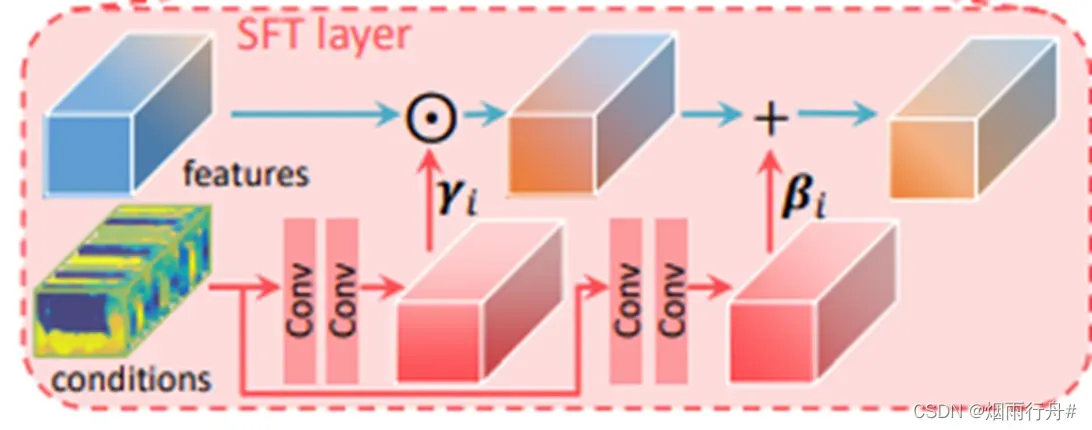

与传统的SRGAN 模型不同之处:相比于BN层的全局统一归一化处理,使用语义分割概率图(segmentation probability maps)做为参考的SFT层对不同物体所在区域进行差异化处理的能力显然更强。

SFT优点:

1、参数效率高。通过变换单个网络的中间特征,只需一次向前传递,就可以重建具有丰富语义区域的HR图像,节约参数。

2、SFT层可以很容易地引入到现有的SR网络结构中。这些层可以使用传统的损耗函数与SR网络一起进行端到端的训练,很容易与先有模型结合

3、它是可扩展的,prior不仅仅可以是语义图,也可以是深度图等等。

Perez等人证明,CN中的仿射变换不需要在归一化后放置。特征可以直接调节。这部电影在视觉推理方面展示了有希望的结果。尽管如此,该公式无法处理具有空间信息的条件(例如,语义分割图),因为电影接受单个语言输入,并为每个特征图输出一个缩放和一个移位参数,与空间位置无关。保存空间信息对于低级任务(例如SR)至关重要,因为这些任务通常需要在图像的不同空间位置进行自适应处理。在SR中使用胶片会导致均匀的空间特征调制,影响SR质量。提议的SFT层解决了这个缺点。它不仅能够转换空间条件进行特征操作,还能够进行空间转换。

语义范畴先验,即知道哪个区域属于天空、水或草,有助于生成更丰富、更真实的纹理。范畴先验ψ可以方便地用语义分割概率图P表示,

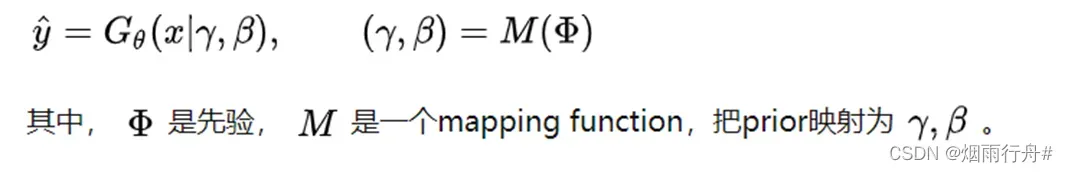

mapping function可以是任意的函数,作者用了一个神经网络,参数随主网络一起训练。作者也用了一个小网络得到conditions,输入是语义图,输出是conditions,这些conditions对于每一层来说是共享的,被广播到所有的SFT层里面。

为什么需要那么多层conditions,当然对于不同的层数,所要考虑的信息不同,比如第一层我们只考虑树的信息,而第五层才需要考虑草的信息。conditions经过两层卷积,得到一个矩阵γi,两层卷积得到一个矩阵β。他是把一个语义的不同概率的图层,进行一定的卷积处理后,得到了一个语义信息的分割概率图,图像特征乘以概率图,就得到了哪里是什么信息,哪里应该恢复哪种细节。

3、目标函数

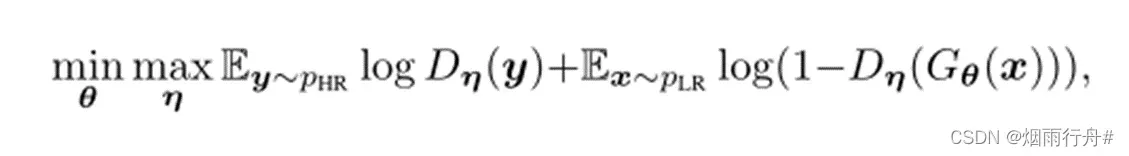

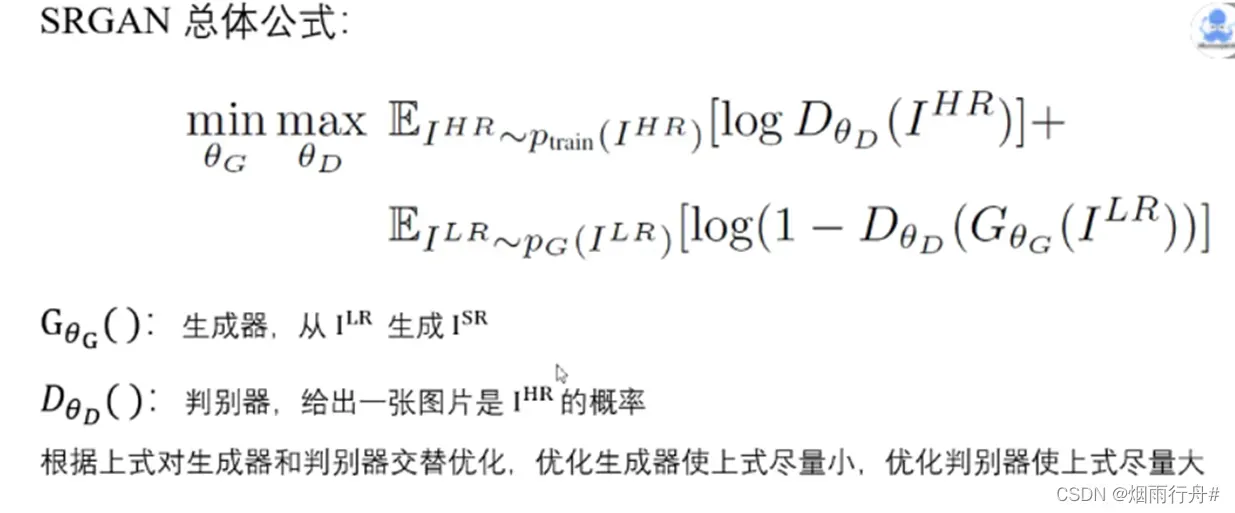

与传统的SRGAN 相同

in:

生成器Gθ

鉴别器Dη

Minimize θ and maximize η.

pHR和pLR分别是HR和LR训练样本的经验分布。

4、损失函数

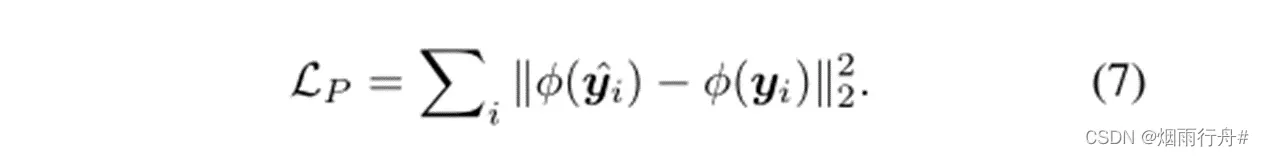

模型中应用感知损失和对抗损失。感知损失度量特征空间中的距离。为了获得特征图,我们使用预先训练的19层VGG网络[40],表示为φ

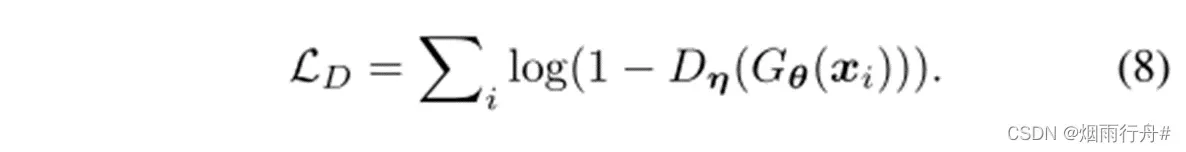

我们使用第五个最大池层之前的第四个卷积获得的特征映射,并计算其特征激活的MSE。来自GAN的对抗性损失LD也被用来鼓励生成器支持多种自然图像中的解决方案。

5、 语义分割结果

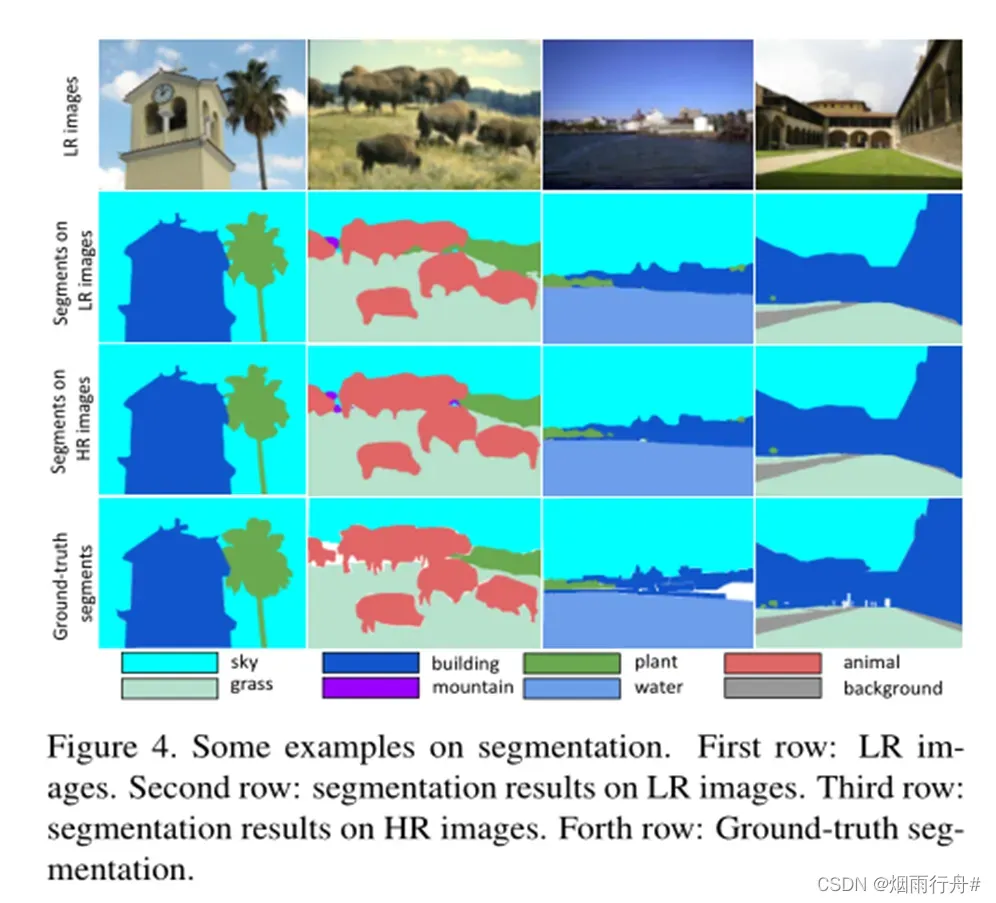

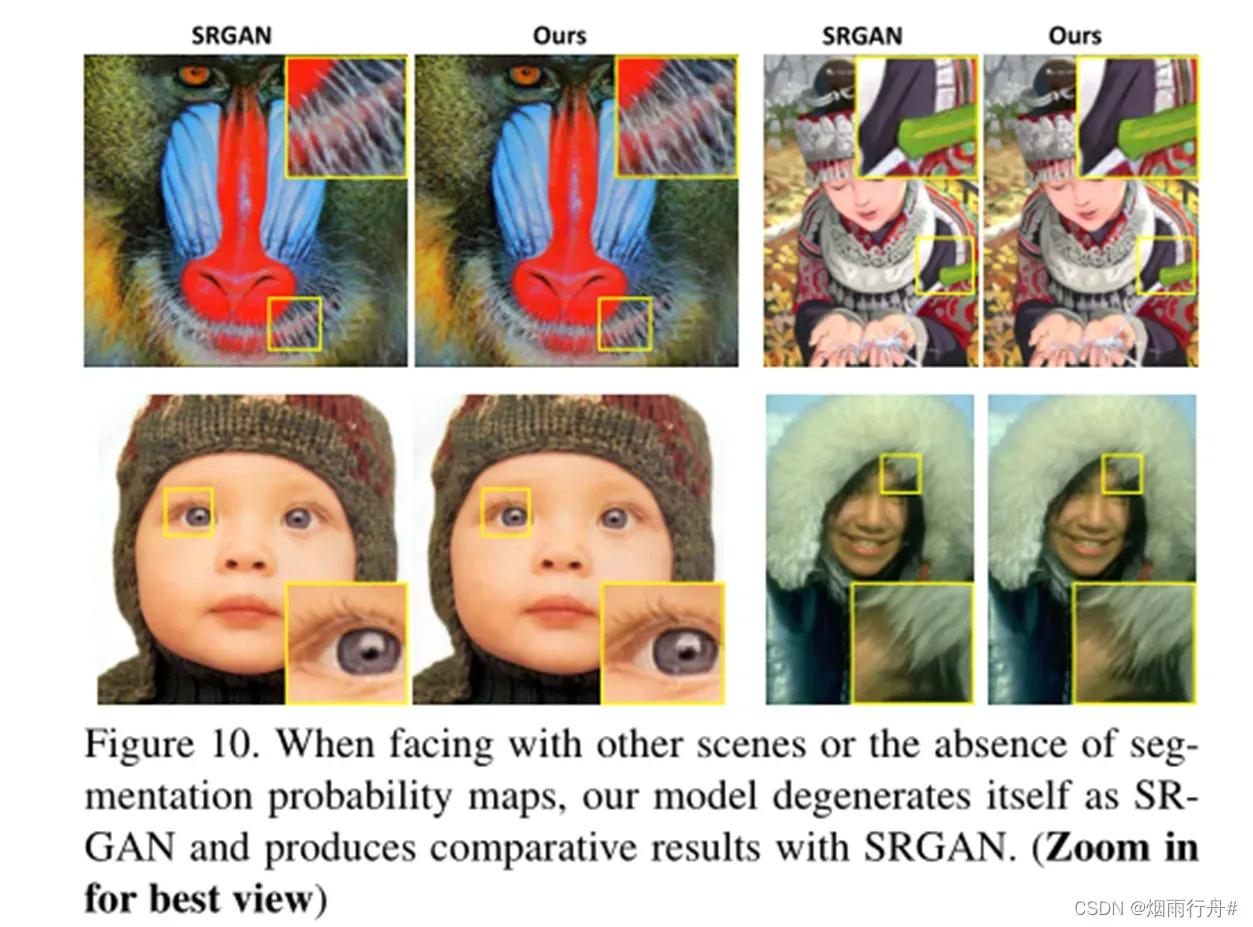

我们研究了从LR图像获得的分割图的准确性。在典型的SR研究中,LR图像从HR图像以×4的比例因子进行下采样。我们发现,在这种分辨率下,即使在基于现代CNN的分割模型[32,31]的LR图像上,仍然可以获得满意的分割结果。一些LR图像和相应的分割结果如图4所示。如图4所示,LR分割接近HR分割。我们还没有尝试过对小对象进行分割,因为这在图像分割领域仍然是一个具有挑战性的问题。在测试期间,不属于预定义的K分段类的类将被归类为“背景”类。在这种情况下,我们的方法仍然会生成一组默认值γ和β,将自身退化为SRGAN,即平等对待所有类。

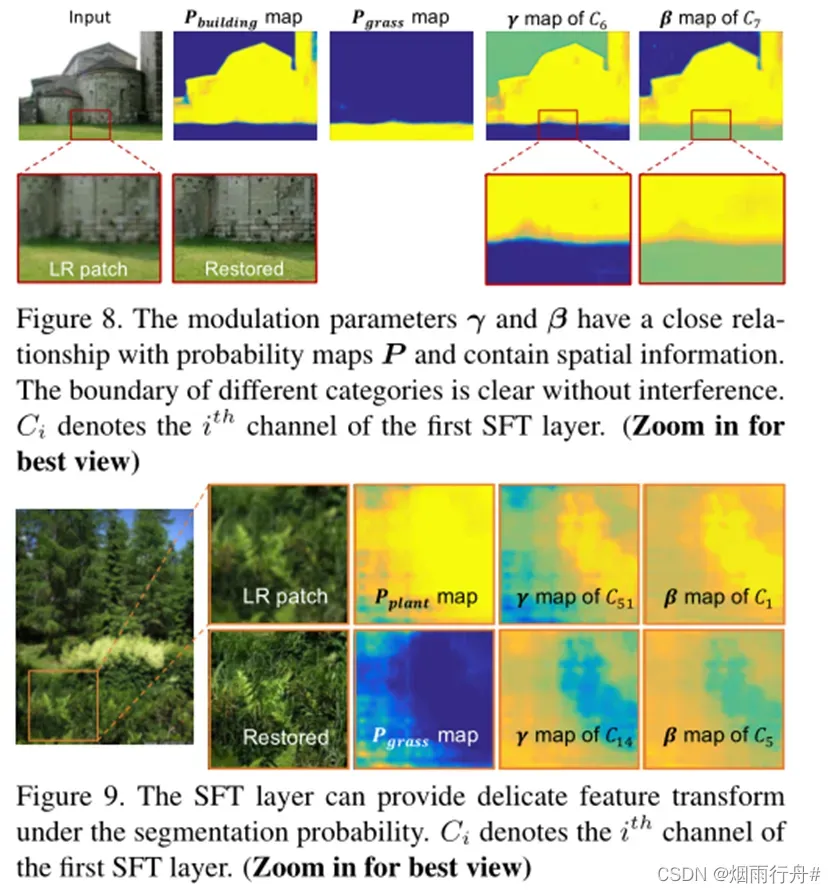

语义分割概率图与特征调制层参数的关系。该图显示了建筑物和草地类别的概率图以及网络中某一层的调制参数的连接。可以看出调制参数与语义分割概率图密切相关,调制参数中不同类别的边界还是比较清晰的。

语义分割概率图与特征调制层参数的关系。该图显示了建筑物和草地类别的概率图以及网络中某一层的调制参数的连接。可以看出调制参数与语义分割概率图密切相关,调制参数中不同类别的边界还是比较清晰的。

实际场景中,物体类别的分隔界限通常并不十分明显,比如图中的植物和草的区域,它们之间的过渡是“无缝”且连续的,而本文中使用的语义分割概率图以及调制层的参数也是连续变化的。因此,SFT-GAN可以更为精细地调制纹理的生成

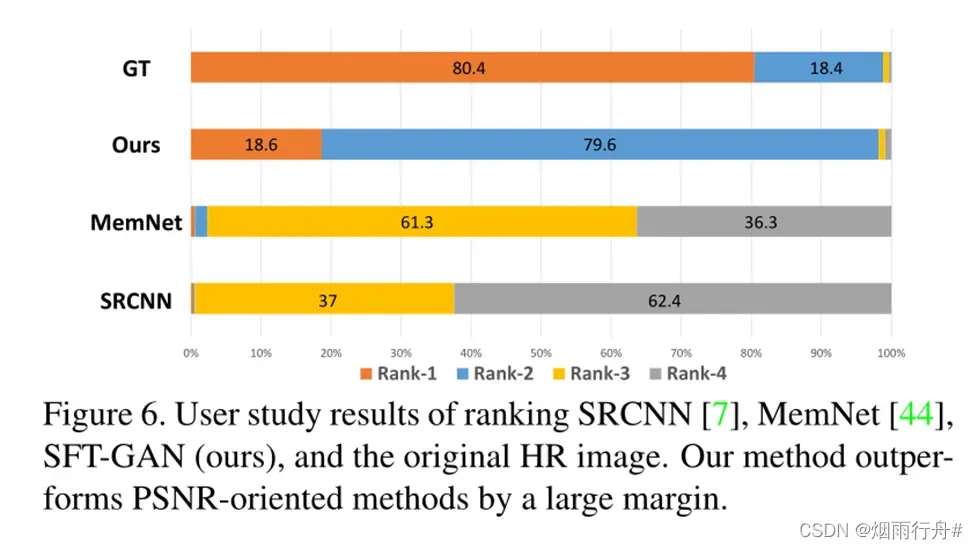

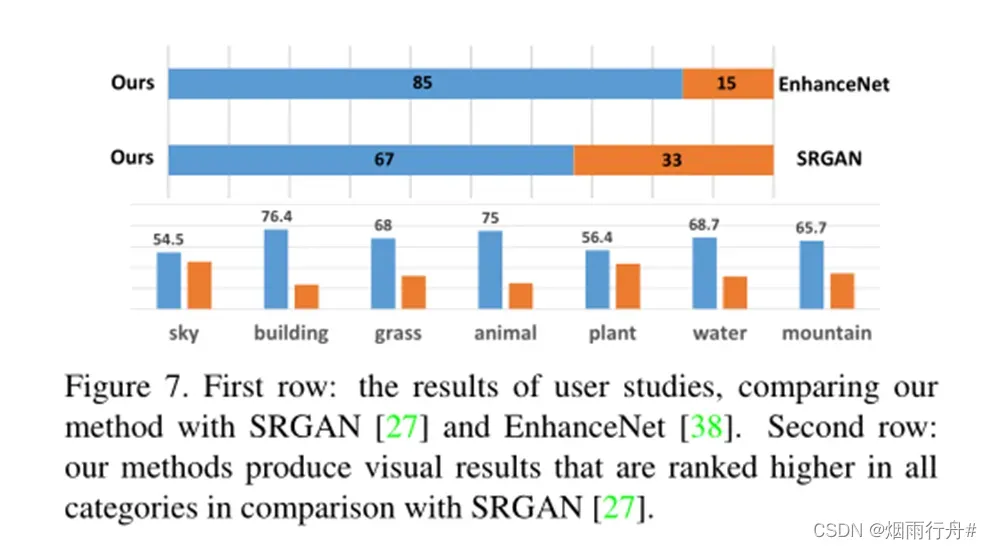

6、User Study

进行了一项用户研究,以量化不同方法重建具有感知说服力的图像的能力。为了更好地将我们的方法与面向PSNR的基线和基于GAN的方法进行比较,我们将评估分为两个阶段。在第一节课中,我们重点讨论了面向PSNR的基线。用户被要求对每幅图像的4个版本进行排名:SRCNN[7]、MemNet[44](最先进的面向峰值信噪比的方法)、我们的SFT-GAN和原始HR图像,根据他们的视觉质量进行排名。我们使用了从户外场景测试中随机选取的30张图片,所有图片都以随机方式呈现。在第二节课中,我们重点介绍了基于GAN的方法,以便用户可以专注于纹理质量。向受试者展示超分辨率图像对(描绘放大的纹理块以便于比较)。每一对都由提议的SFT-GAN和SRGAN或EnhanceNet]生成的对应物的图像组成。用户被要求选择纹理更自然、更逼真的图像。共涉及96张随机选择的图像。我们要求30名用户完成我们的用户研究。第一和第二阶段的结果分别显示在图6和图7中。第一次会议的结果表明,SFT-GAN的性能大大优于面向PSNR的方法。这并不奇怪,因为面向PSNR的方法总是产生模糊的结果,尤其是在纹理区域。我们的方法有时会生成与HR相当的高质量图像,从而在用户中造成混乱。在第二阶段中,我们的方法排名高于SRGAN和EnhanceNet,尤其是在建筑、动物和草地类别中。在天空和植物类别中可以找到类似的性能。

7、消融实验

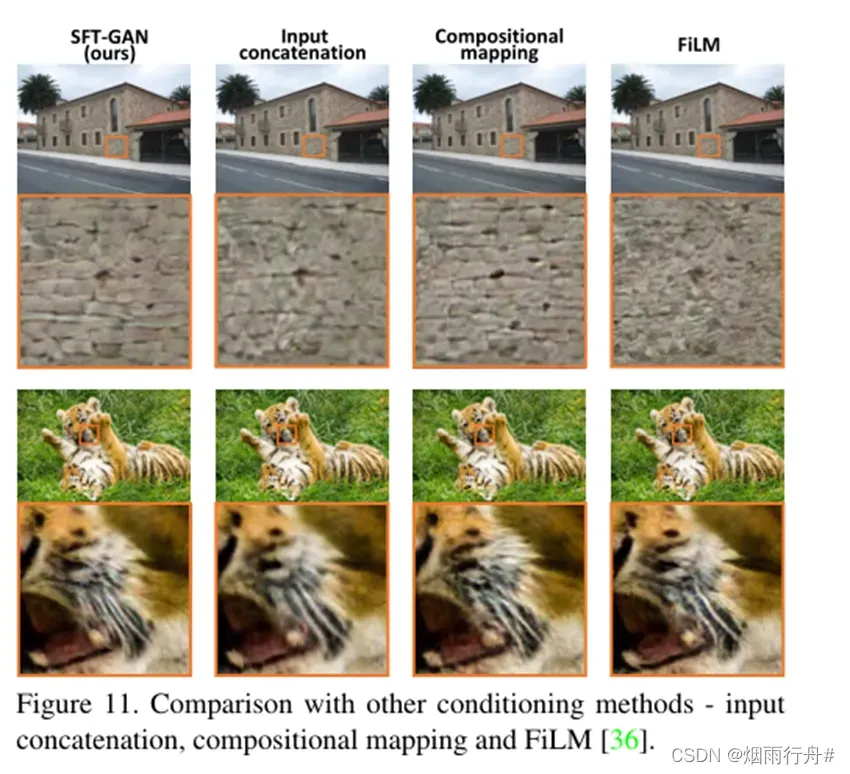

该论文还比较了其他组合先验的方法:

8、总结

本文深入探讨了如何使用语义分割概率图作为语义先验来约束超分辨率的解空间,使生成的图像纹理更符合真实而自然的纹理特性。还提出了一种新颖的空间特征调制层(SFT)来有效地将先验条件结合到现有网络中。空间特征调制层可以和现有的超分辨率网络使用同样的损失函数,端到端地进行训练。测试时,整个网络可以接受任意大小尺寸的图像作为输入,只需要一次前向传播,就能够输出结合语义类别先验的高分辨率图像。实验结果显示,相较于现有超分辨率算法,本文SFT-GAN模型生成的图像具有更加真实自然的纹理。

文章出处登录后可见!