1.TensorBoard详解

TensorBoard是一个可视化的模块,该模块功能强大,可用于深度学习网络模型训练查看模型结构和训练效果(预测结果、网络模型结构图、准确率、loss曲线、学习率、权重分布等),可以帮你更好的了解网络模型,设计TensorBoard调用相关代码,以上结果即可保存,是整合资料、梳理模型的好帮手。

1.1 环境

本设备使用的环境为:

tensorflow-gpu 2.4.0

pytorch1.8.0

cuda 11.0

cudnn 8.0.5

tensorboard 2.7.0

安装TensorBoard,必须要配一个带GPU的虚拟环境,tensorflow-gpu和pytorch的环境选一个就好,配好环境后,下面介绍安装技巧和步骤。

1.2 安装

- 可以在激活的命令行中安装:

conda activate pytorch1.8.0

之后,在命令行中输入:

pip install tensorboard

pip install tensorboardX

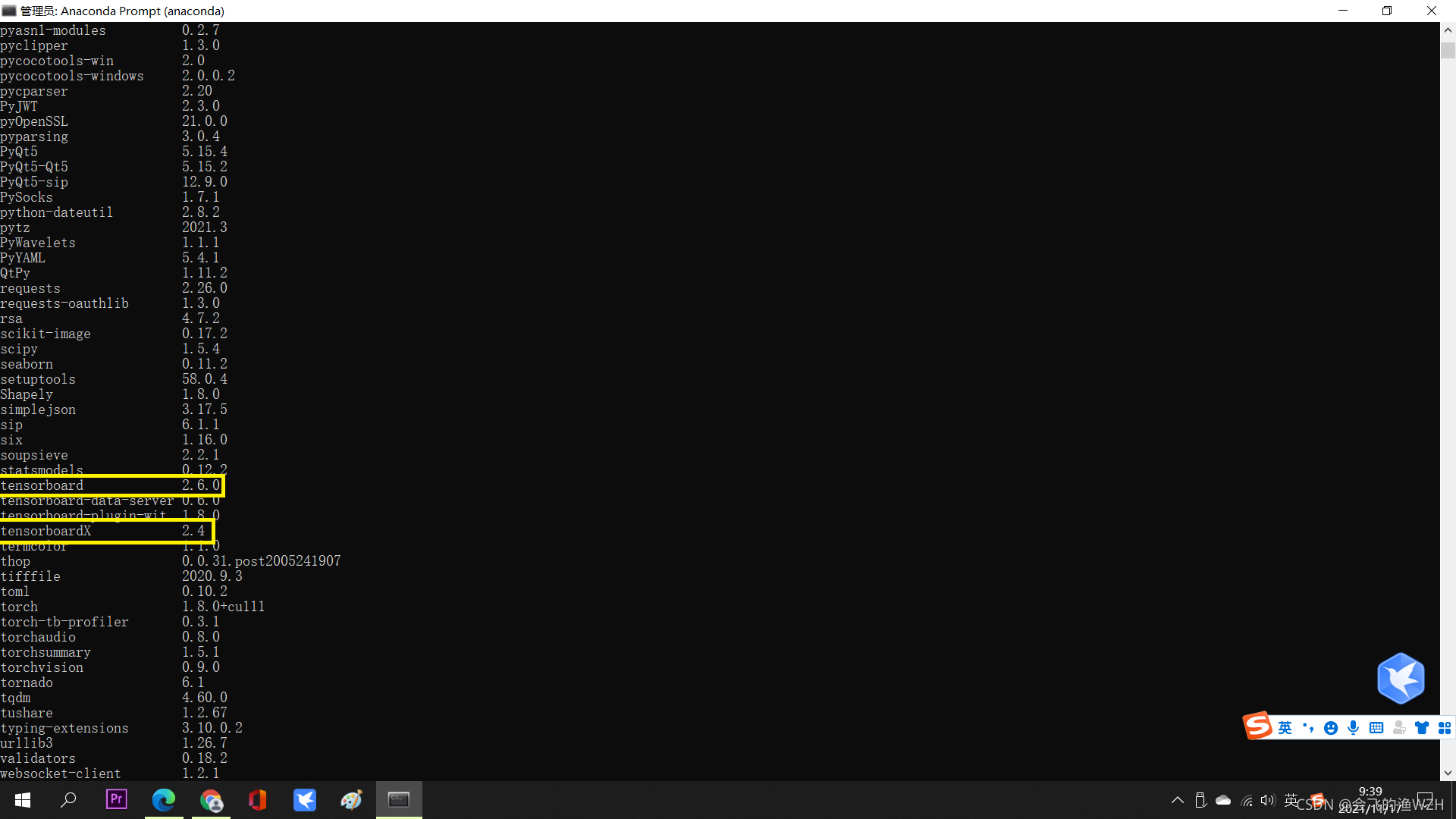

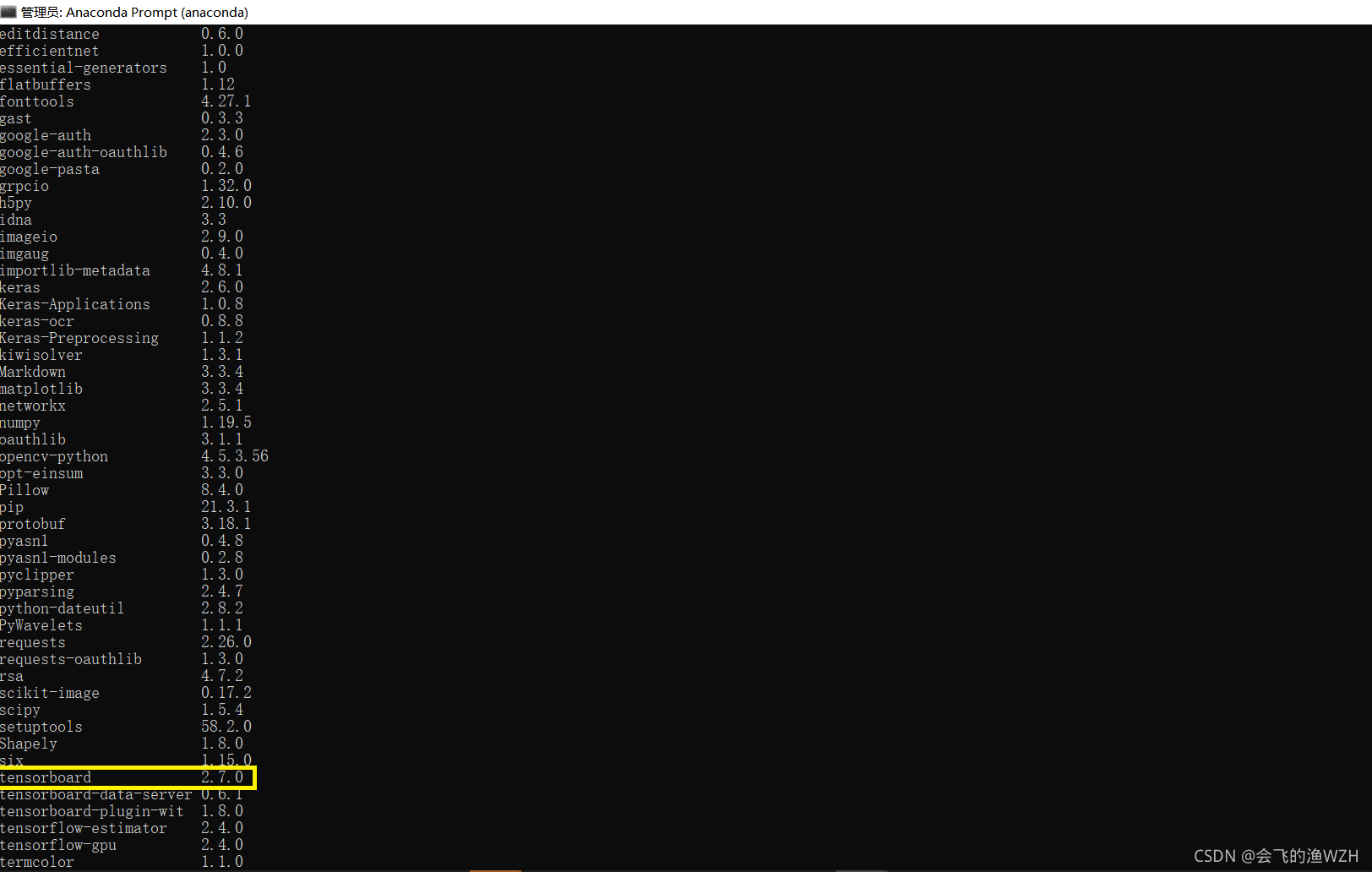

Tensorboard其实是TensorFlow♂ 的一个附加工具,而TensorboardX 这个工具使得 TensorFlow 外的其他神经网络框架也可以使用到 Tensorboard 的便捷功能,如pytorch;安装的版本不用管,会自动安装最近的版本,本设备pytorch环境安装情况如下:

当然,用一些镜像源可以加速下载,下面给出一些好用的镜像源(清华和豆瓣镜像源比较快):

https://pypi.tuna.tsinghua.edu.cn/simple

https://pypi.douban.com/simple

使用方法在pip安装命令行末尾加( -i 镜像网址),pip安装其他模块也适用。

pip install tensorboard -i https://pypi.tuna.tsinghua.edu.cn/simple

- 编译器自动提醒安装,点击确定安装会在编译器终端自动安装;

- 编译器终端命令行安装,该方式在编译器中选择带

GPU的环境后,不虚激活环境,直接pip输入命令行直接安装,方法同上述1。 - 克隆代码安装GitHub,按照

README.md配置并安装,针对GitHub下载部分文件方法以及GitHub加速镜像网站,可参考我的前面博文:

GitHub上只下载部分文件的操作教程

GitHub加速网址及使用教程

注意:其实其他模块安装包,这些方法基本都适用。

1.3 展示

安装完成后,在该虚拟环境中输入:

pip list

可查看是否安装成功,该展示为本设备tensorflow2虚拟环境的安装情况:

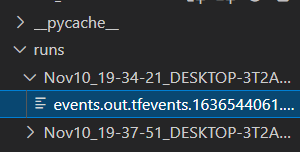

并且下次打开VS code编译器,有“是否使用TensorBoard模块功能”的提示,我们点击“是”,就可以开启TensorBoard的使用,在网络训练结束后将自动生成runs文件夹,里面有后面使用的event file。

1.4说明

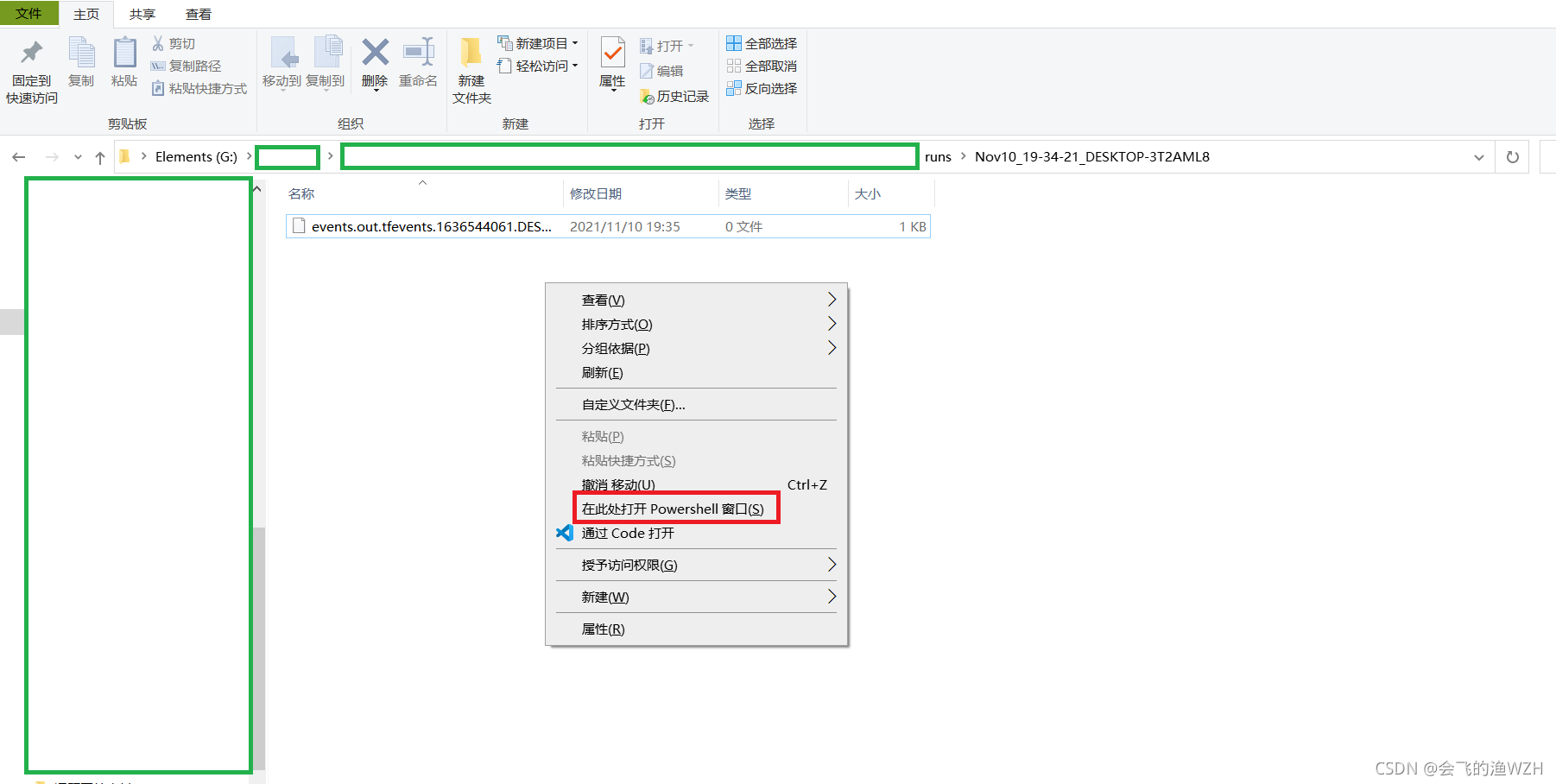

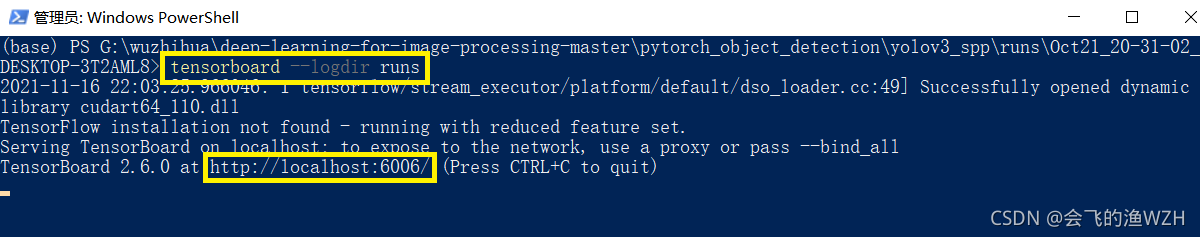

打开event file的方法也可以在该文本文件夹下,按住shift键,并点击右键,鼠标点击“在此处打开powershell窗口(S)”,并输入:

tensorboard –logdir runs

该runs文件夹是TensorBoard调用代码生成的,你也可以在代码中修改为生成logs文件夹等;

点击enter键之后,可以获得TensorBoard可视化结果网址:

http://localhost:6006/

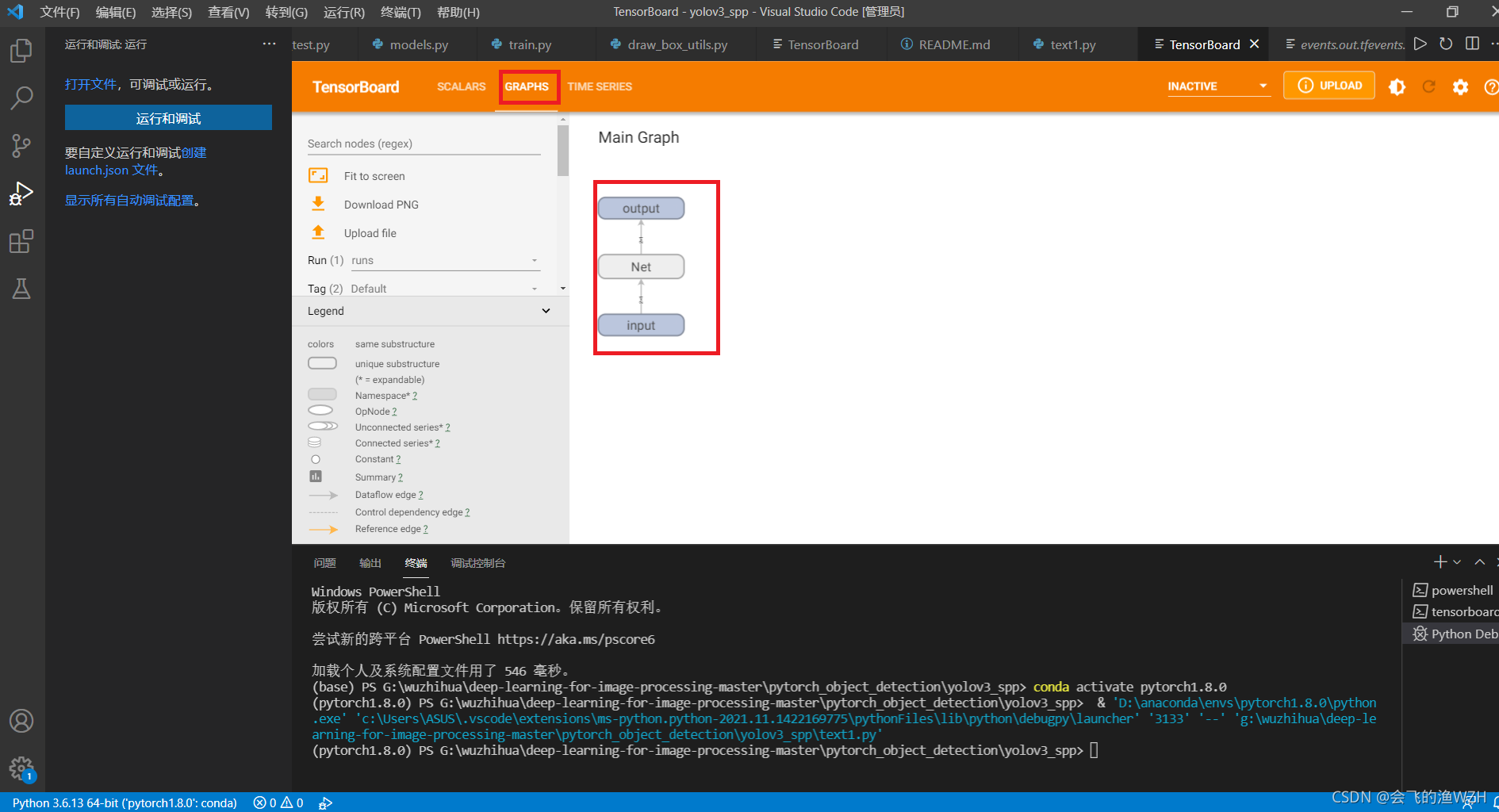

结果如下图:

2.使用

2.1步骤

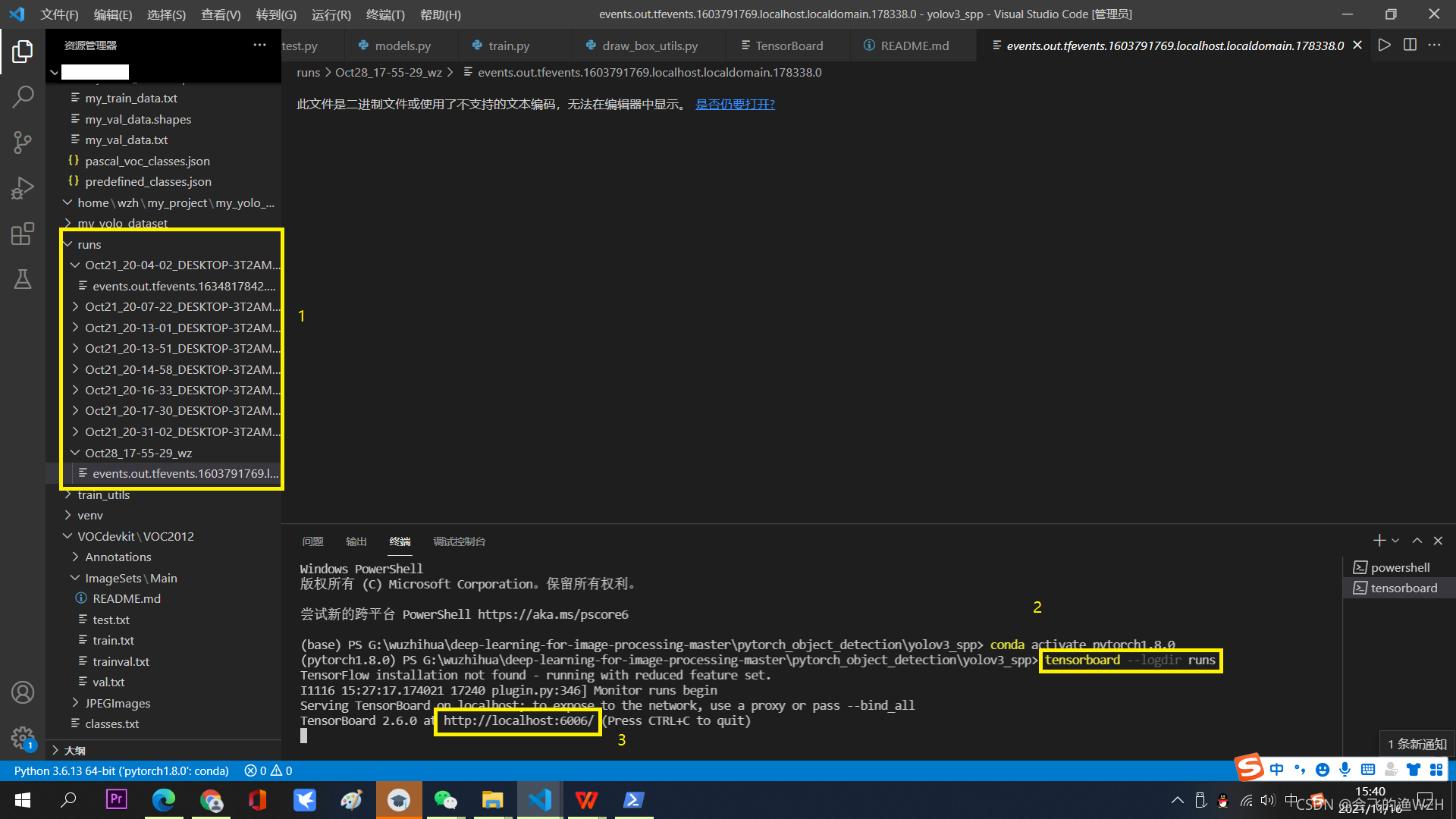

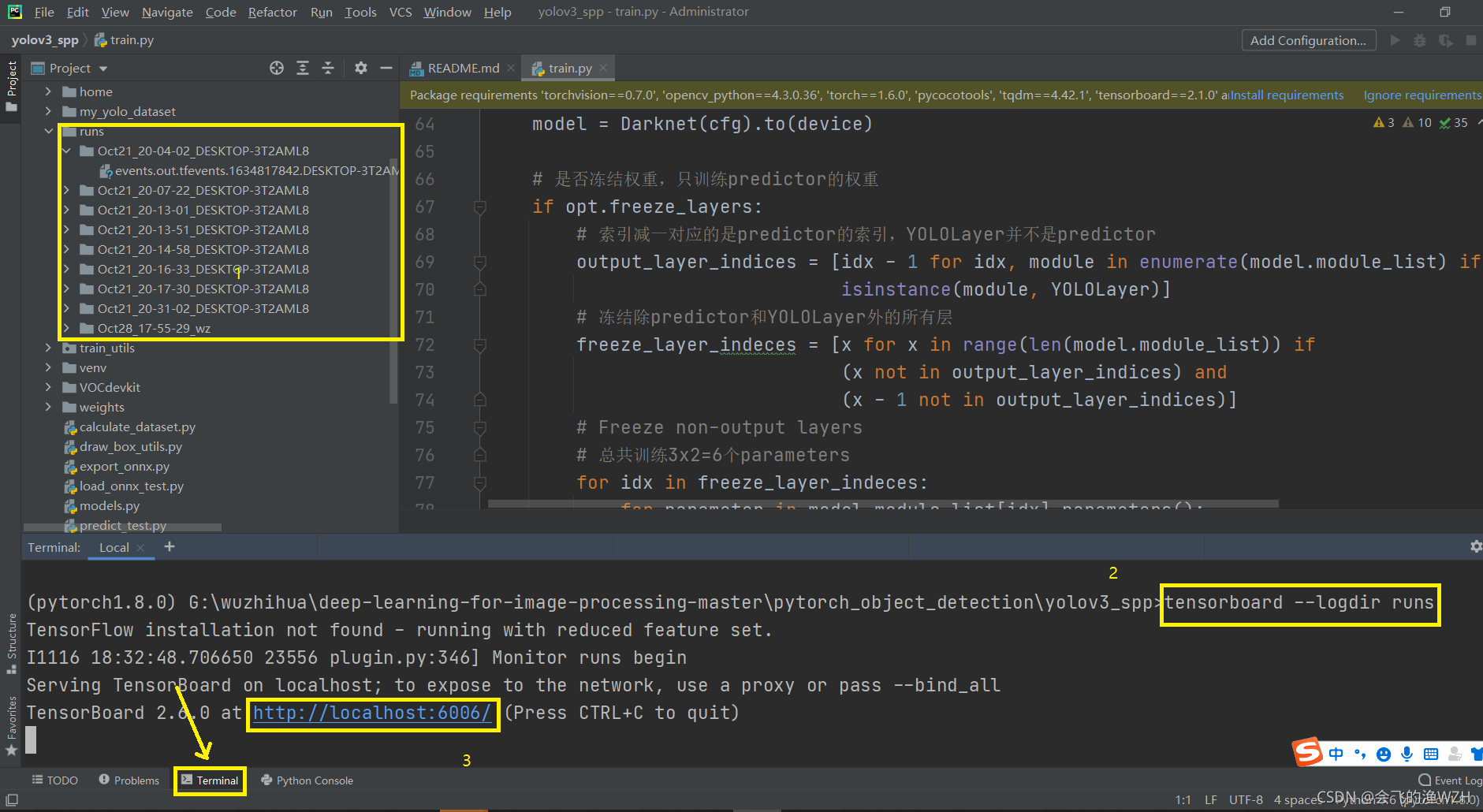

如下面两张图所示,3个黄色框分别对应三个操作步骤:

- 获得代码子文件夹名称为runs里面

events.开头的文本文件(event file),一般在runs的子文件下点开可以看到; - 在编译器(

VS Code、Pycharm)在底部终端输入:tensorboard --logdir runs

- 复制生成的网址,在浏览器打开。

http://localhost:6006/

最后生成TensorBoard可视化界面。

生成event file文本的方法:

- 训练网络自动生成,针对该无法成功的,应该是启动编辑器时没有选用提示显示的使用

tensorboard模块,那我们还有下面两种方法,方法3亲测可用; - 添加

py代码文件保存:

import numpy as np

from torch.utils.tensorboard import SummaryWriter

writer = SummaryWriter(comment='tensorboard_test')

for x in range(50):

writer.add_scalar('y=2x', x * 2, x)

writer.add_scalar('y=pow(2, x)', 2 ** x, x)

writer.add_scalars('data/scalar_group', {"xsinx": x * np.sin(x),

"xcosx": x * np.cos(x),

"arctanx": np.arctan(x)}, x)

writer.close()

- 自行在

tensorboard界面下载,

2.2常用镜像网址

清华:https://pypi.tuna.tsinghua.edu.cn/simple

阿里云:http://mirrors.aliyun.com/pypi/simple/

中国科技大学 https://pypi.mirrors.ustc.edu.cn/simple/

华中理工大学:http://pypi.hustunique.com/

山东理工大学:http://pypi.sdutlinux.org/

豆瓣:http://pypi.douban.com/simple/

3.代码讲解

下面介绍该模块的常用函数和示例代码:

3.1 函数介绍

tensorboard --logdir=路径

该方式为tensorboard文件的生成之后,在命令行调用该文件,获得tensorboard网址(前面已介绍)

tensorboard –logdir=G:\wuzhihua\yolo3-pytorch-master\runs

SummaryWriter()

该函数为创建一个tensorboard文件,调用方式为:

writer = SummaryWriter(log_dir=‘runs’,flush_secs=30)

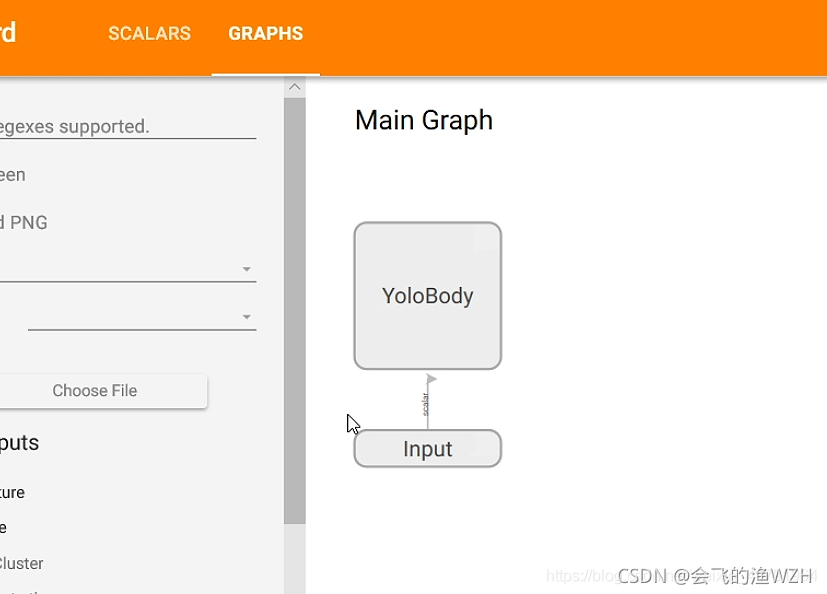

writer.add_graph()

该函数为创建Graphs,Graphs中存放了网络结构,

if Cuda:

graph_inputs = torch.from_numpy(np.random.rand(1,3,input_shape[0],input_shape[1])).type(torch.FloatTensor).cuda()

else:

graph_inputs = torch.from_numpy(np.random.rand(1,3,input_shape[0],input_shape[1])).type(torch.FloatTensor)

writer.add_graph(model, (graph_inputs,))

3.2 示例代码

最后,提供用TensorBoard创建Graph和简单模式并可视化输出显示代码示例:

import torch

from torch.autograd import Variable

import torch.nn.functional as functional

from tensorboardX import SummaryWriter

import matplotlib.pyplot as plt

import numpy as np

# x的shape大小

x = torch.from_numpy(np.linspace(-1, 1, 50).reshape([50, 1])).type(torch.FloatTensor)

# y的shape大小

y = torch.sin(x) + 0.2 * torch.rand(x.size())

class Net(torch.nn.Module):

def __init__(self, n_feature, n_hidden, n_output):

super(Net, self).__init__()

# Applies a linear transformation to the incoming data: :math:y = xA^T + b

# 全连接层,公式为y = xA^T + b

self.hidden = torch.nn.Linear(n_feature, n_hidden)

self.predict = torch.nn.Linear(n_hidden, n_output)

def forward(self, x):

# 隐含层的输出

hidden_layer = functional.relu(self.hidden(x))

output_layer = self.predict(hidden_layer)

return output_layer

# 类的建立

net = Net(n_feature=1, n_hidden=10, n_output=1)

writer = SummaryWriter('runs')

graph_inputs = torch.from_numpy(np.random.rand(2, 1)).type(torch.FloatTensor)

writer.add_graph(net, (graph_inputs,))

# torch.optim是优化器模块

optimizer = torch.optim.Adam(net.parameters(), lr=1e-3)

# 均方差loss

loss_func = torch.nn.MSELoss()

for t in range(2000):

prediction = net(x)

loss = loss_func(prediction, y)

# 反向传递步骤

# 1、初始化梯度

optimizer.zero_grad()

# 2、计算梯度

loss.backward()

# 3、进行optimizer优化

optimizer.step()

writer.add_scalar('loss', loss, t)

writer.close()

结果展示:

注意:界面里面还能修改画图曲线的颜色,要保存结果修改相关代码即可。

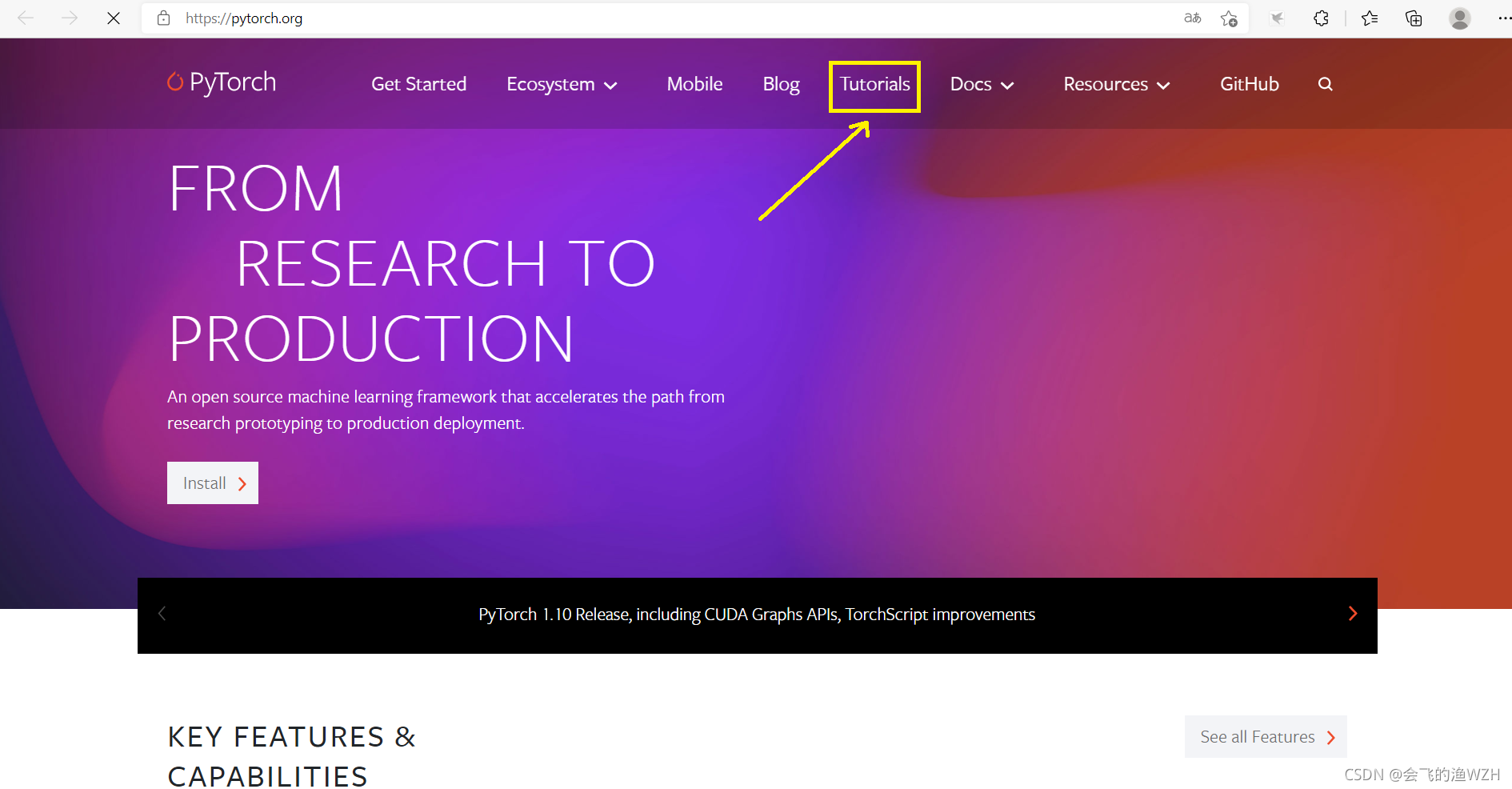

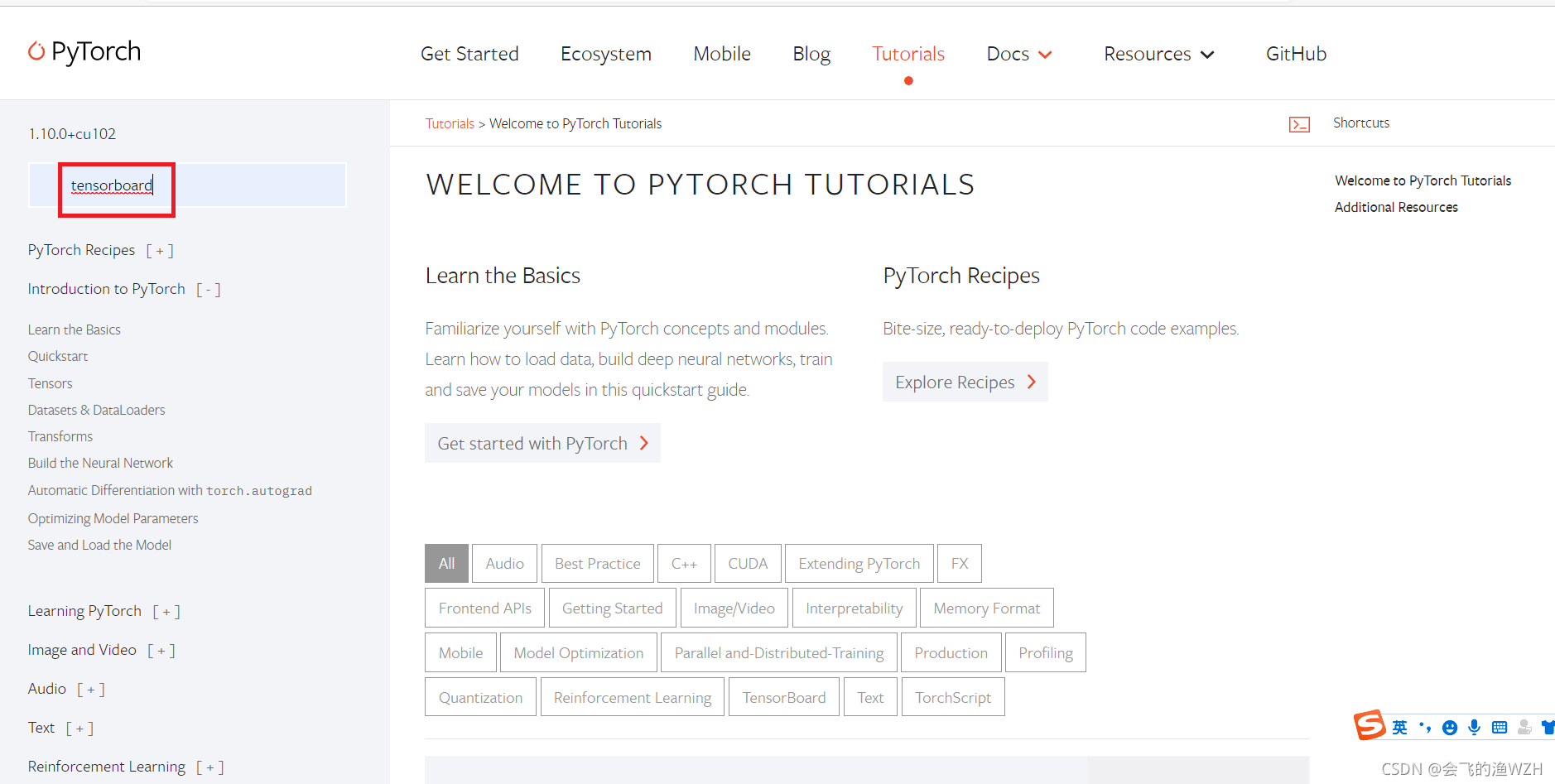

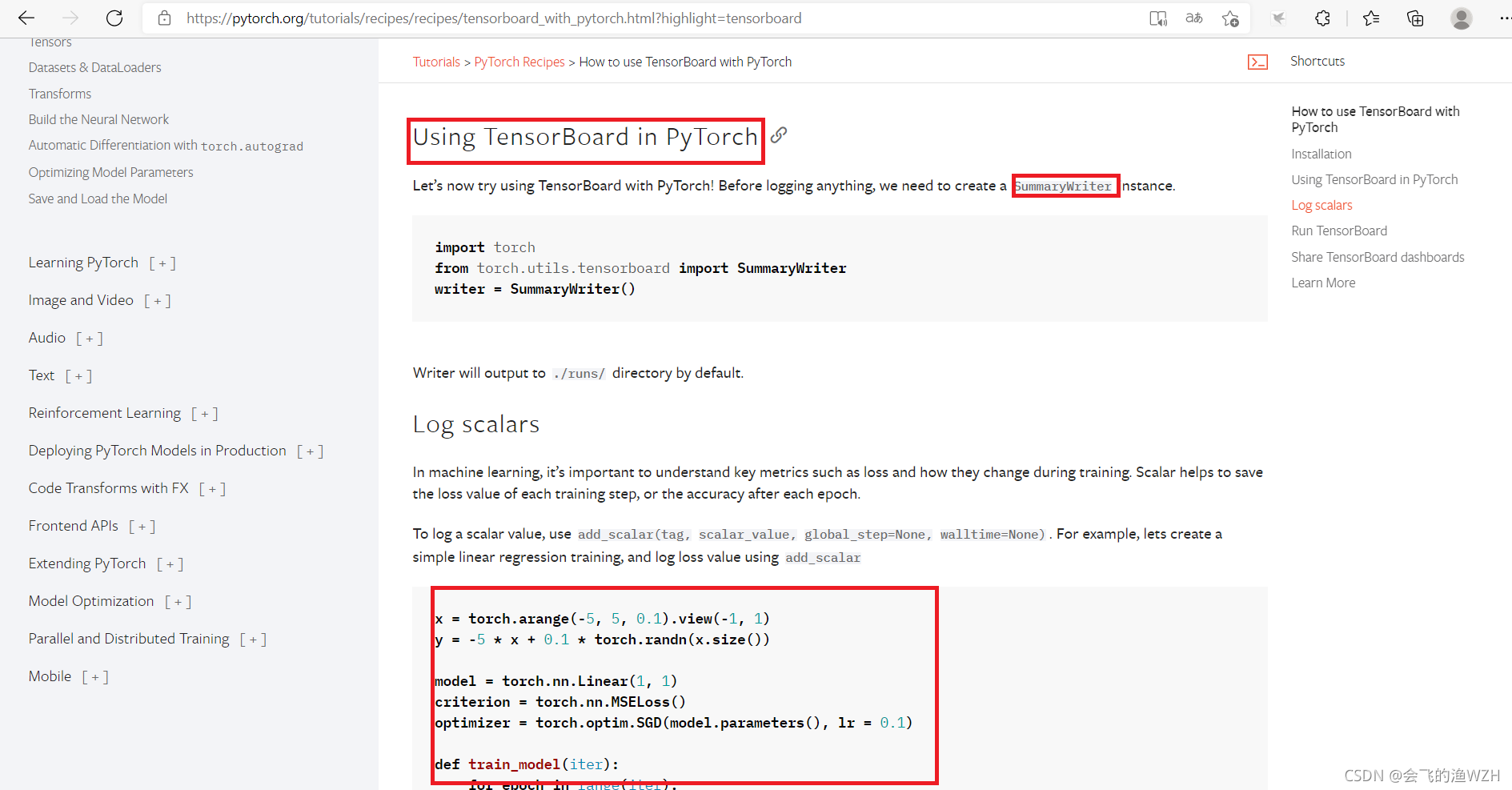

TensorBoard`的介绍到此结束,要去PyTorch♀官方查看使用源码的小伙伴可以从以下进入学习:

https://pytorch.org/

https://pytorch.org/tutorials/recipes/recipes/tensorboard_with_pytorch.html?highlight=tensorboard

参考博主:

https://blog.csdn.net/weixin_44791964/article/details/106701052

参考园主:

https://www.cnblogs.com/coderpeng/p/14180579.html

本文作者:会飞的渔WZH

本文链接:https://blog.csdn.net/wuzhihuaw/article/details/121357355

版权声明:本作品采用知识共享署名-非商业性使用-禁止演绎 2.5 中国大陆许可协议进行许可。

如需转载请注明出处。

各位老板给个关注给个赞赞🤞🤞🤞🤞

文章出处登录后可见!