🏆今日学习目标:

🍀ChatGPT

✅创作者:林在闪闪发光

⏰预计时间:30分钟

🎉个人主页:林在闪闪发光的个人主页

🍁林在闪闪发光的个人社区,欢迎你的加入: 林在闪闪发光的社区

ChatGPT官方说明:

Optimizing Language Models for Dialogue

We’ve trained a model called ChatGPT which interacts in a conversational way.

The dialogue format makes it possible for ChatGPT to answer followup questions, admit its mistakes, challenge incorrect premises, and reject inappropriate requests.

这一模型可以与人类进行谈话般的交互,可以回答追问,连续性的问题,承认其回答中的错误,指出人类提问时的不正确前提,拒绝回答不适当的问题。

ChatGPT is a sibling model to InstructGPT, which is trained to follow an instruction in a prompt and provide a detailed response.

ChatGPT 是 OpenAI 之前发布的 InstructGPT 的近似产物,后者致力于通过命令提示词生成一个细致的回复。

1.序言

预告了一整年的GPT-4迟迟没来,人们猜想OpenAI是不是要跳票了,更何况他们之前的得意之作DALL-E也被开源Stable Diffusion打了个措手不及,再不来点深水炸弹业界地位危矣。

不过,就在大家以为今年OpenAI将以沉寂收场时,聊天机器人模型ChatGPT横空出世,让人们看到了AI的更大创造力,聚光灯也再度打到了OpenAI的身上。

今年9月,LinkedIn联合创始人Reid Hoffman与OpenAI首席执行官Sam Altman进行了一场对话,而肩负着宏伟使命且极富远见的Altman就曾预言:AI即将迎来下一个发展阶段。如今,大型语言模型越来越先进,也出现了可以实现文本-图像相互转换的多模态模型,一些AI应用还可令科学家如虎添翼。在他眼中,AI是一个可以孵化出无数工具,推动各行各业前进的基础平台。

随着AI行业的不断进步,AI应用不再只是充斥着行业热词的纸上项目,已经发展为成熟的工具,助力多个行业的生产服务,也必将催生出无数新企业。

各种AI工具已显现出巨大的日常应用潜力,可以实现人类的各种想法,改善人类的工作方式,比如由Stability.ai发布的开源Stable Diffusion模型,Microsoft和OpenAI联合打造的AI编程工具Copilot,OpenAI开发的语言生成模型GPT-3和图像生成平台DALL-E以及爆火的聊天机器人模型ChatGPT。

你的愿望就是我的命令

上周,OpenAI 研究实验室推出了 ChatGPT,这是一个能在你的浏览器中运行的聊天机器人,类似于你在提供客户支持聊天的网站上看到的机器人。

ChatGPT 由 GPT-3.5 系列模型提供支持,这些模型使用 Azure AI 超级计算基础设施上的文本和代码数据进行训练。人工智能的能力已经得到提升,可以处理奇怪的、技术性的、抽象的或具体的请求。

通过将其高级聊天机器人置于公共预览版中,OpenAI 希望通过了解所有用户对 ChatGPT 的要求以及该技术的性能来获得众包反馈。

需要注意的一个关键点是当前预览未连接到互联网,因此它返回的任何响应都纯粹来自离线训练的模型。ChatGPT 无法告诉你,例如,“Microsoft 当前的电话号码是多少?”或今天的天气

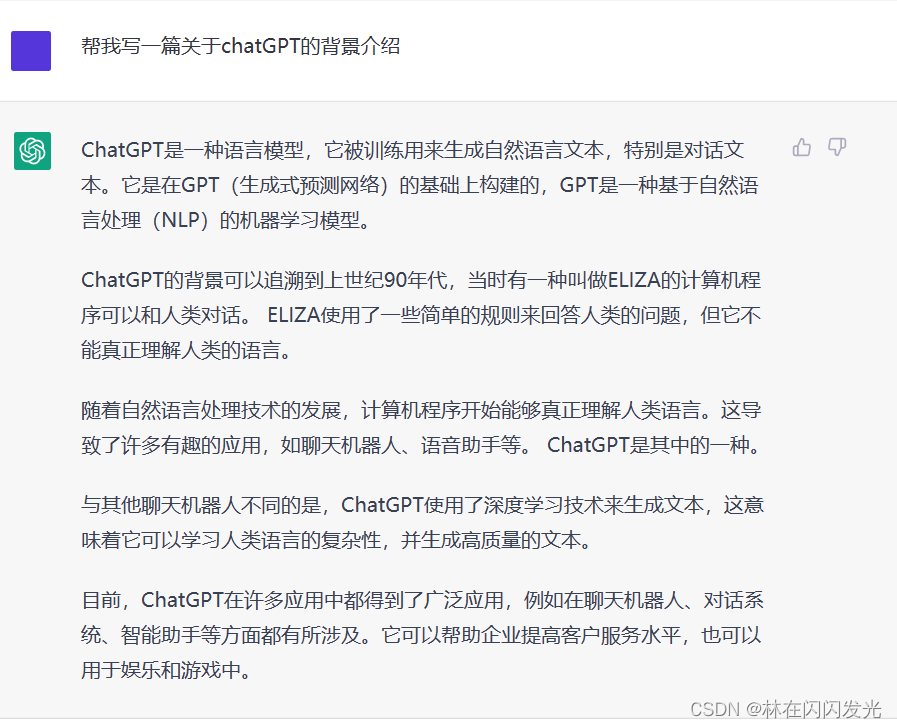

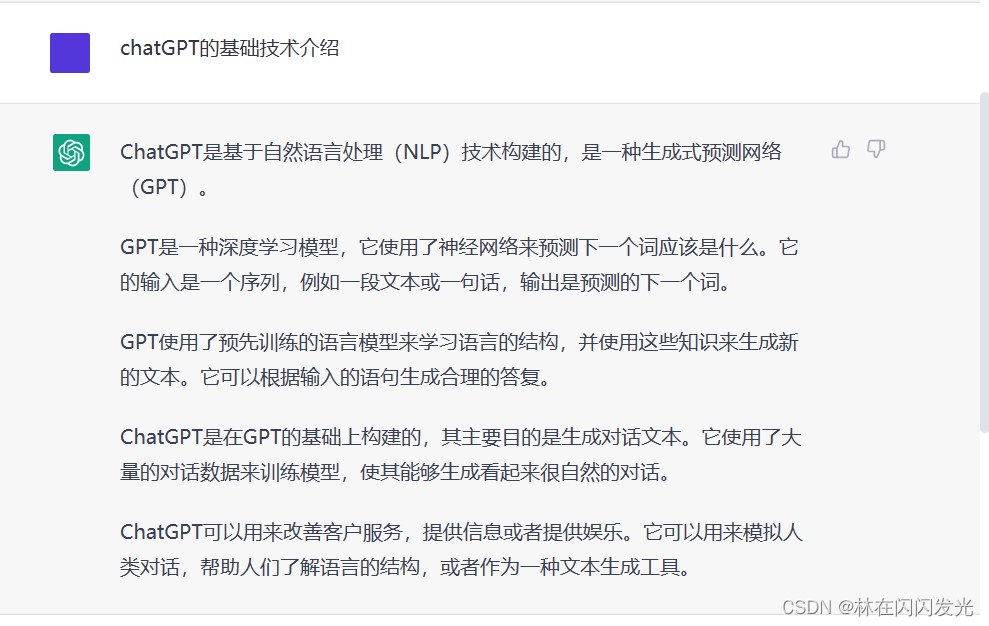

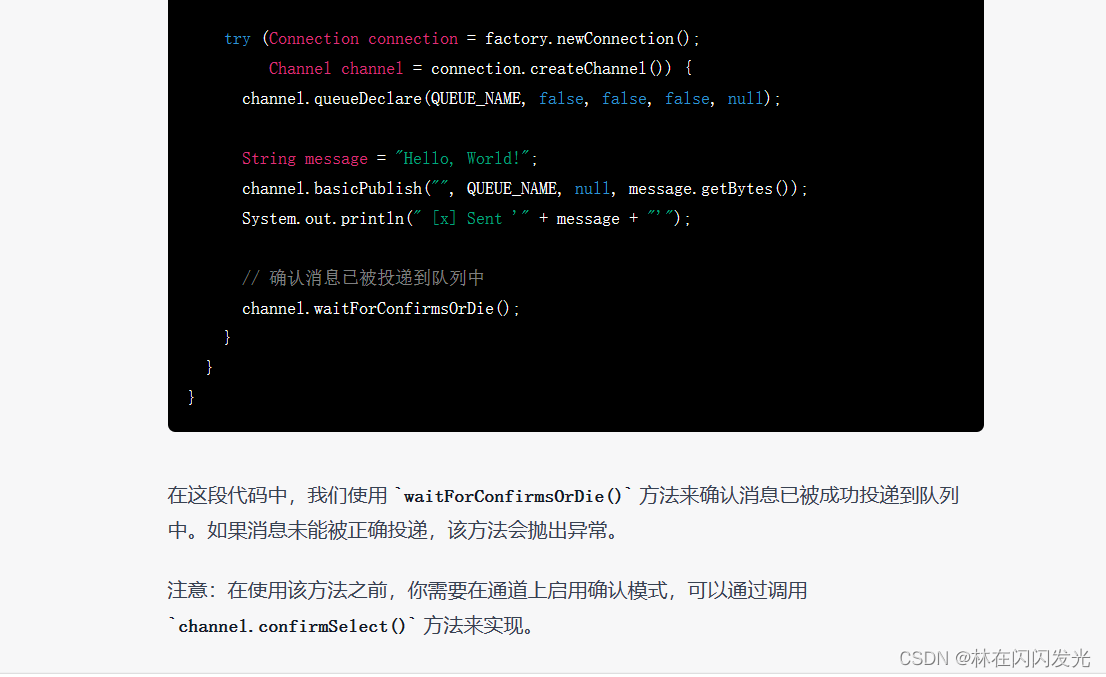

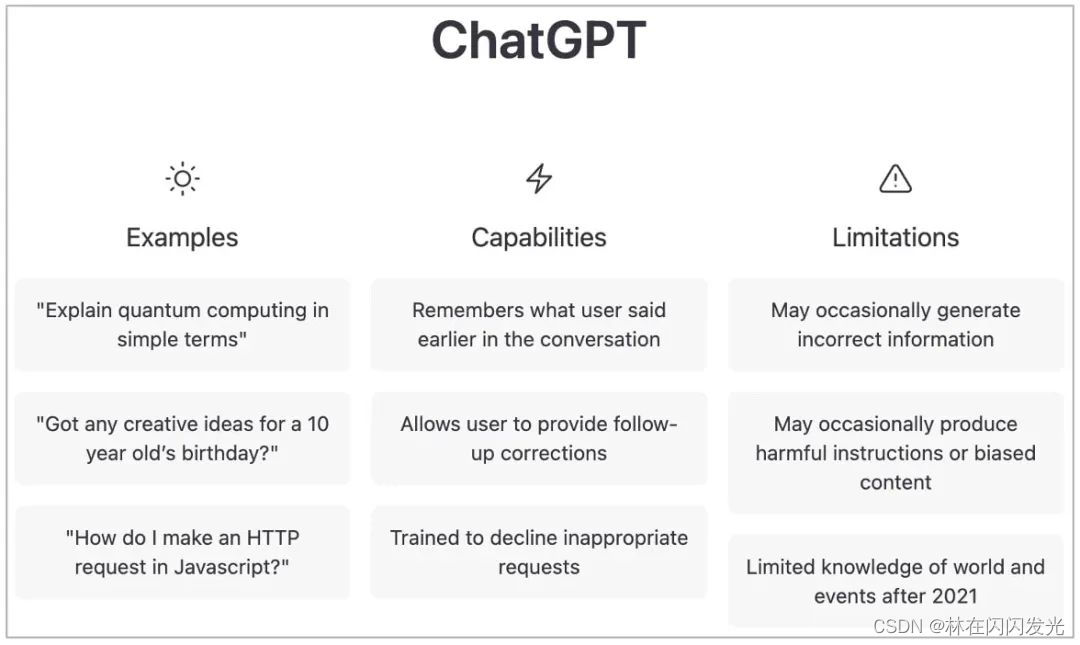

2.简单介绍

3.简单使用

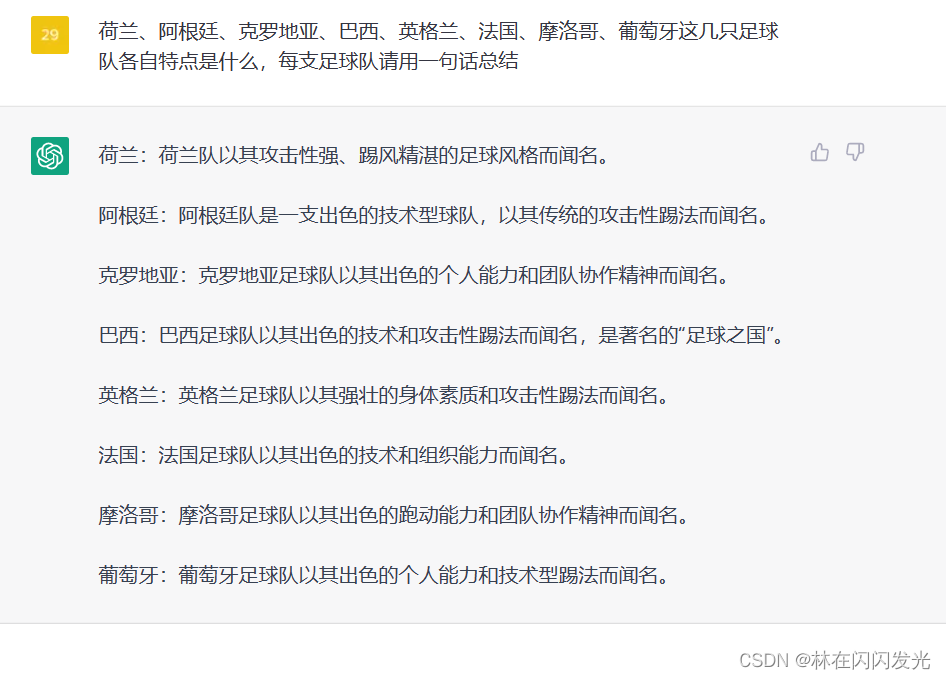

1.世界杯问题

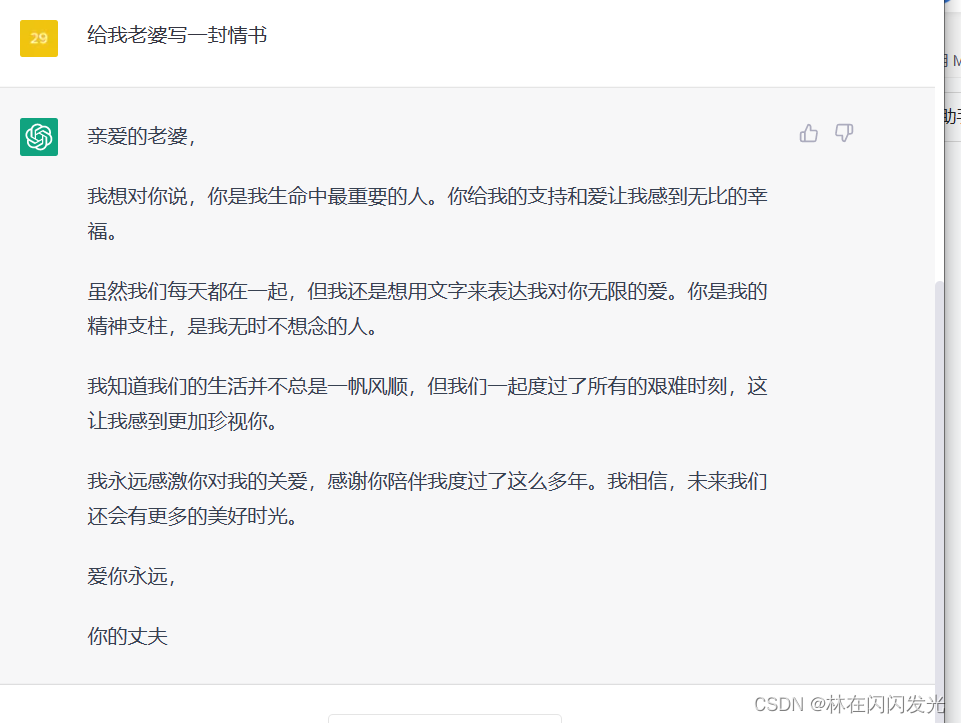

2.你还可以这样

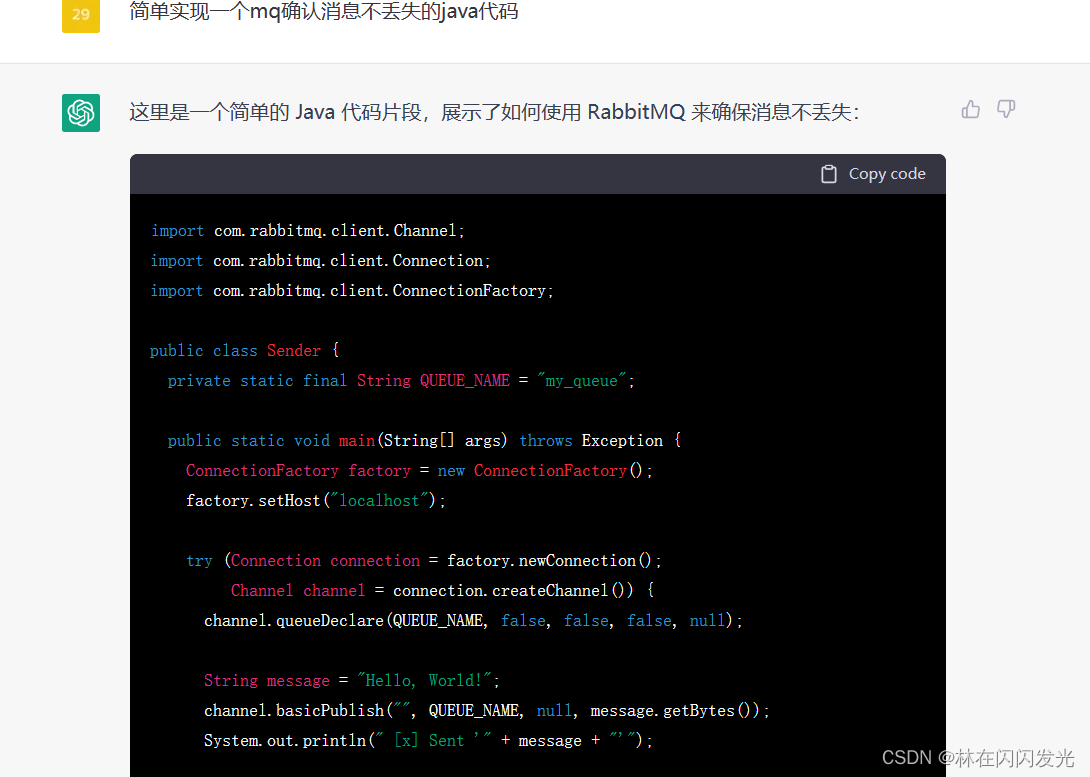

4.编写代码

ChatGpt 还有很多作用 就不一 一截图了

ChatGPT非常擅长对话、情感分析、文本生成、摘要提取等,有了这些直接打开了更广阔的应用面 .如若在垂直领域做定向训练,它将会发挥出更极致的性能,即可作咨询用途,同时也可以辅助创作

5.ChatGPT 的局限性

-

ChatGPT 有时会写出看似合理但不正确或荒谬的答案。解决这个问题是具有挑战性的,因为:(1)在 RL 训练期间,目前没有真实来源;(2) 训练模型更加谨慎导致它拒绝可以正确回答的问题;(3) 监督训练会误导模型,因为理想的答案取决于模型知道什么,而不是人类演示者知道什么。

-

ChatGPT 对输入措辞的调整或多次尝试相同的提示很敏感。例如,给定一个问题的措辞,模型可以声称不知道答案,但只要稍作改写,就可以正确回答。

-

该模型通常过于冗长并过度使用某些短语,例如重申它是 OpenAI 训练的语言模型。这些问题源于训练数据的偏差(训练者更喜欢看起来更全面的更长答案)和众所周知的过度优化问题。

-

理想情况下,当用户提供模棱两可的查询时,模型会提出澄清问题。相反,当前的模型通常会猜测用户的意图。

AI的未来发展方向

一个比较确定的方向是,语言模型的发展会远超今天的想象。虽然很多人都说算力和数据都已经跟不上了,这也是事实,但算法的改进空间依然很大,还可以带来很大的进步

第二个方向是多模态模型的发展。未来的多模态模型将不局限于文本和图像的互相转换,而是所有模态之间都可以方便地互相转化。

第三个方向是,模型可以持续学习。目前的模型如GPT都停滞在当初训练好的状态,并不会随着使用次数的增加而自我优化。我相信未来可以改变这一点

如果上述三点都能实现的话,我们就可以解锁无数全新的应用场景,实现真正的科技革新,帮助人类实现科技的飞跃式前进。而且我相信,我们也有办法利用AI推动科研进步和新知识的产生。

我认为,现在普遍存在的一种错误观点是:“虽然语言模型的功能已经比较完善,还可以应用到图像和视频领域,将应用智能的边际成本降得非常低,但归根结底,它只是模仿人类做过的东西,不能为人类产生新知识,不能治疗癌症,也不能拓展人类已知的科学领域。”我相信,AI的发展会让持这种观点的人大吃一惊

结尾

ChatGPT是不是会取代搜索引擎?取代程序员?有人也分析目前看来技术上还是达不到的,但未来不是没有可能,让我们拭目以待吧

测试

更多好玩的 自己去测试吧

ChatGPT 测试地址:

https://chat.openai.com/auth/login

文章出处登录后可见!