论文标题:SNE-RoadSeg: Incorporating Surface Normal Information into Semantic Segmentation for Accurate Freespace Detection

论文地址:https://arxiv.org/abs/2008.11351v1

论文代码:https://github.com/hlwang1124/SNE-RoadSeg

数据集:http://sites.google.com/view/sne-roadseg

发表时间:2020年8月

本文使用表面法线估计器(SNE)对 Depth Image 进行处理,再使用 ResNet 进行特征提取,和仅使用 ResNet 进行特征提取的 RGB Image 的特征进行融合,融合使用了 FCN、DenseNet 的思想,具体融合处理仅仅是元素相加求和。

Abstract

自由空间检测是自动驾驶汽车视觉感知的重要组成部分。最近在数据融合卷积神经网络 (CNN) 方面所做的努力显著改善了语义驾驶场景分割。自由空间可以假设为地平面,其上的点具有相似的表面法线。

因此,在本文中,我们首先介绍了一个名为表面法线估计器(SNE)的新模块,它可以从密集的深度/视差图像中以高精度和高效率推断表面法线信息。此外,我们提出了一种数据融合 CNN 架构,称为 RoadSeg,它可以从 RGB 图像和推断的表面法线信息中提取和融合特征,以实现准确的自由空间检测。出于研究目的,我们发布了一个名为Ready-to-Drive (R2D) 道路数据集的大型合成自由空间检测数据集,该数据集是在不同的光照和天气条件下收集的。实验结果表明,我们提出的SNE 模块可以使所有最先进的 CNN 用于自由空间检测,并且我们的 SNE-RoadSeg 在不同数据集中实现了最佳的整体性能。

Personal understanding

本文有两个创新点:

1、表面法线估计器(SNE)

本质上是一种特殊的特征提取方法

2、融合架构 RoadSeg

SNE 从深度/视差图像中提取特征,将此特征和 RGB 图像特征通过 RoadSeg 架构进行融合,本质上也是 CNN 的构成的,核心思想是基于 DenseNet 的改进

Method

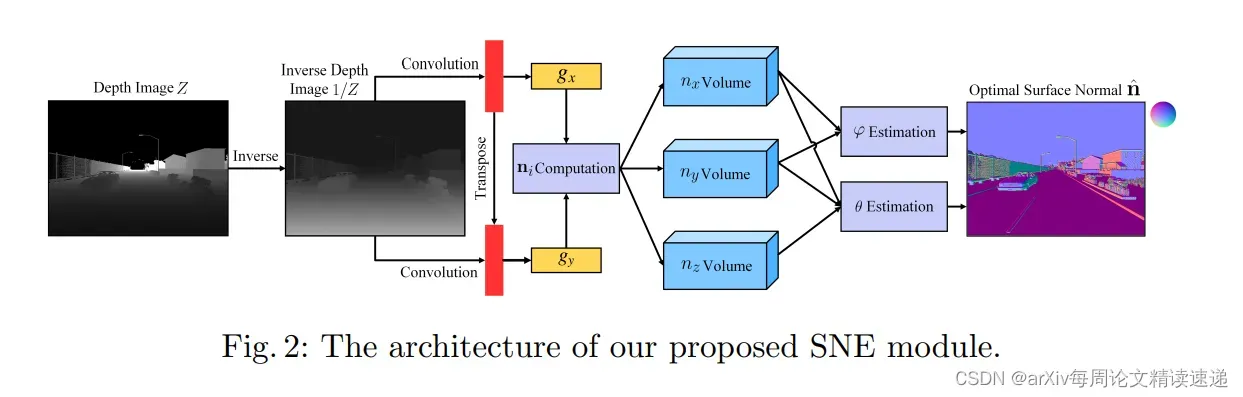

1、表面法线估计器(SNE)架构如图

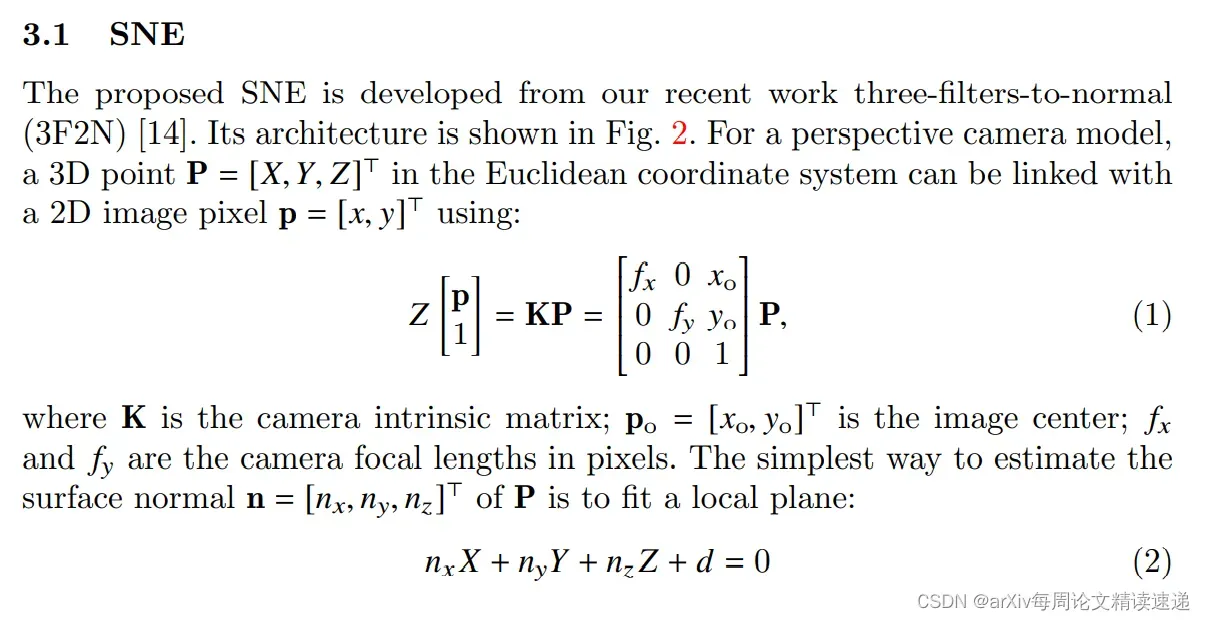

SNE 具体流程是严格的数学推导,并且作者给出了推导过程,数学基础好的同学可以详细看一下,会有收获的,不好的同学代码是开源的,可以直接使用,部分推导原文如下:

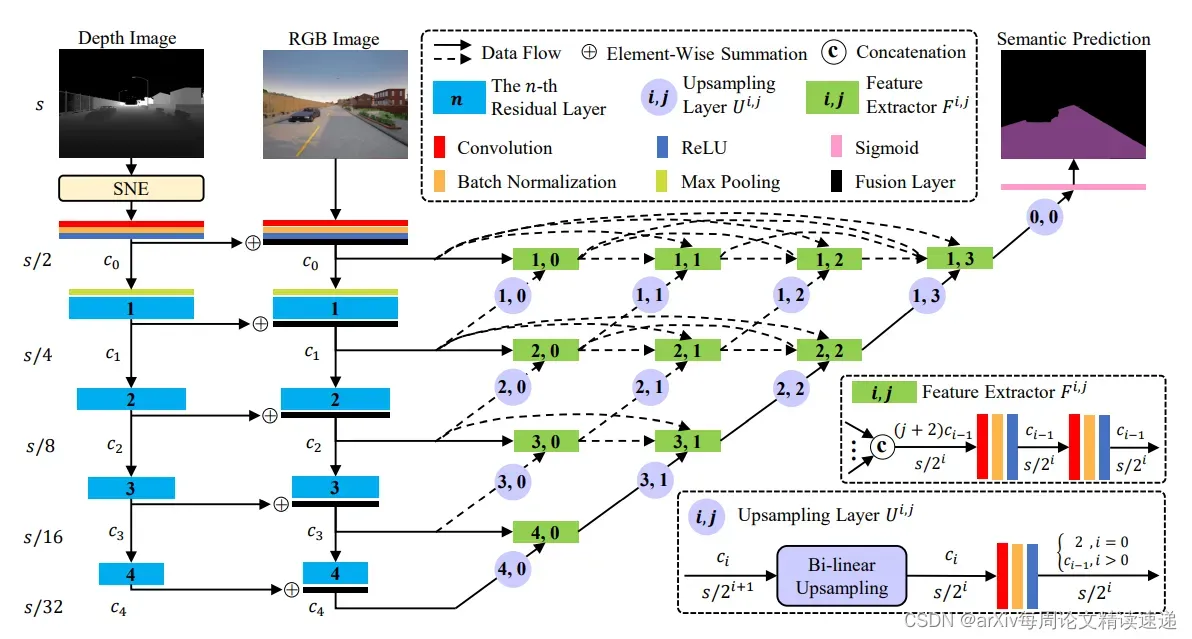

2、RoadSeg 的数据融合 CNN 架构

首先 Depth Image 经过 SNE 进行特征提取,经过 Conv、BN、ReLU、Max Pooling、残差块……

同时 RGB Image 也经过 Conv、BN、ReLU、Fusion(此处融合只是简单的元素相加)

不同层进行了多次残差、融合、上采样、特征提取操作,思想来源于 FCN 架构。不理解的同学,可以自学一下 FCN 不算太复杂,也可以自学以下 U-Net,道理相似。

这里要提一下,针对 Depth Image 图像的 SNE 输出的特征、RGB Image 特征,作者是使用的 ResNet 为主干进行特征提取,ResNet 架构,已经不属于 SOTA 了,所以这个位置,是可以进行改进的。

Experiments

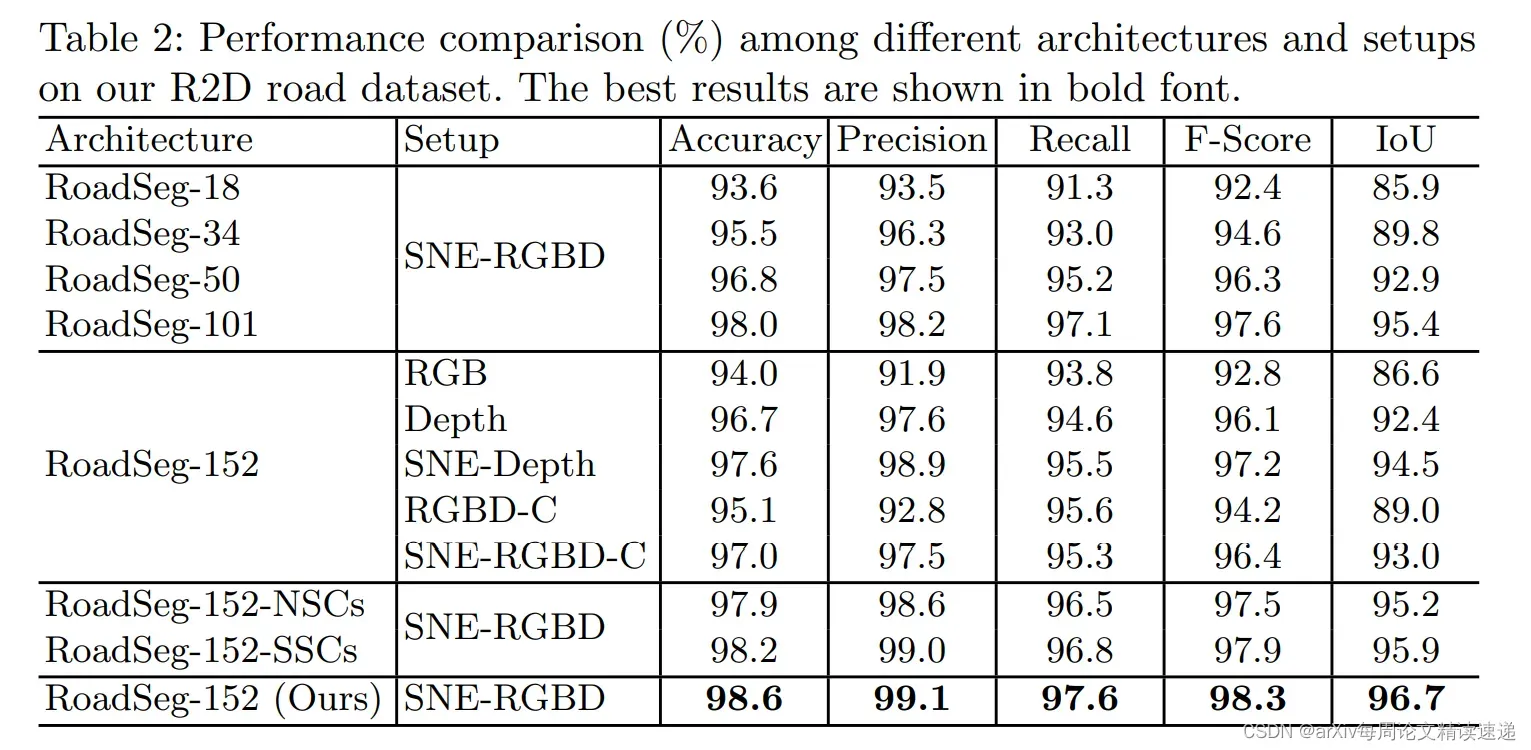

作者进行了很多次实验,并且在不同的数据集上都进行了对比实验,因为本文是2020年的文章,这里就不介绍过多实验过程了,放一张有价值的图,发现我们的方法是最优的。

这里解释一下,为什么有多种 RoadSeg 架构,这里是因为,针对 Depth Image 经过 SNE 后的特征和 RGB Image 的特征是通过 ResNet 进行特征提取的,而 ResNet 的架构有多种架构

有 ResNET-18、ResNet-34……ResNet-152,为了避免同学们看不懂,这里详细说了以一下

方便自己学习时能够更快理解,并且最终发现, RoadSeg 使用 ResNet-152 效果最好,也正是因为神经网络学习的知识做过多,所以它最准确呀!

版权声明:本文为博主arXiv每周论文精读速递原创文章,版权归属原作者,如果侵权,请联系我们删除!

原文链接:https://blog.csdn.net/m0_58678659/article/details/123168477