风格迁移

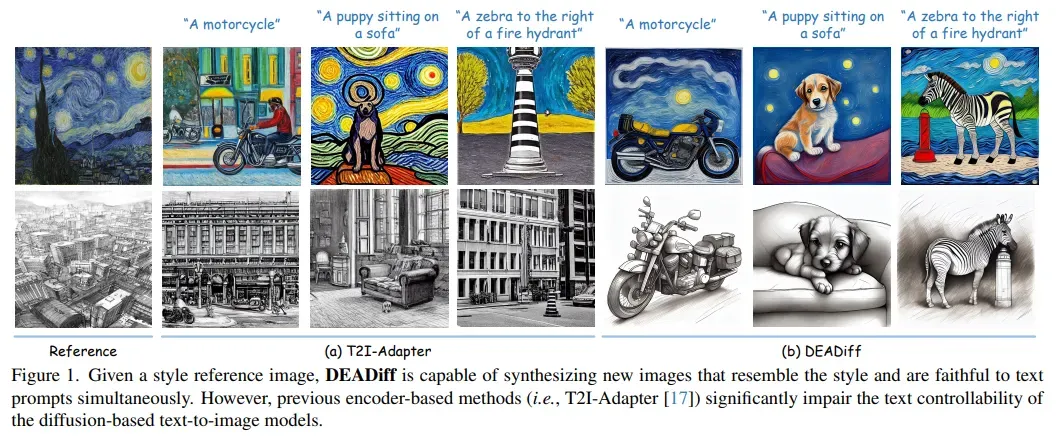

1、DEADiff: An Efficient Stylization Diffusion Model with Disentangled Representations

基于文本到图像扩散模型在迁移参考风格方面具有巨大潜力。然而,当前基于编码器的方法在迁移风格时显著损害了文本到图像模型的文本可控性。本文提出DEADiff来解决这个问题,采用以下两种策略:1)一种解耦参考图像的风格和语义的机制。解耦后的特征表示首先由不同文本描述指导的Q-Formers提取。然后,它们被注入到交叉注意力层的相互排除的子集中,以实现更好的分解。2)一种非重构学习方法。Q-Formers使用成对图像而不是相同的目标进行训练,其中参考图像和真实图像具有相同的风格或语义。

展示DEADiff在视觉风格化结果上取得了最佳效果,并在量化和定性上表现出文本可控性与与参考图像风格相似性之间的最佳平衡。https://tianhao-qi.github.io/DEADiff/

2、Deformable One-shot Face Stylization via DINO Semantic Guidance

本文针对One-shot人脸风格化问题进行研究,关注外观和结构的同时考虑。探索了与传统的单幅图像风格参考不同的变形感知人脸风格化。方法核心是利用自监督视觉transformer,具体来说是DINO-ViT,建立起强大而一致的人脸结构表示,涵盖真实和风格化领域。风格化过程首先通过将StyleGAN生成器适应到具有变形感知能力的状态,通过集成空间transformer(STN)来实现。然后,在DINO语义的引导下,引入两个创新的约束来指导生成器的微调:i)方向变形损失,调整DINO空间中的方向向量;ii)基于DINO令牌自相似性的相对结构一致性约束,确保多样化生成。此外,采用样式混合来使颜色生成与参考图像一致,减少不一致的对应关系。

方法为One-shot人脸风格化提供了更好的可变形性能,并在大约10分钟的微调时间内实现了显著的效率。广泛的定性和定量比较证明方法人脸风格化方法方面的优越性。https://github.com/zichongc/DoesFS

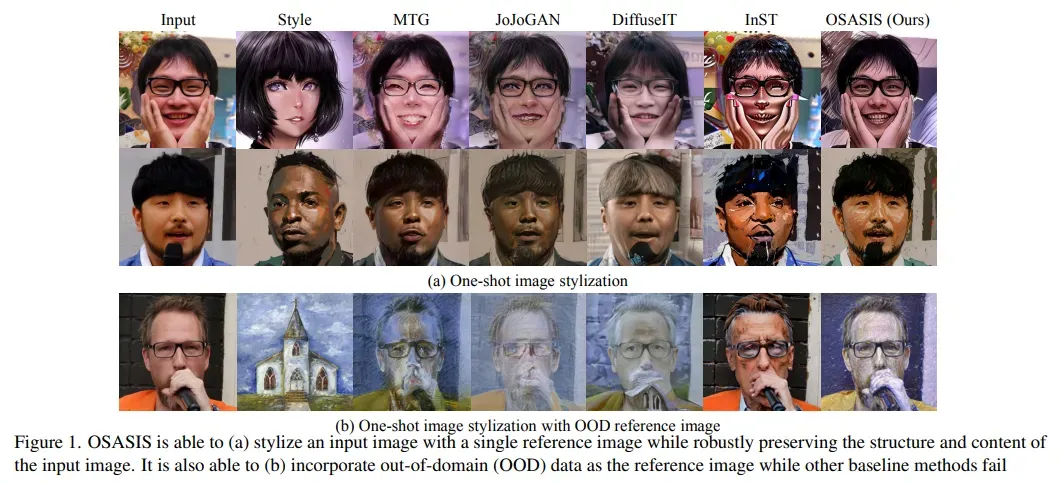

3、One-Shot Structure-Aware Stylized Image Synthesis

虽然基于GAN的模型在图像风格化任务上取得成功,但在对各种输入图像进行风格化时往往难以保持结构的完整性。最近,扩散模型已被用于图像风格化,但仍然缺乏保持输入图像原始质量的能力。

本文提出OSASIS:一种新的One-Shot风格化方法,具有结构保持的鲁棒性。展示了OSASIS能够有效地将图像的语义和结构解耦,使其能够控制给定输入中的内容和风格水平。将OSASIS应用于各种实验设置,包括使用域外参考图像进行风格化以及使用文本驱动的操作进行风格化。结果表明,OSASIS在风格化方法方面表现出色,特别是对于训练中很少遇到的输入图像,为扩散模型风格化提供了有希望的解决方案。

人像生成

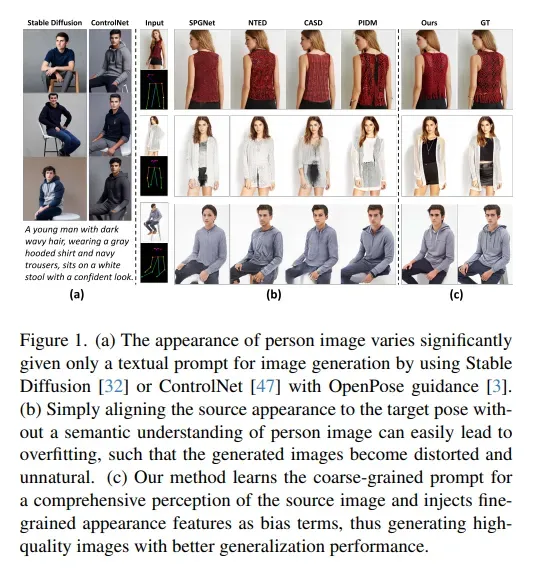

4、Coarse-to-Fine Latent Diffusion for Pose-Guided Person Image Synthesis

扩散模型已用于姿势引导的人物图像合成中。而现有方法仅仅将人物外貌与目标姿势对齐,由于在源人物图像上缺乏高层语义理解,容易出现过拟合的问题。

本文提出一种用于姿势引导的人物图像合成的新方法——粗到精的潜在扩散(CFLD)。在缺乏图像-文本配对和文本提示的情况下,开发一种纯粹基于图像的训练范式,用于控制预训练文本到图像扩散模型的生成过程。设计一个感知精化解码器,用于逐渐优化一组可学习的查询并提取人物图像的语义理解作为粗粒度提示。这使得在不同阶段解耦细粒度外貌和姿势信息控制成为可能,从而避免潜在的过拟合问题。

为生成更真实的纹理细节,提出一种混合粒度注意力模块,用于将多尺度的细粒度外貌特征编码为偏差项,以增强粗粒度提示。在DeepFashion基准测试上的定量和定性实验证明方法在PGPIS方面相对于现有技术的优越性。https://github.com/YanzuoLu/CFLD

5、High-fidelity Person-centric Subject-to-Image Synthesis

基于目标主体的图像生成方法,生成以人物为中心的图像面临着重大挑战。原因在于它们通过对共同预训练扩散进行微调来学习语义场景和人物生成,这涉及到无法调和的训练不平衡。为了生成逼真的人物,它们需要对预训练模型进行充分调整,这不可避免地导致模型忘记丰富的语义场景先验,并且使场景生成过度适应训练数据。此外,即使经过充分微调,这些方法仍然无法生成高保真度的人物,因为场景和人物生成的联合学习也会导致质量的折衷。

本文提出Face-diffuser,一种有效的协作生成流水线,以消除上述训练不平衡和质量折衷。具体而言,首先开发两种专门的预训练扩散模型,即文本驱动扩散模型(TDM)和主体增强扩散模型(SDM),用于场景和人物的生成。采样过程分为三个顺序阶段,即语义场景构建、主体-场景融合和主体增强。第一和最后阶段分别由TDM和SDM完成。主体-场景融合阶段通过一种新且高效的机制实现,即基于显著性自适应噪声融合(SNF)。具体来说,它基于本文核心观察结果,即分类器无关指导响应与生成图像的显著性之间存在强大的联系。在每个时间步骤中,SNF利用了每个模型的独特优势,并以一种自适应于显著性的方式自动地进行两个模型预测噪声的空间混合,所有这些都可以无缝地集成到DDIM采样过程中。

实验证实Face-diffuser在生成高保真度人物图像方面的卓越效果。https://github.com/CodeGoat24/Face-diffuser

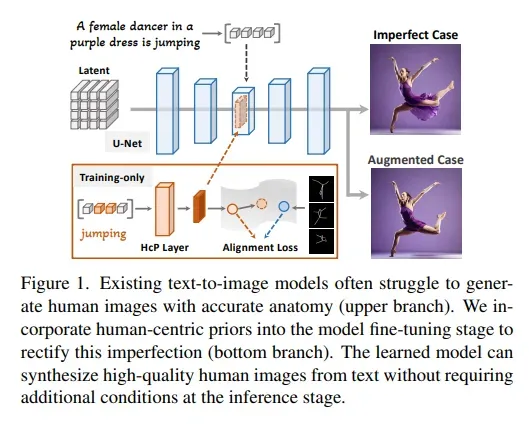

6、Towards Effective Usage of Human-Centric Priors in Diffusion Models for Text-based Human Image Generation

传统的文本到图像扩散模型在生成准确的人物图像方面存在困难,例如不自然的姿势或不成比例的肢体。现有方法大多通过在模型微调阶段添加额外的图像或人体中心先验(例如姿势或深度图)来解决这个问题。本文探讨的是将这些人体中心先验直接集成到模型微调阶段,从而在推理阶段消除额外条件的需求。

通过引入人体中心对齐损失,在交叉注意力图中增强来自文本提示的与人相关的信息,实现了这一想法。为在微调过程中保证语义细节丰富性和人体结构准确性,根据对交叉注意力层的深入分析,引入尺度感知和分步约束。

实验结果表明,方法在基于用户编写的提示语生成高质量人物图像方面取得较大改进。https://hcplayercvpr2024.github.io/

关注公众号【机器学习与AI生成创作】,更多精彩等你来读

不是一杯奶茶喝不起,而是我T M直接用来跟进 AIGC+CV视觉 前沿技术,它不香?!

ICCV 2023 | 最全AIGC梳理,5w字30个diffusion扩散模型方向,近百篇论文!

卧剿,6万字!30个方向130篇!CVPR 2023 最全 AIGC 论文!一口气读完

深入浅出stable diffusion:AI作画技术背后的潜在扩散模型论文解读

深入浅出ControlNet,一种可控生成的AIGC绘画生成算法!

最新最全100篇汇总!生成扩散模型Diffusion Models

附下载 |《TensorFlow 2.0 深度学习算法实战》

《礼记·学记》有云:独学而无友,则孤陋而寡闻

点击跟进 AIGC+CV视觉 前沿技术,真香!,加入 AI生成创作与计算机视觉 知识星球!

版权声明:本文为博主作者:机器学习与AI生成创作原创文章,版权归属原作者,如果侵权,请联系我们删除!

原文链接:https://blog.csdn.net/lgzlgz3102/article/details/137190100