目录

在配置环境前,需要远程连接服务器,我选择使用MobaXterm,具体操作详见:

使用MobaXterm连接Linux服务器

一. 安装anaconda

Anaconda,中文大蟒蛇,是一个开源的Python发行版本,其包含了conda、Python等180多个科学包及其依赖项。

1. 下载anaconda

在官网上查找自己需要的版本,地址链接如下:

https://repo.anaconda.com/archive/

以我自己安装的版本为例,在控制台输入这句话:

wget https://repo.anaconda.com/archive/Anaconda3-2022.05-Linux-x86_64.sh或者可以在官网直接下载,然后拖入服务器文件夹中安装

2. 安装anaconda

下载完成后输入以下命令来进行Anaconda的安装

sh Anaconda3-2022.05-Linux-x86_64.sh

遇到回车就回车, 一直回车到底部,遇到yes/no输入yes

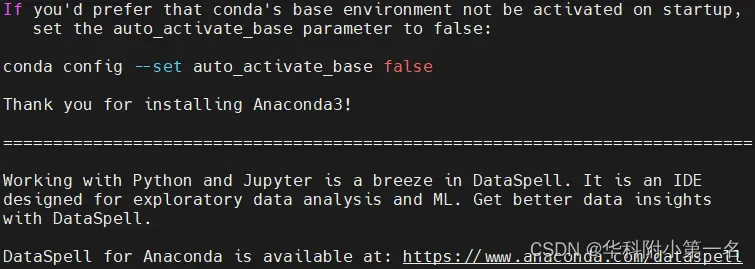

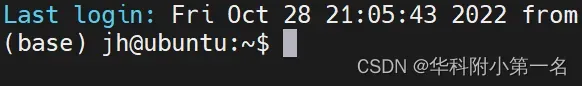

如见上述文字,说明已经安装完成,重启服务器后前面就增加了(base)

3. 卸载anaconda

打开终端,然后删除整个Anaconda目录即可:

rm -rf ~/anaconda3二. 创建虚拟环境

1. 创建虚拟环境

conda create -n lc_raft python=3.7创建名为lc_raft的python3.7的虚拟环境

2. 进入虚拟环境

conda activate lc_raft

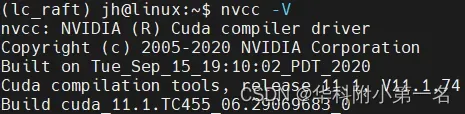

环境由base变为了lc_raft,前面变成了(lc_raft)

更多conda指令,详见:Conda简介及常用指令

三. 安装PyTorch

1. 查看cuda版本

CUDA(Compute Unified Device Architecture),是显卡厂商NVIDIA推出的运算平台。 CUDA™是一种由NVIDIA推出的通用并行计算架构,该架构使GPU能够解决复杂的计算问题。

关于查看自己电脑上的CUDA版本,首先需要区分CUDA的两种API,即运行时API(Runtime API)和驱动API(Driver API),详见CUDA学习(一)——如何查看自己CUDA版本?

1.1. 运行时API(Runtime API)

查看运行时API 版本的前提是已将在电脑上安装了CUDA Toolkit

nvcc -V

最下边一行是CUDA Runtime API的版本。

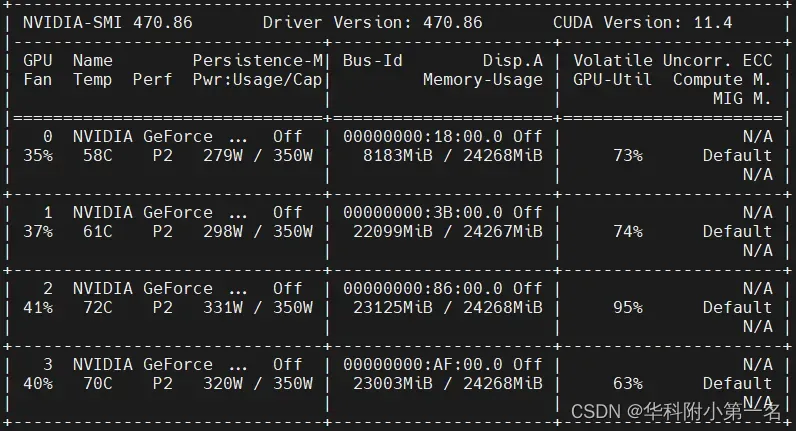

1.2. 驱动API(Driver API)

nvidia-smi

右上角的CUDA Version便是CUDA Driver API版本。

总结:nvidia-smi版本大于nvcc -V的版本不会有什么问题,根据nvidia-smi版本下载pytorch即可。

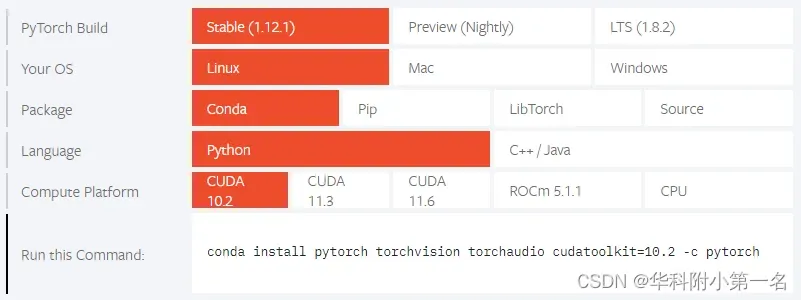

2. 下载PyTorch

官网下载:

找到后,复制安装代码,输入到控制台:

conda install pytorch torchvision torchaudio cudatoolkit=10.2 -c pytorch弹出提示,输入 y,即可完成安装,显示“done”。

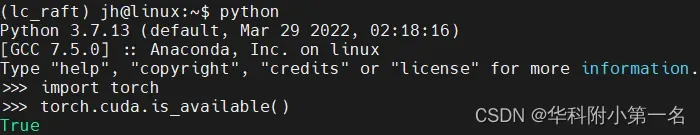

3. 测试安装

首先输入:python 然后在输入:import torch

输出true即为成功,false不成功(可能是因为pytorch和cuda版本不匹配)

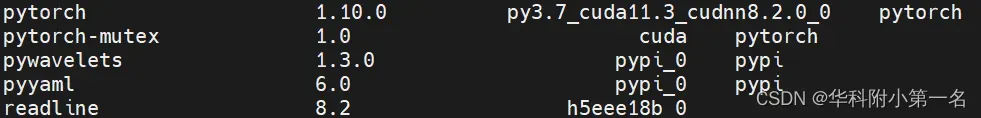

4. 查看pytorch版本

conda list

5. 卸载Pytorch

5.1. 使用conda卸载

conda uninstall pytorch

conda uninstall libtorch5.2. 使用pip卸载

pip uninstall torch如果是用conda install 命令安装的pytorch,则用conda卸载,如果是用pip install命令安装的,则用pip卸载。

至此,深度学习环境就配好啦,冲冲冲!

我们在远程登录到Linux服务器后,有时运行需要很长时间才能完成的任务,在此期间不能关掉窗口或者断开连接,否则这个任务就会被终止。因此需要在后台离线运行程序,我选择使用screen离线运行程序,具体操作详见:

使用screen在后台离线运行程序(linux服务器)

还有,配置环境中遇到的专业名词(IP地址、端口、终端、显卡服务器……)

文章出处登录后可见!