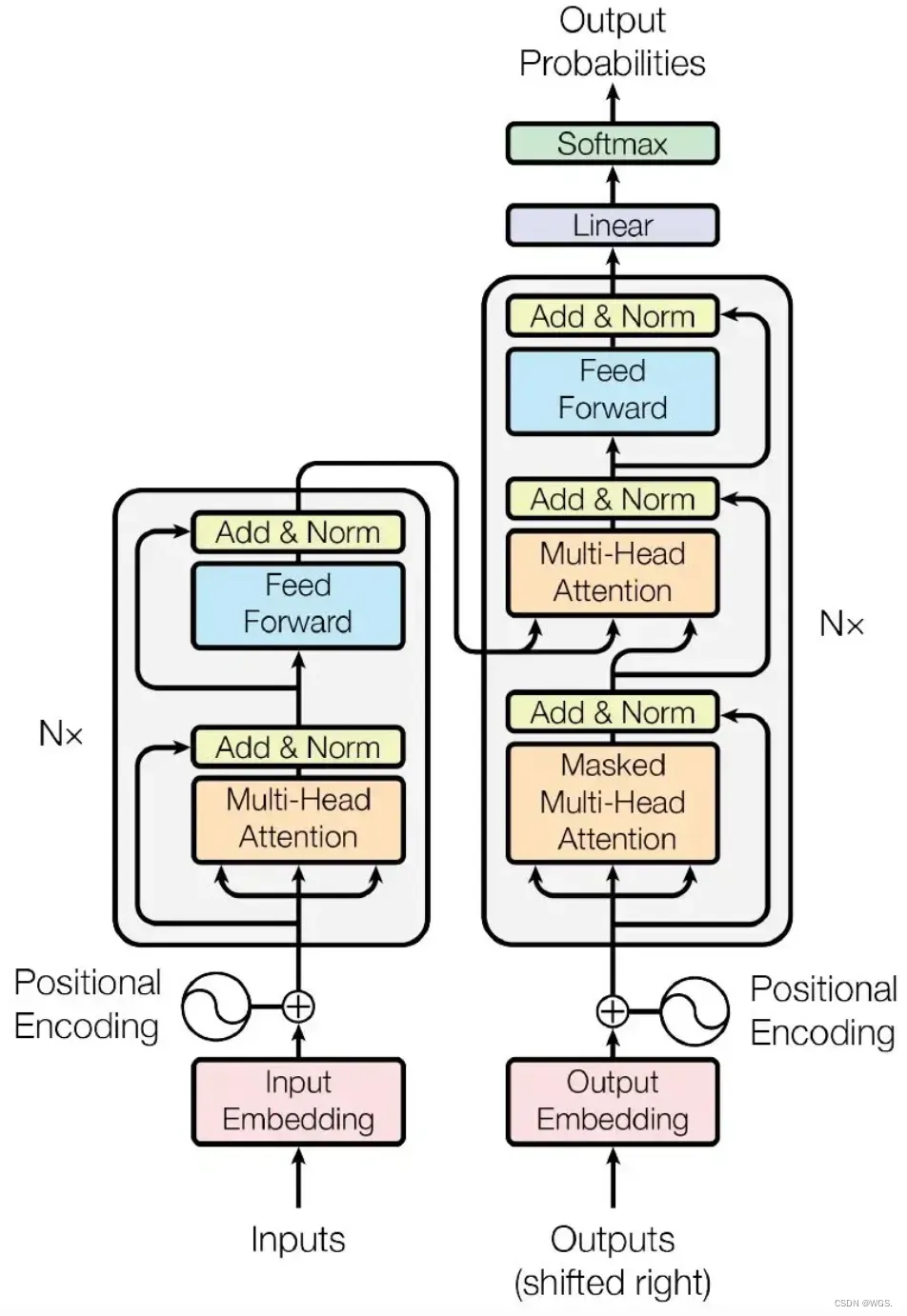

1. transformer结构图

在transformer的结构图中,由一个“Positional Encoding”,即位置编码,查看了以下资料后,稍微有点儿理解了,记录于此。

2. 位置编码的作用

由于transformer是并行化运算,所以输入的信息中没有位置信,而在语音文本中,绝大部分都是有语序的。例如:我爱你,要是翻译成’“You love me”,那意思就完全不一样了。于是,就有了位置编码,其作用就是让输入数据携带位置信息,是模型能够找出位置特点。

3. 位置编码的计算

在transformer中的位置编码中,其编码公式如下:

其中,

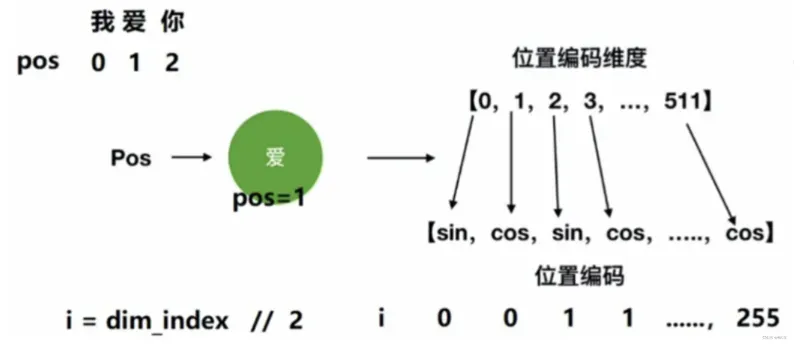

。上面,表示偶数位置使用sin, 奇数位置使用cos。引入实例,如: 翻译”我爱你”。

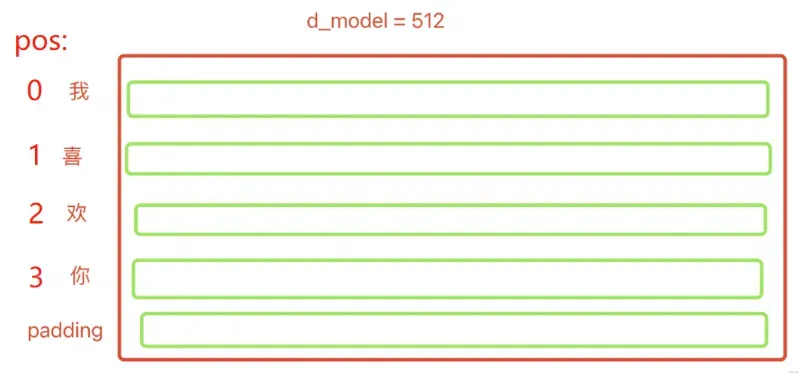

Step1: embedding编码

假设embedding编码将每个词向量编程成512维,如图所示:

Step2: 位置编码

由上图知,其 ,其编码示意图如下:

一步步计算可得,其具体的位置编码:

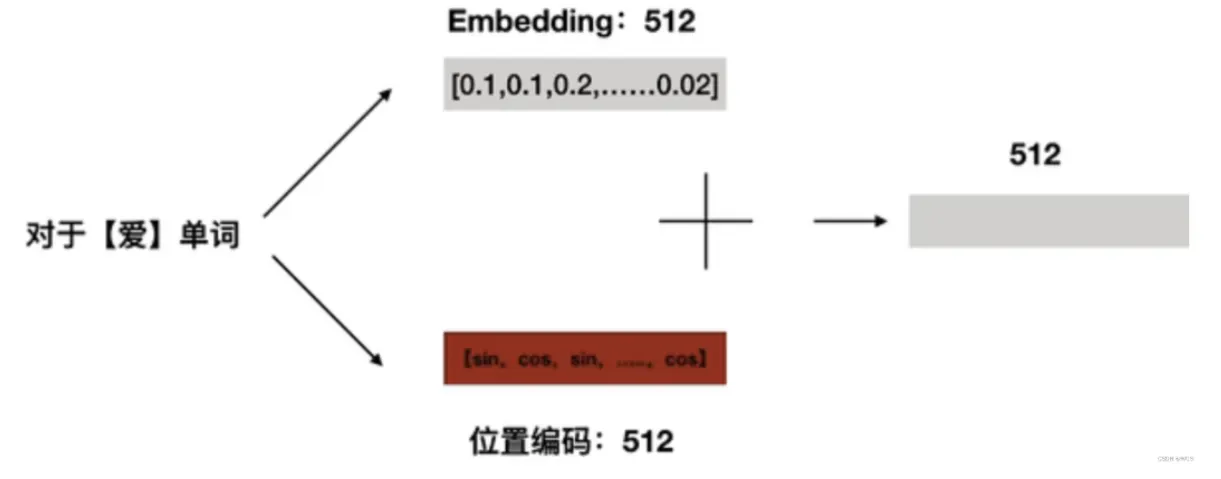

Step3: 位置编码与embedding编码进行相加

如图,

然后即可将其作为transtormer的输入进去Attention以及其他运算。

注:

文章有参考:https://wangguisen.blog.csdn.net/article/details/125074022?spm=1001.2014.3001.5502

该文写得非常赞,值得一看。

文章出处登录后可见!

已经登录?立即刷新