文章目录

1. 摄像头的成像原理

视觉传感器:利用光学元件和成像装置获取外部环境图像信息的仪器。

通常视觉传感器,其主要功能是获取足够的机器视觉系统要处理的最原始图像,类似于人类的眼睛。

1.1 单目视觉传感器的硬件结构

单目视觉的相机模组的组件包括了lens(镜头)、分色滤色片(IR cut)、感光元件等。 分色滤色片:对色光具有吸收、反射和透过作用的染有颜色的透明片。目前分色滤色片有两种分色方法:RGB原色分色法,CMYK补色分色法

分色滤色片:对色光具有吸收、反射和透过作用的染有颜色的透明片。目前分色滤色片有两种分色方法:RGB原色分色法,CMYK补色分色法

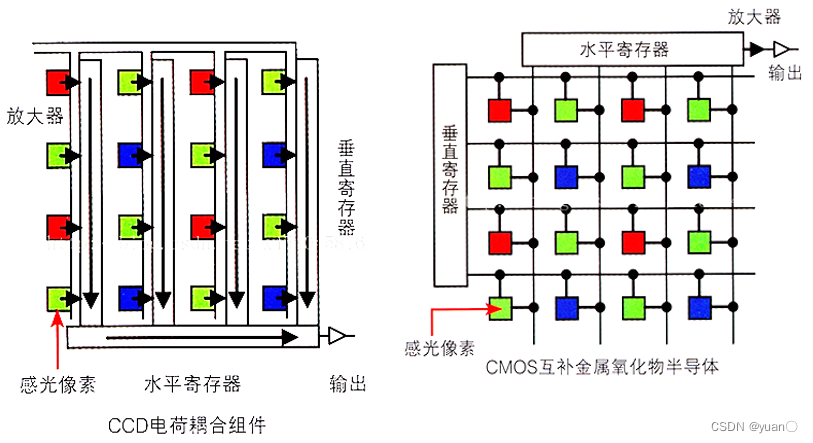

感光元件,其表面包含有几十万到几百万的光电二极管。光电二极管受到光照射时,就会产生电荷。感光元件一般包括CCD和CMOS两种。像素值一般为(0-255),电路噪声导致像素值失真.

感光元件,其表面包含有几十万到几百万的光电二极管。光电二极管受到光照射时,就会产生电荷。感光元件一般包括CCD和CMOS两种。像素值一般为(0-255),电路噪声导致像素值失真.

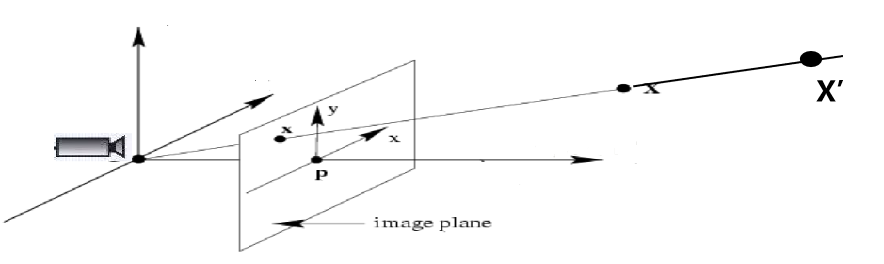

1.2 单目视觉的成像原理 –小孔成像模型

成像模型:相机将三维世界中的坐标点(单位为米)映射到二维图像平面(单位为像素)的过程。

相机坐标系: 为相机坐标系,在轴指向相机前方,

轴向右,

轴向下。

为摄像机的光心(或摄像头中心)。

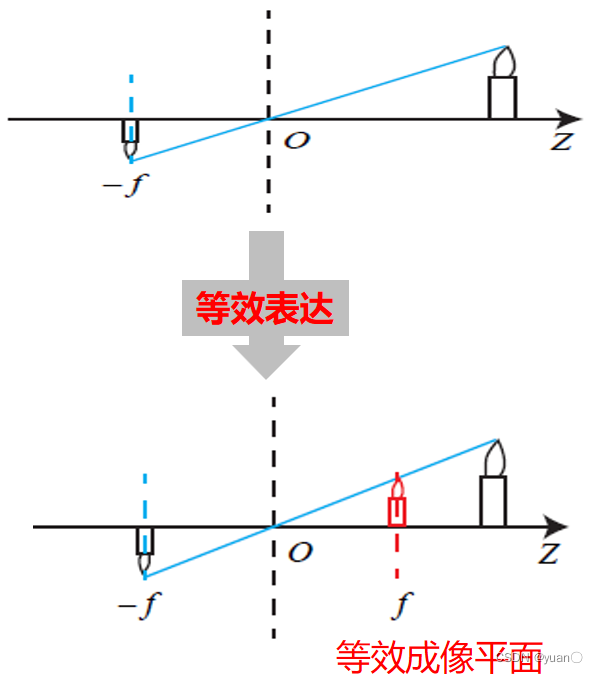

物理成像平面: 为物理成像平面。物理成像平面到小孔的距离为

,称之为焦距。

成像原理:空间点的光束被映射到图像平面,图像平面感光之后形成像素

。

接下来看看具体的原理推导:

首先,已知三维世界中的坐标点,成像平面中的

,焦距为

.由相似三角形原理可得,

在视觉感知中,常使用等效表达的方式来体现真实图像的输出过程

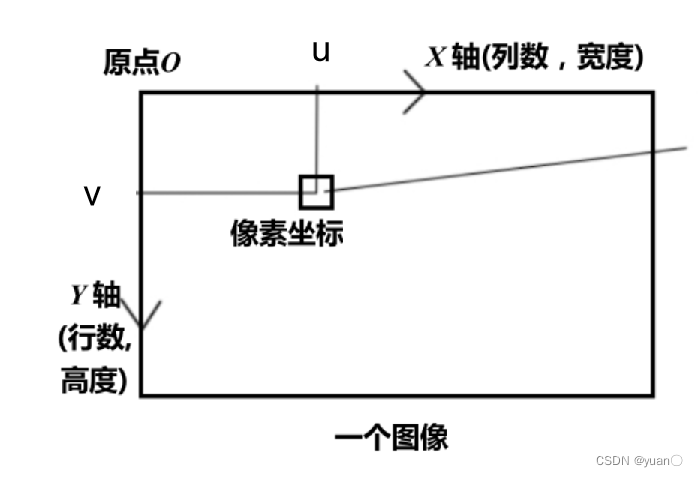

1.3 单目视觉的成像原理 – 像素坐标系

从成像平面坐标到像素坐标:图像是基于像素来表达。像素坐标和成像平面坐标之间,相差了一个缩放和原点的平移。

假设正向成像平面中, 其像素坐标为

.

缩放及平移的过程可以由下式来表达: 将

的坐标代入,

,可以得到三维坐标与像素坐标的转换关系

用矩阵的形式表达:

其中,

为像素坐标,

为相机坐标系中的三维坐标点,

为内参矩阵。

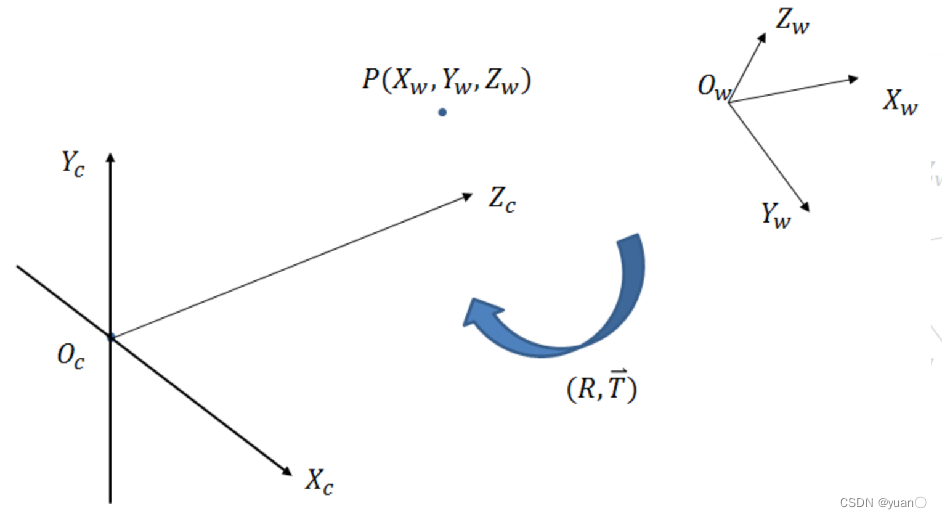

1.4 单目视觉三维坐标系转换 – 外参

相机的三维坐标系() 并不是一个“稳定”的坐标系,会随着相机的移动而改变坐标的原点和各个坐标轴的方向。在应用中,相机安装在自动驾驶车辆上,随车辆运动相机坐标系实时变化。对一些需要固定特征坐标的应用,比如地图,因此需要引进一个稳定不变的坐标系:世界坐标系(

)

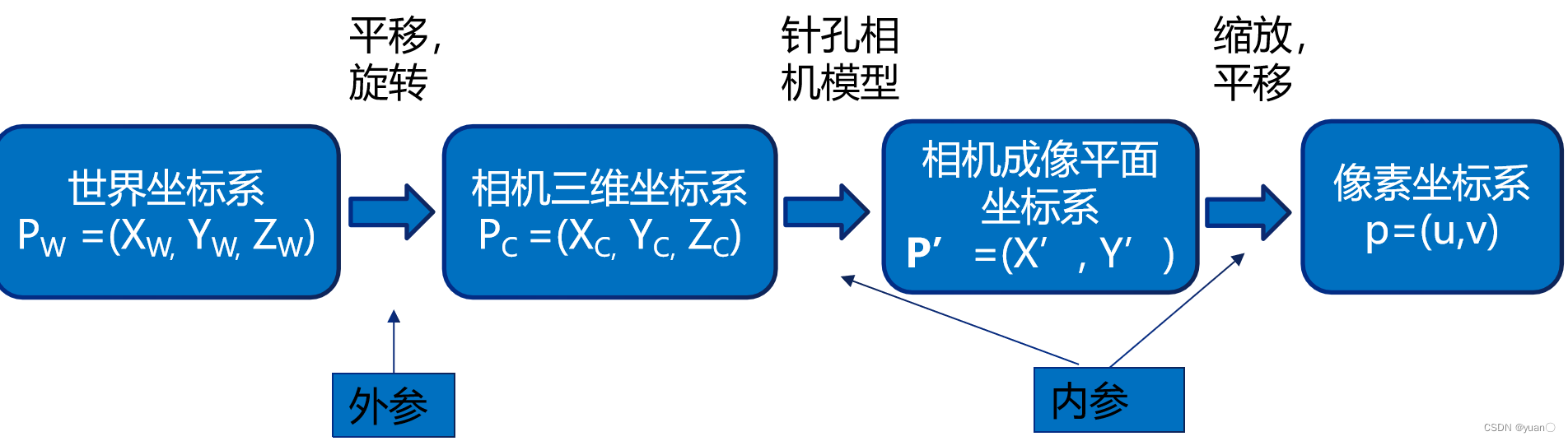

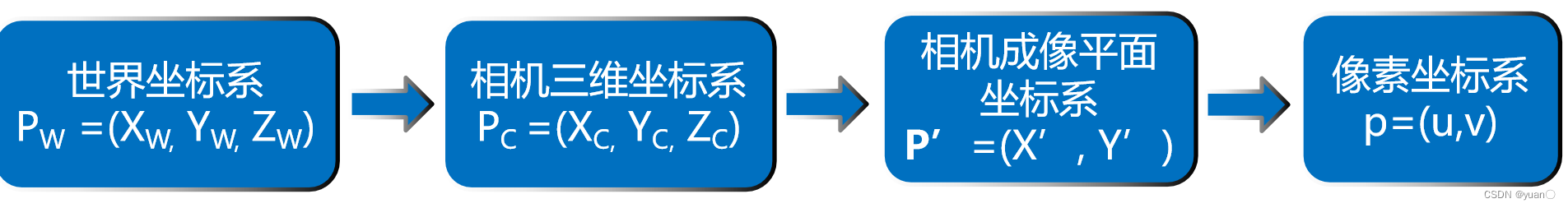

1.5 单目视觉的坐标系转换 – 从世界坐标点到像素坐标

最后对整个过程进行总结:

世界坐标系()中空间点

,成像到相机中得出其像点

,需要经过三次变换:

- 世界坐标系转换到相机三维坐标系→ 刚性变化,平移加旋转

- 相机三维坐标系转换到相机成像平面坐标系 → 小孔成像模型

- 相机成像坐标系转换到像素坐标系 →缩放加平移

1.6 单目视觉的特性

- 深度不确定:图中点X以及点X’的成像点是同一个像素点x。

- 远小近大:高度为X的物体,离相机越远成像点越矮,远处看不见。

- 易受遮挡:X与X’同时存在时,只能看到X,有盲区

- 受光线强度影响:光线过强,都是255,光线过暗,都是0

- 受分辨率影响:像素过低,细节就会丢失

- 受帧率影响:像素过高,传输速率有限,图片帧率偏低

- 受镜头影响:焦距和视角会直接决定看见的距离和角度范围

2. 视觉传感器的标定

首先对成像公式进行整理:

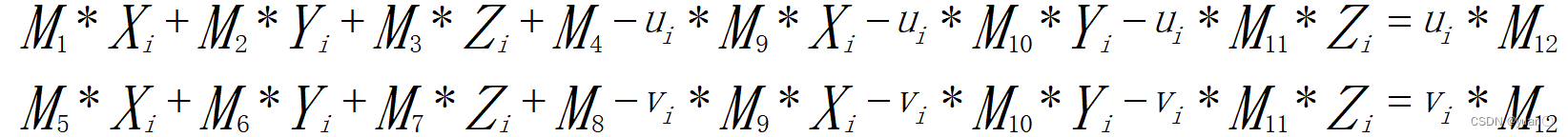

2.1 视觉传感器标定原理 – 线性标定法

标定的数学表达解释:输入个特征点的世界坐标及像素坐标,输出

矩阵

原理:根据一对特征点 ,成像公式可以得到两个线性方程:

如果镜头畸变需要矫正,则需要基于非线性方法,引入非线性畸变模型。一般可以采用非线性优化的方法求解。

2.2 相机畸变模型

2.2.1 径向畸变

由镜头透镜形状引起的畸变称为径向畸变,径向畸变主要分为桶形畸变和枕型畸变。

2.2.2 切向畸变

切向畸变源于透镜不完全平行于图像平面,即感光成像平面装配时与镜头间的角度不准;

产生的影响是图像像素点以畸变中心为中心点,沿着切向产生的位置偏差;

切向畸变由两个参数确定。

结合径向畸变的式子,即可得到畸变矫正的公式:

2.3 单目相机标定方法

对于单目相机的标定,我们主要需要对以下几个量进行标定:

- 内参矩阵

- 外参

- 畸变参数

有几种常用的方法用于标定:

一步法:

直接使用最优化方法求出相机内外参数

两步法:

- Tsai法(1987年)

假设:已知,只考虑径向畸变

标定设备:三维标定块 - 张正友法

假设:只考虑径向畸变

标定设备:平面标定板

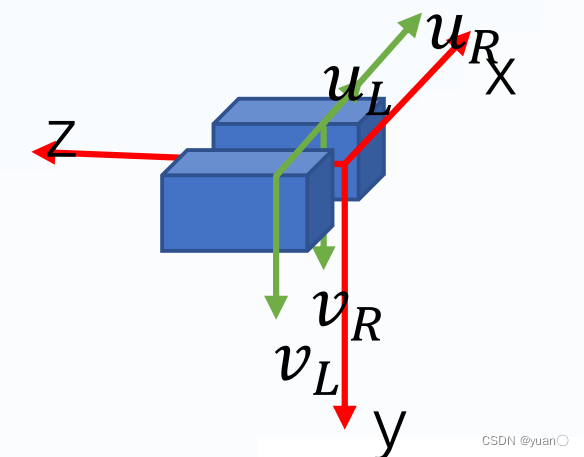

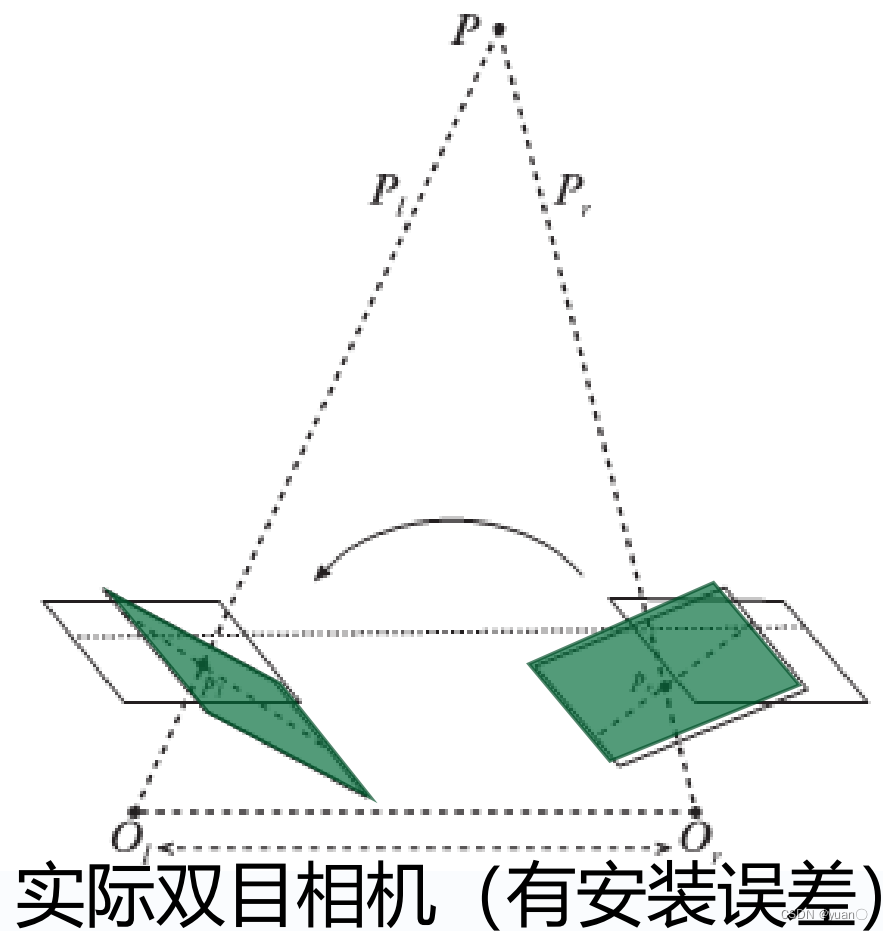

2.4 双目相机标定

此部分来源于北京理工大学慕课《无人驾驶车辆》

2.4.1 双目相机模型

2.4.2 双目相机标定方法

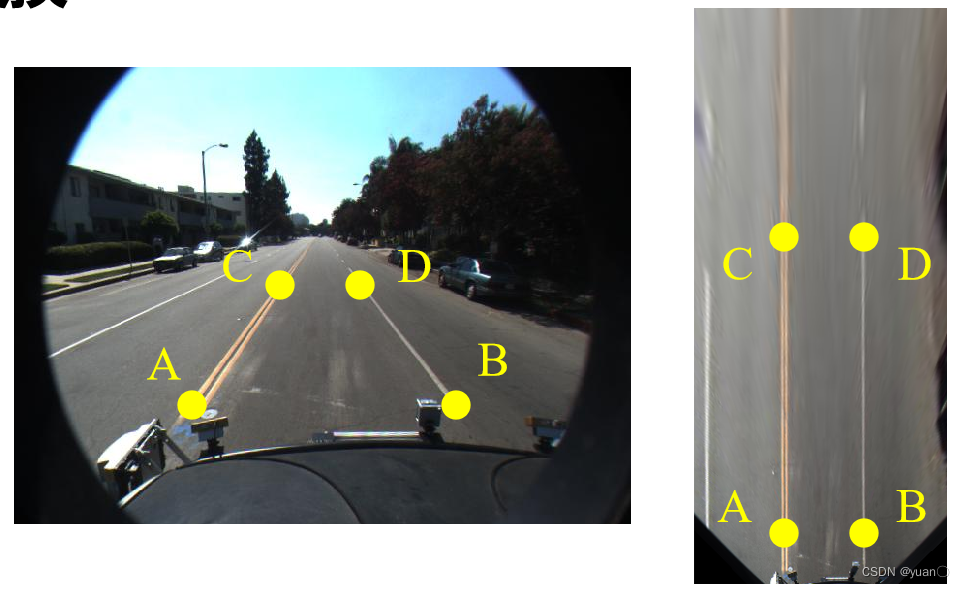

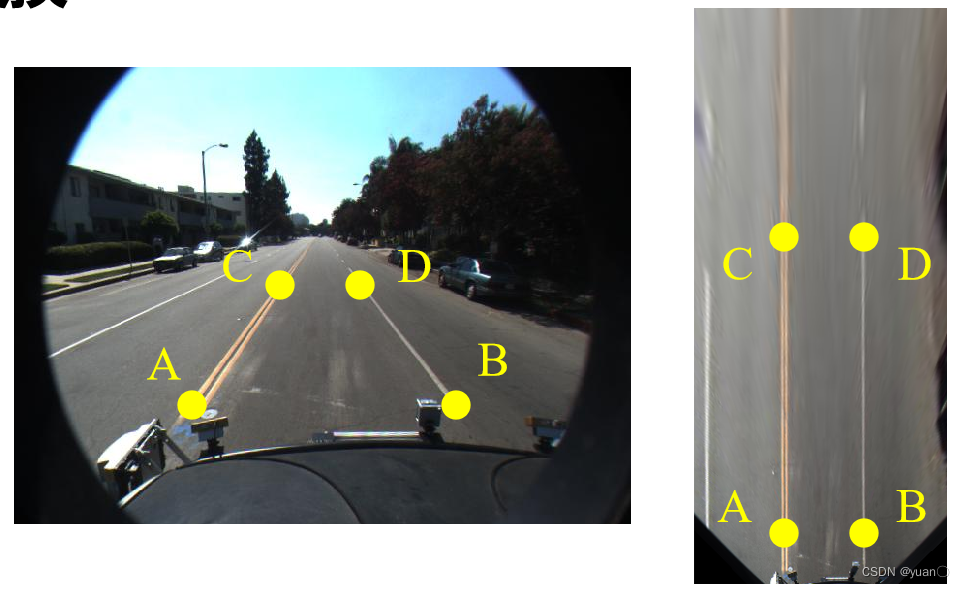

2.5 俯视图转化标定——逆透视变换

逆透视变换,英文为IPM (Inverse Perspective Mapping)

原理:根据图片坐标与世界坐标的关系,将图片像素对应到路面

- 相机成像公式,内参外参可以合并为一个3乘4矩阵

- 假设地面平坦,令

,就可以去掉

的第三列,两侧左乘

,并将

移到右侧,记

,

- 归一化:将P中各元素除以

,

也除以

,重新整理得

声明

本人所有文章仅作为自己的学习记录,若有侵权,联系立删。本系列文章主要参考了清华大学、北京理工大学、哈尔滨工业大学、深蓝学院、百度Apollo等相关课程。

文章出处登录后可见!