在最新的视觉顶会 CVPR 2023 会议中,涌现出了大量基于生成式AIGC的CV论文,包括不限于生成对抗网络GAN、扩散模型diffusion等等!除了直接生成,还广泛应用于其它各类 low-level、high-level 的视觉任务!

经过小编累计半年的跟踪,集齐和梳理了CVPR 2023里共30+大方向、近130篇的AIGC论文!下述论文均已分类打包好!

关注公众号【机器学习与AI生成创作】公众号,在后台回复 AIGC (长按红字、选中复制)即可获取分类、按文件夹汇总好的论文集,gan起来吧!!!

文章很长,梳理不易,越到后面的方向越有趣!麻烦各位看官,转发、分享、在看三连,多多鼓励小编!!!

一、图像转换/翻译

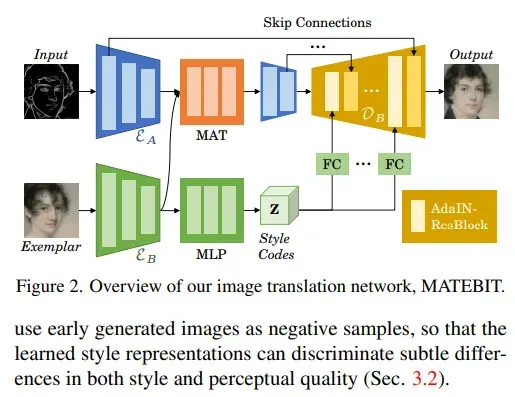

1、Masked and Adaptive Transformer for Exemplar Based Image Translation

提出了一个基于样本的图像转换新方法。 最近用于此任务的先进方法主要集中在建立跨域语义对应上,它以局部风格控制的方式顺序控制图像生成。 但跨域语义匹配具有挑战性,匹配错误最终会降低生成图像的质量。

为了克服这一挑战,一方面提高了匹配的准确性,另一方面削弱了匹配在图像生成中的作用。 为了实现前者,提出了一种掩码和自适应变换器 (MAT),用于学习准确的跨域对应关系,并执行上下文感知特征增强。 为了实现后者,使用样本的输入源特征和全局样式代码作为补充信息来解码图像。

此外,设计了一种新的对比风格学习方法,用于获取质量区分风格表示,这反过来有利于高质量图像的生成。 实验结果表明在各种图像转换任务中表现更好。 代码可在 https://github.com/AiArt-HDU/MATEBIT

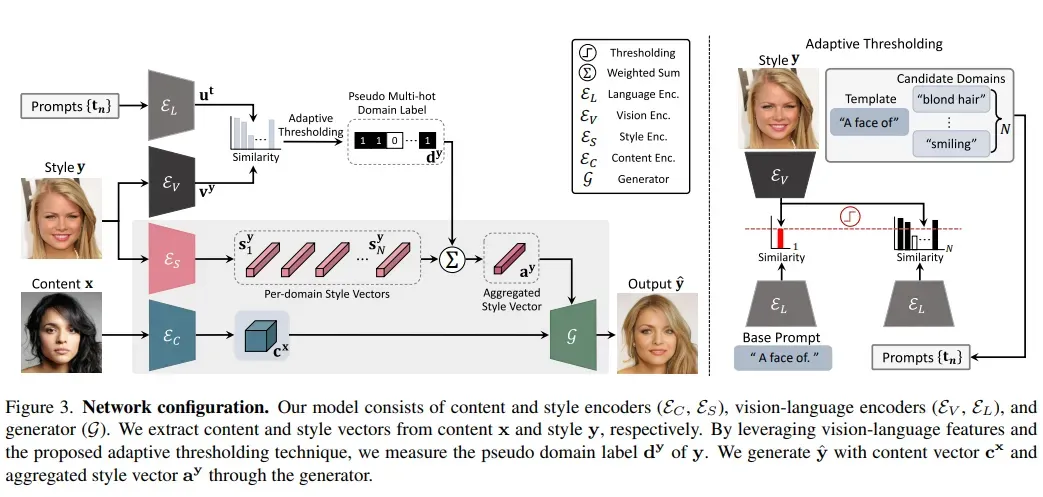

2、LANIT: Language-Driven Image-to-Image Translation for Unlabeled Data

现有的图像转换技术通常存在两个关键问题:严重依赖每个样本域标注,或无法处理每个图像的多个属性。 最近的真正无监督方法采用聚类方法来提供每个样本的域标签。 然而,它们无法解释现实世界的设置:一个样本可能具有多个属性。 此外,集群的语义不容易与人类理解相结合。

为了克服这些问题,提出了语言驱动的图像转换模型,称为 LANIT。 利用数据集文本中给出的易于获取的候选属性:图像和属性之间的相似性表示每个样本域标签。 用户可以使用语言中的一组属性指定目标域。 为了解决初始提示文本不准确的情况,还提供提示学习。

进一步提出域正则化损失,强制将转换后的图像映射到相应的域。 几个标准基准的实验表明,LANIT 实现了与现有模型相当或更优的性能。

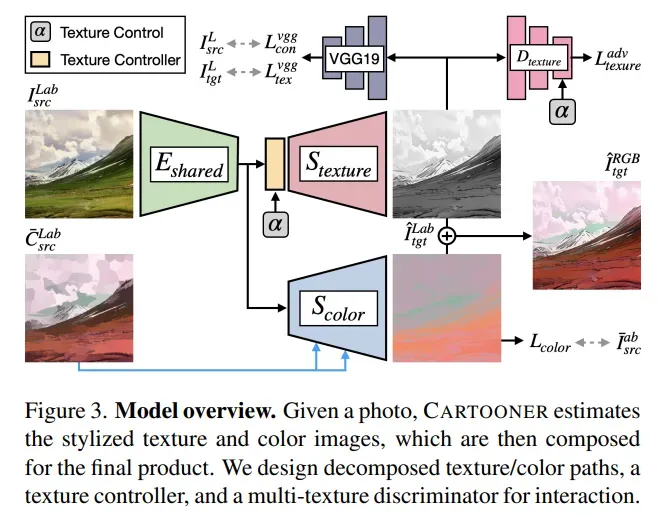

3、Interactive Cartoonization with Controllable Perceptual Factors

图像卡通化,即将自然照片渲染成卡通风格。 以前的卡通化方法只关注端到端的转换,这可能会阻碍可编辑性。 相反,本文提出了一种基于卡通创作过程的纹理和颜色编辑特征的新解决方案。

设计了一个模型架构,具有独立的解码器、纹理和颜色,以解耦这些属性。 在纹理解码器中,提出了一个纹理控制器,它使用户能够控制笔触样式和抽象以生成不同的卡通纹理。 还引入了 HSV 颜色增强来诱导网络生成多样且可控的颜色转换。 作者声称,该工作是第一个在推理时控制卡通化的深度学习方法,同时比基线有明显的质量改进。

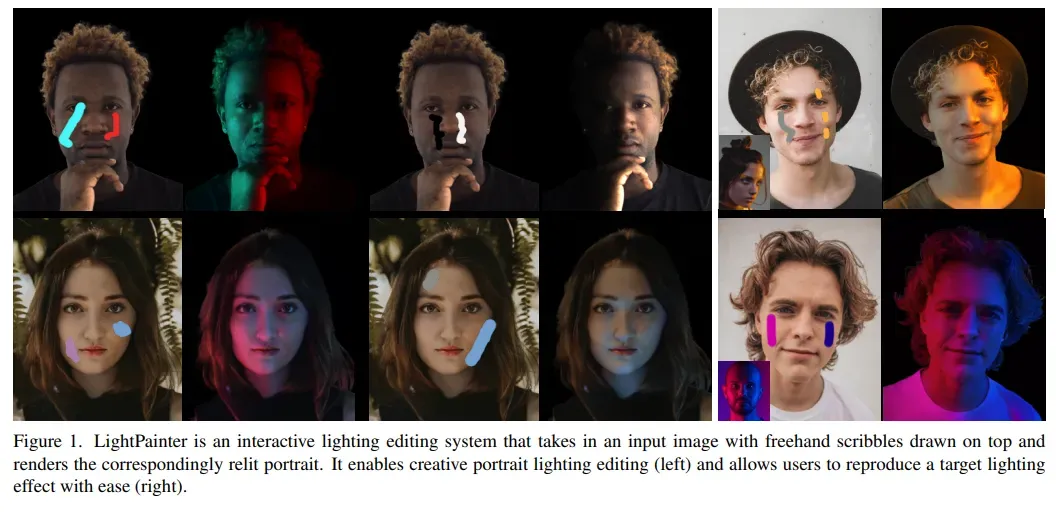

4、LightPainter: Interactive Portrait Relighting with Freehand Scribble

给定所需的照明表示(例如环境贴图),最近的人像重新打光/照明(portrait relighting)方法已经实现了人像照明效果的逼真效果。 然而,这些方法对于用户交互来说并不直观,并且缺乏精确的照明控制。

本文推出了 LightPainter,一种基于涂鸦的重打光系统,允许用户轻松地以交互方式操纵人像照明效果。 通过两个条件神经网络实现的,一个模块根据肤色恢复几何形状和反照率,以及一个用于重新照明的基于涂鸦的模块。 为了训练重新照明模块,提出了一种新的涂鸦模拟程序来模拟真实用户的涂鸦,可以在没有任何人工注释的情况下进行训练。

通过定量和定性实验展示了高质量和灵活的肖像照明编辑能力。 用户研究与商业照明编辑工具的比较也证明了用户对方法的一致偏好。

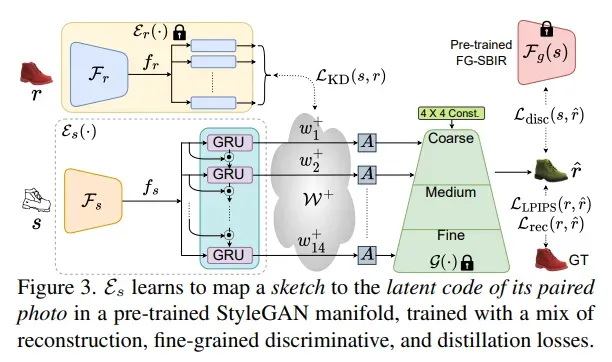

5、Picture that Sketch: Photorealistic Image Generation from Abstract Sketches

给定一个抽象的、变形的、普通的草图,这些草图来自像你我这样未经训练的业余爱好者,本文将它变成了一个逼真的图像。

与现有技术有很大的不同,因为一开始并不规定类似边缘图的草图,而是旨在使用抽象的徒手人体草图。 首先,提出一个解耦的编码器-解码器训练范例,其中解码器是仅在照片上训练的 StyleGAN。 这可确保生成的结果始终逼真。

剩下的就是如何最好地处理素描和照片之间的抽象差距。 为此,提出了一个在草图-照片对上训练的自回归草图映射器,将草图映射到 StyleGAN 潜在空间。 进一步介绍了具体的设计来解决人体草图的抽象性质,包括在经过训练的草图照片检索模型背后的细粒度判别损失,以及部分感知的草图增强策略。

最后,展示了我们的生成模型支持的一些下游任务,其中展示了如何将基于细粒度草图的图像检索简化为图像(生成)到图像检索任务。

项目页面:https://subhadeepkoley.github.io/PictureThatSketch

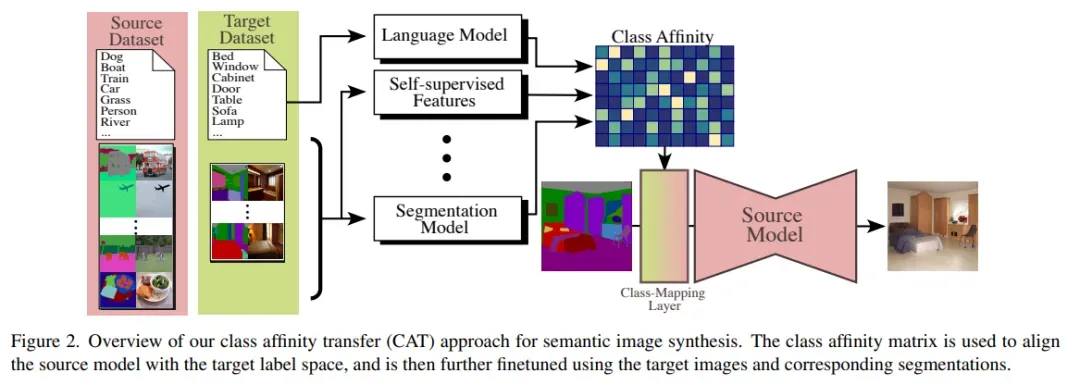

6、Few-shot Semantic Image Synthesis with Class Affinity Transfer

语义图像合成,旨在在给定语义分割图的情况下生成照片般逼真的图像。 尽管最近取得了很大进展,但训练它们仍然需要大量图像数据集,这些图像数据集用像素标签图进行标注,获取起来非常繁琐。

为了减轻标注成本,提出了一种迁移方法,该方法利用在大型源数据集上训练的模型,通过估计源类和目标类之间的成对关系来提高小型目标数据集的学习能力。 类亲和矩阵( class affinity matrix )作为源模型的第一层引入,使其与目标标签映射兼容,然后针对目标域进一步微调源模型。 为了估计类亲和力,考虑利用先验知识的不同方法:源域语义分割、文本标签嵌入和自监督视觉特征。

将方法应用于基于 GAN 和基于扩散的语义合成架构。 实验表明,可以有效地组合估计类亲和力的不同方法,并且改进了生成图像模型的现有最先进的转换方法。

二、GAN改进

7、CoralStyleCLIP: Co-optimized Region and Layer Selection for Image Editing

高保真编辑(Edit fidelity)是开放可控生成图像编辑中的一个重要问题。最近,基于clip的方法通过在StyleGAN的一个精心挑选的层中引入空间注意力来进行优化改进。

本文提出CoralStyleCLIP,它在StyleGAN2的特征空间中融合了多层注意力引导的混合策略,以获得高保真的编辑。提出了多种形式的共同区域优化和层选择策略,以展示时间复杂性随不同架构复杂性的编辑质量的变化,同时保持简单性。

进行了广泛的实验分析,并将方法与最先进的基于clip的方法进行了比较。研究结果表明,在保持易用性的同时,CoralStyleCLIP可以产生高质量的编辑。

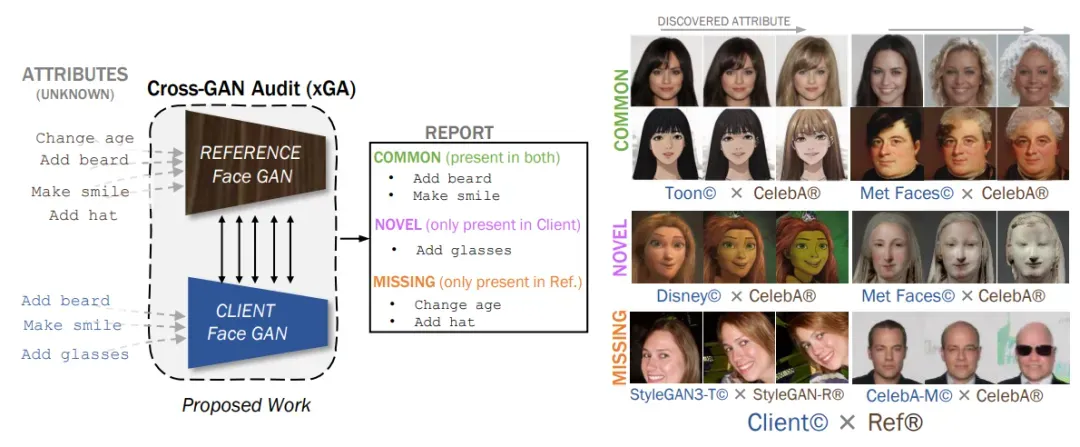

8、Cross-GAN Auditing: Unsupervised Identification of Attribute Level Similarities and Differences between Pretrained Generative Models

生成对抗网络(GAN)在训练复杂分布和数据量有限的情况下尤其难以训练。这促使需要一些工具以人类可读的格式审核已训练的网络,例如识别偏见或确保公平性。现有的GAN审核工具(GAN audit tools)仅限于基于总结统计量(如FID或召回率)的粗粒度模型数据比较。

本文提出了一种替代方法,即将新开发的GAN与之前的基线进行比较。为此,引入了跨GAN审核(Cross-GAN Auditing,xGA),给定一个已建立的“参考”GAN和一个新提出的“客户端”GAN,共同识别可理解的属性(intelligible attributes),这些属性在两个GAN中是相同的、客户端GAN中是新的、或缺少于客户端GAN中。

这为用户和模型开发人员提供了GAN之间相似性和差异的直观评估。引入新的指标来评估基于属性的GAN审核方法,并使用这些指标定量地证明xGA优于基线方法。还包括定性结果,展示了xGA从各种图像数据集上训练的GAN中识别出的常见、新颖和缺失属性。

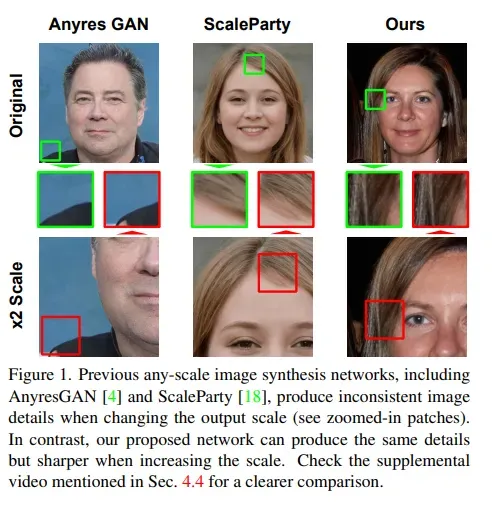

9、Efficient Scale-Invariant Generator with Column-Row Entangled Pixel Synthesis

任意尺寸图像生成(Any-scale image synthesis)提供了一种高效和可扩展的解决方案,可以在任何比例下合成逼真的图像,甚至超过2K分辨率。然而,现有的基于GAN的解决方案过度依赖卷积和分层架构,在缩放输出分辨率时会导致不一致和“纹理粘合”问题。

从另一个角度来看,基于INR的生成器从设计上具有尺度等变性,但它们巨大的内存占用和慢速推断阻碍了这些网络在大规模或实时系统中的采用。这项工作提出了列行耦合的像素生成(Column-Row Entangled Pixel Synthesis,CREPS),一种既高效又具有尺度等变性的新型生成模型,而不使用任何空间卷积或粗到细的设计。为了节省内存占用并使系统可扩展,采用了一种新的双线表示方法(bi-line representation),将层内特征映射分解为单独的“厚”列和行编码。

在各种数据集上的实验,包括FFHQ、LSUNChurch、MetFaces和Flickr-Scenery,证实了CREPS具有在任意任意分辨率下合成尺度一致图像的能力。代码在https://github.com/VinAIResearch/CREPS

文章出处登录后可见!