ChatGPT背景:

ChatGPT 是一种专注于对话生成的语言模型。它能够根据用户的文本输入,产生相应的智能回答。这个回答可以是简短的词语,也可以是长篇大论。其中GPT是Generative Pre-trained Transformer(生成型预训练变换模型)的缩写。

通过学习大量现成文本和对话集合(例如Wiki),ChatGPT能够像人类那样即时对话,流畅的回答各种问题。(当然回答速度比人还是慢一些)无论是英文还是其他语言(例如中文、韩语等),从回答历史问题,到写故事,甚至是撰写商业计划书和行业分析,“几乎”无所不能。甚至有程序员贴出了ChatGPT进行程序修改的对话。

ChatGPT也可以与其他AIGC模型联合使用,获得更加炫酷实用的功能。例如上面通过对话生成客厅设计图。这极大加强了AI应用与客户对话的能力,使我们看到了AI大规模落地的曙光。

ChatGPT特点

ChatGPT 是基于GPT-3.5(Generative Pre-trained Transformer 3.5)架构开发的对话AI模型,是InstructGPT 的兄弟模型。ChatGPT很可能是OpenAI 在GPT-4 正式推出之前的演练,或用于收集大量对话数据。

当然它还包括如下特征:

1)可以主动承认自身错误。若用户指出其错误,模型会听取意见并优化答案。

2)ChatGPT 可以质疑不正确的问题。例如被询问 “哥伦布 2015 年来到美国的情景” 的问题时,机器人会说明哥伦布不属于这一时代并调整输出结果。

3)ChatGPT 可以承认自身的无知,承认对专业技术的不了解。

4)支持连续多轮对话。

ChatGPT实现原理

1.数据集

ChatGPT的实现基于大规模的自然语言语料库,如维基百科、互联网论坛、新闻报道等。OpenAI通过使用Web爬虫和API获取了这些数据集,并对它们进行了预处理。这些数据集被用来训练ChatGPT的神经网络,以便生成自然语言文本。

2.模型架构

ChatGPT使用的是Transformer架构,它是一种基于注意力机制的神经网络模型。这种模型的优点在于,它可以并行化处理文本序列,并且能够捕捉序列中单词之间的长距离依赖关系。

Transformer模型的架构分为编码器和解码器两部分。在ChatGPT中,只有一个解码器,没有编码器。这是因为ChatGPT主要用于生成文本,而不是处理输入文本。

3.训练模型

在ChatGPT中,模型的训练是通过无监督的方式进行的。在训练过程中,模型的目标是最大化给定一段文本序列的概率。具体来说,模型的目标是预测下一个单词在给定上下文中出现的概率。

为了训练模型,OpenAI使用了一种称为“掩码语言建模”的技术。在掩码语言建模中,模型会随机将文本序列中的一些单词替换为特殊的掩码符号,然后根据上下文预测被掩码的单词。通过这种方式,模型可以学习到单词之间的关系,并生成自然语言文本。

4.生成文本

当ChatGPT训练完成后,就可以用于生成自然语言文本。生成文本的过程是通过向模型提供一些初始文本,然后模型会根据初始文本生成后续的文本。生成文本的过程使用的是基于采样的方法,即从模型预测的概率分布中随机采样。

5.Fine-tuning

除了在大规模的语料库上进行训练之外,ChatGPT还可以通过fine-tuning来适应特定的任务。在fine-tuning中,模型会通过使用特定的数据集进行有监督的训练。这样,模型就可以生成与特定任务相关的自然语言文本。比如,可以使用fine-tuning训练一个对话生成模型,使其能够生成与特定话题相关的对话。

6.多头注意力机制

Transformer模型中的多头注意力机制是ChatGPT实现原理的重要组成部分之一。这种机制可以让模型同时关注不同的位置,从而提高模型的性能。具体来说,多头注意力机制将输入分成多个子空间,每个子空间都有自己的注意力机制,从而可以并行计算。这样,模型可以关注不同子空间中的不同特征,从而提高模型的性能。

7.对抗训练

除了使用无监督的训练方式外,ChatGPT还使用了对抗训练技术来提高模型的鲁棒性。在对抗训练中,模型会与一个敌对模型进行对抗。敌对模型会生成一些文本序列,这些文本序列是有意识地设计成能够欺骗ChatGPT模型的。然后,ChatGPT会学习如何识别这些欺骗性的文本序列,并生成更为准确的文本。

ChatGPT使用感受:

近期我使用了ChatGPT后,发现这个所谓的人工智能其实是基于数据集的大数据运算而已,很简单例子,为什么它能够名声大振,一方面是因为代码,而许多已经常见的漏洞复现原理及代码在互联网上已经大批存在,因此当我们输入:生成log4j的漏洞执行脚本时,它会基于运算找到相关数据集,在后续训练中就会基于该数据集去拓展。

毋庸置疑的是它依然是人类发展的一大步,至少它带动了全球人工智能的发展。

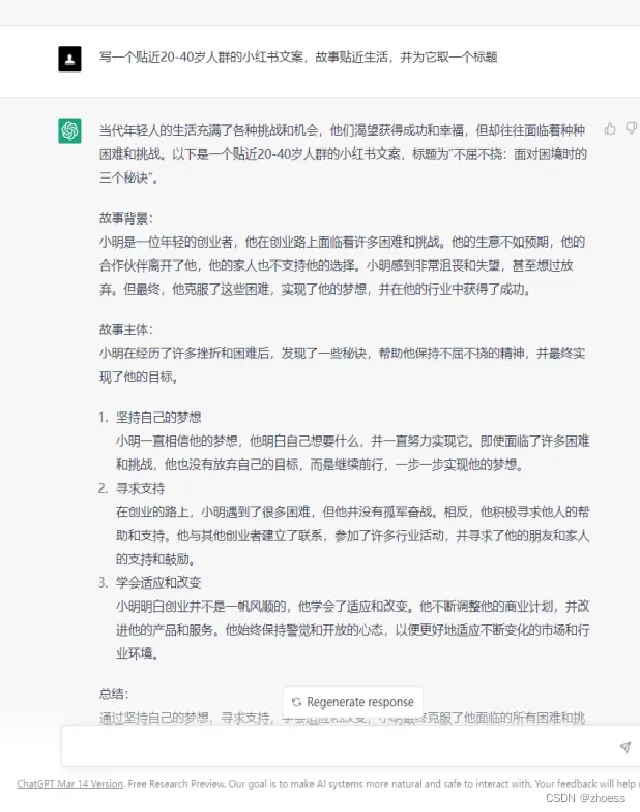

但他依然存在一些问题,例如你想让他去生成一个视频脚本或文案时,你需要将细节描述的特别清晰,不然它所生成的内容依旧是大众化俗套的。我不知道是不是因为语言的问题,但很明显,对于文字的创新性,它几乎为0的,可以很直观的看到 它所产生的文案几乎都是“烂大街的故事”

此处我已经提出了10余条细节点了,但依旧无法生成一个过得去的故事,包括故事的类型、故事的情节、故事需要具有曲折、故事贴近20-40岁人群、更贴近于生活、放大故事的细节等

文章出处登录后可见!