池化层是什么?

池化层是深度学习中常用的一种层级结构,它可以对输入数据进行降采样,减少数据量,同时保留重要的特征信息。池化层通常紧跟在卷积层之后,可以有效地减少数据量和计算复杂度,提高模型的训练速度和泛化能力。

池化层的结构

池化层的结构与卷积层类似,它也由多个滤波器组成,每个滤波器对输入数据进行卷积操作,得到一个输出特征图。不同的是,池化层的卷积操作通常不使用权重参数,而是使用一种固定的池化函数,例如最大池化、平均池化等。

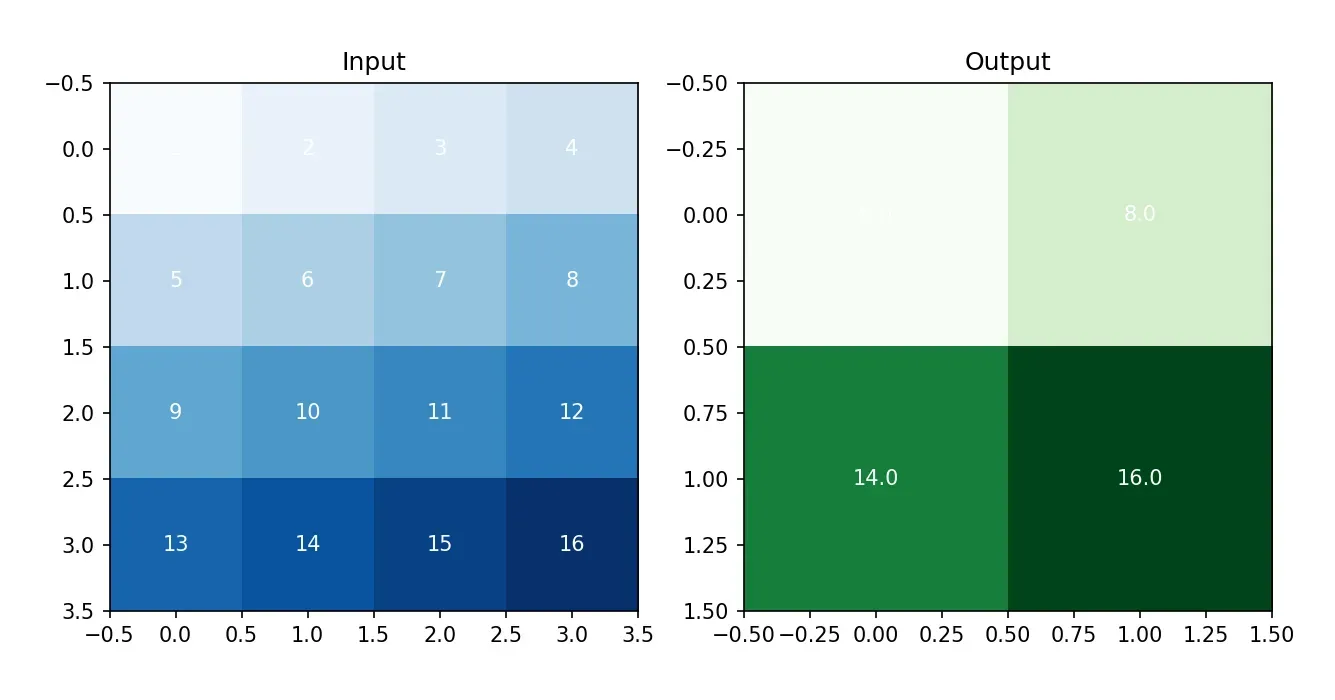

以下是池化层的结构图:

池化层的应用

池化层主要用于减少数据量和计算复杂度,同时保留重要的特征信息。它可以提高模型的训练速度和泛化能力,避免过拟合等问题。具体应用包括:

- 图像分类:在卷积神经网络中,池化层常用于减少图像特征的维度,从而提高分类的准确率和速度。

- 目标检测:在目标检测中,池化层可以对特征图进行降采样,从而提高检测的速度和精度。

- 语音识别:在语音识别中,池化层可以降低声学特征的维度,从而提高识别的准确率和速度。

池化层的实现

在PyTorch中,可以使用nn.MaxPool2d和nn.AvgPool2d等函数实现最大池化和平均池化操作。以下是一个简单的例子:

import torch.nn as nn

# 定义一个池化层,使用最大池化函数,池化核大小为2x2,步长为2

pool = nn.MaxPool2d(kernel_size=2, stride=2)

# 输入特征图大小为[batch_size, channels, height, width]

input_tensor = torch.randn(1, 3, 28, 28)

# 对输入特征图进行池化操作

output_tensor = pool(input_tensor)

# 输出特征图大小为[batch_size, channels, height/2, width/2]

print(output_tensor.size())

以上代码定义了一个最大池化层,输入特征图大小为[1, 3, 28, 28],输出特征图大小为[1, 3, 14, 14],即将输入特征图的大小降低了一半。

池化层的理论推导

池化层的理论推导与卷积层类似,都是通过卷积操作对输入数据进行处理,得到输出特征图。以下是最大池化和平均池化的推导过程。

最大池化

最大池化是指对输入数据中每个区域内的最大值进行池化操作,得到输出特征图。以下是最大池化的推导过程:

- 定义输入数据和池化核大小

假设输入数据为,池化核大小为

,步长为

。

- 定义输出特征图

输出特征图的大小为:

- 定义最大池化函数

最大池化函数的定义为:

其中。

- 计算输出特征图

将最大池化函数应用于输入数据的每个区域,得到输出特征图

:

其中。

平均池化

平均池化是指对输入数据中每个区域内的平均值进行池化操作,得到输出特征图。以下是平均池化的推导过程:

- 定义输入数据和池化核大小

假设输入数据为,池化核大小为

,步长为

。

- 定义输出特征图

输出特征图的大小为:

- 定义平均池化函数

平均池化函数的定义为:

其中。

- 计算输出特征图

将平均池化函数应用于输入数据的每个区域,得到输出特征图

:

其中。

池化层的计算步骤

以下是最大池化和平均池化的计算步骤。

最大池化

假设输入数据为,池化核大小为

,步长为

。

- 定义输出特征图大小

输出特征图的大小为:

- 定义输出特征图

初始化输出特征图为

。

- 计算输出特征图

对于每个输出特征图的位置,计算输入数据

中对应区域内的最大值,得到输出特征图

:

其中。

平均池化

假设输入数据为,池化核大小为

,步长为

。

- 定义输出特征图大小

输出特征图的大小为:

- 定义输出特征图

初始化输出特征图为

。

- 计算输出特征图

对于每个输出特征图的位置,计算输入数据

中对应区域内的平均值,得到输出特征图

:

其中。

希望以上内容能够帮助您理解池化层的概念和应用,如有疑问请随时提出。

文章出处登录后可见!