1 自我介绍

- 背景介绍

- 实习介绍

- 项目介绍

- 自我评估

2 面试官问答

1.介绍一下常用的激活函数

参考【常用激活函数】

2. ReLU相对Sigmoid有什么优势

- 解决了梯度消失、爆炸的问题。它在x>0时不存在饱和问题,从而使保持梯度不衰减,从而解决了梯度消失问题。这让我们能够直接以监督的方式训练深度神经网络,而无需依赖无监督的逐层预训练。

- 计算简单,计算速度快

- 加速网络的训练

参考【常用激活函数】

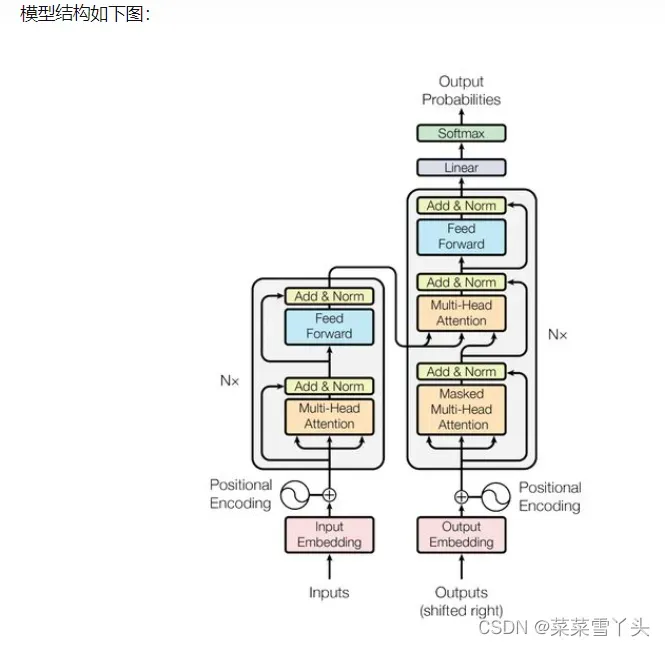

3. 介绍一下Transformer的结构

参照【Attention机制讲解】

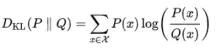

4. 介绍一下KL散度

KL散度( Kullback–Leibler divergence),又称相对熵(relative entropy),是描述两个概率分布P和Q差异的一种方法。

它是非对称的,这意味着D(P||Q) ≠ D(Q||P)。

机器学习领域的物理意义是衡量两个函数的相似度或相似度。

取值范围:,当两个分布接近相同的时候KL散度取值为0,当两个分布差异越来越大的时候KL散度值就会越来越大。当 p(x) 和 q(x) 的相似度越高,KL散度越小。

5. 有没有机器学习的相关项目经验

由于我是做知识图谱方向的,项目也是,可能不符合工作要求,所以有人问我有什么机器学习方向的项目,我回答说只是一个项目之前复制了太多标签分类,只需输入标签,即可实现正确分类。然后他没有再问任何问题。其实那个时候他做了很多事情,只是他看了半天就忘了💔所以大家还是需要回顾一下比较有用的项目。

3 笔试

Leetcode 3. 无重复字符的最长子串

文章出处登录后可见!

已经登录?立即刷新