1.过拟合总结

1.造成过拟合的原因:

①.训练集太少,导致无法训练出能够泛化新数据的模型。

②.训练集和测试集的数据分布不一致。

③.模型本身特别复杂,深度太大。

2.解决过拟合的方法:

①针对训练集太少,可以增加训练数据。

②针对模型复杂,可以降低模型复杂度。

③权重正则化,这是解决过拟合的常用方法。

④dropout正则化,迭代过程中,随机丢弃神经网络的神经元。

⑤early stop,训练过程中,如果训练误差继续减小,但测试误差已经开始增加,此时停止训练。

⑥BN,在每层之间加上神经元的权重调成正态分布的正则化层。

⑦数据增强,从现有的数据中生成更多的训练样本。

2.在小型数据集上从头开始训练一个卷积神经网络

步骤:

①下载数据集,并创建训练集、验证集和测试集的文件夹

②数据预处理:将数据输入神经网络之前,需要将数据格式化为经过预处理的浮点数张量。读取数据,将文件解码为RGB网格像素,再转化为浮点数张量,最后将像素缩放到【0-1】之间,因为神经网络喜欢处理较小的数据。

③构建网络结构:根据数据集的大小适当调整网络的大小。网络中特征图的深度在逐渐增大,而特征图的尺寸在逐渐减小,这几乎是所有卷积神经网络结构的模式

④训练并保存模型(如果结果出现过拟合,可以针对不同情况对数据进行数据增强等,再保存模型)

因为深度学习学到的特征在不同问题之间具有可移植性,所以我们以上训练的网络可以应用于某个不相干的任务。由于每个任务又有所不同,不可能用完全一样的网络结构,所以就有了使用预训练网络的方法。

预训练网络包括特征提取和微调模型。

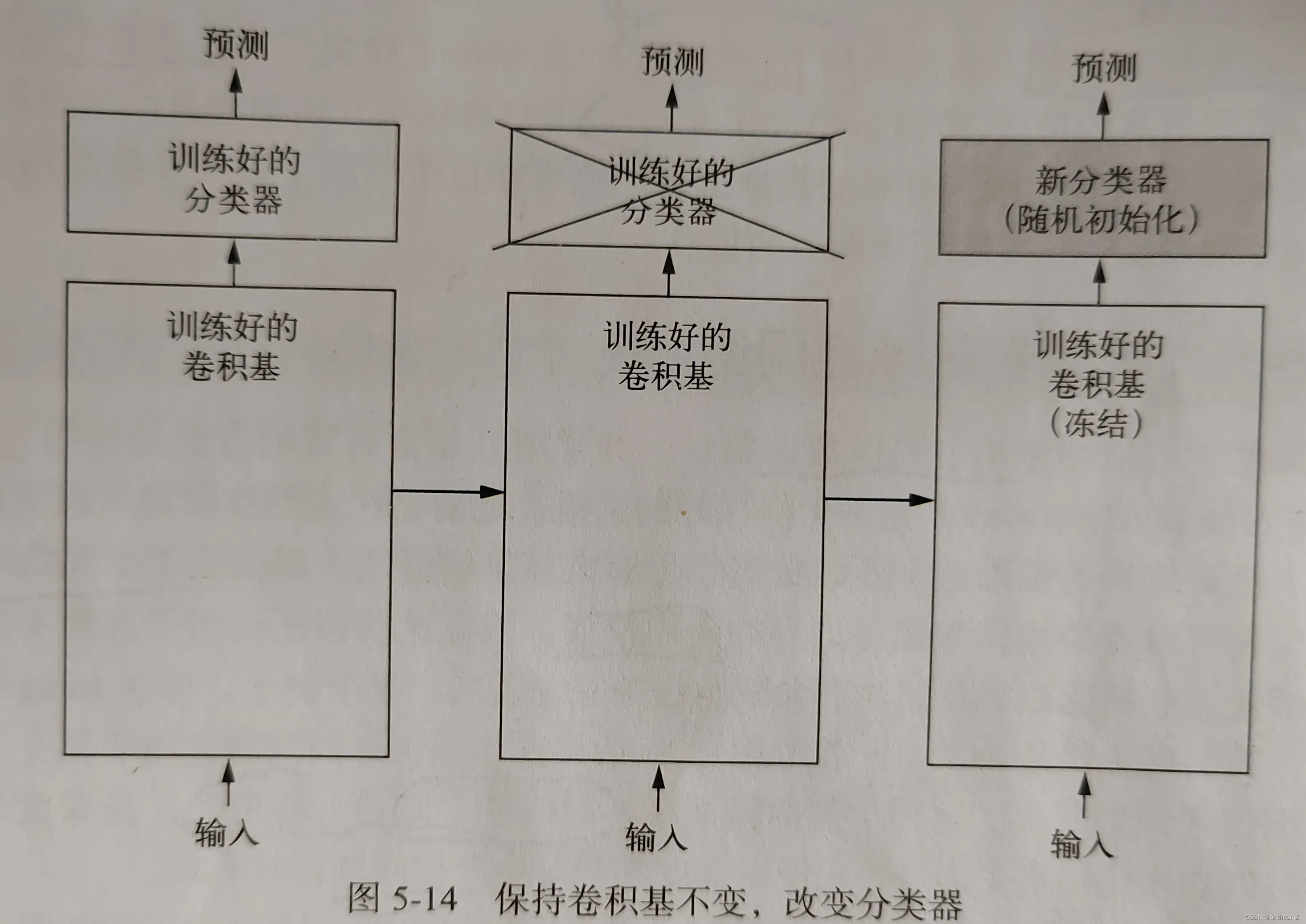

特征提取:在神经网络结构中,负责特征提取的层是卷积层和池化层,我们把这部分叫作模型的卷积基。特征提取就是使用之前训练好的卷积基,在改变全连接层(分类器)。

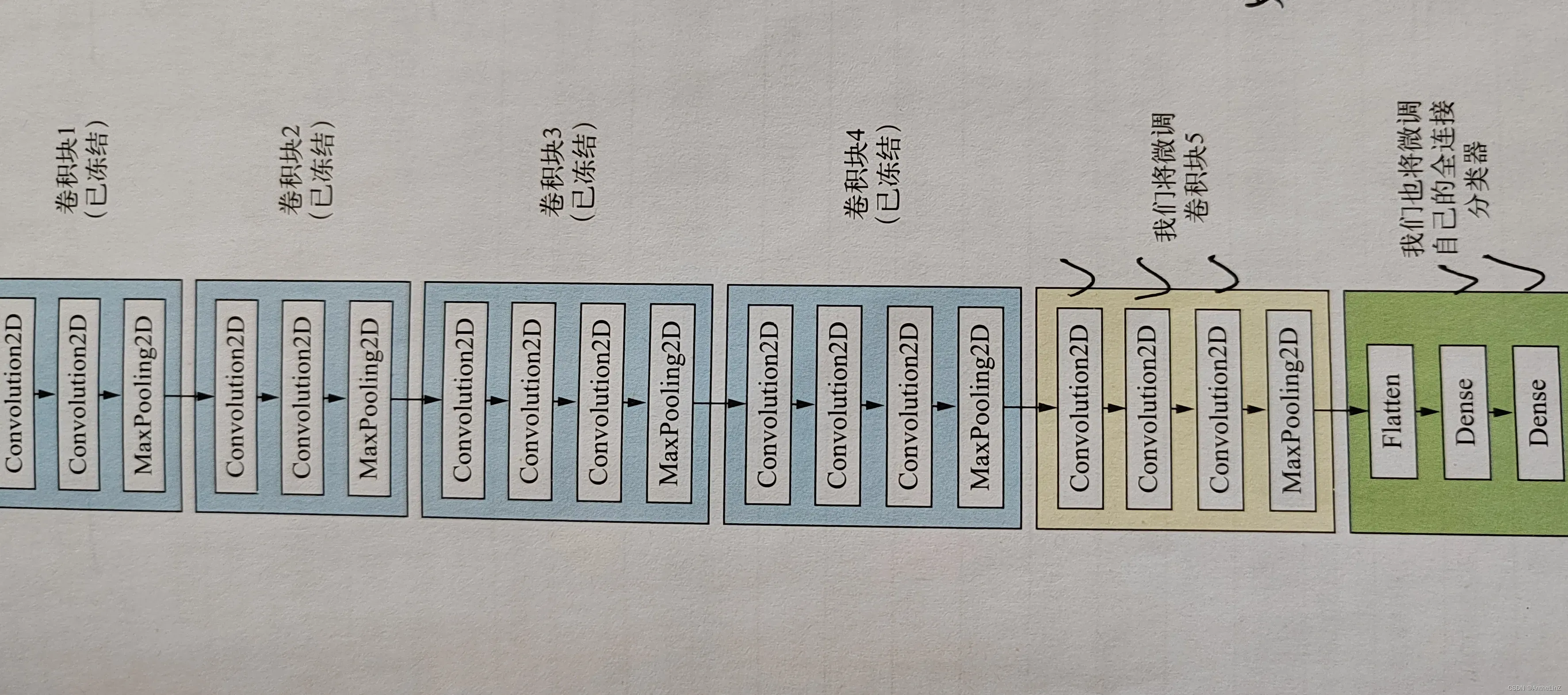

微调模型:与特征提取互为补充,微调是指将用于特征提取的模型基进行冻结,其顶部的几层“解冻”,并将解冻的几层和新增的部分联合训练。

微调的步骤:

①在训练好的基网络上添加自定义的网络

②冻结基网络

③训练添加的部分

④解冻基网络的一些层

⑤联合训练解冻的这些层和添加的部分

顶部:可复用特征

底部:专业化特征

完整代码:

# 在小型数据集上从头开始训练一个卷积神经网络

import os # 对文件,文件夹执行操作的一个模块。

import shutil # 复制文件内容,创建文件的新副本并进行归档

# 原始数据集解压目录

original_dataset_dir = 'F:/dogs_vs_cats/kaggle/train'

# 创建新的数据集,将包含三个子集

base_dir = 'F:\dogs_vs_cats\cats_and_dogs_small6'

os.mkdir(base_dir) # 创建目录

# 创建训练集

train_dir = os.path.join(base_dir, 'train') # 连接两个或更多的路径名组件

os.mkdir(train_dir) # 创建目录

# 创建验证集

validation_dir = os.path.join(base_dir, 'validation')

os.mkdir(validation_dir)

# 创建测试集

test_dir = os.path.join(base_dir, 'test')

os.mkdir(test_dir)

# 创建猫的训练图像目录

train_cats_dir = os.path.join(train_dir, 'cats')

os.mkdir(train_cats_dir)

# 创建狗的训练图像目录

train_dogs_dir = os.path.join(train_dir, 'dogs')

os.mkdir(train_dogs_dir)

# 创建猫的验证图像目录

validation_cats_dir = os.path.join(validation_dir, 'cats')

os.mkdir(validation_cats_dir)

# 创建狗的验证图像目录

validation_dogs_dir = os.path.join(validation_dir, 'dogs')

os.mkdir(validation_dogs_dir)

# 创建猫的测试图像目录

test_cats_dir = os.path.join(test_dir, 'cats')

os.mkdir(test_cats_dir)

# 创建狗的测试图像目录

test_dogs_dir = os.path.join(test_dir, 'dogs')

os.mkdir(test_dogs_dir)

# 将前1000张猫的图像复制到train_cats_dir

fnames = ['cat.{}.jpg'.format(i) for i in range(1000)]

for fname in fnames:

src = os.path.join(original_dataset_dir, fname)

dst = os.path.join(train_cats_dir, fname)

shutil.copyfile(src, dst)

# 接下来分别将500张猫的图像复制到validation_cats_dir和test_cats_dir,代码同上

fnames = ['cat.{}.jpg'.format(i) for i in range(1000, 1500)]

for fname in fnames:

src = os.path.join(original_dataset_dir, fname)

dst = os.path.join(validation_cats_dir, fname)

shutil.copyfile(src, dst)

fnames = ['cat.{}.jpg'.format(i) for i in range(1500, 2000)]

for fname in fnames:

src = os.path.join(original_dataset_dir, fname)

dst = os.path.join(test_cats_dir, fname)

shutil.copyfile(src, dst)

# 接下来是按照上面复制猫的图像方法把狗的图像划分开

fnames = ['dog.{}.jpg'.format(i) for i in range(1000)]

for fname in fnames:

src = os.path.join(original_dataset_dir, fname)

dst = os.path.join(train_dogs_dir, fname)

shutil.copyfile(src, dst)

fnames = ['dog.{}.jpg'.format(i) for i in range(1000, 1500)]

for fname in fnames:

src = os.path.join(original_dataset_dir, fname)

dst = os.path.join(validation_dogs_dir, fname)

shutil.copyfile(src, dst)

fnames = ['dog.{}.jpg'.format(i) for i in range(1500, 2000)]

for fname in fnames:

src = os.path.join(original_dataset_dir, fname)

dst = os.path.join(test_dogs_dir, fname)

shutil.copyfile(src, dst)

# 构建网络,实例化猫狗分类的小卷积神经网络

from keras import layers

from keras import models

model = models.Sequential()

model.add(layers.Conv2D(32, (3, 3), activation='relu', input_shape=(150, 150, 3)))

model.add(layers.MaxPooling2D((2, 2)))

model.add(layers.Conv2D(64, (3, 3), activation='relu'))

model.add(layers.MaxPooling2D((2, 2)))

model.add(layers.Conv2D(128, (3, 3), activation='relu'))

model.add(layers.MaxPooling2D((2, 2)))

model.add(layers.Conv2D(128, (3, 3), activation='relu'))

model.add(layers.MaxPooling2D((2, 2)))

model.add(layers.Flatten())

model.add(layers.Dense(512, activation='relu'))

model.add(layers.Dense(1, activation='sigmoid'))

# 配置模型用于训练

from tensorflow.keras import optimizers

model.compile(loss='binary_crossentropy',

optimizer=optimizers.RMSprop(learning_rate=1e-4),

metrics=['acc'])

print(model.summary())

# 数据预处理

# 数据以 JPEG 文件的形式保存在硬盘中,所以数据预处理步骤大致如下。

# (1) 读取图像文件。

# (2) 将 JPEG 文件解码为 RGB 像素网格。

# (3) 将这些像素网格转换为浮点数张量。

# (4) 将像素值(0~255 范围内)缩放到 [0, 1] 区间(正如你所知,神经网络喜欢处理#较小的输

# 入值)。

# keras可以自动完成这些处理步骤,在keras.preprocessing.image的ImageDataGenerator类中

from keras.preprocessing.image import ImageDataGenerator

train_datagen = ImageDataGenerator(rescale=1. / 255)

test_datagen = ImageDataGenerator(rescale=1. / 255) # 将所有图像缩小255倍,在0-1之间

# flow_from_directory(): 获取图像路径,生成批量增强数据。该方法只需指定数据所在的路径,而无需输入numpy形式的数据,

# 也无需输入标签值,会自动返回对应的标签值

train_generator = train_datagen.flow_from_directory(train_dir, # 目标目录

target_size=(150, 150), # 调整图像大小为150*150

batch_size=20,

class_mode='binary') # 使用了binary_corssentropy损失,所以用二进制标签

validation_generator = test_datagen.flow_from_directory(validation_dir, # 目标目录

target_size=(150, 150), # 调整图像大小为150*150

batch_size=20,

class_mode='binary') # 使用了binary_corssentropy损失,所以用二进制标签

# 利用批量生成器拟合模型

history = model.fit(

train_generator,

steps_per_epoch=100, # 从生成器中抽取steps_per_epoch个批量后(即运行了steps_per_epoch次梯度下降),拟合进入到下一轮次

epochs=30,

validation_data=validation_generator,

validation_steps=50) # 从验证生成器中抽取多少个批次用于评估

# 保存模型

model.save('cats_and_dogs_small_1.h5') # 以后可以用这个模型训练新数据

# 绘制训练过程中的损失曲线和精度曲线

import matplotlib.pyplot as plt

acc = history.history['acc']

val_acc = history.history['val_acc']

loss = history.history['loss']

val_loss = history.history['val_loss']

epochs = range(1, len(acc) + 1)

plt.plot(epochs, acc, 'bo', label='Training acc')

plt.plot(epochs, val_acc, 'b', label='Validation acc')

plt.title('Training and validation accuracy')

plt.legend()

plt.figure()

plt.plot(epochs, loss, 'bo', label='Training loss')

plt.plot(epochs, val_loss, 'b', label='Validation loss')

plt.title('Training and validation loss')

plt.legend()

plt.show()

# 利用ImageDataGenerator来设置数据增强

from keras.preprocessing.image import ImageDataGenerator

datagen = ImageDataGenerator(rotation_range=40, # 旋转

width_shift_range=0.2, # 左右平移

height_shift_range=0.2, # 上下平移

shear_range=0.2, # 错切变换

zoom_range=0.2, # 缩放变换

horizontal_flip=True, # 水平翻转

fill_mode='nearest') # 填充

# 显示几个随机增强后的训练图像

# from keras.preprocessing import image

import matplotlib.pyplot as plt

#

# fnames = [os.path.join(train_cats_dir, fname) for fname in os.listdir(train_cats_dir)] # 返回指定路径下的文件和文件夹列表

# img_path = fnames[3] # 编号为3的图片

# img = image.load_img(img_path, target_size=(150, 150)) # 读取图像并调整图像大小

# x = image.img_to_array(img) # 将其转换为形状(150,150,3)的numpy数组

# x = x.reshape((1,) + x.shape) # 将其形状改变为(1,150,150,3),原来的行踪前面加1,1为变换

#

# i = 0

# for batch in datagen.flow(x, batch_size=2):

# plt.figure(i)

#

# imgplot = plt.imshow(image.array_to_img(batch[0]))

# i += 1

# if i % 4 == 0:

# break

# plt.show()

# 定义一个包含dropout的新卷积神经网络

from keras import layers

from keras import models

model = models.Sequential()

model.add(layers.Conv2D(32, (3, 3), activation='relu', input_shape=(150, 150, 3)))

model.add(layers.MaxPooling2D((2, 2)))

model.add(layers.Conv2D(64, (3, 3), activation='relu'))

model.add(layers.MaxPooling2D((2, 2)))

model.add(layers.Conv2D(128, (3, 3), activation='relu'))

model.add(layers.MaxPooling2D((2, 2)))

model.add(layers.Conv2D(128, (3, 3), activation='relu'))

model.add(layers.MaxPooling2D((2, 2)))

model.add(layers.Flatten())

model.add(layers.Dropout(0.5))

model.add(layers.Dense(512, activation='relu'))

model.add(layers.Dense(1, activation='sigmoid'))

from tensorflow.keras import optimizers

model.compile(loss='binary_crossentropy',

optimizer=optimizers.RMSprop(lr=1e-4),

metrics=['acc'])

# 使用数据增强,只对训练数据进行增强,测试数据不进行增强

from keras.preprocessing.image import ImageDataGenerator

train_datagen = ImageDataGenerator(rescale=1. / 255,

rotation_range=40,

width_shift_range=0.2,

height_shift_range=0.2,

shear_range=0.2,

zoom_range=0.2,

horizontal_flip=True, )

test_datagen = ImageDataGenerator(rescale=1. / 255) # 将所有图像缩小255倍,在0-1之间

train_generator = train_datagen.flow_from_directory(train_dir, # 目标目录

target_size=(150, 150), # 调整图像大小为150*150

batch_size=20,

class_mode='binary') # 使用了binary_corssentropy损失,所以用二进制标签

validation_generator = test_datagen.flow_from_directory(validation_dir, # 目标目录

target_size=(150, 150), # 调整图像大小为150*150

batch_size=20,

class_mode='binary') # 使用了binary_corssentropy损失,所以用二进制标签

history = model.fit(

train_generator,

steps_per_epoch=100, # 从生成器中抽取steps_per_epoch个批量后(即运行了steps_per_epoch次梯度下降),拟合进入到下一轮次

epochs=20,

validation_data=validation_generator,

validation_steps=50) # 从验证生成器中抽取多少个批次用于评估

acc = history.history['acc']

val_acc = history.history['val_acc']

loss = history.history['loss']

val_loss = history.history['val_loss']

epochs = range(1, len(acc) + 1)

plt.plot(epochs, acc, 'bo', label='Training acc')

plt.plot(epochs, val_acc, 'b', label='Validation acc')

plt.title('Training and validation accuracy')

plt.legend()

plt.figure()

plt.plot(epochs, loss, 'bo', label='Training loss')

plt.plot(epochs, val_loss, 'b', label='Validation loss')

plt.title('Training and validation loss')

plt.legend()

plt.show()文章出处登录后可见!