线性回归

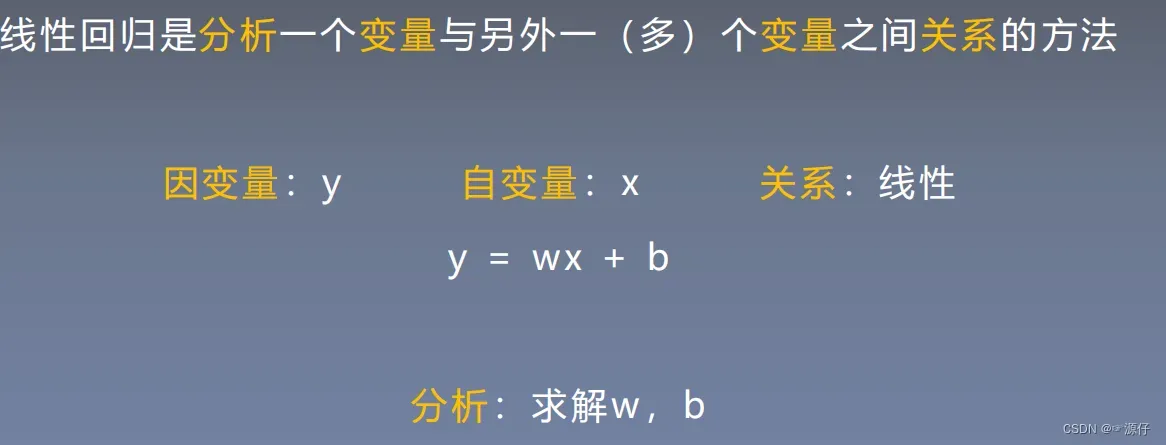

什么是线性回归 ?

线性回归是分析一个变量与另外一(多)个变量之间关系的方法

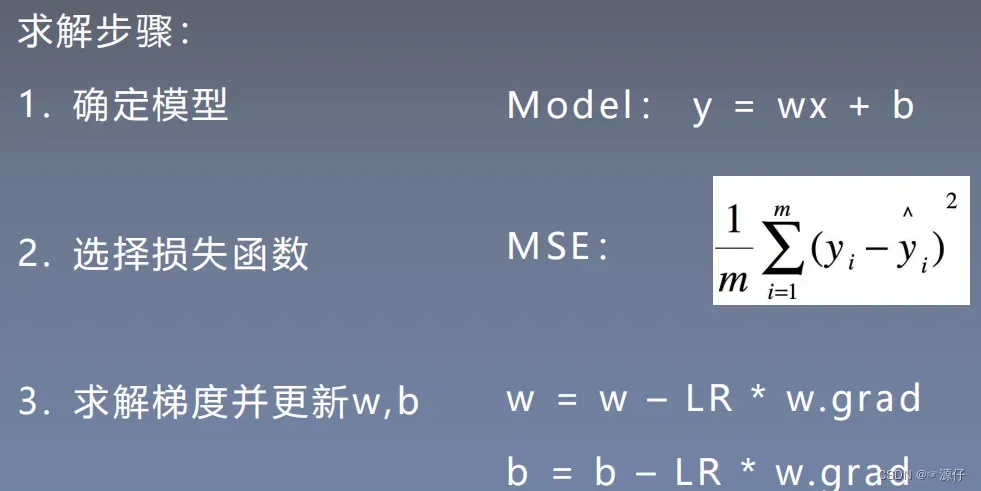

线性回归求解步骤

代码实现

import torch

import matplotlib.pyplot as plt

torch.manual_seed(10)

lr = 0.05 # 学习率 20191015修改

# 创建训练数据

x = torch.rand(20, 1) * 10 # x data (tensor), shape=(20, 1)

y = 2*x + (5 + torch.randn(20, 1)) # y data (tensor), shape=(20, 1)# torch.randn(20, 1)是加一些噪声。

# 构建线性回归参数

w = torch.randn((1), requires_grad=True) # w随机初始化并服从标准正态分布

b = torch.zeros((1), requires_grad=True)

for iteration in range(1000):

# 前向传播

wx = torch.mul(w, x)

y_pred = torch.add(wx, b)

# 计算 MSE loss

loss = (0.5 * (y - y_pred) ** 2).mean()

# 反向传播

loss.backward() # 自动求导函数,得到梯度

# 更新参数

b.data.sub_(lr * b.grad) # grad:是用来存储梯度的

w.data.sub_(lr * w.grad)

# 清零张量的梯度 20191015增加

w.grad.zero_()

b.grad.zero_()

# 绘图

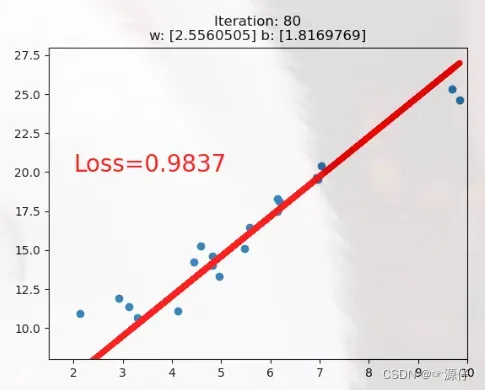

if iteration % 20 == 0:

plt.cla() # 防止社区版可视化时模型重叠2020-12-15

plt.scatter(x.data.numpy(), y.data.numpy())

plt.plot(x.data.numpy(), y_pred.data.numpy(), 'r-', lw=5)

plt.text(2, 20, 'Loss=%.4f' % loss.data.numpy(), fontdict={'size': 20, 'color': 'red'})

plt.xlim(1.5, 10)

plt.ylim(8, 28)

plt.title("Iteration: {}\nw: {} b: {}".format(iteration, w.data.numpy(), b.data.numpy()))

plt.pause(0.5)

# loss小于1时停止更新

if loss.data.numpy() < 1:

break

plt.show()

OUT:

文章出处登录后可见!

已经登录?立即刷新