文章目录

机器学习是计算机基于数据构建概率统计模型并运用模型对数据进行预测和分析的学科

根据输入输出类型的不同,机器学习分为:分类问题,回归问题,标注问题三类

过拟合是机器学习中不可避免的,可通过选择合适的模型降低影响

监督学习是机器学习的主流任务,包括生成方法和判别方法两类

1.1 机器学习概念

1.1.1 定义

人类学习机制:从大量现象中提取反复出现的规律与模式

A computer sprogram is said to learn from E with respect to some class of tasks T and performance measure P ,if its performance at tasks T as measured by P improves with experience E.

形式化角度:如果算法利用某些经验,使自身在特定任务类上的性能得到改善,则认为该算法实现了人工智能

机器角度:计算机系统通过运用数据及统计方法提高系统性能

方法论角度:机器学习是 计算机基于数据构建概率统计模型,并 运用该模型对数据进行预测与分析 的学科

- 所有模型都是错的,但有一些是有用的

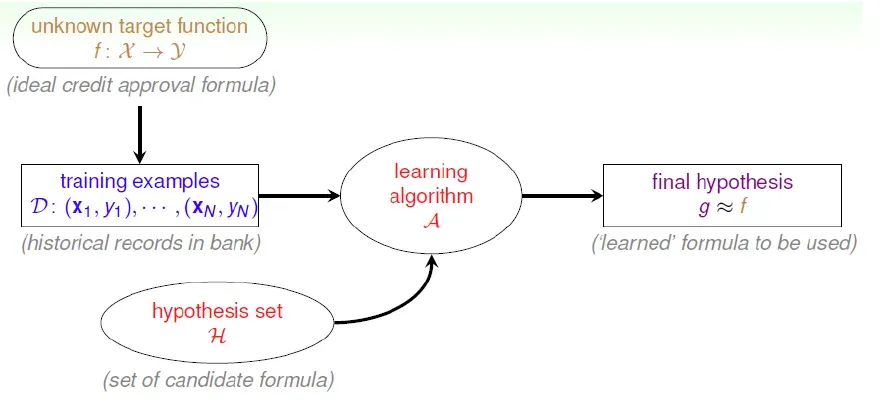

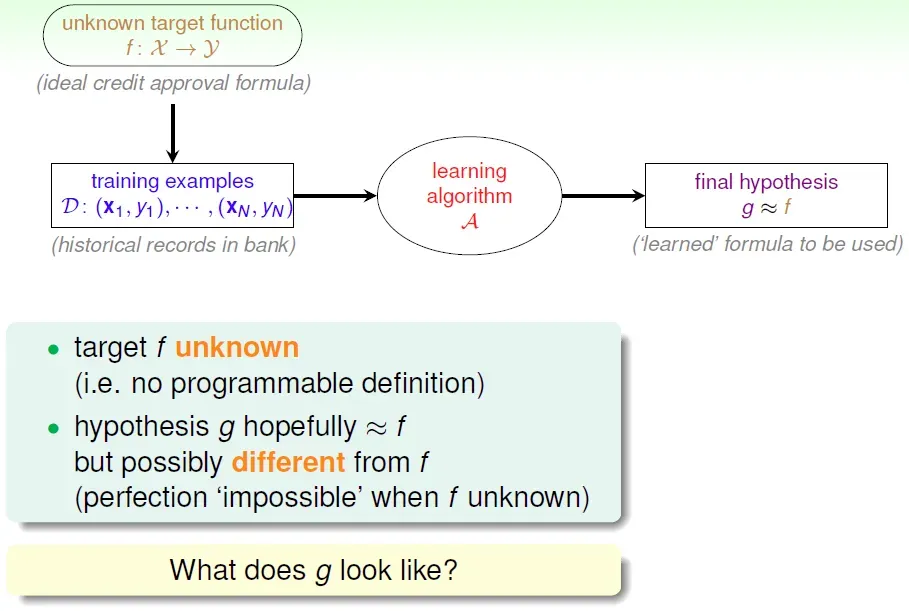

Learning algorithm运用数据计算想假设空间 中的

用以近似

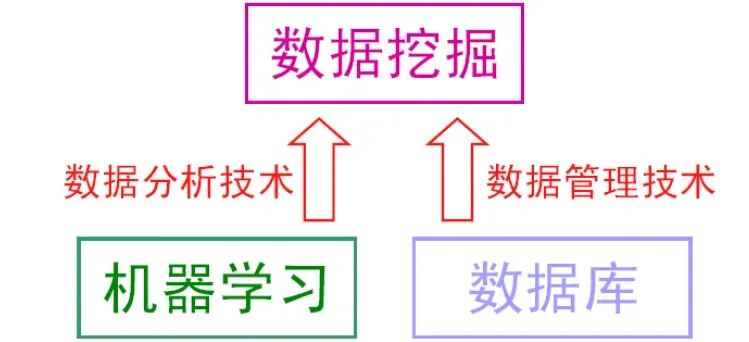

统计机器学习与数据挖掘区别

数据挖掘:运用机器学习的数据分析方法来分析海量数据,由数据库提供的技术管理海量数据

机器学习前提

可判别任务 是否使用

存在需学习的模型

没有明确可定义的规则

有某种形式的数据供学习

1.1.2 术语

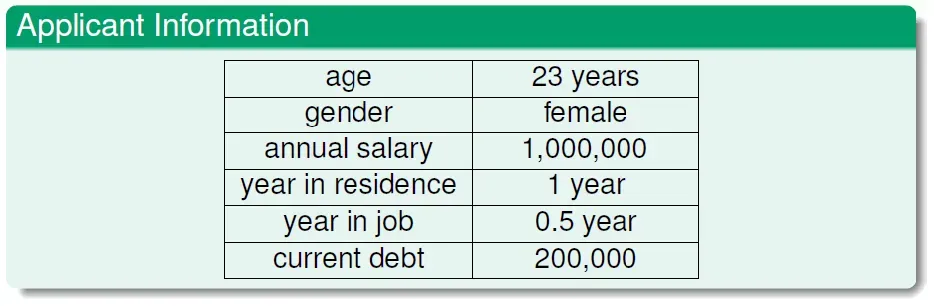

数据(实例):对对象某些性质的描述,不同的属性值有序排列得到的向量

- 属性:被描述的性质

- 属性值:属性的取值

不同的属性之间视为相互独立,每个属性都代表了不同的维度,这些属性共同张成了 特征空间

每个实例(数据)都可以看做特征空间中的一个向量—— 特征向量

1.1.3 特点

- 以计算机及网络为平台

- 以数据为研究对象

- 目的是对数据进行分析和预测

- 以方法为中心:基于数据构建模型

- 交叉学科

以数据为研究对象

提取数据特征,抽象为模型。利用模型对未知数据进行分析预测

前提:同类数据有一定统计规律,可以用概率统计的方法处理

目标

机器学习目标:根据已有的训练数据推导出所有数据的模型,并根据得出的模型实现对未知测试数据的最优预测

总目标:学习什么样的模型,如何构建模型

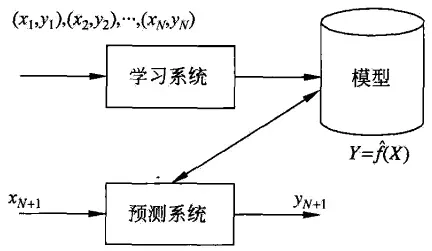

方法——基于数据构建模型

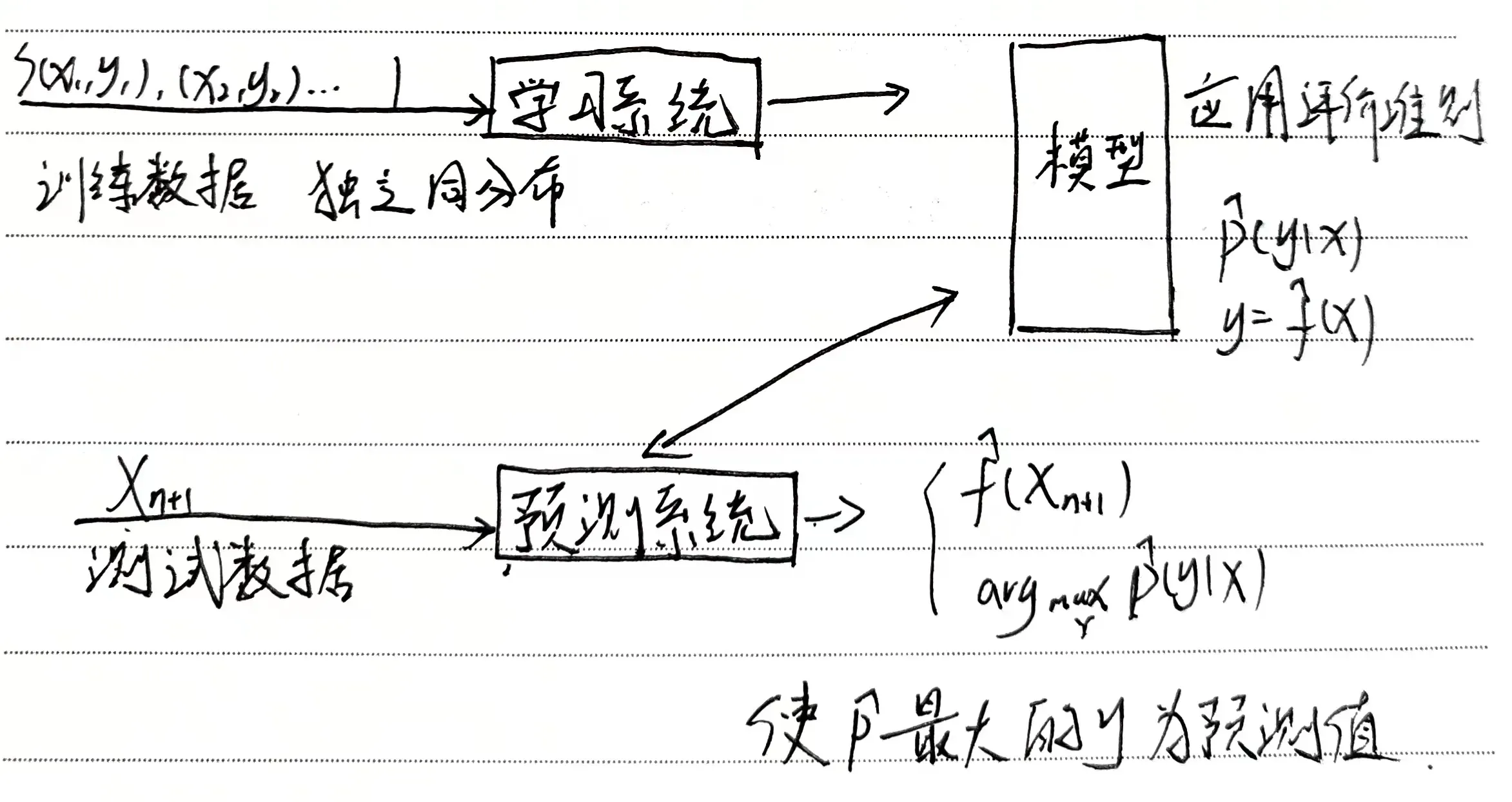

从给定的、有限的、用于学习的训练数据集(Training data)出发,且训练集中的数据具有一定的统计特性,可以视为满足 独立同分布 的样本。

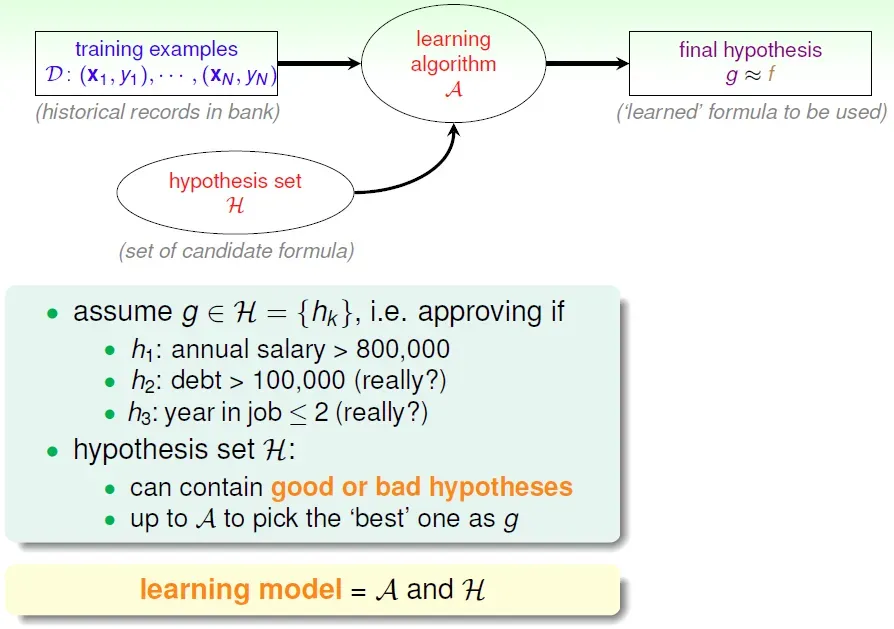

假设待学习的模型属于某个函数集合——假设空间(Hypothesis space)

应用某个评价准则(Evaluation criterion)——风险最小

通过算法(Algorithm)选取一个最优化模型

使它在已知的训练集和测试集上在给定的评价标准下有最优预测

SML三要素

模型Model:from Hypothesis space

策略Strategy:evaluation criterion

算法Algorithm:调参过程

SML步骤

- 得到有限的训练数据集合

- 确定学习模型的集合——Model

- 确定模型选择的准则(评价准则)——Strategy 风险

- 实现最优模型求解算法——Algorithm 最优化理论

- 运行算法

最优化模型

- 预测新数据,分析

eg

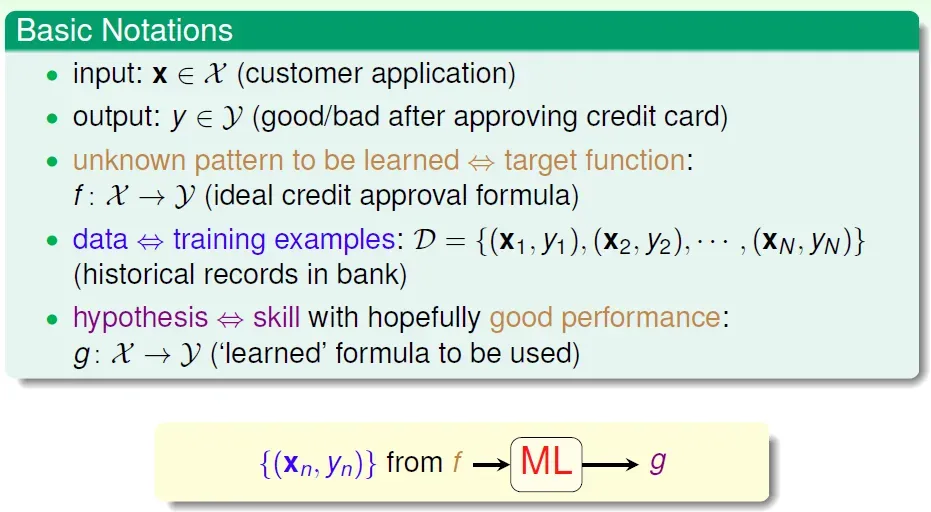

需要学习的未知潜藏模式:批准信用卡是否对银行有利(good/bad)

1.2 分类

1.2.1 参数化/非参数化方法

参数化:假设模型的参数维度固定

- 感知机

- 朴素贝叶斯

- 逻辑斯蒂回归

- K均值

- 高斯混合模型

非参数化:参数维度不固定,随数据量的增加而增加

- 决策树

- Adaboosting

- K近邻

- 语义分析

- 潜在狄利克雷分配

1.2.2 按算法分类

在线学习:一次一个数据,动态调整模型

- 接收一个输入

,用已知模型给出

后,得到反馈

- 系统用损失函数计算

与

的差异,更新模型

批量学习:一次所有数据,学习模型

随机梯度下降感知机

10个数据,

1.2.3 按模型分类

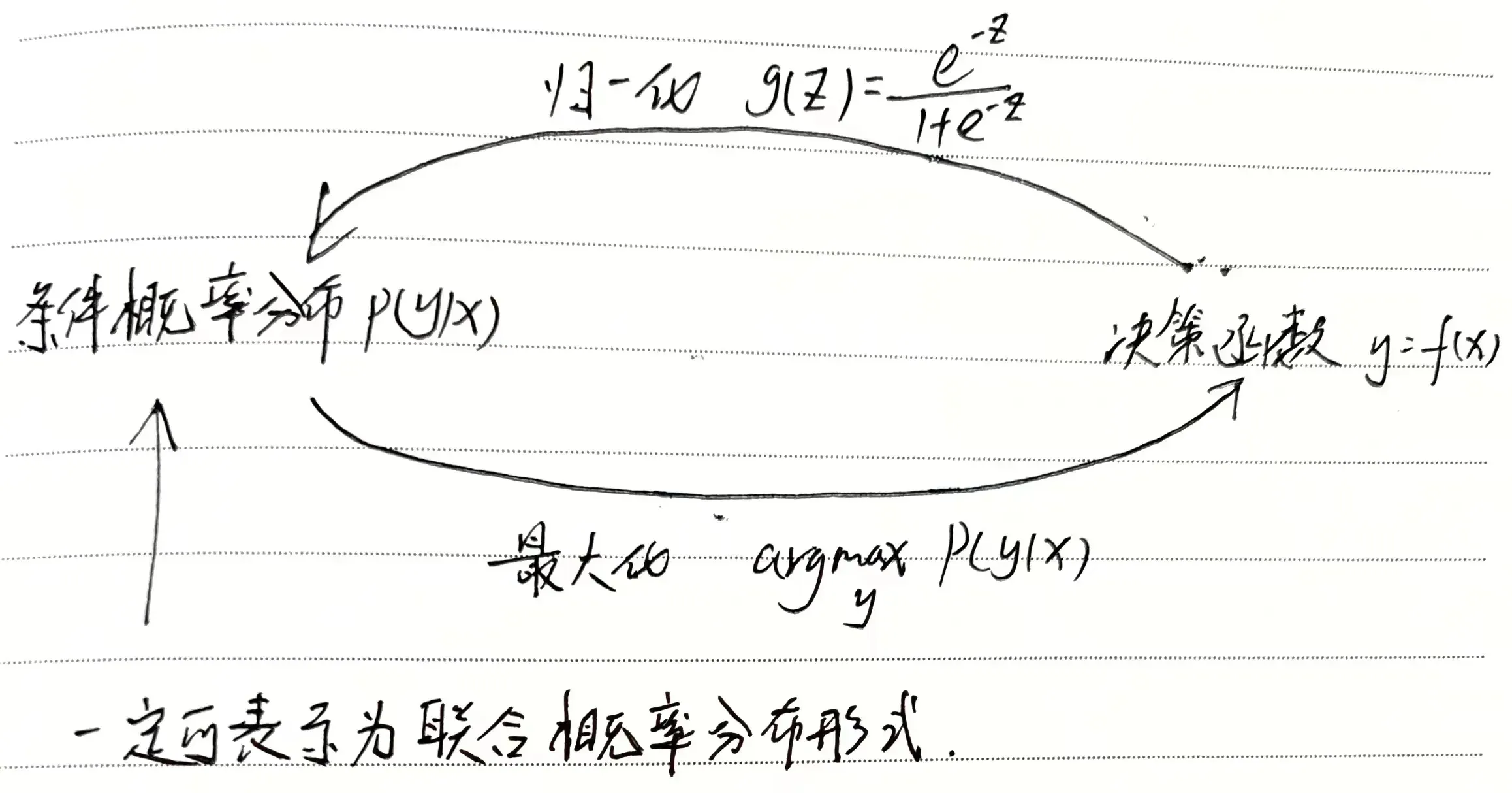

概率模型——条件概率

非概率模型(确定性模型)——决策函数

概率模型

- 决策树

- 朴素贝叶斯

- 隐马尔科夫模型

- 条件随机场

- 高斯混合模型

- 概率混合模型

- 潜在狄利克雷分配

概率模型的代表为 概率图模型

-

联合概率分布由有向图和无向图表示

-

遵循加法,乘法原则

非概率模型

线性模型

- 感知机

- 线性SVM

- K近邻

- K均值

- 潜在语义分析

非线性模型

-

核函数SVM

核函数:

核技巧

-

AdaBoost

-

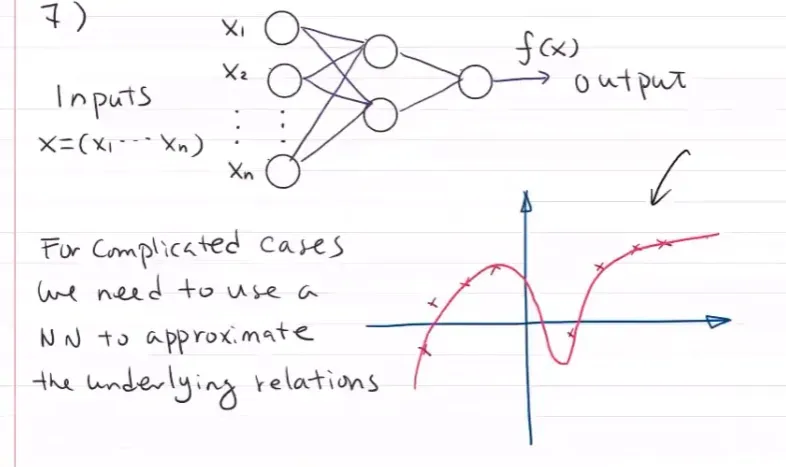

神经网络

逻辑斯蒂回归

将线性回归模型 代入

,归一化可得到概率分布,故逻辑斯蒂回归既是概率模型又是非概率模型

1.2.4 基本分类

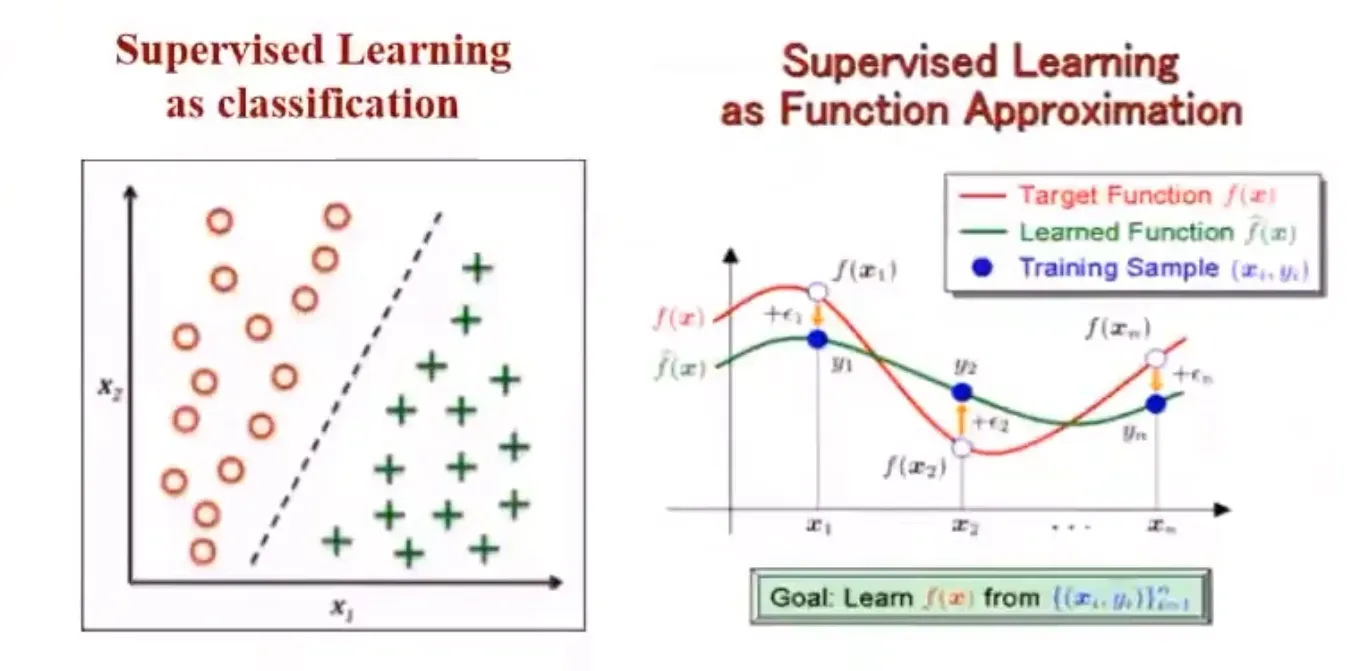

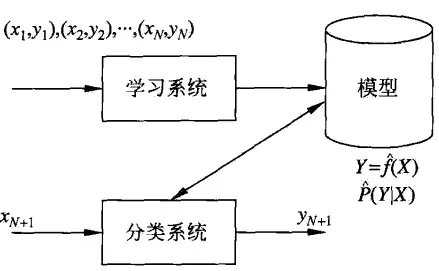

监督学习

从标注的数据中学习预测模型

- 标注:已知实例的分类,某些特征的取值

本质:学习输入与输出间映射的统计规律

分类

根据输入输出类型:

- 分类问题:输出变量为有限个离散变量,SP:二分类问题

- 回归问题(预测):输入变量与输出变量均为连续变量

- 标注问题:输入变量和输出变量均为变量序列

符号表示

输入变量: ,取值空间

——输入空间

输出变量: ——输出空间

每个具体输入:实例(instance) 用特征向量 (feature vcector) 表示

注 :

训练数据集:

联合概率分布:给出 与

之间遵循的关系——

假设空间: 输入到输出的映射由模型表示 假设空间 hypothesis space 所有可能的模型的集合

- 概率模型:

条件概率分布

- 决策函数:

形式化

学习的模型分为概率模型和非概率模型

- 概率模型由条件概率表示,在预测时,通过

得到输出

- 非概率模型由决策函数表示,在预测时,给出一个输出结果

特征

- 数据有标注

- 输入产生相应的输出

- 本质是学习输入与输出映射的统计规律

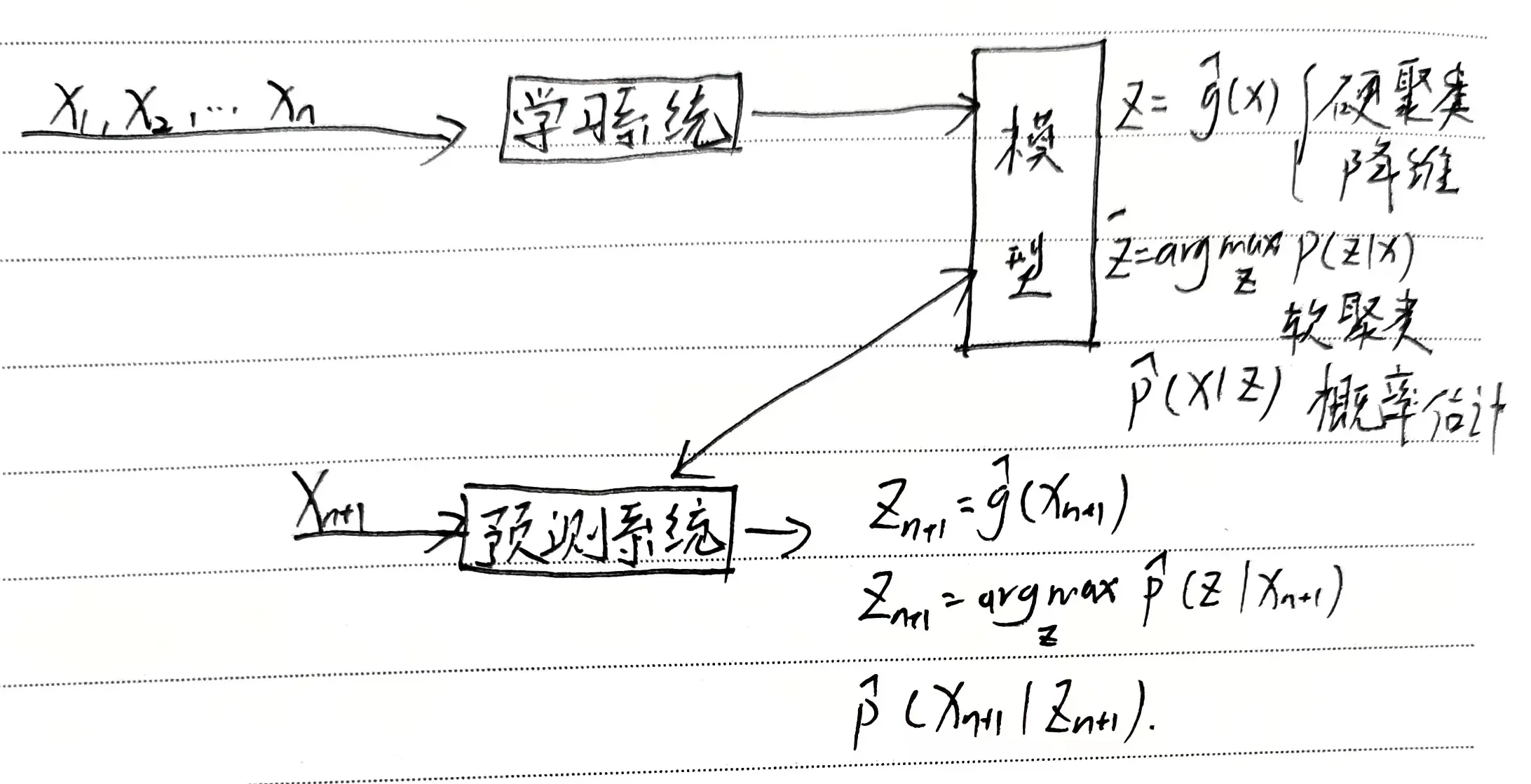

无监督模型

从无标注的数据中学习预测模型

特征

- 数据无标注——自然得到的数据

- 预测模型:每个输出都是对输入的分析结果,表示数据的类别(聚类)、转换(降维)、概率估计

- 本质是学习数据中的统计规律与潜在结构

符号表示

:输入空间

:隐式结构

- 降维

- 硬聚类:一对一,只属于一个类别

- 软聚类:一对多,可能属于多个类别

模型:

:所有可能模型的集合——假设空间

训练数据: ,

表示样本

形式化

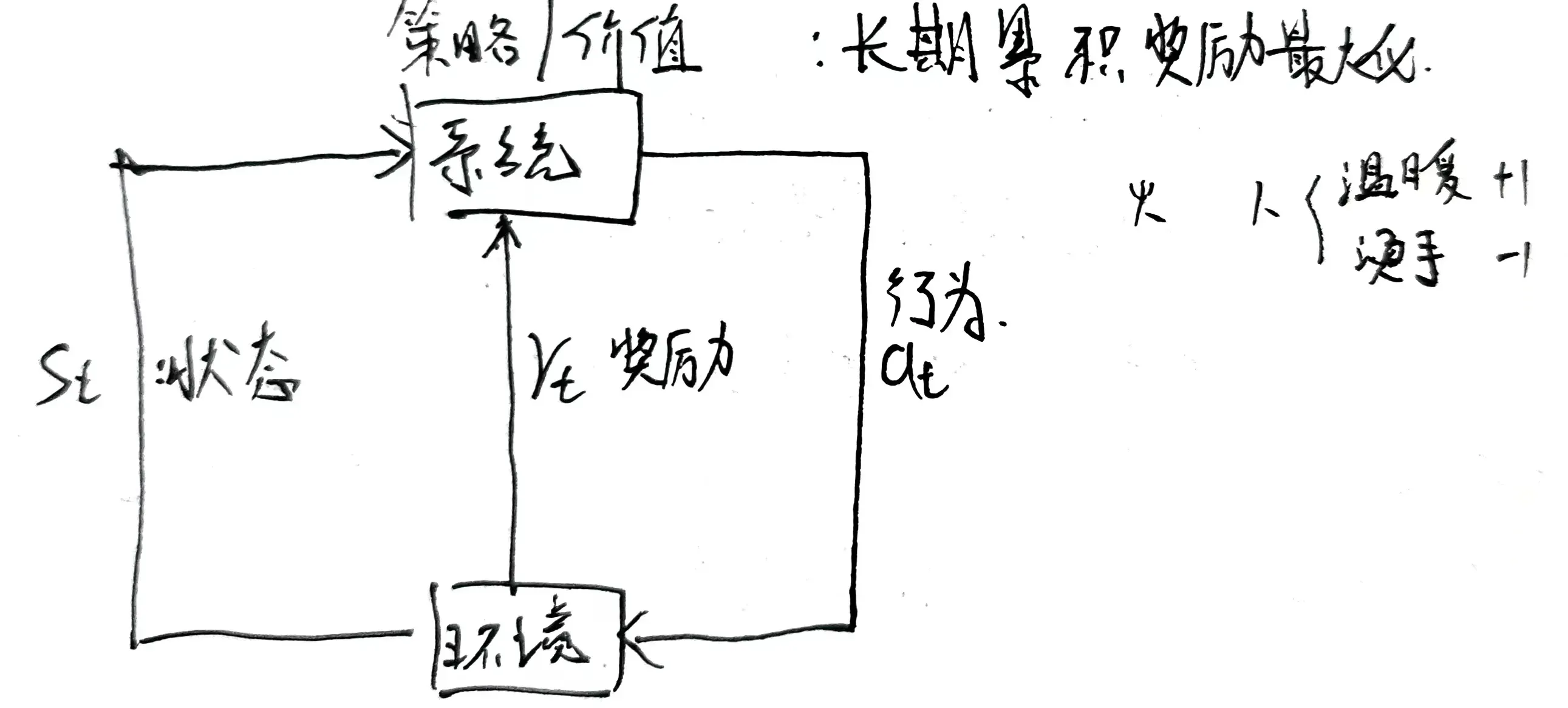

强化学习

系统与环境连续互动中学习最优行为策略

半监督学习

少量标注,大量未标注数据

主动学习

机器找到对学习最有帮助的实例,给出实例让人标注

1.2.5 按技巧分类

- 贝叶斯学习

- 核方法

贝叶斯方法

利用贝叶斯原理,计算在给数据下,模型的后验概率

,并进行模型估计、数据预测

特点

- 模型参数、未知量用变量表示

- 使用模型的先验概率

步骤

-

后验概率

变先验

-

预测,并计算期望

取贝叶斯估计最大,可得到极大似然最大

-

似然概率,在已知参数

取值时,取得数据

的概率

对于极大似然估计,目标是调整参数

使数据

出现的概率最大化,即令

最大化,此时的

作为参数的估计值

-

:为先验知识,通过统计数据可得,作为已知数据

是固定的,后验概率

可以通过计算似然概率与先验概率求得

贝叶斯估计:使后验概率最大的

为贝叶斯估计的参数

所以重点来到对似然概率的求解

核方法

使用核函数表示和学习非线性模型,可以将线性模型扩展到非线性模型

- SVM

- 核PCA

- K均值

显式定义:

隐式定义:直接定义核函数,在输入空间中内积运算

1.3 统计学习三要素

方法=模型+策略+算法

- 模型:选定某一类模型——SVM/EM

- 策略:模型选择标准、准则——

,风险最小化

- 算法:怎样快速确定模型

1.3.1 模型

1.3.2 策略

按什么样准则选择模型的最优参数组

损失:度量模型 一次 预测的好坏

风险:度量 平均 意义下预测的好坏

常用损失函数

预测模型得出的预测值 与

有差距,用损失函数

表示

风险函数(期望损失)

关于联合分布的期望损失(expectation risk)

表示 关于联合分布

的平均意义下的损失

不可计算:

未知。

- 若

已知,则可通过

计算

- 病态:期望损失用到

朴素贝叶斯后验概率最大化是期望风险最小化策略

经验函数(平均损失)

empirical risk

极大似然估计是经验风险最小化策略

可观测样本的联合概率分布一定是最大(小概率事件原理)可采样的, 越大,联合概率

越大

可得损失函数,也即对数损失函数。即经验风险最小化策略

由于现实中 很小,需要对

矫正

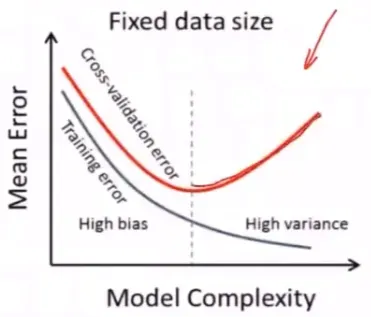

经验风险最小化和结构风险最小化

样本量足够大,用经验风险最小化策略 —— empirical risk minimization,ERM

样本容量小 ——过拟合 参数过多

过拟合解决思路

用结构风险最小化策略——structural risk minimization SRM

用于权衡

与

1.3.3 算法

用什么样方法,求最优模型

梯度下降求损失函数的极值,最优解

1.4 模型评估与选择

噪声数据:训练样本本身还可能包含一些噪声,这些随机噪声会给模型精确性带来误差

1.4.1 误差

学习器的预测输出与样本真实输出之间的差异被定义为机器学习中的误差

分类问题中,

训练误差 :学习器在训练集上的平均误差,经验误差

- 描述输入属性和输出分类之间的相关性,能够判定给定的问题是不是一个容易学习的问题

测测误差 :学习器在测试集上的误差,泛化误差

- 反映了学习器对未知测试数据集的预测能力

实用的学习器都是测试误差较低,即在新样本上变现比较好的学习器

eg:

0-1损失

误差率 error

正确率 right

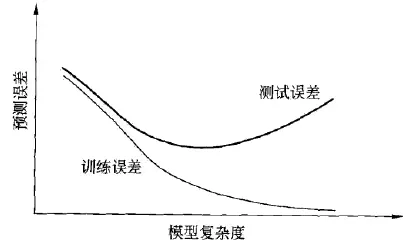

模型复杂度与测试误差

当模型复杂度较低时,测试误差较高

随着模型复杂度增加,测试误差将逐渐下降并达到最小值

之后当模型复杂度继续上升,测试误差会随之增加,对应过拟合的发生

理想模型

逼近 “真”模型

1.4.2 欠拟合

欠拟合:学习能力太弱,以致于训练数据的基本性质都没学到

在实际的机器学习中,欠拟合可以通过改进学习器的算法克服,但过拟合却无法避免

-

由于训练样本的数量有限,所以具备有限个参数的模型就足以将所有样本都纳入其中。

但模型的参数越多,与这个模型精确符合的数据也越少,将这样的模型运用到无穷的未知数据中,过拟合的出现便不可避免

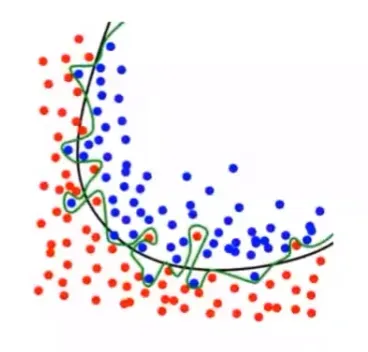

1.4.3 过拟合

原因 :将噪音数据并入模型

过拟合:对训练数据拟合程度越高,学习时模型会越复杂(包含的参数过多),从而导致训练误差较低但测试误差较高(失去泛化能力)

- 表现为错把训练数据的特征当做整体的特征

多项式复杂度代表模型复杂度与自由度,自由度过高会出现过拟合问题

避免过拟合

-

增大样本容量

-

集成学习:训练很多模型,对模型求均值

-

正则化:对模型复杂度加以惩罚

-

交叉验证

正则化

控制模型参数范围,使一些参数趋于0或等于0

结构风险最小化策略的实现

正则化项

-

范数尽可能趋于0

-

范数——使参数稀疏化

经验风险较小的模型,正则化项会比较大

- 用于选择经验风险与模型复杂度同时小的模型

奥卡姆剃刀

在所有可能解释数据的模型中,模型越简单越好

-

对于贝叶斯估计,先验概率为正则项。

复杂模型,先验概率小

简单模型,先验概率大

正则化为什么防止过拟合

对于平方损失函数,

正则化项可看做拉格朗日算子,该函数极值点为令 的点

也可以对参数和进行约束

KKT条件:

构造拉格朗日函数

令

由此可知,带正则化项与带约束项是一致的

1.4.4 泛化能力

模型对位置数据的预测能力

由于测试数据集是有限的,依赖测试误差的评价结果不可靠

泛化误差:风险函数(期望损失)最小化

由于 ,无法计算期望损失

比较 泛化误差上界 ,上界小的模型比较好

- 样本容量越多,泛化上界

- 假设空间容量越多,泛化误差上界越大

泛化误差上界

的期望风险,

经验风险,

经验风险最小化策略,

对于 的泛化能力

-

对于任一

,以

概率上式成立,

-

为

由泛化上界可知,

样本多,备选模型少,小范围使用,不信任普适性,则泛化误差小

交叉验证

验证集和测试集不用于训练模型

调参(是否过拟合)——评估泛化能力

- 对模型框架定义

- 学习率

交叉验证思想在于重复利用有限的训练样本,通过将数据切分成若干子集,让不同的子集分别组成训练集与测试集,并在此基础上反复进行训练、测试和模型选择,达到最优效果。

交叉验证 适用于

-

简单交叉验证

训练+测试随机划分

-

k折交叉验证

将数据集分为

个大小相等,互不相交的子集,用

个子集作为训练集,1个用作测试集,进行

轮训练,保证每份数据集都被用作测试集,选出

次评测中平均测试误差最小的模型

留一交叉验证 :一份一个样本

- 折数=样本数

1.4.5 参数取值

参数的取值是影响模型性能的重要因素,同样的学习算法在不同的参数配置下,得到的模型性能会有显著差异

假设一个神经网络有1000个参数,每个参数有10种取值可能,对于每一组训练/测试集就有 个模型需要考察,因此在调参过程中,主要的问题就是性能与效率的折衷

1.4.6 维数诅咒

在高维空间中,同样规模的数据集会变得很稀疏

在高维空间,达到与低维空间相同的数据密度需要更大的数据量

1.5 监督学习

监督学习假定训练数据满足独立同分布,并根据训练数据学习出一个由输入到输出的映射模型

- 所有可能的映射模型共同构成了假设空间

监督学习的任务是在假设空间中根据特定的误差准则找到最优的模型,形式为

1.5.1 学习方法

生成方法

关注 X,Y的真实状态,强调数据本身(掌握所有语言再判断)

首先学习X,Y的联合概率分布 ,再求出条件概率分布

- 反映同类数据的相似度

- 学习的收敛速度快:当样本容量增加,学到的模型更快,收敛于真实模型

- 当存在隐变量时,用生成方法

判别方法

关注给定输入X,有什么样的输出Y,强调数据边界(语言关键词)

直接学习决策函数 或条件概率

- 反映数据的差异

- 学习难度小,准确率高

- 对数据进行抽象,定义特征并使用特征简化学习问题

- 具有更高的准确率和更简单的使用方式

1.5.2 模型

生成模型

由生成方法学习到的模型为生成模型,遍历所有结果,取概率最大的为结果

- 朴素贝叶斯

判别模型

由判别方法生成的模型为判别模型,直接得到结果

- 感知机

- K近邻

- 逻辑斯蒂回归

- 最大熵模型

- SVM

1.5.3 监督学习应用

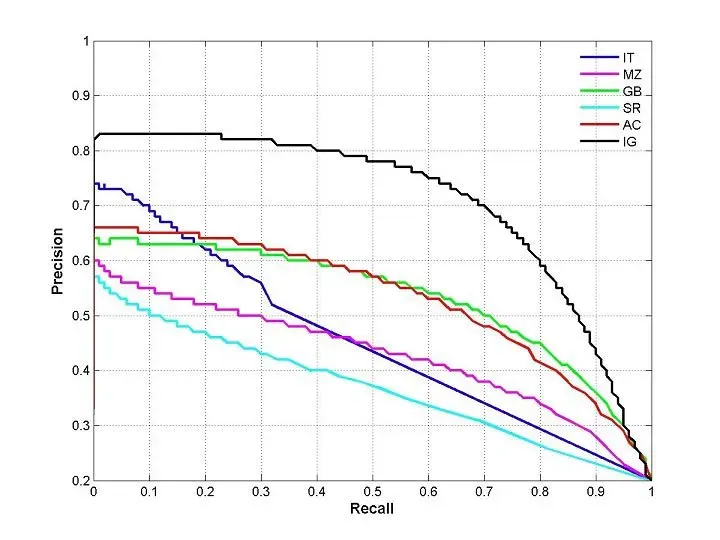

分类问题

输出为有限个离散值

二分类问题

T:预测正确,P:预测为正类

F:预测错误,N:预测为负类

当 减小,

会增大

指标

精确率(查准率)与召回率(查全率)是相互矛盾的,在不同模型中要是用不同评价指标

越大,则

越小

调和均值

标注问题

输入:观测序列

表示一个样本在不同阶段的取值

输出:标记序列/状态序列

表示输出在不同阶段的值

回归问题

用于预测输入变量和输出变量的关系,输入与输出之间的映射函数

函数拟合

学习+预测

变量个数—— 大小

特征数量

平方损失函数MSE(mean square error) :

- 最小二乘法求解LMS(least mean square)

- MSE最小化

极大似然估计

对于复杂的现实问题,很难用已有的函数进行拟合

神经网络逼近 ——预测问题

概率拟合 贝叶斯——分类问题

则分类为0

1.6 频率派与贝叶斯派

1.6.1 频率派

频率本身会随机波动,但随着重复实验的次数不断增加,特定事件出现的频率值会呈现出稳定性,逐渐趋近于某个常数

从事件发生的频率认识概率的方法称为 “频率学派”。概率被认为是一个独立可重复实验中,单个结果出现频率极限。

稳定的频率是统计规律性的体现 ,用其表征事件发生的可能性是一种合理的思路

频率学派依赖的是古典概型。由于古典概型只描述单个随机事件,并不能刻画两个随机事件之间的关系。所以引入的 条件概率 ,进一步得出 全概率公式 。

全概率公式代表了频率派解决问题的思路:先做出一些假设 ,再在这些假设下讨论随机事件的概率

1.6.2 贝叶斯派

逆概率 :由全概率公式调整得来,即在事件结果 确定的条件下,推断各种假设发生的可能性

通过贝叶斯公式,可以将后验概率 转变为先验概率

:先验概率,假设成立的概率

:似然概率

:后验概率,已知结果下情况下假设成立的概率

贝叶斯定理提供了解决问题的新思路:根据观测结果寻找最佳的理论解释

1.6.3 区别

频率学派 认为假设是客观存在且不会改变的,即存在固定的先验分布,需要通过 最大似然估计 确定概率分布的类型和参数,以此作为基础进行概率推演。

贝叶斯学派 认为固定的先验分布是不存在的,即参数本身是随机数。假设本身取决于结果,是不确定的、可以修正的。数据的作用就是对假设不断修正,通过 贝叶斯估计 使后验概率最大化 。

从 参数估计 角度也能体现两种思想的差距

由于实际任务中可供使用的训练数据有限,因而需要对概率分布的参数进行估计。

最大似然估计(最大似然概率 )的思想是使训练数据出现的概率最大化,以此确定概率分布中的未知参数

贝叶斯方法(最大后验概率 ):根据训练数据和已知的其他条件,使未知参数出现的可能性最大化,并选取最大概率对应的未知参数

- 还需要额外的信息 ——先验概率

文章出处登录后可见!